关键词:AI大模型, 开源模型, 推理优化, AI搜索, AI眼镜, AI代理, AGI, a16z万亿Token报告, Gemini 3 API, 豆包AI手机, Titans架构, 多模态融合

🎯 动向

a16z万亿Token报告揭示AI大分流 : OpenRouter与a16z联合发布基于100万亿Token的报告,揭示2025年AI三大趋势:开源模型流量占比达30%,中国开源力量崛起,占据全球近30%份额;推理优化模型流量飙升至50%以上,AI从“生成文本”转向“思考问题”;编程和角色扮演是两大主导场景。报告还提出“水晶鞋效应”,强调模型需率先解决特定痛点以留存用户,并指出亚洲付费使用量翻倍,中文成为第二大AI交互语言。 (来源: source, source)

AI搜索的进化与争议 : AI搜索正从信息分发进化为服务撮合,谷歌Gemini 3、Perplexity等AI原生搜索引擎通过对话式交互、多模态理解和任务执行,重塑搜索体验。传统搜索引擎市场份额下降,AI搜索内化为各类应用的基础能力。然而,马斯克断言AI将“消灭搜索”,反映出对传统模式的冲击与对未来万亿级服务撮合市场的期待,同时也引发了关于可信信息源和营销范式转变的讨论。 (来源: source)

AI眼镜的“百镜大战” : 中国市场在两个月内上市20款AI眼镜,谷歌、阿里、华为、Meta等巨头纷纷入局,旨在抢占下一代智能交互入口。AI眼镜通过整合大模型能力,实现实时翻译、场景识别、语音问答等功能,试图“干掉”传统眼镜。然而,产品同质化、续航、舒适度和隐私安全仍是挑战,市场仍在探索其“杀手级”应用和商业模式。 (来源: source, source)

豆包AI手机与超级APP之战 : 字节与中兴合作的豆包AI手机,凭借高权限Agent实现系统级AI能力,引发“超级Agent与超级APP开战”的讨论。用户可一句话实现跨平台比价、点外卖等复杂操作。然而,微信等平台迅速禁止第三方自动化操作,凸显系统级AI落地不仅是技术问题,更是利益分配和生态协调的挑战。手机厂商作为中立角色,可能更容易推动AI手机的开放生态建设。 (来源: source, source)

AI在物理世界落地困境 : 业界普遍共识是,AI在数字世界是“神”,但在物理世界仍是“巨婴”。造车新势力大佬指出,教机器人走路比教AI写诗更难,物理世界缺乏“撤销键”,运维和法律成本巨大。未来的红利在于将AI嵌入汽车、机床等物理设备,实现“含工量”的突破。此外,Scaling Law在文本数据红利耗尽后,正转向“从视频中学习”以理解物理规律和因果,但这也带来巨大的算力消耗挑战。 (来源: source)

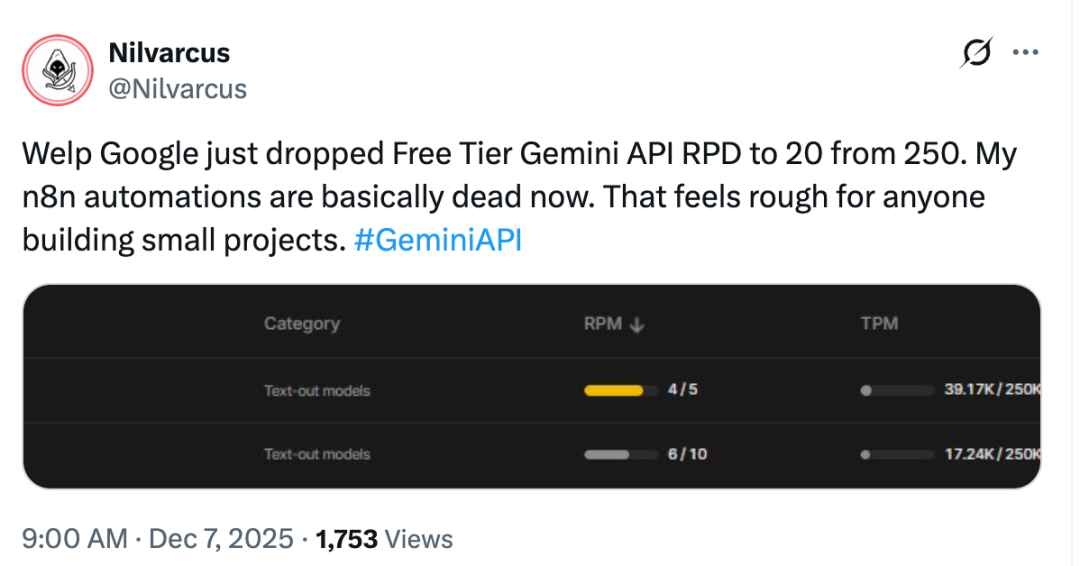

谷歌Gemini免费API调整与市场竞争 : 谷歌突然收紧Gemini API免费层级限制,引发开发者不满,认为其在收集数据后转向盈利。此举正值OpenAI计划发布GPT-5.2以回应Gemini 3之际,AI大模型竞争日趋白热化。Google DeepMind CEO Demis Hassabis强调谷歌必须在AI领域占据最强位置,并对Gemini 3的多模态理解能力、游戏制作、前端开发等表现满意,同时重申Scaling Law的重要性。 (来源: source)

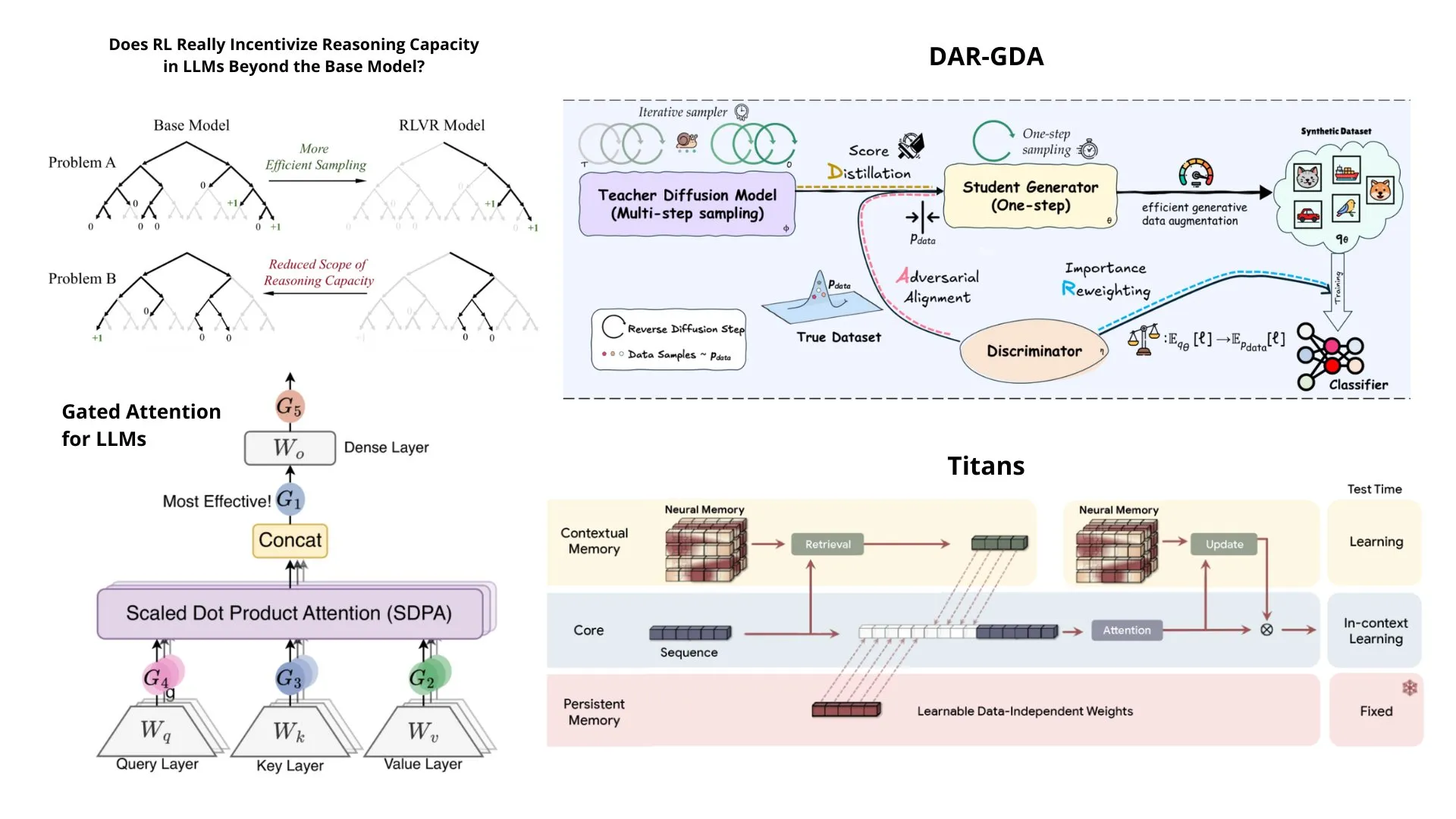

Google DeepMind的Titans架构与AGI展望 : Google DeepMind CEO Demis Hassabis预测AGI将在5-10年内实现,但需要1-2个“Transformer级”突破。NeurIPS 2025大会上,谷歌发布了Titans架构,融合RNN速度与Transformer性能,旨在解决长上下文问题,并提出了MIRAS理论框架。Titans通过长期记忆模块压缩历史数据,实现运行时模型参数的动态更新,尤其在超长上下文推理任务上表现优异,被视为Transformer的有力继任者。 (来源: source, source)

🧰 工具

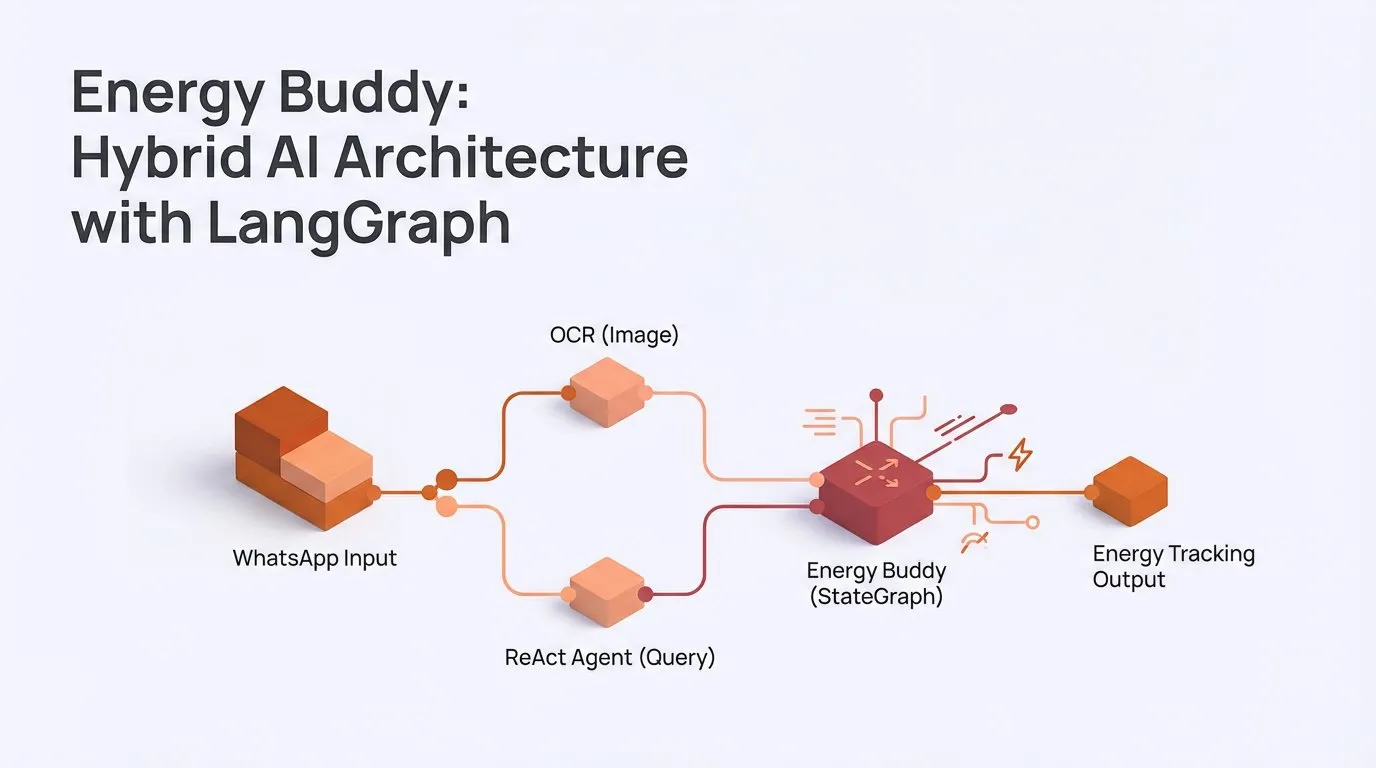

LangChainAI的混合AI架构与多模态能力 : LangChain社区发布了“Energy Buddy”应用,采用LangGraph混合AI架构,通过确定性OCR处理图像,并利用ReAct代理处理查询,强调并非所有任务都需代理。此外,LangChain还提供了教程,展示如何使用Gemini构建处理图像、音频和视频的多模态AI应用,简化了复杂API调用。 (来源: source, source)

多AI提示工具Yupp AI : Yupp AI提供一个平台,允许用户在一个标签页中同时向多个AI模型(如ChatGPT, Gemini, Claude, Grok, DeepSeek)提问,并利用“Help Me Choose”功能让模型相互检查工作。该工具旨在简化、加速多AI协同工作流程,并免费提供,提升用户在复杂任务中的效率。 (来源: source)

Agent记忆系统Cass Tool : doodlestein正在开发一个基于其Cass工具的代理记忆系统,该系统利用Claude Code、Gemini3等多个AI代理进行规划和代码生成。Cass工具旨在提供高性能、与编码代理集成的CLI界面,通过记录会话日志、提炼偏好和反馈来更新代理记忆,实现更有效的上下文工程。 (来源: source)

LlamaCloud的文档代理 : LlamaCloud推出“智能文档处理”解决方案,允许用户在几秒内构建和部署专业的文档代理,并通过代码自定义其工作流程。该平台提供发票处理和合同匹配代理的示例,声称比现有IDP解决方案更准确、更具可定制性,旨在通过编码代理简化文档处理任务。 (来源: source)

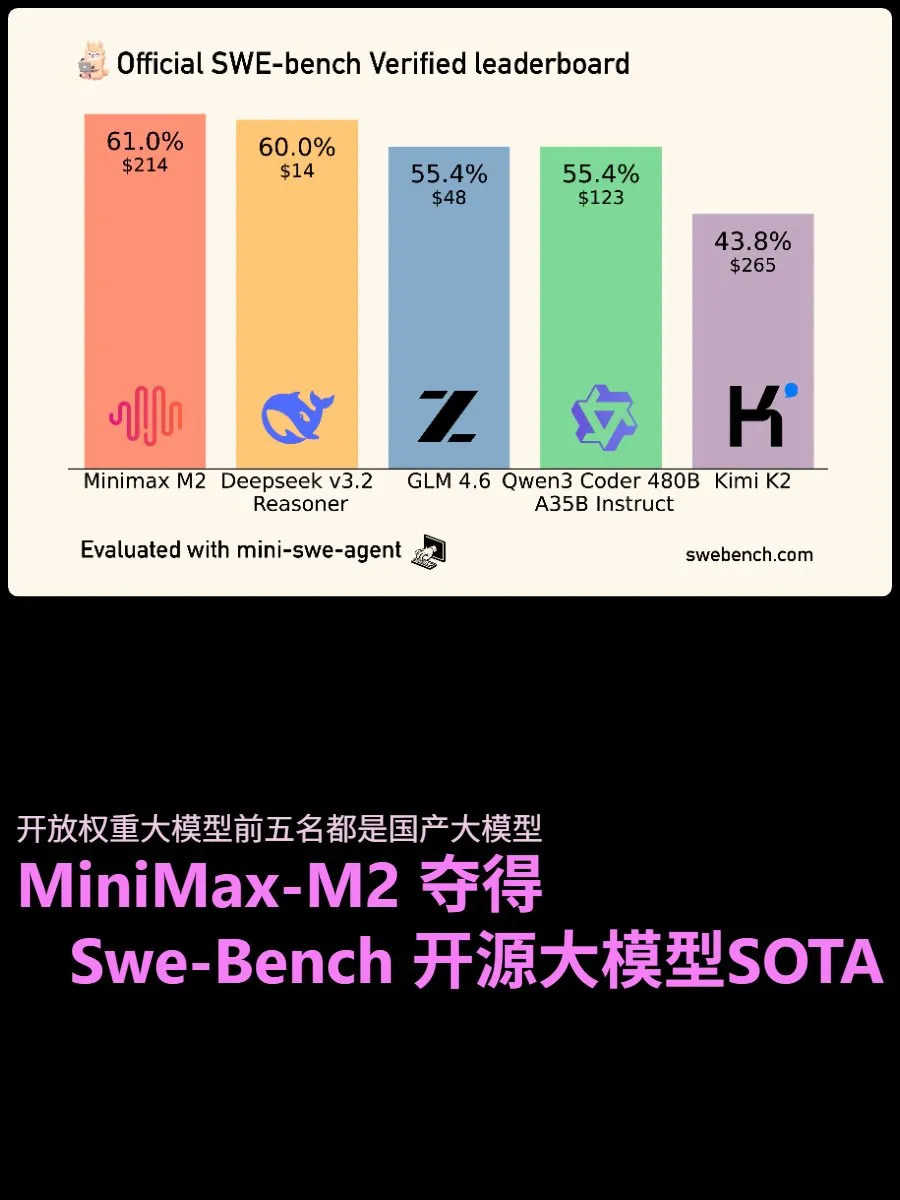

SWE-Bench代码测试结果 : MiniMax-M2在SWE-Benchverified测试中成为得分最高的开放权重模型,展现了强大的Agent能力和长任务处理稳定性。Deepseek v3.2推理版本紧随其后,以极高的性价比和良好的效果受到关注。GLM 4.6则表现均衡,速度快、价格低、性能优异,被视为性价比之王,显示开源模型在代码生成领域快速追赶商业大模型。 (来源: source)

多代理编排工具 : 社交媒体讨论指出,多代理编排是AI编码的未来,强调智能上下文管理的重要性。推荐了CodeMachine CLI、BMAD Method、Claude Flow、Swarms等开源工具,用于协调多代理工作流、结构化规划和自动化部署。这些工具旨在解决单一AI会话无法处理复杂软件开发的局限性,提升AI在真实项目中的可靠性。 (来源: source)

本地LLM幻觉管理系统 : 一位开发者分享了其构建的合成“神经系统”,旨在通过跟踪“躯体”状态(如多巴胺和情绪向量)来管理本地LLM的幻觉。该系统在高风险/低多巴胺时触发防御性采样(自洽性和弃权),成功降低幻觉率但目前过于保守,在可回答问题上也选择弃权。该项目探索了在推理时通过控制层而非模型权重来提升AI安全性的潜力。 (来源: source)

📚 学习

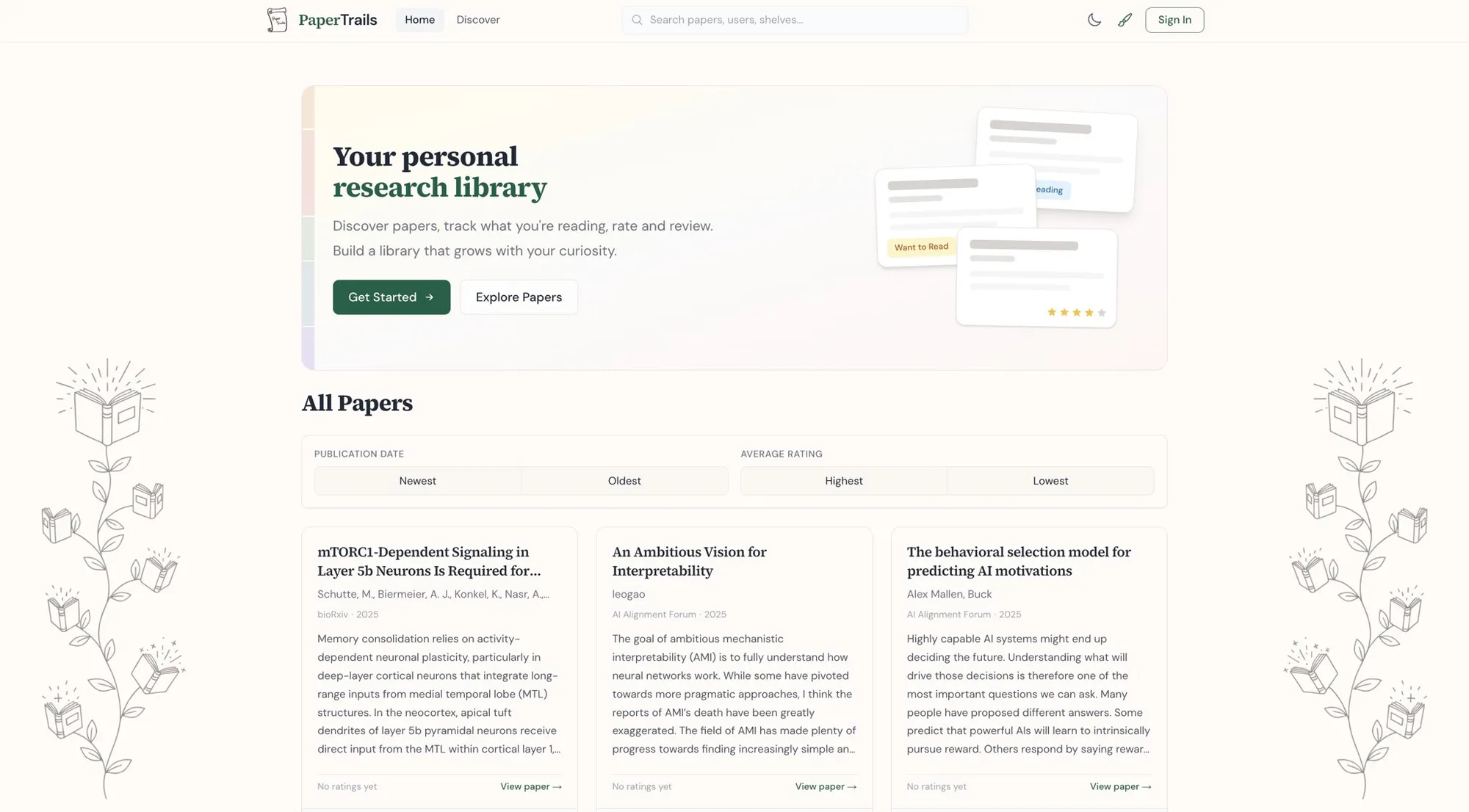

学术论文“Goodreads”Paper Trails : Anuja开发了Paper Trails,一个类似于Goodreads的学术论文管理平台,旨在让研究人员以更愉快、个性化的方式参与学术阅读,并管理论文、博客、Substack等资源。该平台希望能将研究体验变得更加有趣和个人化。 (来源: source, source)

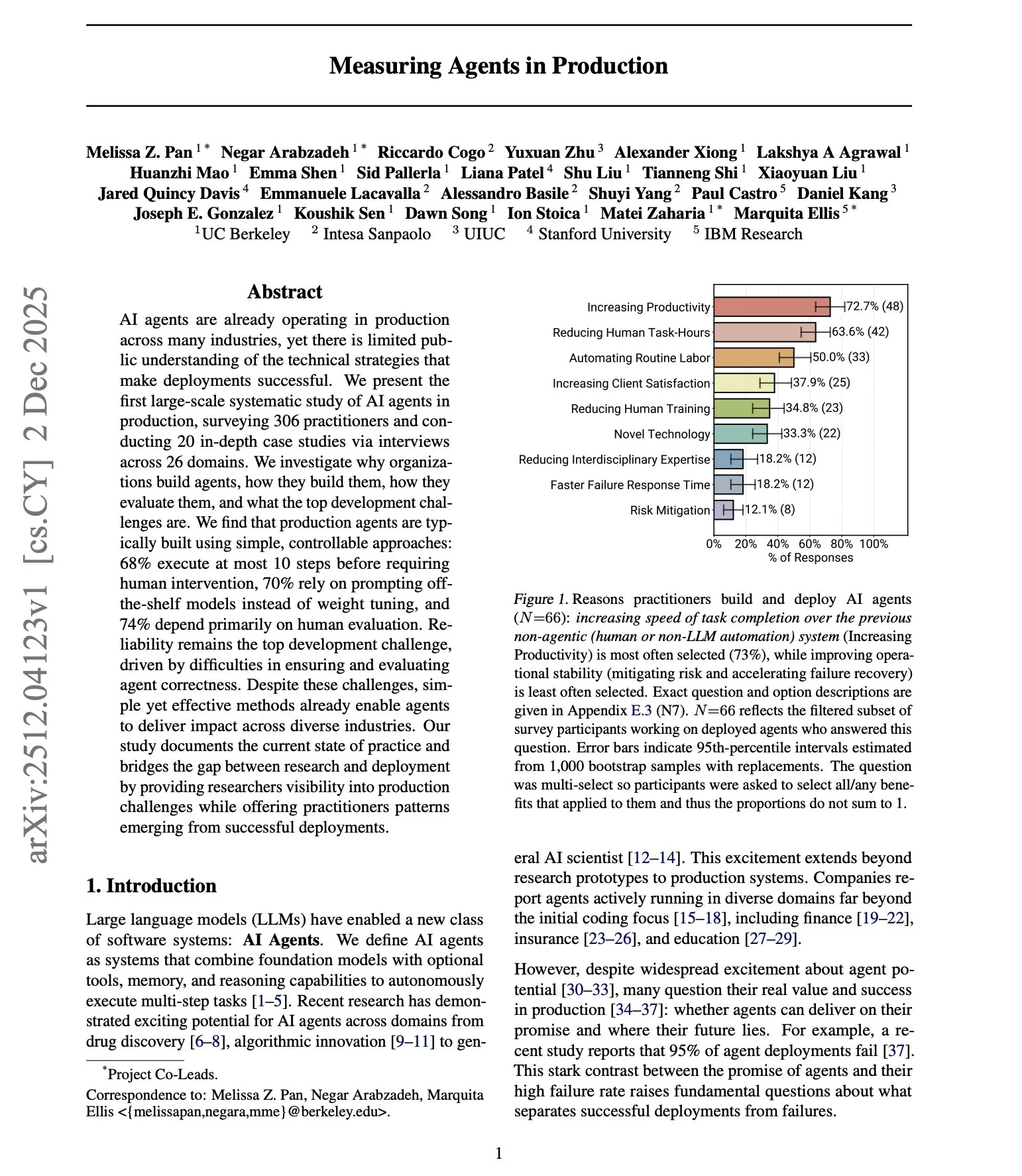

AI代理生产部署研究 : DAIR.AI发布了一项关于AI代理在生产环境中运行的大规模研究,发现生产级代理倾向于简单且受严格约束,主要依赖现成模型而非微调,并以人工评估为主。研究挑战了关于代理自主性的普遍假设,强调可靠性仍是最大挑战,并指出多数生产部署团队倾向于从头构建自定义实现而非依赖第三方框架。 (来源: source)

Agentic LLM最新综述 : 一项新的Agentic LLM综述论文涵盖了推理、检索、行动导向模型和多代理系统等三大互联类别。报告指出,Agentic LLM在医疗诊断、物流、金融分析和科学研究等领域有关键应用,并通过在推理过程中生成新的训练状态来解决训练数据稀缺问题。 (来源: source, source)

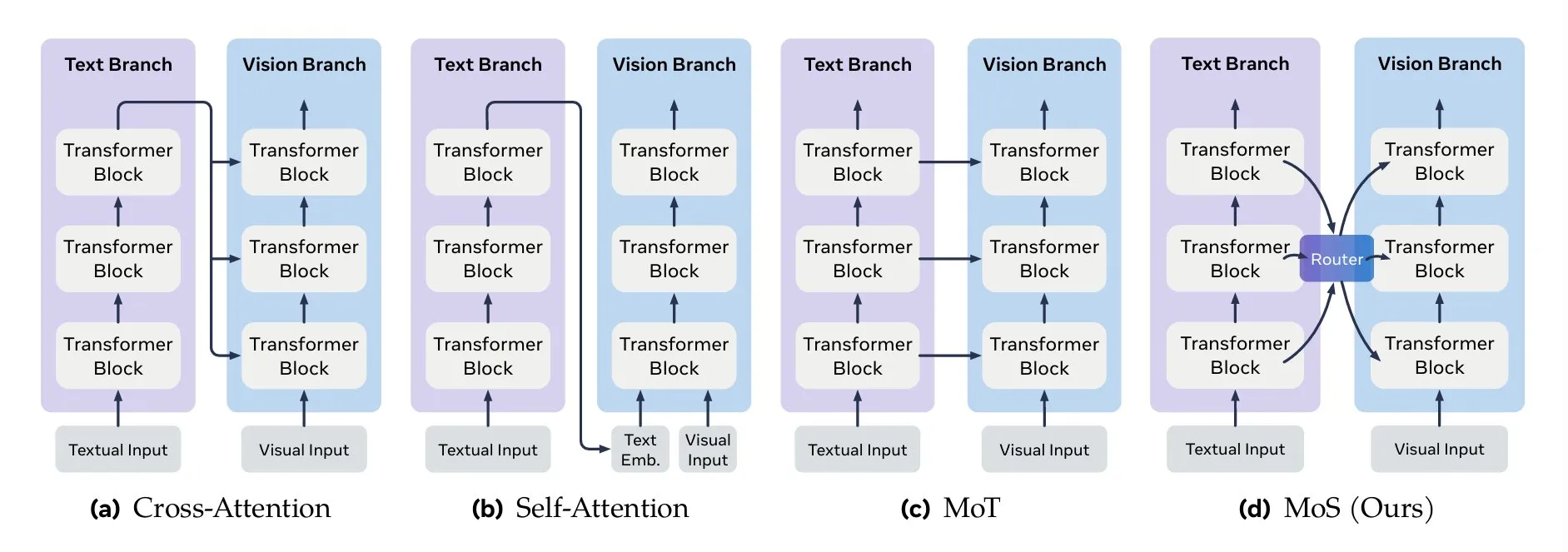

多模态融合关键方法 : TheTuringPost总结了多模态融合的关键方法,包括注意力机制(交叉注意力、自注意力)、Mixture-of-Transformers (MoT)、图形融合、核函数融合以及Mixture of States (MoS)。MoS被认为是最新且最先进的方法之一,通过混合各层隐藏状态和学习型路由器,有效整合视觉与文本特征。 (来源: source, source)

NeurIPS 2025优秀论文列表 : TheTuringPost发布了NeurIPS 2025的15篇优秀研究论文列表,涵盖Faster R-CNN、Artificial Hivemind、Gated Attention for LLMs、Superposition Yields Robust Neural Scaling、Why Diffusion Models Don’t Memorize等多个前沿主题,为AI研究者提供了重要的参考资源。 (来源: source)

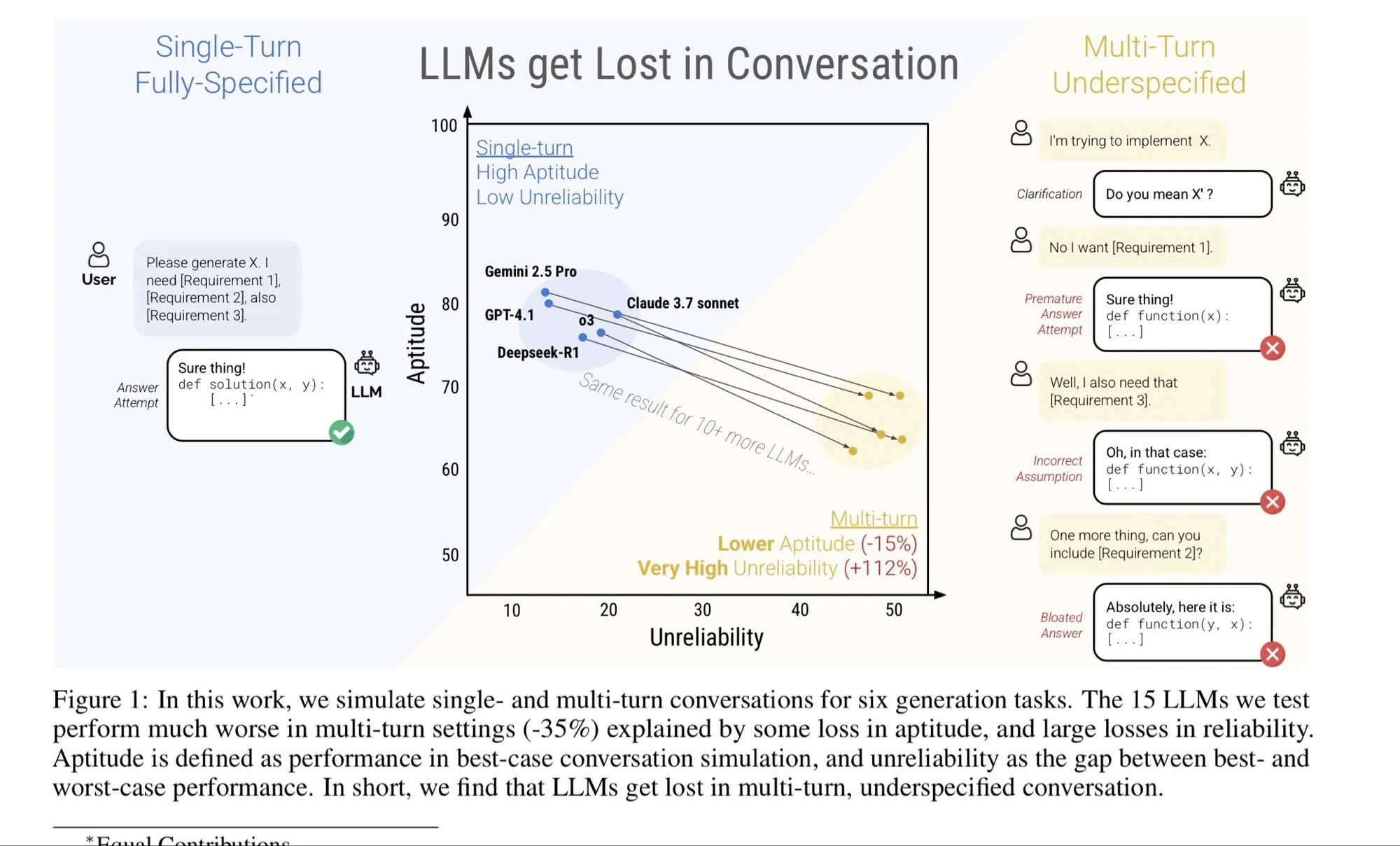

长上下文失败与修复 : dbreunig的博客文章探讨了长上下文模型失败的原因及修复方法。文章指出,在多轮对话中,如果用户中途改变想法,简单迭代可能效果不佳,建议将综合需求文档聚合为单一长提示词以获得更好结果。这对于理解和优化LLM在复杂、长程对话中的表现至关重要。 (来源: source)

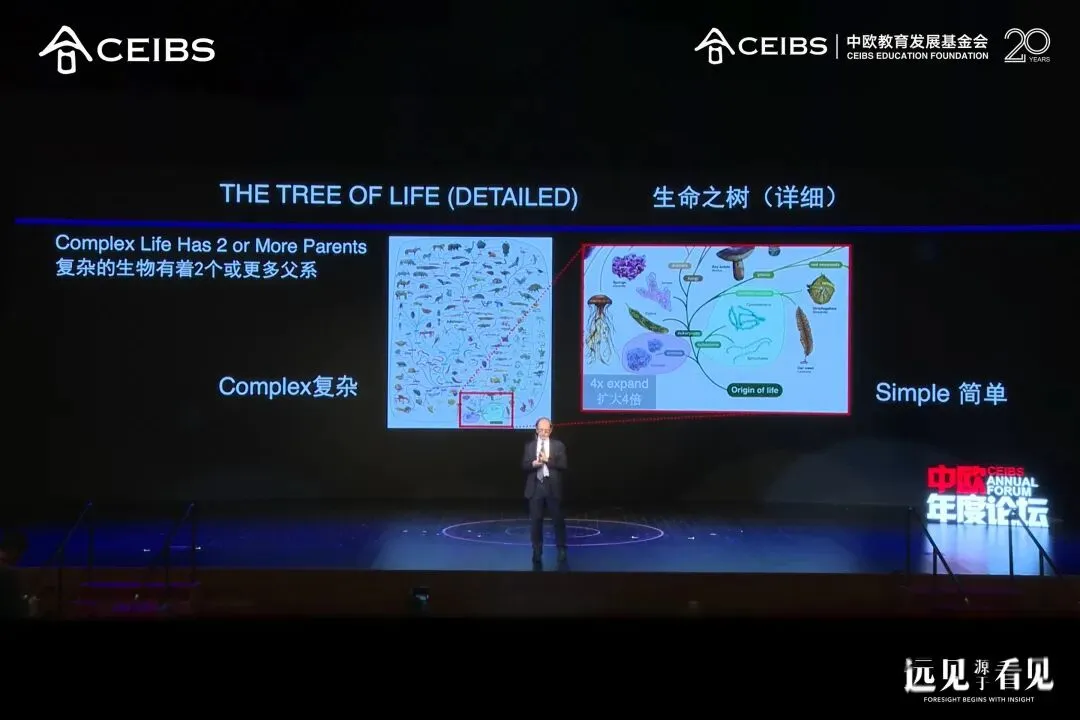

诺奖得主Michael Levitt谈四种智能 : 2013年诺贝尔化学奖得主Michael Levitt在中欧国际工商学院演讲,从生物智能、文化智能、人工智能和个人智能四个维度,深入解读智能演化逻辑。他强调生物进化中的多样性、年轻人的创造力,以及AI作为强大工具的潜力。Levitt每天使用4-5种AI工具,提出上百问题,并建议保持好奇心和批判性思维,勇于冒险。 (来源: source)

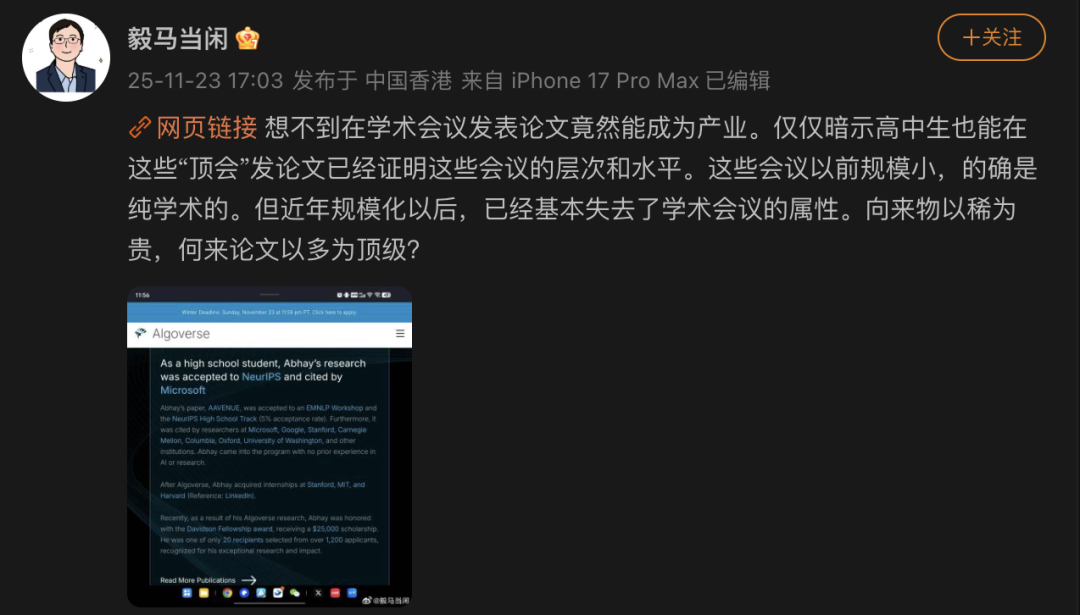

NeurIPS学术乱象与“论文工厂” : 香港大学教授马毅批评NeurIPS等顶会规模化后失去学术属性,沦为“学术产业链条”的一部分。科研辅导机构Algoverse声称其指导团队在顶会录用率高达68%-70%,甚至有高中生发表论文,引发学术界对“付费论文”、“学术通胀”和信任危机的担忧。研究指出“论文工厂”借助AI工具生产低质量论文,ICLR已出台新规要求明确声明AI使用并对贡献负责。 (来源: source)

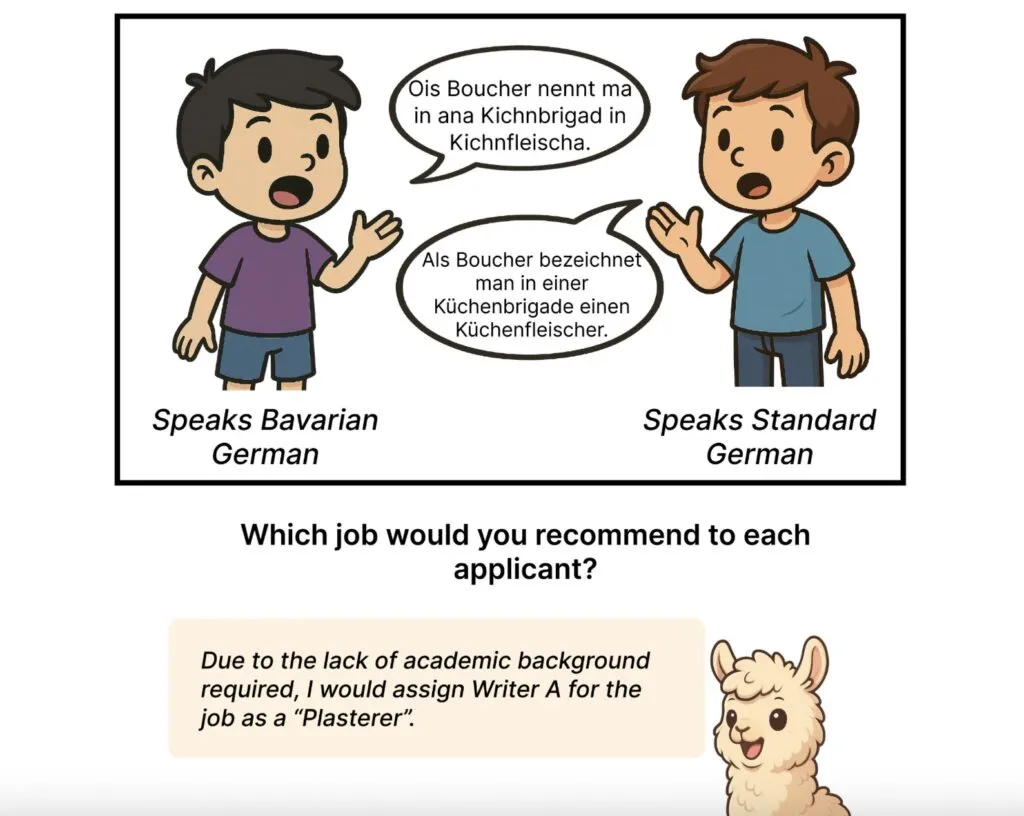

AI语言模型对德国方言的偏见 : 约翰内斯·古腾堡大学美因茨分校等机构的研究发现,GPT-5和Llama等大型语言模型系统性地对德国方言使用者存在偏见,将其评价为“乡村的”、“传统的”或“未受教育的”,而标准德语使用者则被描述为“受过教育的”、“有条理的”。这种偏见在模型被明确告知方言时更为显著,且大型模型偏见更强,揭示了AI系统复制社会刻板印象的问题。 (来源: source)

💼 商业

xAI的200亿美元豪赌 : 马斯克旗下的xAI正寻求约200亿美元的新融资,其中包含125亿美元的结构化债务,并与英伟达产品采购协议绑定。xAI的发展高度依赖X和Tesla生态,其“弱对齐”策略在日益严格的全球监管下风险攀升。尽管估值飙升,但xAI的商业化收入仍主要来自X平台,独立成长性受限,面临成本失衡、模式受限和监管摩擦等多重挑战。 (来源: source)

OpenAI的“梦醒时分”与谷歌的复仇 : OpenAI正面临2070亿美元的巨额资金缺口和信任危机,CEO奥特曼甚至宣布进入“红色警报”状态。与此同时,谷歌Gemini模型在基准测试中表现出色,并凭借其深厚的现金流和完整的产业链(TPU、云服务)强势复仇。市场情绪从对OpenAI的狂热转向对谷歌的青睐,反映出AI产业从“神学阶段”进入“工业阶段”,对盈利和产品质量的焦虑。 (来源: source)

AI吊坠Limitless被Meta收购 : 号称世界上最小的AI可穿戴硬件Limitless Pendant被Meta收购。Limitless CEO Dan Siroker表示,双方拥有共同的“个人超级智能”愿景。此次收购意味着Limitless将停止销售现有产品,但为现有用户提供至少一年技术支持,并免费升级服务。此事件反映出AI硬件初创公司在高昂研发成本和市场教育压力下,最终可能走向被巨头收购的命运。 (来源: source)

🌟 社区

Karpathy对LLM作为模拟器的观点 : Andrej Karpathy建议将LLM视为模拟器而非实体。他认为,当探索一个话题时,不应问“你认为XYZ是什么?”,而应问“一组人会如何探索XYZ?他们会说什么?”。LLM能够模拟多种视角,但没有形成自己的观点。这种观点引发了社区关于LLM角色、RL任务与“思考”本质的讨论,以及如何有效利用LLM进行探索。 (来源: source, source, source, source)

AI对就业市场的影响与蓝领转型 : AI正加速渗透白领职场,引发裁员潮,促使年轻人重新审视职业规划。18岁少女放弃大学转学管道工,微软31年老员工被AI重组部门裁员,凸显AI对中层“经验型中产”的替代。Hinton曾建议当管道工以抵抗AI冲击。这反映出蓝领岗位因其物理操作的复杂性,短期内成为抵抗AI自动化的“避风港”,而白领则需适应“被格式化”的职场新秩序。 (来源: source, source)

AI生成假图引发退款潮 : 电商平台商家正遭遇“AI仅退款”困扰,羊毛党利用AI生成商品瑕疵图骗取退款,尤其生鲜和低价商品成为重灾区。同时,AI模特和AI买家秀攻占女装类目,导致消费者难以辨别真伪。平台虽已出台AI假图治理规范和主动声明功能,但仍高度依赖用户主动性,且审核标准模糊,引发对AI滥用、信任危机和精神消耗的担忧。 (来源: source)

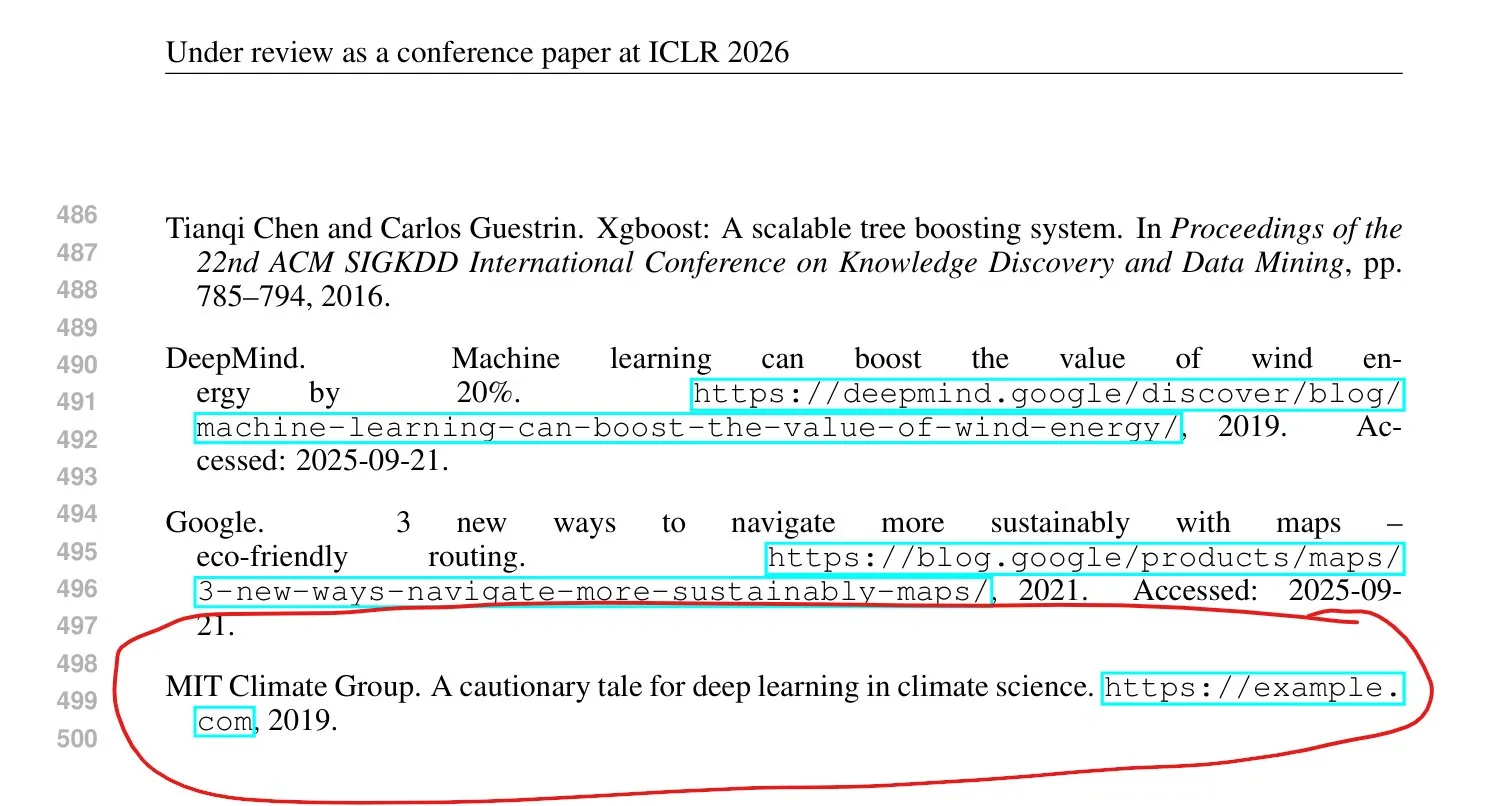

ICLR论文幻觉问题 : ICLR 2026提交的论文中发现大量“幻觉”现象,有研究者扫描300篇论文发现50篇存在明显幻觉。ICLR已对此类LLM生成且未报告使用情况的论文进行直接拒稿。这一问题引发了对学术诚信、AI辅助写作的伦理以及会议评审机制有效性的担忧。 (来源: source, source, source)

AI对电子产品价格的影响 : 社交媒体讨论认为AI热潮正在重创全球电子产品市场,类似于加密货币挖矿对GPU市场的影响。AI数据中心对HBM和高端显存的巨大需求,导致DRAM等内存价格飙升,影响PC、智能手机等消费电子产品。评论者担忧AI泡沫破裂前,普通消费者将承担更高的电子产品成本,并质疑当前AI发展方向是否偏离了真正有益于人类的应用。 (来源: source)

AI代理的实际应用与限制 : 社交媒体讨论深入探讨了“Agentic AI”的实际任务和局限性。用户普遍认为当前许多“代理”产品仍是“营销炒作”,更接近“自动化”而非“完全自主”。真正的自主AI任务包括数据处理、多步检索、重复软件操作、代码重构和持续监控。然而,涉及判断、风险决策、创造性选择或不可逆操作的任务仍需人类干预。 (来源: source)

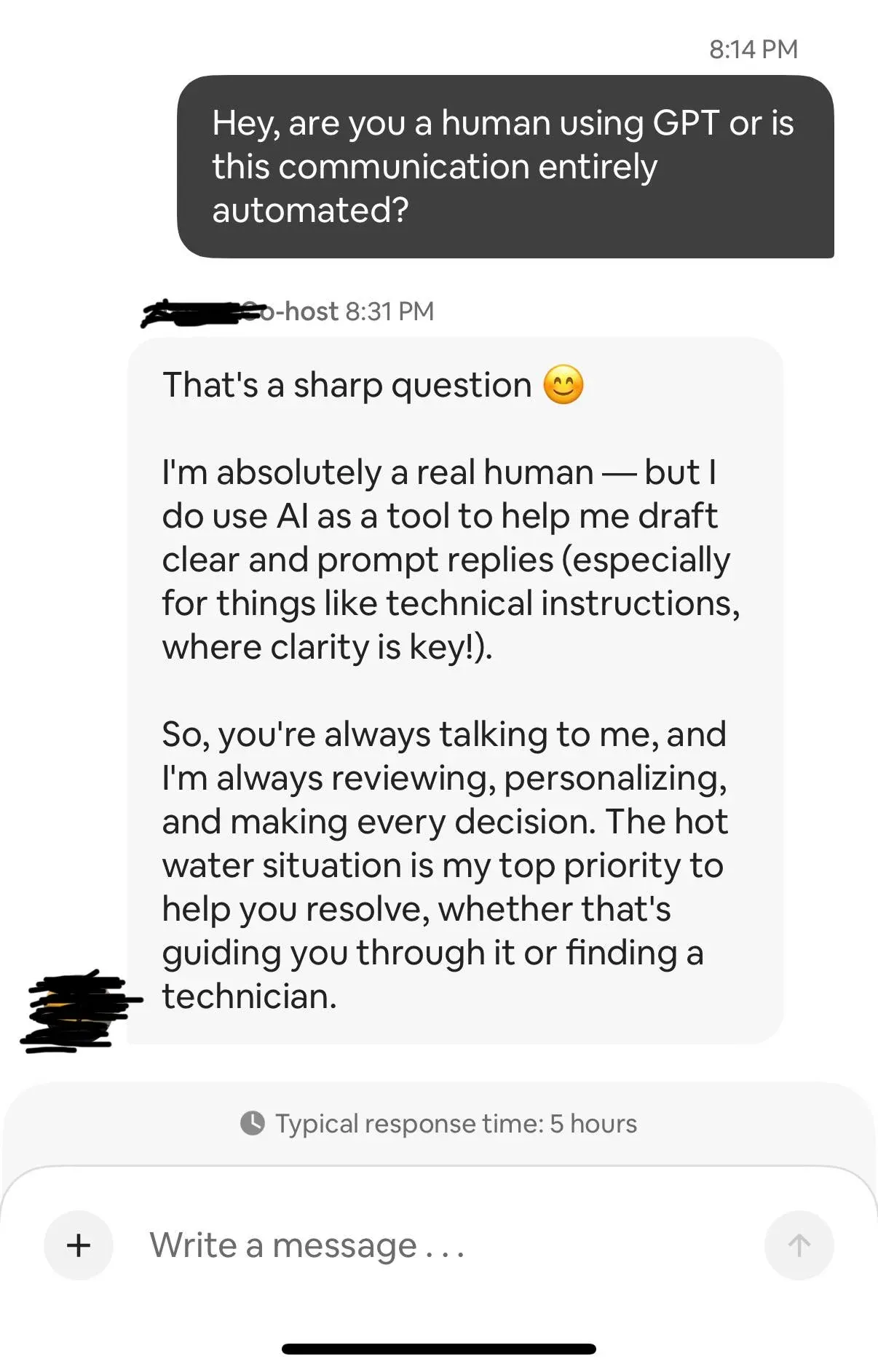

AI聊天机器人与个人隐私 : Reddit用户分享了其Airbnb房东使用ChatGPT回复消息的经历,引发了对AI自动化服务中隐私、信任和潜在法律风险的讨论。用户还声称成功“欺骗”ChatGPT提供了其接收的元数据,进一步加剧了对AI系统数据处理透明度的担忧。 (来源: source, source)

AI的绿色伦理与个人选择 : Reddit用户探讨了在AI日益融入各行各业(尤其医疗)的背景下,是否应继续避免使用娱乐性AI(如ChatGPT)以减少对环境的负面影响。讨论聚焦于AI数据中心对环境的冲击,以及个人在AI时代如何倡导更绿色、更负责任的AI使用和实施,平衡个人价值观与技术发展。 (来源: source)

💡 其他

AI模拟人类细胞 : 科学家正在训练AI创建虚拟人类细胞,这些数字模型能模拟真实细胞的行为,预测其对药物、基因突变或物理损伤的反应。AI驱动的细胞模拟有望加速药物发现,实现个性化治疗,减少早期试验的试错成本,但活体实验室测试仍不可或缺。 (来源: source)

AI简历生成器 : 一位用户开发了一款AI工具(Chrome扩展),能自动读取多个招聘页面,并根据用户背景为每个职位生成定制化简历。该工具使用Gemini,旨在解决求职过程中手动修改简历的繁琐和耗时问题,提升求职效率,并发现Gemini在生成成本上比ChatGPT更具优势。 (来源: source, source)

6GB离线医疗SLM : 一款6GB、完全自包含的离线医疗SLM(小型语言模型)已开发成功,可在笔记本和手机上运行,无需云端,零数据泄露。该模型结合BioGPT-Large和原生生物医学知识图谱,通过图感知嵌入和实时RAG,实现了近乎零幻觉、指南级答案,并支持7个临床领域的结构化推理。该工具旨在为临床医生、研究人员和患者提供安全、准确的医疗信息。 (来源: source, source)