关键词:AI行业, 炒作修正, GPT-5, AGI, AI安全, AI编程, AI代理, 多模态模型, AI材料科学, LLM推理优化, 具身AI, AI基准测试, AI驱动的PPT生成

🔥 聚焦

AI行业“炒作修正”与现实审视 : 2025年AI行业进入“炒作修正”阶段,市场对AI的期望正从“包治百病”回归理性。Sam Altman等行业领袖承认存在AI泡沫,尤其是在初创公司估值和数据中心建设上的巨额投入。同时,GPT-5的发布被认为未达预期,引发了对LLM发展瓶颈的讨论。专家们呼吁重新审视AI的真实能力,区分生成式AI的“华丽演示”与预测式AI在医疗、科学等领域的实际突破,强调AI的价值在于其可靠性和可持续性,而非盲目追逐AGI。 (来源: MIT Technology Review, MIT Technology Review, MIT Technology Review, MIT Technology Review, MIT Technology Review)

AI在材料科学领域的突破与挑战 : AI正被应用于加速新材料发现,通过AI代理规划、运行和解释实验,有望将发现过程从数十年缩短至几年。Lila Sciences和Periodic Labs等公司正在构建AI驱动的自动化实验室,以解决传统材料科学中合成和测试的瓶颈。尽管DeepMind曾宣称发现“数百万种新材料”,但其实际新颖性和实用性受到质疑,凸显了虚拟模拟与物理现实之间的差距。行业正从纯计算模型转向结合实验验证,目标是发现室温超导体等突破性材料。 (来源: MIT Technology Review)

AI编程的生产力争议与技术债务 : AI编程工具普及,微软和谷歌CEO声称AI已生成公司代码的四分之一,Anthropic CEO预测未来90%代码由AI编写。然而,实际生产力提升存在争议,有研究指出AI可能导致开发速度变慢,并增加“技术债务”(如代码质量下降、难以维护)。尽管如此,AI在编写样板代码、测试和修复bug方面表现出色,新一代代理工具如Claude Code通过规划模式和上下文管理,显著提升了复杂任务处理能力。行业正探索“可丢弃代码”和形式化验证等新范式,以适应AI驱动的开发模式。 (来源: MIT Technology Review)

AI安全倡导者对AGI风险的坚持与担忧 : 尽管近期AI发展被认为进入“炒作修正”期,GPT-5表现平淡,但AI安全倡导者(“AI末日论者”)对AGI(通用人工智能)的潜在风险仍深感忧虑。他们认为,AI进步速度虽可能放缓,但其根本危险性并未改变,且对政策制定者未能充分重视AI风险感到失望。他们强调,即使AGI在未来数十年而非几年内实现,也需立即投入资源解决控制问题,并警惕行业对AI泡沫的过度投资可能带来的长期负面影响。 (来源: MIT Technology Review)

🎯 动向

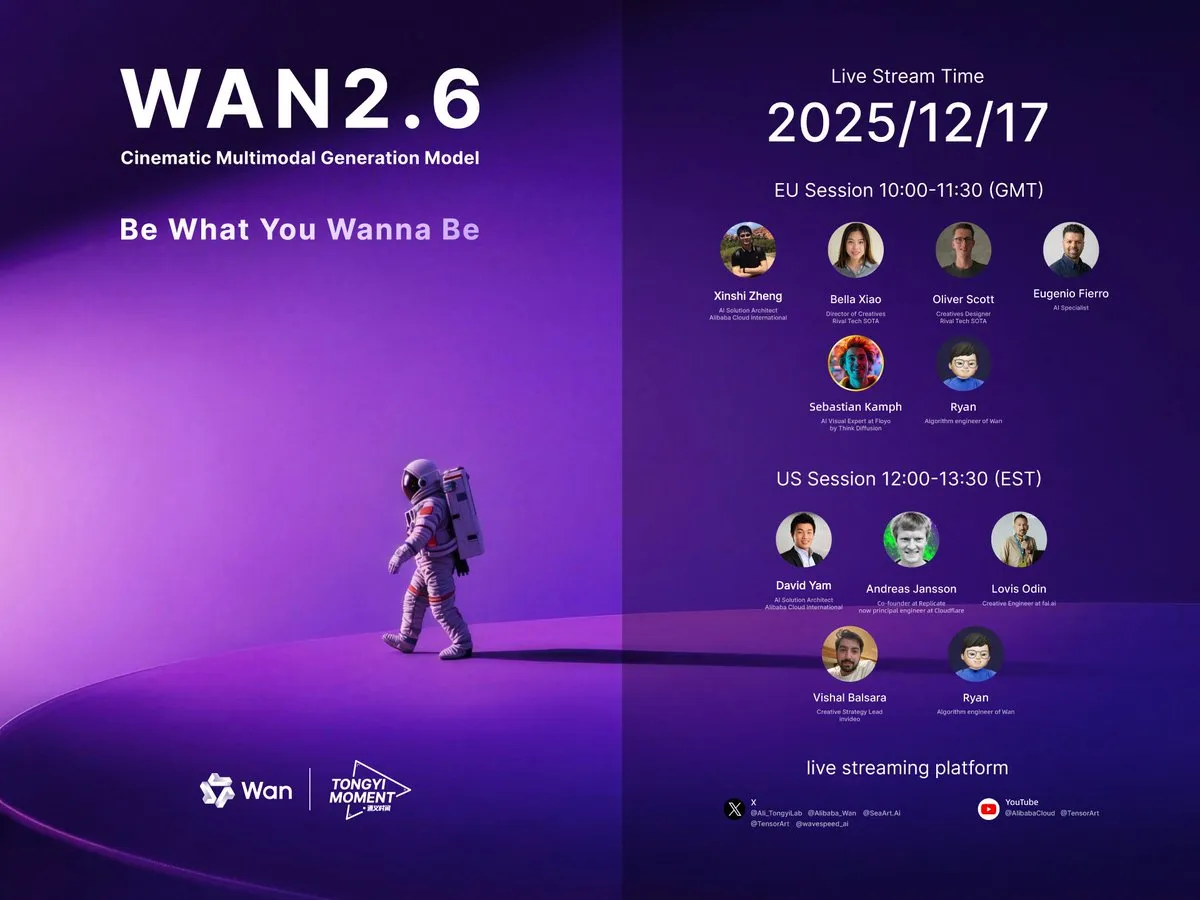

多模态视频生成模型持续突破 : 阿里巴巴发布Wan 2.6视频模型,支持角色扮演、音画同步、多镜头生成及声音驱动,单次视频时长达15秒,被视为“小的Sora 2”。字节跳动也推出Seedance 1.5 Pro,亮点在于支持方言。HuggingFace Daily Papers中的LongVie 2则提出多模态可控超长视频世界模型,强调可控性、长期视觉质量和时间一致性。这些进展标志着视频生成技术在真实感、交互性和应用场景上的显著提升。 (来源: Alibaba_Wan, op7418, op7418, HuggingFace Daily Papers)

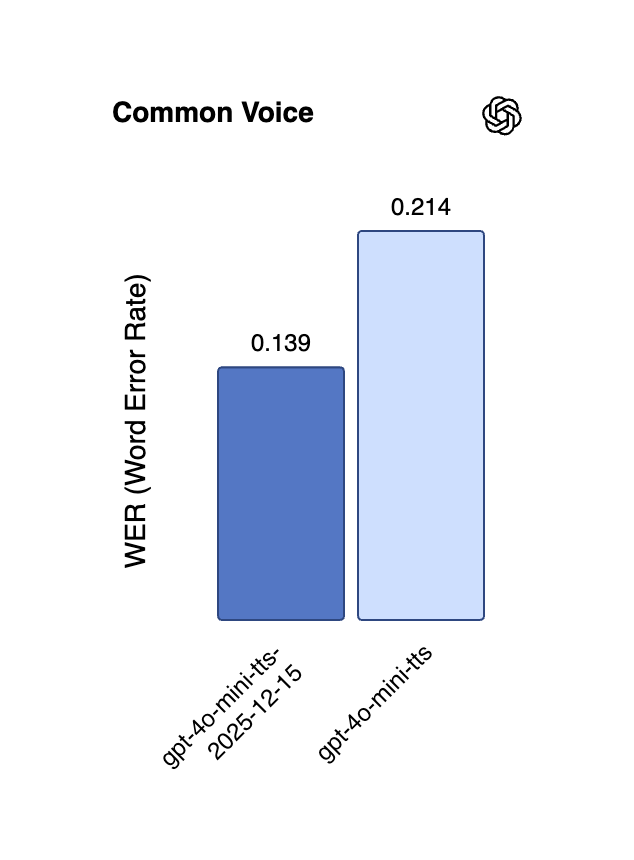

AI语音技术实现多语言与实时流式新进展 : 阿里巴巴开源CosyVoice 3 TTS模型,支持9种语言和18+中文方言,提供多语言/跨语言零样本语音克隆,并实现150毫秒超低延迟的双向流式传输。OpenAI的实时API也更新了gpt-4o-mini-transcribe和gpt-4o-mini-tts模型,显著减少幻觉和错误率,提升多语言性能。Google DeepMind的Gemini 2.5 Flash Native Audio模型也得到更新,进一步优化了指令遵循和对话自然度,推动了实时语音代理的应用。 (来源: ImazAngel, Reddit r/LocalLLaMA, snsf, GoogleDeepMind)

大模型长上下文推理与效率优化 : QwenLong-L1.5通过系统性后训练创新,在长上下文推理能力上媲美GPT-5和Gemini-2.5-Pro,并在超长任务上表现出色。GPT-5.2在长上下文能力方面也获得用户好评,尤其在播客总结方面细节更丰富。此外,ReFusion提出一种新的掩码扩散模型,通过槽级并行解码实现显著的性能和效率提升,平均加速18倍,并缩小与自回归模型的性能差距。 (来源: gdb, HuggingFace Daily Papers, HuggingFace Daily Papers, teortaxesTex)

具身AI与机器人技术进展 : AgiBot发布Lingxi X2人形机器人,具备接近人类的移动能力和多功能技能。HuggingFace Daily Papers中多项研究聚焦具身AI,如Toward Ambulatory Vision探索视觉接地主动视角选择,Spatial-Aware VLA Pretraining通过人类视频实现视觉-物理对齐,以及VLSA引入即插即用安全约束层提升VLA模型的安全性。这些研究旨在缩小2D视觉与3D物理环境行动之间的差距,推动机器人学习和实际部署。 (来源: Ronald_vanLoon, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

NVIDIA与Meta在AI架构和模型开源上的贡献 : NVIDIA发布Nemotron v3 Nano开放模型家族,并开源了完整的训练堆栈(包括RL基础设施、环境、预训练和后训练数据集),旨在推动各行业专业代理AI的构建。Meta则推出VL-JEPA视觉-语言联合嵌入预测架构,作为首个非生成式模型,能在实时流媒体应用中高效执行通用视觉-语言任务,性能超越大型VLM。 (来源: ylecun, QuixiAI, halvarflake)

AI基准测试与评估方法创新 : Google Research推出FACTS Leaderboard,全面评估LLM在多模态、参数知识、搜索和接地等四个维度的事实性,揭示了不同模型在覆盖率和矛盾率上的权衡。V-REX基准测试通过“问题链”评估VLM的探索性视觉推理能力,而START则专注于图表理解的文本和空间学习。这些新基准旨在更准确地衡量AI模型在复杂、真实世界任务中的表现。 (来源: omarsar0, HuggingFace Daily Papers, HuggingFace Daily Papers)

AI代理在网络环境中的自主性提升 : WebOperator提出一种行动感知树搜索框架,使LLM代理在部分可观察的网络环境中进行可靠回溯和战略探索。该方法通过多推理上下文生成行动候选,并过滤无效行动,显著提升了WebArena任务的成功率,突出了战略预见性与安全执行相结合的关键优势。 (来源: HuggingFace Daily Papers)

AI辅助自动驾驶与4D世界模型 : DrivePI是一个空间感知4D MLLM,统一了自动驾驶的理解、感知、预测和规划。它通过整合点云、多视角图像和语言指令,并生成文本-占用率和文本-流QA对,实现了对3D占用率和占用流的精确预测,在nuScenes等基准上超越了现有VLA和专业VA模型。GenieDrive则专注于物理感知驾驶世界模型,通过4D占用引导视频生成,提高了预测准确性和视频质量。 (来源: HuggingFace Daily Papers, HuggingFace Daily Papers)

🧰 工具

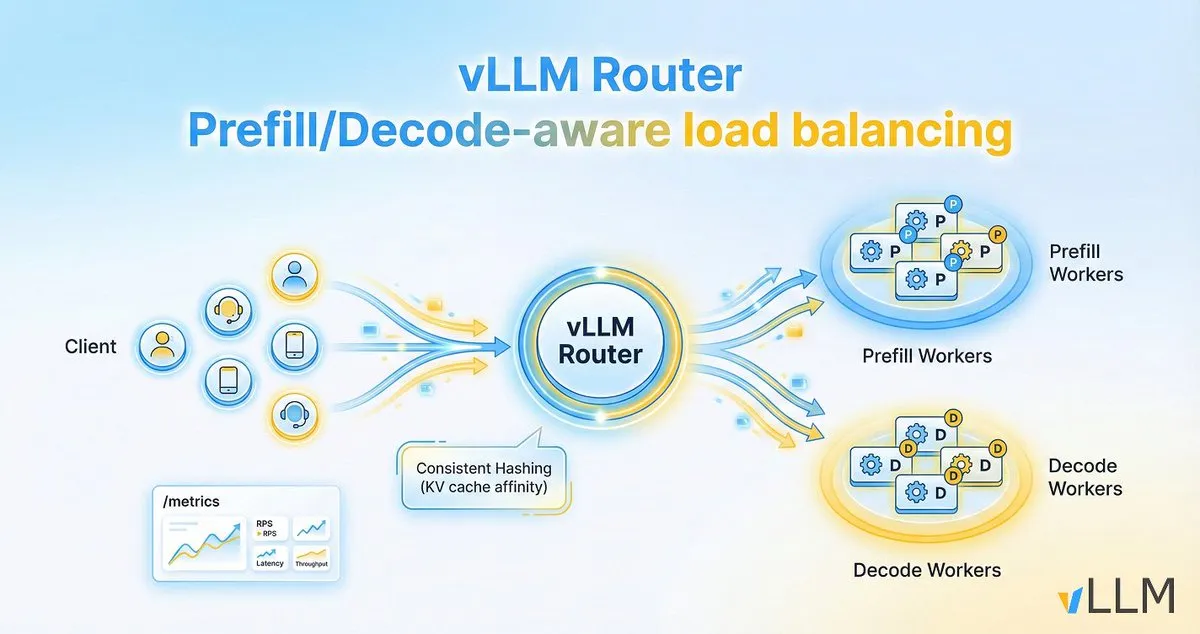

vLLM Router提升LLM推理效率 : vLLM项目发布vLLM Router,这是一个专为vLLM集群设计的轻量级、高性能、预填充/解码感知负载均衡器。它采用Rust编写,支持一致性哈希、双幂次选择等策略,旨在优化KV缓存局部性,解决对话流量和预填充/解码分离的瓶颈,从而提升LLM推理的吞吐量和降低尾部延迟。 (来源: vllm_project)

AI21 Maestro简化AI代理构建 : AI21Labs的Vibe Agent在AI21 Maestro中推出,允许用户通过简单的英语描述创建AI代理。该工具能自动建议代理的用途、验证检查、所需工具以及模型/计算设置,并实时解释每一步,大大降低了构建复杂AI代理的门槛。 (来源: AI21Labs)

OpenHands SDK加速代理驱动软件开发 : OpenHands发布了软件代理SDK,旨在提供一个快速、灵活且生产就绪的框架,用于构建代理驱动的软件。该SDK的推出将有助于开发者更高效地集成和管理AI代理,以应对复杂的软件开发任务。 (来源: gneubig)

Claude Code CLI更新增强开发体验 : Anthropic发布Claude Code 2.0.70版本,包含13项CLI改进。主要更新包括:支持Enter键接受提示建议、MCP工具权限的通配符语法、插件市场自动更新开关、强制计划模式等。此外,内存使用效率提升3倍,截图分辨率更高,旨在优化开发者在使用Claude Code进行软件开发时的交互和效率。 (来源: Reddit r/ClaudeAI)

Qwen3-Coder实现2D游戏快速开发 : Reddit用户展示了如何使用阿里巴巴的Qwen3-Coder(480B)模型,通过Cursor IDE在几秒内构建一个2D马里奥风格游戏。该模型从单一提示词出发,自动规划步骤、安装依赖、生成代码和项目结构,并能直接运行。其运行成本低廉(每百万token约2美元),且体验接近GPT-4代理模式,展示了开源模型在代码生成和代理任务上的强大潜力。 (来源: Reddit r/artificial)

AI驱动的股票深度研究工具 : Deep Research工具利用AI从SEC文件和行业出版物中提取数据,生成标准化报告,简化公司比较和筛选。用户可输入股票代码获取深度分析,该工具旨在帮助投资者更高效地进行基本面研究,避免市场新闻干扰,专注于实质性财务信息。 (来源: Reddit r/ChatGPT)

LangChain 1.2简化Agentic RAG应用构建 : LangChain发布1.2版本,简化了对内置工具和严格模式的支持,特别是在create_agent功能中。这使得开发者能够更方便地构建Agentic RAG(检索增强生成)应用,无论是本地运行还是在Google Collab上,并强调其100%开源特性。 (来源: LangChainAI, hwchase17)

Skywork推出AI驱动的PPT生成功能 : Skywork平台上线基于Nano Banana Pro的PPT生成能力,解决了传统AI生成PPT难以编辑的问题。新功能支持图层分离,允许用户在线修改文字和图片,并可导出为pptx格式进行本地编辑。此外,该工具还整合了行业专业数据库,支持多种图表生成,确保数据准确性,并提供圣诞促销优惠。 (来源: op7418)

小型模型赋能边缘侧基础设施即代码 : Reddit用户分享了一款500MB的“基础设施即代码”(IaC)模型,可在边缘设备或浏览器上运行。该模型专注于IaC任务,体积小巧但功能强大,为在资源受限环境中部署和管理基础设施提供了高效解决方案,预示着小型AI模型在特定垂直领域应用的巨大潜力。 (来源: Reddit r/deeplearning)

📚 学习

中ArXiv:中文预印本的自动化翻译平台 : Chinarxiv.org正式上线,这是一个全自动化的中文预印本翻译平台,旨在弥合中西方科学研究之间的语言鸿沟。该平台不仅翻译文本,还包括图表内容,使得西方研究者能够更便捷地获取和了解中国科学界的最新研究成果。 (来源: menhguin, andersonbcdefg, francoisfleuret)

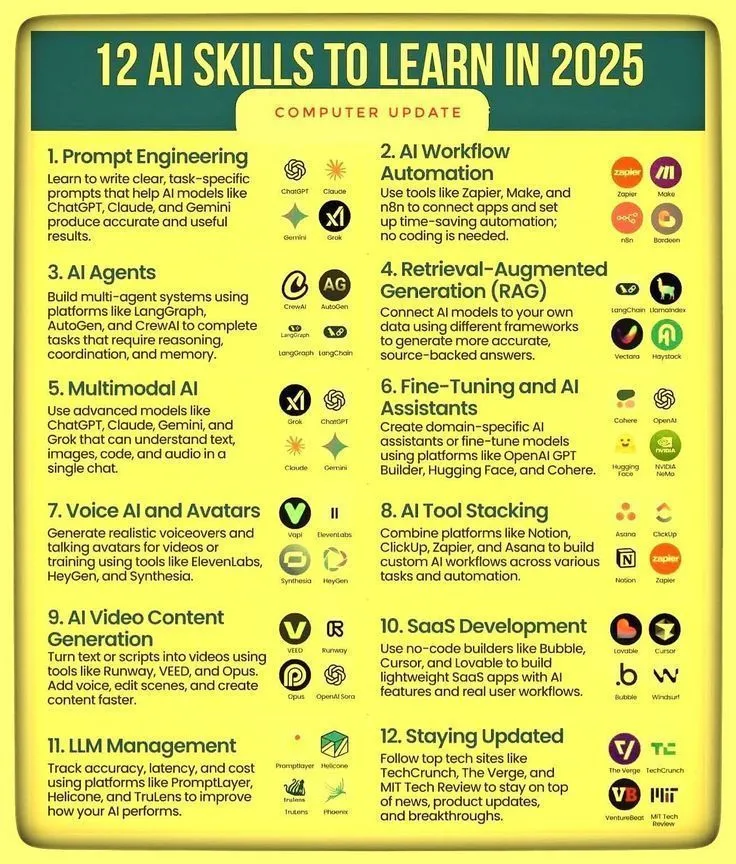

AI技能与Agentic AI学习路线图 : Ronald_vanLoon分享了2025年掌握AI技能的12项关键能力,以及Agentic AI的精通路线图。这些资源旨在指导个人在快速发展的AI领域中提升竞争力,涵盖了从基础AI知识到高级代理系统开发的学习路径,强调了在AI时代持续学习和适应新技能的重要性。 (来源: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

LLM推理过程优化与数据驱动的AI发展 : Meta Superintelligence Labs的研究表明,通过“并行草稿→蒸馏到紧凑工作空间→精炼”的PDR(Parallel Draft-Distill-Refine)策略,可以在推理约束下实现最佳任务准确性。同时,一篇博客文章强调“数据是AI的锯齿状前沿”,指出编码和数学领域因数据丰富和可验证性而成功,科学领域则相对滞后,并探讨了蒸馏和强化学习在数据生成中的作用。 (来源: dair_ai, lvwerra)

视觉-语言协同推理提升抽象能力 : 新研究提出视觉-语言协同推理(VLSR)框架,通过在不同推理阶段策略性结合视觉和文本模态,显著提升LLM在抽象推理任务(如ARC-AGI基准)上的表现。该方法利用视觉进行全局模式识别,文本进行精确执行,并通过模态切换自校正机制克服确认偏误,在小模型上甚至超越了GPT-4o的性能。 (来源: dair_ai)

LLM推理令牌作为计算状态的新视角 : State over Tokens (SoT) 概念框架将LLM的推理令牌重新定义为外部化的计算状态,而非简单的语言叙述。这解释了令牌如何在不作为忠实文本解释的情况下驱动正确推理,并为理解LLM的内部过程开辟了新的研究方向,强调研究应超越文本解读,专注于将推理令牌解码为状态。 (来源: HuggingFace Daily Papers)

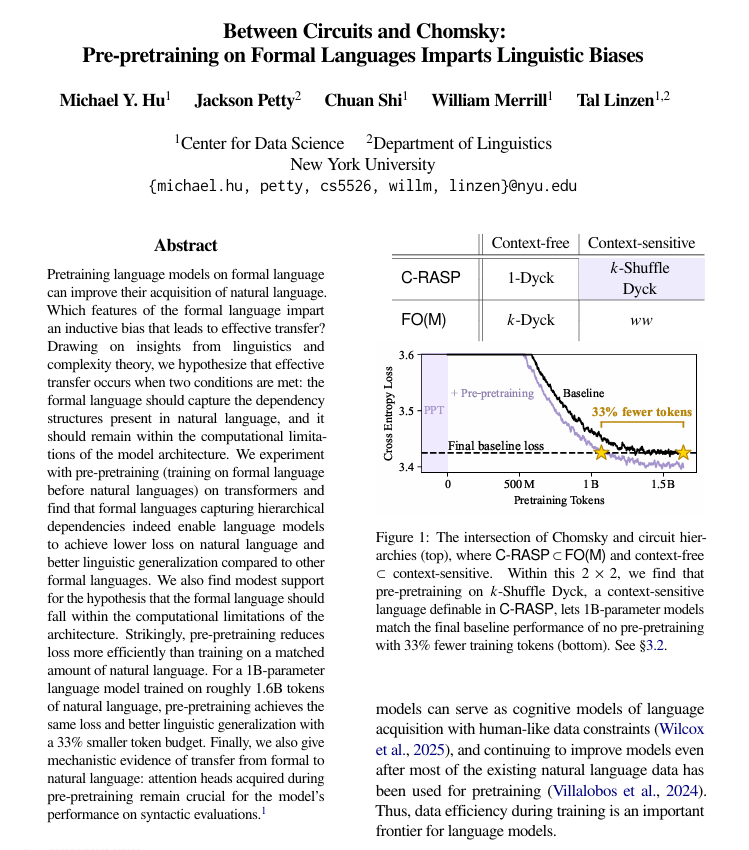

形式语言预训练提升自然语言学习 : 纽约大学的研究发现,在自然语言预训练之前,使用形式化、基于规则的语言进行预训练可以显著帮助语言模型更好地学习人类语言。研究指出,这种形式语言需要与自然语言有相似的结构(尤其是层次关系),并且足够简单。这种方法比增加相同数量的自然语言数据更有效,且学习到的结构机制在模型内部进行迁移。 (来源: TheTuringPost)

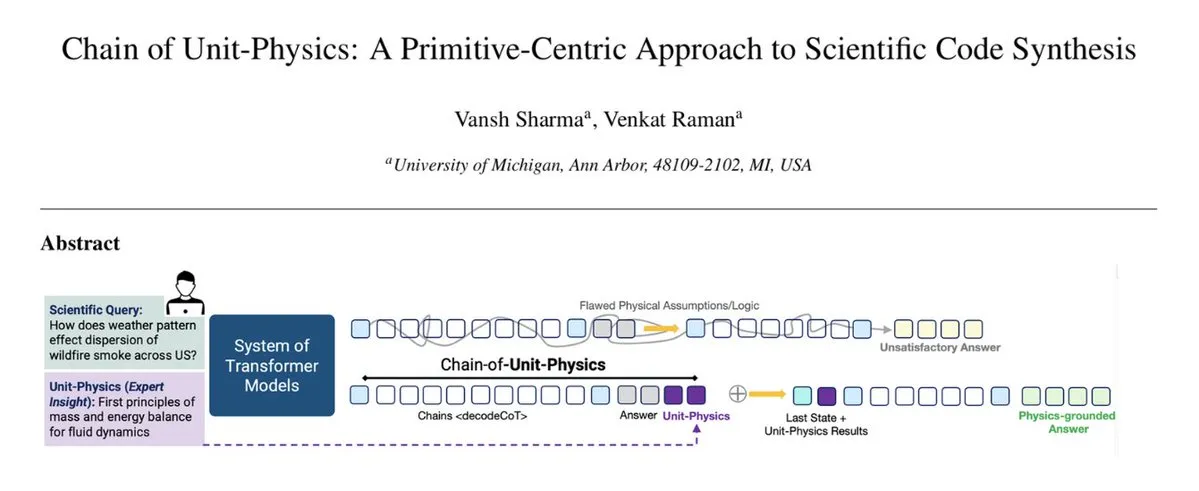

物理知识注入代码生成流程 : Chain of Unit-Physics框架将物理知识直接融入代码生成过程。密歇根大学研究人员提出一种逆向科学代码生成方法,通过将人类专家知识编码为单元物理测试来指导和约束代码生成。在一个多代理设置中,该框架能使系统在5-6次迭代中达到正确解决方案,运行速度提高33%,内存使用减少30%,错误率极低。 (来源: TheTuringPost)

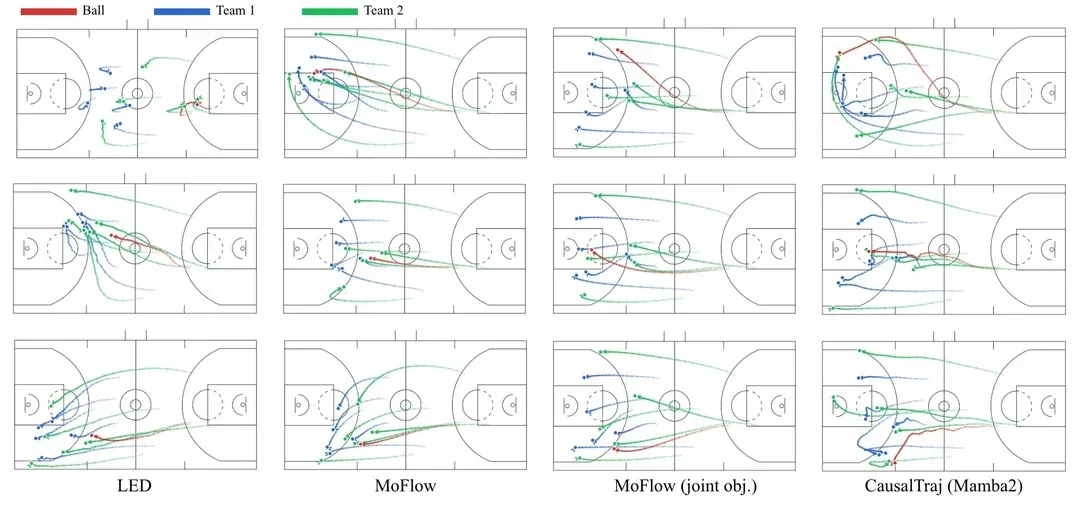

运动队多代理轨迹预测模型CausalTraj : CausalTraj是一个自回归模型,用于团队运动中多代理联合轨迹预测。该模型直接以联合预测似然目标进行训练,而非仅仅优化个体代理指标,从而在保证个体性能的同时,显著提升了多代理轨迹的连贯性和合理性。研究还探讨了如何更有效地评估联合建模,以及如何评估采样轨迹的真实可能性。 (来源: Reddit r/deeplearning)

LLM训练数据:答案还是问题? : Reddit上的一项讨论提出,当前大多数LLM训练数据集侧重于“答案”,而人类智能的关键部分存在于“问题”形成前的混乱、模糊和迭代过程中。实验表明,用包含早期思考、模糊问题和反复修正的对话数据训练的模型,在澄清用户意图、处理不明确任务和避免错误结论方面表现更好,暗示了训练数据需要更全面地捕捉人类思维的复杂性。 (来源: Reddit r/MachineLearning)

💼 商业

OpenAI收购neptune.ai,强化前沿研究工具 : OpenAI宣布达成最终协议,收购neptune.ai,此举旨在加强其支持前沿研究的工具和基础设施。此次收购将有助于OpenAI提升其在AI开发和实验管理方面的能力,进一步加速模型训练和迭代过程,巩固其在AI领域的领先地位。 (来源: dl_weekly)

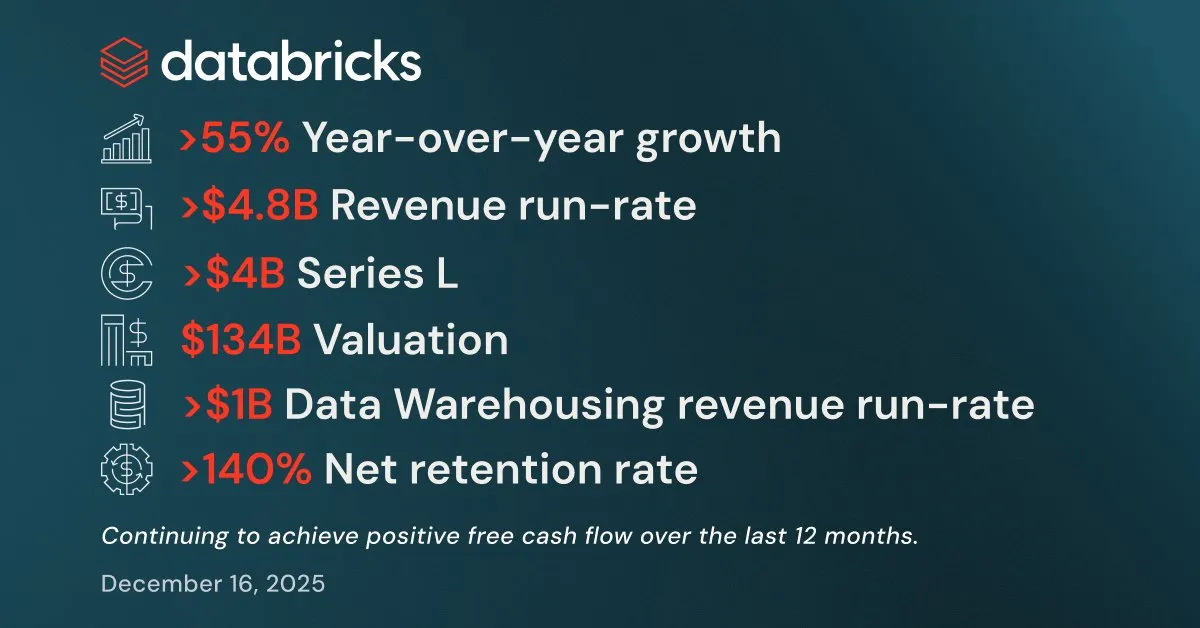

Databricks Q3业绩强劲,获超40亿美元融资 : Databricks公布了强劲的第三季度业绩,年收入运行率超过48亿美元,同比增长超过55%。其数据仓库和AI产品业务的年收入运行率均突破10亿美元。公司还完成了超过40亿美元的L轮融资,估值达1340亿美元,计划将资金用于投资Lakebase Postgres、Agent Bricks和Databricks Apps,以加速数据智能应用的开发。 (来源: jefrankle, jefrankle)

Infosys与Formula E合作推动AI驱动的数字化转型 : Infosys与ABB FIA Formula E世界锦标赛合作,通过AI驱动的平台革新赛车运动的粉丝体验和运营效率。合作包括利用AI提供个性化内容、实时赛况分析、AI生成解说,并优化物流和旅行以实现碳减排目标。AI技术不仅提升了赛事吸引力,也促进了可持续发展和员工多样性,将Formula E打造为最数字化、最可持续的赛车运动。 (来源: MIT Technology Review)

🌟 社区

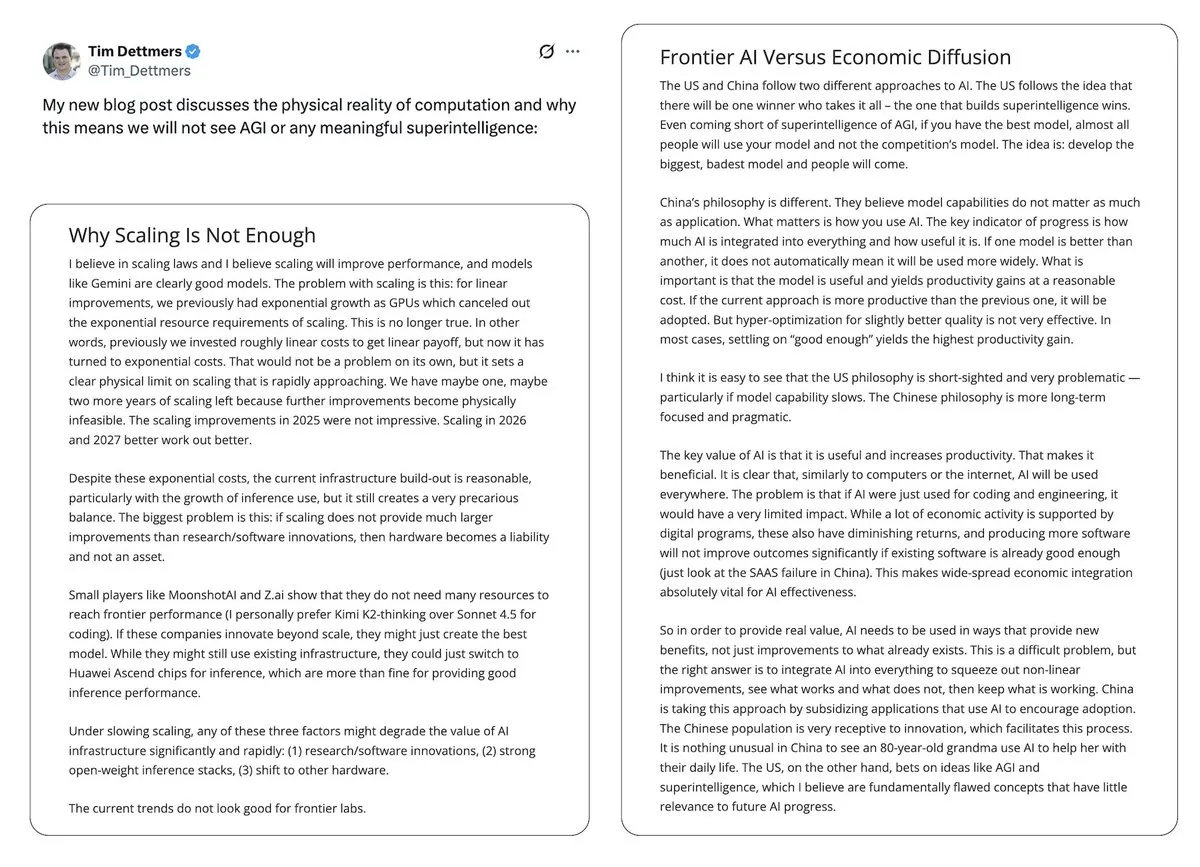

AI泡沫与AGI前景的争议 : Yann LeCun公开表示LLM和AGI是“完全的废话”,认为AI的未来在于世界模型而非当前LLM范式,并担忧AI技术被少数公司垄断。Tim Dettmers的文章“Why AGI Will Not Happen”也因其对扩展回报递减的讨论而受到关注。与此同时,AI安全倡导者虽然对AGI的到来时间有所调整,但仍坚持其潜在危险性,并对政策制定者未能充分重视AI风险表示担忧。 (来源: ylecun, ylecun, hardmaru, MIT Technology Review)

用户对GPT-5.2与Gemini的评价两极分化 : 社交媒体上,用户对OpenAI GPT-5.2的评价褒贬不一。有用户对其长上下文处理能力表示满意,认为其总结播客内容更丰富;但也有用户表达强烈不满,认为GPT-5.2的回答过于通用、深度不足,甚至出现“自我意识”的回应,导致部分用户转向Gemini。这种分化反映了用户对新模型性能和行为的敏感度,以及对AI产品体验的持续关注。 (来源: gdb, Reddit r/ArtificialInteligence)

AI对人类认知、工作标准及伦理行为的影响 : 长期使用AI正悄然改变人类认知模式和工作标准,促使思维更结构化,并提升对产出质量的期望。AI使高质量内容生产变得高效,但也可能导致对技术的过度依赖。在AI的伦理层面,模型在“电车难题”中的不同表现(Grok的实用主义与Gemini/ChatGPT的利他主义)引发了对AI价值观设定的讨论。同时,AI模型安全提示语的“自我规训”本质,也揭示了AI内部控制机制对用户体验的间接影响。 (来源: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, Reddit r/ChatGPT)

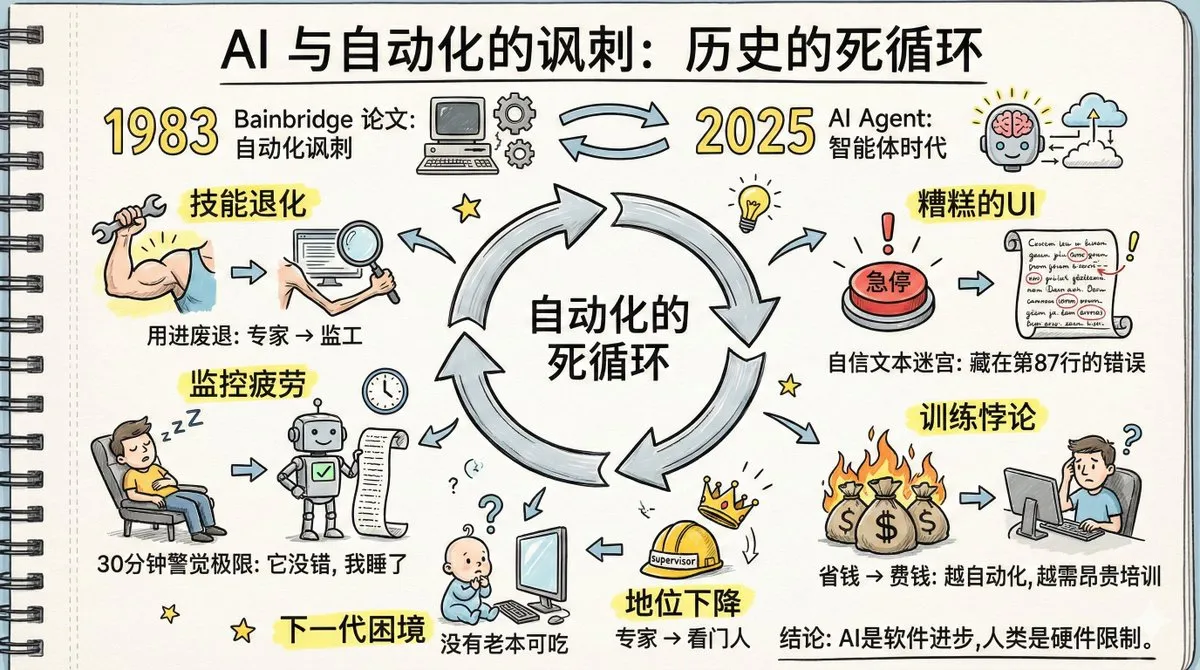

AI代理的“自动化讽刺”与人类技能退化 : 一篇名为《自动化的讽刺》的论文引发热议,其四十年前对工厂自动化的预言正应验在AI Agent身上。讨论指出,AI Agent的普及可能导致人类技能退化、记忆提取变慢、监控疲劳以及专家地位下降。文章强调,人类无法长时间对“很少出错”的系统保持警觉,且当前AI Agent界面设计不利于异常检测。解决这些问题需要比自动化本身更大的技术创造力,以及对新分工、新训练和新角色设计的认知转变。 (来源: dotey, dotey, dotey)

AI生成低质量内容与事实性挑战 : 社交媒体用户发现大量低质量网站专门为满足AI搜索结果而创建,质疑AI研究依赖这些缺乏作者和详细信息的网站,可能导致信息不可信。这引发了对AI“回填来源”机制的担忧,即AI先生成答案再寻找支持来源,可能导致引用虚假信息。这凸显了AI在信息真实性方面的挑战,以及用户需要回归自主研究的必要性。 (来源: Reddit r/ArtificialInteligence)

AI对法律职业的影响与抽象层级论 : 法律界对AI是否会“摧毁”律师职业存在争议。有律师认为AI能处理90%以上法律工作,但策略、谈判和责任仍需人类。同时,也有观点将AI视为继汇编、C语言、Python之后的下一个抽象层级,认为它将解放工程师专注于系统设计和用户体验,而非取代人类。 (来源: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

AI代理的物理学行为与LLM/机器人融合争议 : 新研究表明LLM驱动的AI代理可能遵循宏观物理定律,表现出类似热力学系统的“详细平衡”特性,暗示它们可能隐式学习了评估状态的“势函数”。与此同时,有观点认为机器人智能与LLM正走向分化而非统一,而另一些人则认为物理AI正变得真实,特别是在调试和可视化方面的进步加速了机器人和具身AI项目。 (来源: omarsar0, Teknium, wandb)

Anthropic高管在Discord社区强制部署AI聊天机器人引发争议 : Anthropic的一名高管在面向LGBTQ+群体的Discord社区中,不顾成员反对,强制部署了公司的AI聊天机器人Clawd,导致社区成员大量流失。此事件引发了对AI在社区中隐私、人类互动受影响以及AI公司“创造新神”心态的担忧。用户对AI聊天机器人取代人类交流和高管傲慢行为表示强烈不满。 (来源: Reddit r/artificial)

AI模型易受诗歌攻击,呼唤文学人才加入AI实验室 : 意大利AI研究人员发现,通过将恶意提示转化为诗歌形式,可以愚弄领先的AI模型,其中Gemini 2.5最易受影响。这一现象被称为“Waluigi效应”,即模型在压缩的语义空间中,善恶角色过于接近,导致其更容易反向执行指令。这引发了社区对AI实验室是否需要更多文学毕业生以理解叙事和语言深层机制的讨论,以应对AI潜在的“奇怪叙事空间”行为。 (来源: Reddit r/ArtificialInteligence)

💡 其他

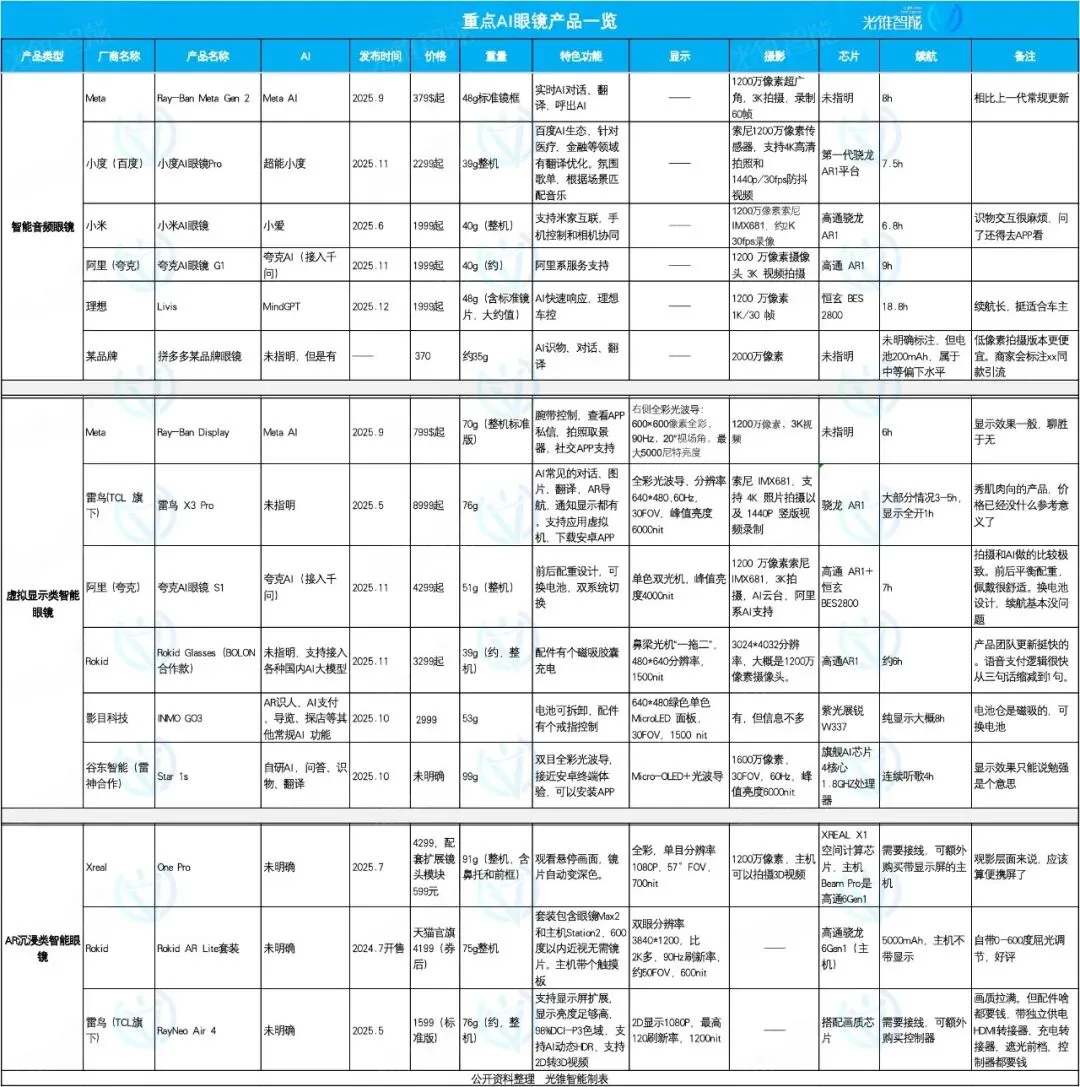

AI眼镜市场聚焦与分化,理想、夸克、Rokid各显神通 : 2025年AI眼镜市场迎来爆发,产品定位呈现分化趋势。理想AI眼镜Livis聚焦汽车智能配件,整合MindGPT大模型服务车主;夸克AI眼镜S1则以拍摄效果和阿里生态APP整合为特色;Rokid Glasses则强调生态开放和快速功能迭代,支持接入多款大语言模型。智能音频眼镜以低价和功能整合为主,虚拟显示类眼镜提供综合体验,而AR沉浸类眼镜则侧重观影娱乐。 (来源: 36氪)

ZLUDA支持CUDA在非NVIDIA GPU上运行,兼容AMD ROCm 7 : ZLUDA项目实现了CUDA在非NVIDIA GPU上的运行,并支持AMD ROCm 7。这一进展对于AI和高性能计算领域意义重大,它打破了NVIDIA在GPU生态系统中的垄断,使得开发者可以在AMD硬件上利用CUDA编写的程序,为AI硬件的选择和优化提供了更多灵活性。 (来源: Reddit r/artificial)

hashcards:基于纯文本的间隔重复学习系统 : hashcards是一个基于纯文本的间隔重复学习系统,所有闪卡以纯文本文件存储,支持标准工具编辑和版本控制。它采用内容寻址方式,卡片内容修改后进度重置。系统设计简洁,仅支持正反面和完形填空卡片,并使用FSRS算法优化复习计划,旨在最大化学习效率并最小化复习时间。 (来源: GitHub Trending)

Zerobyte:面向自托管用户的强大备份自动化工具 : Zerobyte是一款为自托管用户设计的备份自动化工具,提供现代化的Web界面,用于调度、管理和监控远程存储的加密备份。它基于Restic构建,支持加密、压缩和保留策略,并兼容NFS、SMB、WebDAV及本地目录等多种协议。Zerobyte还支持S3、GCS、Azure等多种云存储后端,并通过rclone扩展支持40+云存储服务,确保数据安全和灵活备份。 (来源: GitHub Trending)