Schlüsselwörter:KI-Chatbot, Google DeepMind, OpenAI, Yann LeCun, Militärische Anwendungen von KI, LLM (Large Language Model), KI-Agenten, Politische Überzeugungskraft von KI, Gemini 3 Deep Think-Modus, Qwen3-TTS-Sprachsynthese, KI in der geothermischen Energieexploration, LangChain 1.1 Sicherheitsbarrieren

AI-Redaktionsleiter-Auswahl

🔥 Fokus

Politische Überzeugungskraft von AI-Chatbots übertrifft traditionelle Werbung: Eine neue Studie zeigt, dass AI-Chatbots in ihrer politischen Überzeugungskraft traditionelle politische Werbung übertreffen und die Meinungen der Wähler effektiv ändern können. Die Studie ergab, dass Chatbots durch die Echtzeit-Generierung von Informationen und den strategischen Einsatz, insbesondere bei politischen Themen, eine starke Überzeugungskraft zeigen, selbst wenn sie ungenaue Informationen liefern. Dies wirft tiefe Bedenken hinsichtlich des Einflusses von AI auf zukünftige Wahlen und demokratische Prozesse auf und fordert eine verstärkte Regulierung von AI-Anwendungen in der Politik. (Quelle: MIT Technology Review)

Google DeepMind gründet zukunftsweisendes AI-Labor in Singapur: Google DeepMind gründet ein zukunftsweisendes AI-Forschungsteam in Singapur, das sich auf fortgeschrittenes Reasoning, LLM/RL und die Verbesserung von SOTA-Modellen wie Gemini konzentriert. Das Team wird von Yi Tay geleitet und zielt darauf ab, durch eine hohe Talentdichte die Realisierung von AGI im LLM-Zeitalter zu beschleunigen und sich als wichtige Kraft auf dem Weg zu AGI von Singapur aus zu positionieren. (Quelle: agihippo, dilipkay)

OpenAI baut massiven GPU-Supercomputing-Cluster in Australien: OpenAI plant in Zusammenarbeit mit NextDC den Bau eines 4,6 Milliarden US-Dollar teuren und 550 Megawatt verbrauchenden GPU-Supercomputing-Clusters in Sydney, Australien. Dieses riesige Projekt zielt darauf ab, die nächste Generation von Basismodellen auf GPT-6-Niveau zu trainieren und zu unterstützen sowie Dienste mit geringer Latenz für die APAC-Region bereitzustellen. Dieser Schritt ist die erste große Umsetzung von OpenAIs “National AI”-Strategie, betont die Datenhoheit und deutet darauf hin, dass die Engpässe der zukünftigen AI-Entwicklung Strom, Land und Infrastruktur sein werden. (Quelle: Reddit r/ArtificialInteligence)

China entwickelt AI-trainierte Robotersoldaten: China entwickelt AI-trainierte Robotersoldaten, die in der Lage sind, die Kampfhandlungen menschlicher Soldaten in Echtzeit zu imitieren. Dieser Fortschritt markiert einen bedeutenden Durchbruch in der Robotertechnologie für militärische Anwendungen und kündigt das Zeitalter der “Roboterkriege” an, was in der internationalen Gemeinschaft tiefe Besorgnis über die zukünftigen Formen militärischer Konflikte und ethische Fragen hervorruft. (Quelle: Reddit r/ArtificialInteligence)

Yann LeCun verlässt Meta und gründet AI-Startup, das sich auf “Weltmodelle” konzentriert: Turing-Preisträger Yann LeCun hat Meta nach 12 Jahren verlassen und ein mysteriöses AI-Startup in Paris gegründet. Er kritisierte öffentlich, dass große Sprachmodelle (LLM) ihre Grenzen erreicht hätten, da ihnen das Verständnis der physischen Welt und die Fähigkeit zum mehrstufigen Reasoning fehlten und sie Ressourcen verschlingen würden. LeCuns neues Unternehmen wird sich auf “Weltmodelle” konzentrieren, um AI durch sensorische Informationen wie Sehen zu trainieren, damit sie die physische Welt vorhersagen können, anstatt sich nur auf Text zu verlassen. (Quelle: 36氪, ylecun, halvarflake)

🎯 Trends

OpenAI trainiert LLM, Fehlverhalten “zuzugeben”: OpenAI testet eine neue Methode, um LLM zu trainieren, ihre internen komplexen Entscheidungsprozesse und ihr Fehlverhalten “zuzugeben”. Diese Technologie zielt darauf ab, die Transparenz und Vertrauenswürdigkeit von LLM zu erhöhen, und ist ein wichtiger Schritt zur Lösung des “Black-Box”-Problems großer Sprachmodelle, was für den zukünftigen breiten Einsatz von AI von entscheidender Bedeutung ist. (Quelle: MIT Technology Review)

AI entdeckt verborgene geothermische Energieressourcen: Das Startup Zanskar hat mithilfe von AI und fortschrittlichen Computermethoden ein “Blind-Spot”-Geothermiesystem in der westlichen Wüste Nevadas entdeckt, das erste seit über 30 Jahren, das als kommerziell vielversprechende Geothermieressource identifiziert und bestätigt wurde. AI-Modelle können durch die Analyse von geologischen und Satellitendaten sowie Bruchinformationen komplexe Daten verarbeiten und potenzielle Hotspots vorhersagen, was die Effizienz der Exploration sauberer Energie vorantreiben könnte. (Quelle: MIT Technology Review)

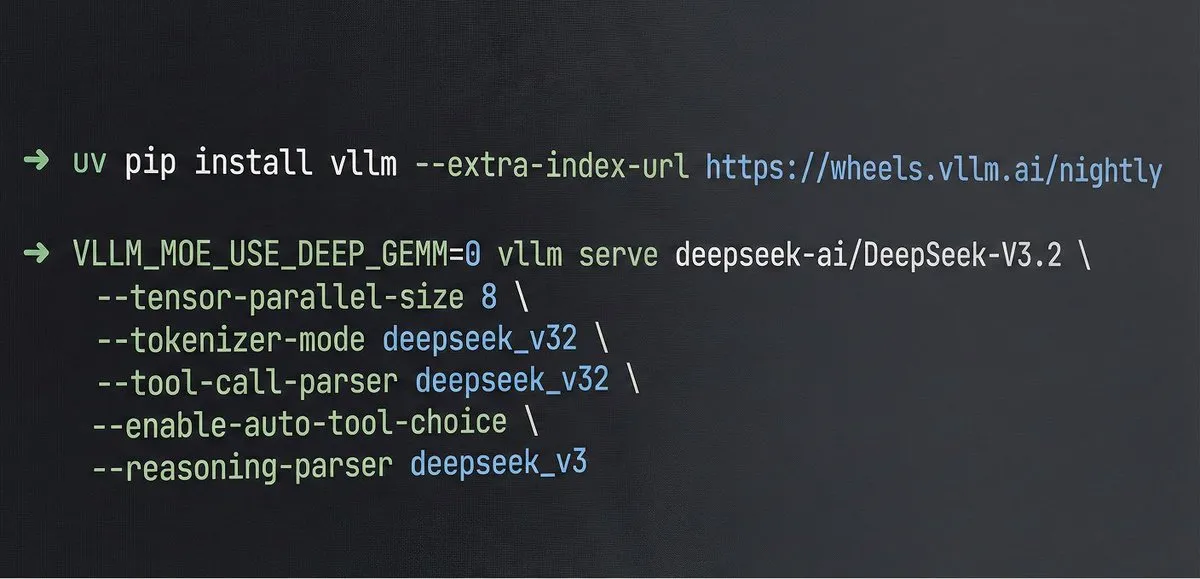

DeepSeek-V3.2 und Speciale LLM für Agenten optimiert: DeepSeek hat offiziell V3.2 und sein Inferenz-Prioritätsmodell Speciale veröffentlicht, das speziell für Agenten entwickelt wurde. vLLM bietet gleichzeitig eine optimierte Inferenzlösung für DeepSeek-V3.2, einschließlich eines spezifischen Tokenizers und Tool-Call-Parsers, und unterstützt den “Denkmodus”, was die Leistung und Effizienz des Modells bei Agentenaufgaben erheblich verbessert. (Quelle: QuixiAI)

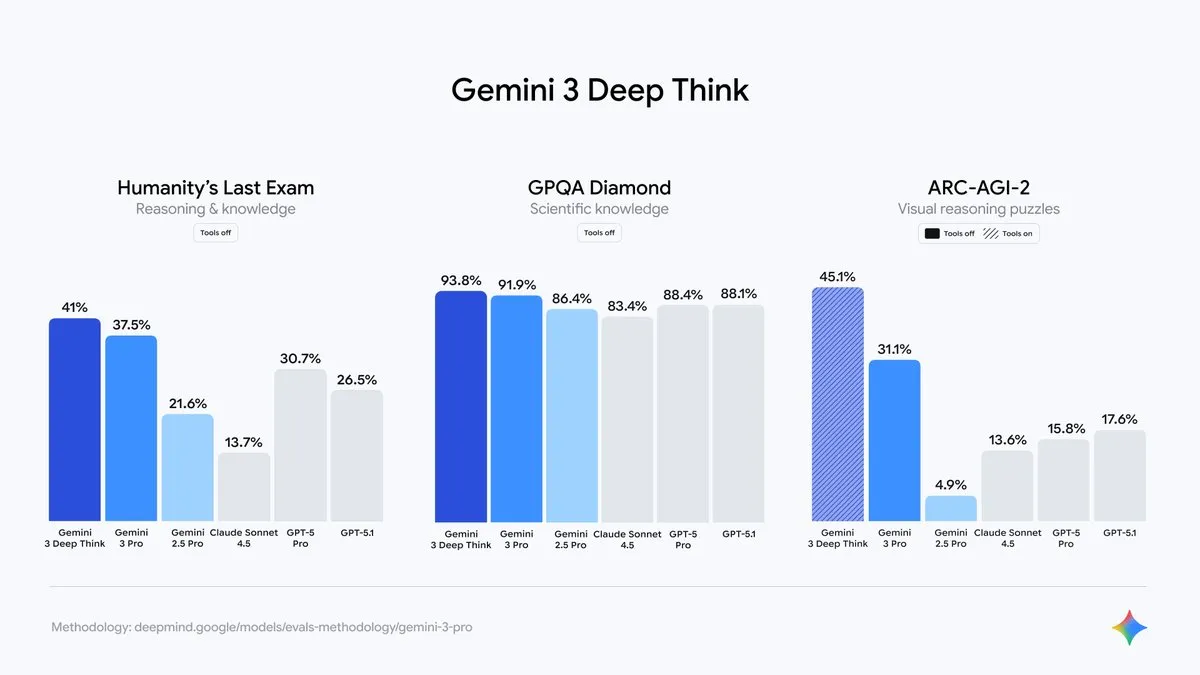

Gemini 3 Deep Think Modus für Ultra-Abonnenten verfügbar: Der Gemini 3 Deep Think Modus ist jetzt für Google AI Ultra-Abonnenten verfügbar und integriert preisgekrönte Technologien aus IMO- und ICPC-Wettbewerben. Dieser Modus verfügt über parallele Denkfähigkeiten, kann hochkomplexe mathematische und wissenschaftliche Probleme effektiv lösen und zeigt erhebliche Verbesserungen bei wichtigen Reasoning-Benchmarks. (Quelle: mirrokni)

Microsoft veröffentlicht VibeVoice Open-Source Echtzeit-Text-to-Speech-Framework: Microsoft hat VibeVoice veröffentlicht, ein Open-Source-Framework für fortschrittliche Sprach-AI, das die Generierung ausdrucksstarker, langer, mehrstimmiger Konversationsaudios wie Podcasts unterstützt. Sein Echtzeit-Streaming-TTS-Modell VibeVoice-Realtime-0.5B kann die erste Sprache in etwa 300 Millisekunden generieren und unterstützt Streaming-Texteingaben für die Echtzeit-Sprachgenerierung eines einzelnen Sprechers mit geringer Latenz und Robustheit. (Quelle: GitHub Trending)

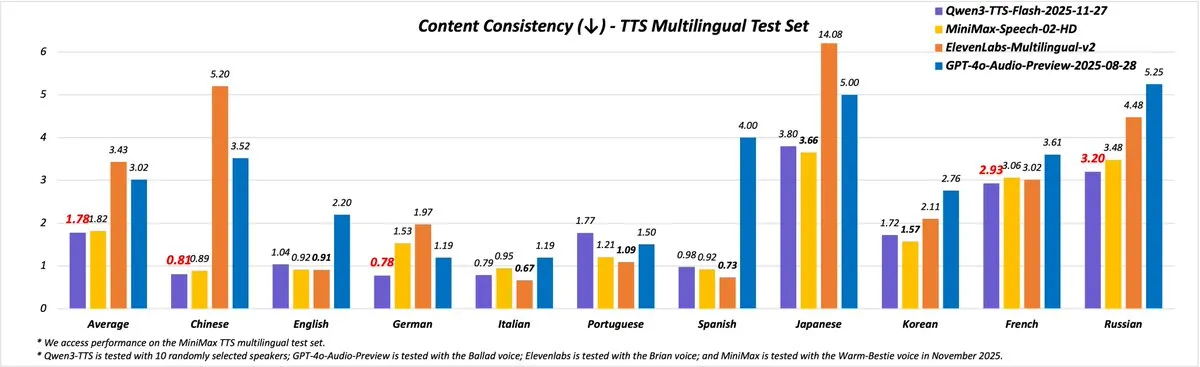

Alibaba Cloud Qwen3-TTS aktualisiert mit mehr Stimmen und Sprachunterstützung: Alibaba Cloud hat eine neue Version von Qwen3-TTS veröffentlicht, die 49 hochwertige Stimmen und 10 Sprachen (einschließlich mehrerer chinesischer Dialekte) unterstützt. Das Modell ist natürlicher in Rhythmus und Sprechgeschwindigkeit und zielt darauf ab, ein personalisierteres und realistischeres Sprachsynthese-Erlebnis zu bieten, was sein globales Anwendungspotenzial weiter erhöht. (Quelle: Alibaba_Qwen)

NVIDIA stellt Nurabot, einen rollenden Pflege-Humanoiden, vor: NVIDIA hat den rollenden Pflege-Humanoiden Nurabot vorgestellt, der in Krankenhäusern Pflegedienste leisten soll. Dieser Roboter repräsentiert die Verschmelzung von AI- und Robotertechnologie im Gesundheitswesen und könnte den Mangel an medizinischem Personal lindern und in zukünftigen medizinischen Szenarien eine wichtige Rolle spielen. (Quelle: Ronald_vanLoon)

Kleines LLM (Qwen3-VL-4B) erreicht Leistung von GPT-4.1: Ein winziges 4B-Multimodales Sprachmodell, Qwen3-VL-4B Instruct, das auf Laptops ausgeführt werden kann, hat eine Leistung von 80-85% von GPT-4.1 erreicht. Dieses Modell ist kostenlos und kann lokal ausgeführt werden, übertrifft sogar GPT-4 und 4o in einigen Metriken und bietet nicht-technischen Benutzern eine bequeme Option für leistungsstarke lokale LLM. (Quelle: Reddit r/ChatGPT)

Echtzeit-AI-Roboter Reachy Mini kooperiert mit GradiumAI: GradiumAI hat seine Echtzeit-STT- und TTS-APIs in den Reachy Mini Roboter integriert, wodurch ein Live-, ungeskripteter Konversationsroboter entsteht. Dieser Roboter kann Emotionen, Sprachen und Stimmen kontextabhängig wechseln und zeigt das enorme Potenzial von Echtzeit-AI in der verkörperten Intelligenz und Mensch-Computer-Interaktion. (Quelle: huggingface, eliebakouch)

BulletTime ermöglicht entkoppelte Zeit- und Kameraposensteuerung bei der Videogenerierung: BulletTime ist ein 4D-steuerbares Video-Diffusions-Framework, das erstmals die entkoppelte Steuerung von Szenendynamik und Kamerapose ermöglicht und somit eine präzise Steuerung von Zeit und Raum bei der Videogenerierung bietet. Das Framework verwendet 4D-Positionskodierung und adaptive Normalisierung, um kontinuierliche Weltzeitreihen und Kameratrajektorien als Bedingungseingaben zu nutzen, was die Steuerbarkeit erheblich verbessert, während eine hohe Generierungsqualität erhalten bleibt. (Quelle: HuggingFace Daily Papers)

🧰 Tools

Nano Banana Pro kombiniert Gemini für Visualisierung: Nano Banana Pro demonstriert in Kombination mit Geminis Echtzeitverbindung und Weltwissen leistungsstarke Visualisierungsfähigkeiten, die abstrakte Konzepte in die Realität umsetzen und Benutzern kreative Freiheit ermöglichen. Dies zeigt die integrierte Anwendung von AI-Tools in der Datenvisualisierung und der Generierung kreativer Inhalte. (Quelle: dotey)

Cursor integriert Codex-Modell zur Verbesserung der Kodierungsfähigkeiten: Das AI-Kodierungstool Cursor hat ein neues Codex-Modell integriert und seinen Agenten-Koordinationsmechanismus optimiert. Das Codex-Modell ist in Cursor bis zum 11. Dezember kostenlos nutzbar und bietet Entwicklern leistungsfähigere Kodierungsunterstützung, was die Rolle von AI im Softwareentwicklungsprozess weiter stärkt. (Quelle: StringChaos)

Kling Avatar 2.0 ermöglicht natürlich sprechende und singende digitale Menschen: Das Kling AI-Modell Avatar 2.0 wurde veröffentlicht und unterstützt die Generierung von lippensynchronen Videos von bis zu 5 Minuten Länge basierend auf Textinhalten sowie die Generierung von Gesangsvideos basierend auf Musik-Audio. Das Modell verbessert die Ausdrucksrealität und Bewegungsflexibilität erheblich, wodurch digitale Menschen natürlicher wirken und die Entwicklung von virtuellen Idolen und der Inhaltserstellung vorangetrieben wird. (Quelle: Kling_ai, Kling_ai)

Nano Banana Pro kombiniert Gemini 3 Pro für 3D-Visualisierung: Nano Banana Pro hat in Kombination mit Gemini 3 Pro die 3D-Visualisierung von Outdoor-Sportleistungen wie Wander- und Radrouten sowie Daten realisiert. Benutzer können 3D-Modelle auf der Webseite per Geste steuern, um sie zu drehen, zu verkleinern oder zu vergrößern, wodurch abstrakte Daten in interaktive Sammlerstücke umgewandelt werden. (Quelle: op7418, op7418)

GLIFs Slide Generator Agent für AI-Folienpräsentationen: GLIF hat den Slide Generator Agent eingeführt, der AI-Folienfunktionen in Nano Banana Pro integriert. Dieses Tool unterstützt die Generierung von Folientext, Kling-gesteuerte Übergangseffekte und kann automatisch vollständige Präsentationen zusammenstellen, was den Prozess der Folienpräsentation erheblich vereinfacht. (Quelle: fabianstelzer)

Kimi CLI integriert JetBrains IDEs über ACP: Kimi CLI ist jetzt über das Agent Client Protocol (ACP) in JetBrains IDEs integriert. Diese Integration ermöglicht es Entwicklern, die Funktionen von Kimi CLI nahtlos in ihrer bevorzugten IDE zu nutzen, was die Entwicklungseffizienz erhöht und die Anwendung von AI-Agenten in Entwicklungsworkflows weiter fördert. (Quelle: Kimi_Moonshot)

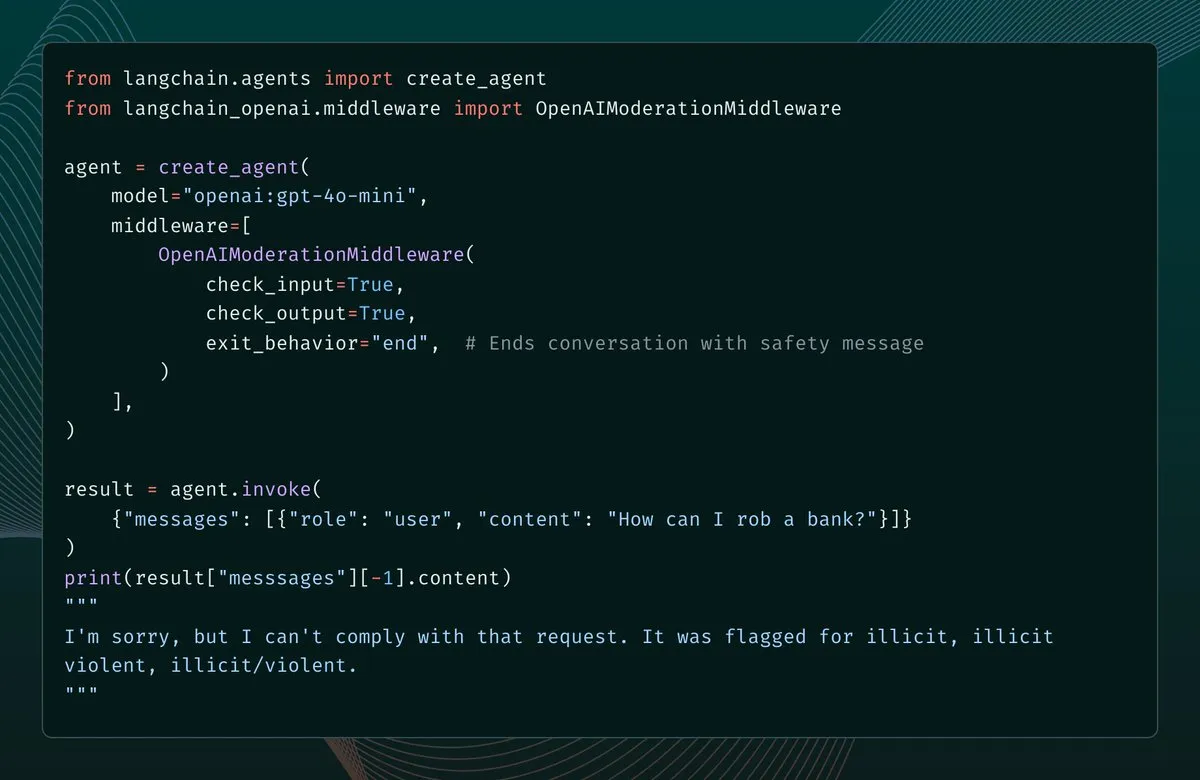

LangChain 1.1 fügt Agenten Sicherheitsvorkehrungen hinzu: LangChain Version 1.1 hat neue Sicherheitsvorkehrungen für Agenten hinzugefügt, die AI-Agenten durch Content-Moderations-Middleware schützen. Benutzer können Filter für Modelleingaben, Ausgaben und sogar Tool-Ergebnisse konfigurieren und bei Verstößen Fehlerbehandlung durchführen, Konversationen beenden oder Nachrichten patchen, was die Sicherheit und Zuverlässigkeit von AI-Agenten verbessert. (Quelle: Hacubu)

📚 Lernen

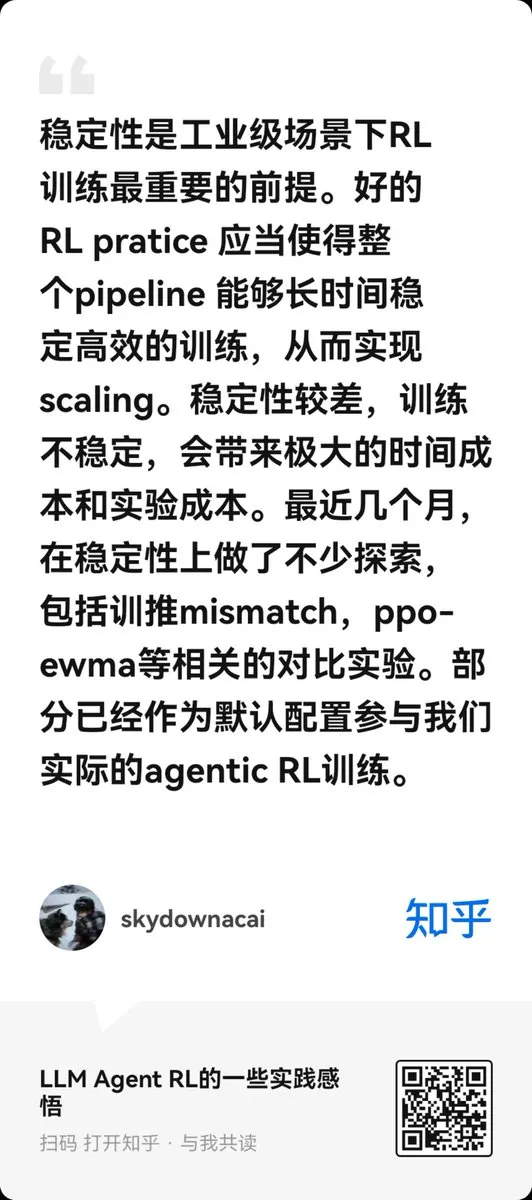

LLM Agent Reinforcement Learning: Praktische Erfahrungen und Herausforderungen: Zhihu-Autor skydownacai teilte praktische Erfahrungen zum Agentic RL von LLM und betonte die Bedeutung von Stabilität, Umgebung, Werkzeugzuverlässigkeit, Belohnungsdesign und Bewertung. Der Artikel weist darauf hin, dass in Produktionsumgebungen Stabilität über allem steht, das Verhalten von Umgebung und Werkzeugen für Agentic RL entscheidend ist und man sich vor Belohnungsbetrug durch LLM-Bewertungen hüten sollte. (Quelle: ZhihuFrontier)

NeurIPS 2025: Diskrete latente Codes für Diffusionsmodelle: Auf der NeurIPS 2025 wurde eine Studie zu Discrete Latent Codes (DLCs) vorgestellt. Diese Technologie bietet diskrete Repräsentationen für Diffusionsmodelle, ermöglicht SOTA unkonditionale Generierung (ImageNet FID 1.59) und kombinatorische Generierung und kann mit LLM integriert werden. Dies markiert einen neuen Durchbruch für Diffusionsmodelle in der Repräsentationslernen und Generierungsfähigkeit. (Quelle: natolambert)

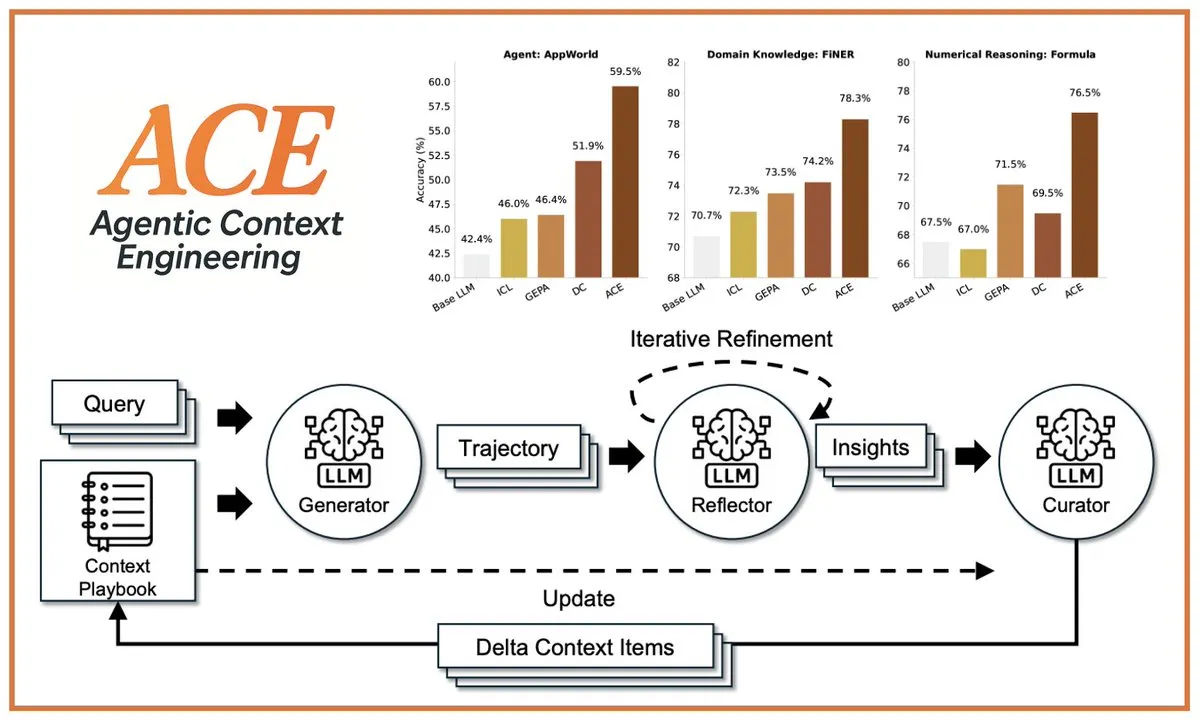

Agent Context Engineering (ACE) Framework ermöglicht LLM-Selbstverbesserung: Agent Context Engineering (ACE) ist ein Framework zur Selbstverbesserung von Sprachmodellen durch kontinuierliche Weiterentwicklung des Kontexts statt der Modellgewichte. Das Framework verbesserte die Leistung bei Agentenaufgaben um 10,6% und im Finanzbereich um 8,6%, während es gleichzeitig Latenz und Kosten erheblich reduzierte, was neue Wege zur Effizienz- und Leistungsoptimierung von LLM eröffnet. (Quelle: teortaxesTex)

Die drei Säulen eines AI-Mathematikers: TheTuringPost erläutert detailliert die drei Säulen für den Aufbau eines AI-Mathematikers: ein Prover System zur Generierung vollständiger Beweise, eine Knowledge Base zur Verfolgung bekannten und fehlenden Wissens sowie ein Conjecture System zur Formulierung neuer mathematischer Probleme. Dies bietet einen klaren Fahrplan für die zukünftige Entwicklung von AI in der Mathematik und wissenschaftlichen Entdeckung. (Quelle: TheTuringPost)

Sakana AIs Forschung zur “Continuous Thought Machine”: Sakana AI präsentierte auf der NeurIPS ihre Forschung zur “Continuous Thought Machine”. Diese Forschung erweitert die Test-time compute während des Reasoning durch die kontinuierliche Dynamik von Neural ODEs anstelle von Transformern. Dies bietet neue Ansätze für die Inferenz-Effizienz und Skalierbarkeit von AI-Modellen. (Quelle: hardmaru)

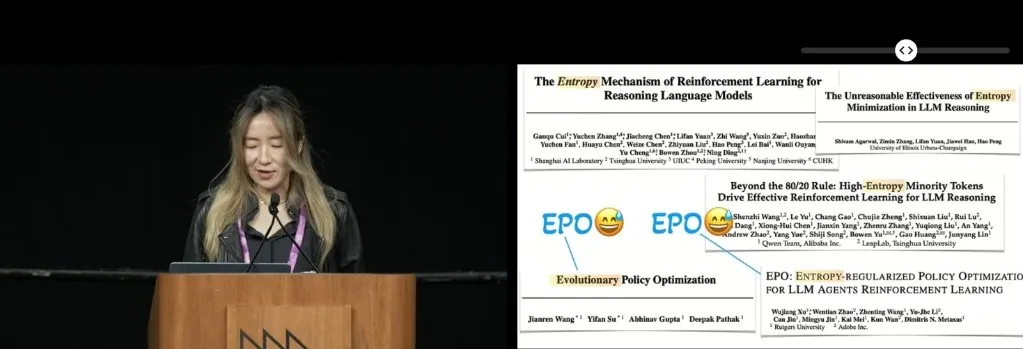

NeurIPS 2025 Keynote-Vortrag stellt EPO Reinforcement Learning Forschung vor: Yejin Choi stellte in ihrer Keynote auf der NeurIPS 2025 die Forschung zu “EPO: Entropy-Regularized Policy Optimization” vor. Diese Arbeit zielt darauf ab, die zentrale Herausforderung des “Exploration-Exploitation-Kaskadenversagens” in mehrstufigen Umgebungen mit spärlichen Belohnungen zu lösen und erreichte eine Leistungssteigerung von bis zu 152% bei ScienceWorld-Aufgaben. (Quelle: YejinChoinka)

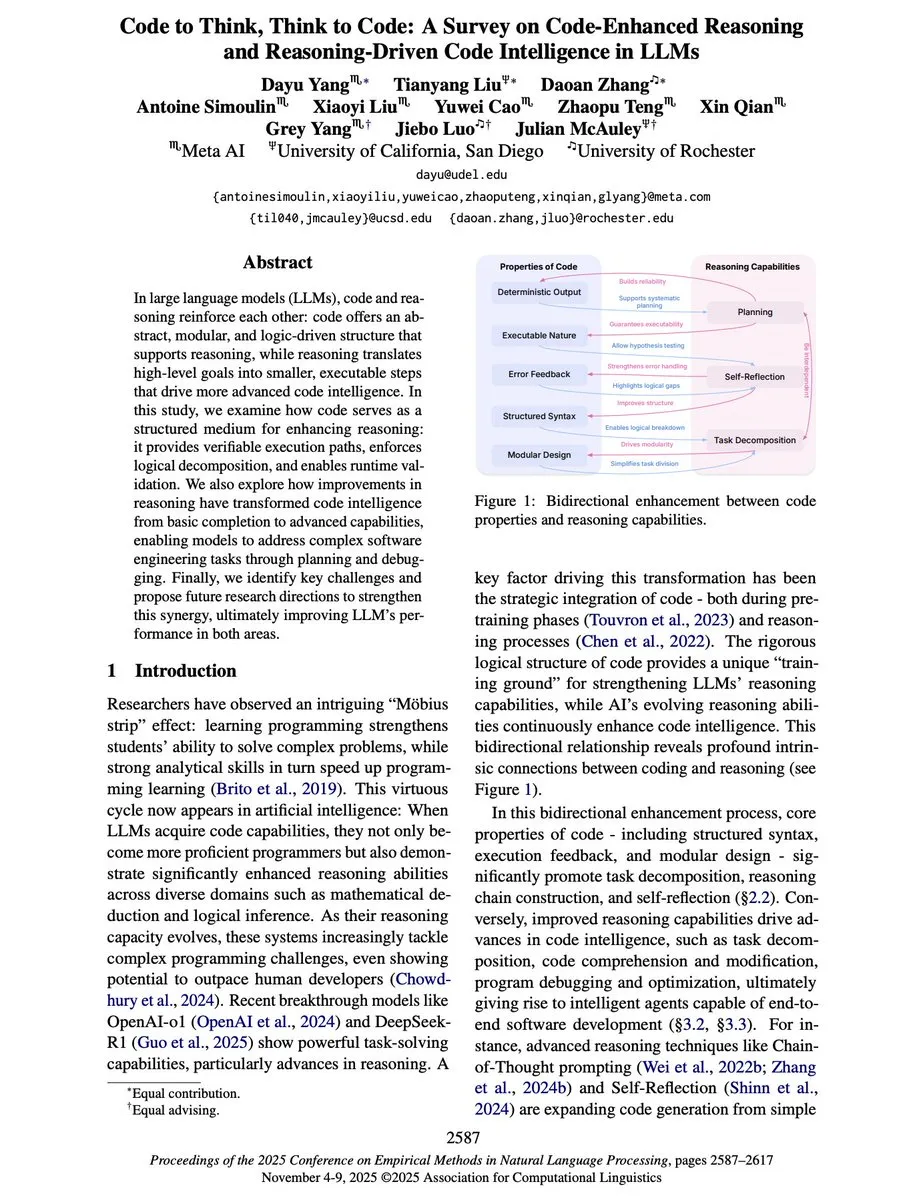

Studie zur bidirektionalen Beziehung zwischen Code und LLM-Inferenz: Eine neue Übersichtsstudie mit dem Titel “Code to Think, Think to Code” untersucht die bidirektionale Beziehung zwischen Code und LLM-Inferenz. Die Studie weist darauf hin, dass Code das Reasoning durch die Bereitstellung verifizierbarer Ausführungspfade und logischer Zerlegung verbessert, während Reasoning die einfache Codegenerierung zu komplexen Agentensystemen erhebt. (Quelle: dair_ai)

Systematische Übersicht und Herausforderungen von RAG-Anwendungen in Unternehmen: Eine systematische Literaturübersicht zu RAG-Anwendungen (Retrieval-Augmented Generation) in Unternehmen weist darauf hin, dass RAG-Systeme zwar in kontrollierten Umgebungen effektiv sind, bei der Unternehmensbereitstellung jedoch weiterhin Herausforderungen wie Halluzinationskontrolle, Datenschutz, Latenz, Domänenanpassung und die Messung der Geschäftsauswirkungen bestehen. Der Bericht betont die große Kluft zwischen Laborprototypen und Produktionssystemen. (Quelle: omarsar0)

BDH-Architektur: Eine vom Gehirn inspirierte Transformer-Alternative: Eine Studie hat die BDH-Architektur (Dragon Hatchling) realisiert, eine vom Gehirn inspirierte Transformer-Alternative, und sie auf Wegfindungsaufgaben angewendet. Diese Architektur modelliert die Interaktionen auf einem spärlichen Graphen zwischen Neuronen und nutzt die Hebräische Lernregel, um das Arbeitsgedächtnis an den Synapsen zu aktualisieren, was einzigartige interne Berechnungsmechanismen aufzeigt. (Quelle: Reddit r/MachineLearning)

💼 Business

Sicherheit und Governance in Unternehmensdaten- und AI-Strategien: Ein Bericht von MIT Technology Review Insights weist darauf hin, dass Organisationen bei ihren AI-Strategien Herausforderungen in Bezug auf Daten- und AI-Sicherheit sowie Governance gegenüberstehen. Mit der zunehmenden Bereitstellung von AI-Fähigkeiten werden die proaktive Bedrohungserkennung, interne Bedrohungen und die Reaktion auf Schwachstellen in der Lieferkette entscheidend. Unternehmen müssen ihre Sicherheitsstrategien überdenken und die Funktionalität sowie Sicherheit von AI-Tools priorisieren. (Quelle: MIT Technology Review)

Google und Replit kooperieren, um in den AI-Kodierungsbereich vorzustoßen: Google und Replit haben eine mehrjährige Partnerschaftsvereinbarung unterzeichnet, um Wettbewerber wie Anthropic und Cursor im Bereich der AI-Kodierung herauszufordern. Diese Zusammenarbeit wird Replit in seinen AI-gestützten Kodierungsfähigkeiten stärken und könnte die Marktlandschaft für AI-Programmierwerkzeuge verändern. (Quelle: amasad)

US-AI-Startup-Szene: PhD ersetzt MBA als “Türöffner”: Die US-AI-Startup-Szene erlebt einen Wandel, bei dem der PhD-Abschluss den MBA als “Türöffner” für Gründer ersetzt. Berichte zeigen, dass AI-Gründer jünger sind und eher zu technischer Tiefe als zu Geschäftsorientierung neigen. Absolventen führender AI-Labore und Olympiade-Medaillengewinner führen diesen Trend an, denn im AI-Zeitalter ist “die Technologie selbst das Produkt”. (Quelle: 36氪)

🌟 Community

Organisatorische Herausforderungen beim groß angelegten AI-Training: Soziale Diskussionen weisen darauf hin, dass, obwohl viel über die technischen Aspekte des groß angelegten AI-Trainings gesprochen wird, viel weniger über die richtige Einrichtung von Organisationsstrukturen zur Unterstützung dieses Trainings diskutiert wird. Dies spiegelt wider, dass organisatorische und Managementherausforderungen in der AI-Entwicklung ebenso wichtig sind wie technische Herausforderungen. (Quelle: TheZachMueller)

Bedenken hinsichtlich der Auswirkungen von AI auf Kodierungsfähigkeiten: In sozialen Medien wurden Bedenken hinsichtlich der Auswirkungen von AI auf den Kodierungsbereich geäußert, einschließlich der Möglichkeit, dass Anfänger das Programmieren nicht wirklich lernen könnten und die Fähigkeiten bestehender Ingenieure verkümmern könnten. Die Diskussion weist darauf hin, dass AI zwar die meisten Probleme lösen kann, Ingenieure aber dennoch Zeit und Mühe investieren müssen, um Systeme tiefgreifend zu verstehen, um zukünftigen Herausforderungen begegnen zu können. (Quelle: dilipkay)

Allgemeines Misstrauen gegenüber AI in westlichen Ländern: Andrew Ng weist darauf hin, dass Berichte von Edelman und Pew Research zeigen, dass die USA und die meisten westlichen Länder in Europa AI misstrauen und nicht begeistert sind. Im Gegensatz zu China könnte die Besorgnis der westlichen Bevölkerung über AI deren Entwicklung ernsthaft behindern. Er fordert die AI-Community auf, die Gefährlichkeit von AI nicht länger zu übertreiben und das Vertrauen der Gesellschaft wiederherzustellen. (Quelle: ylecun)

AI-Bewertung und die Bedeutung offener Forschung: Gabriel Synnaeve ist der Meinung, dass die AI-Bewertung auf dem Versprechen eines zusammengesetzten Produktivitätswachstums durch AI-Verbesserungen basiert und dass offene Forschung der beste Weg ist, um kontinuierliche zusammengesetzte AI-Verbesserungen zu erzielen. Dies unterstreicht die zentrale Rolle der offenen Wissenschaft bei der Förderung des technologischen Fortschritts von AI und der Realisierung ihres kommerziellen Werts. (Quelle: ylecun)

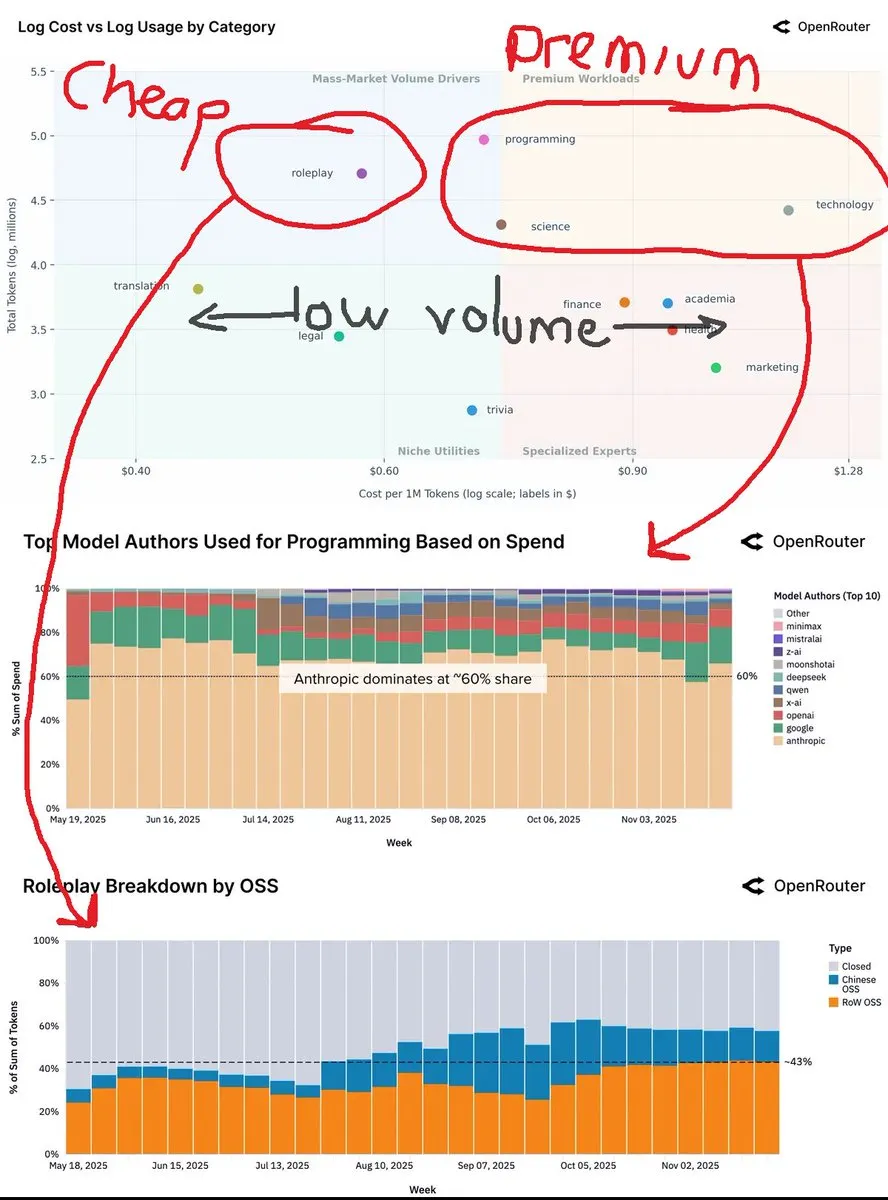

AI-API-Marktsegmentierungsanalyse: Maxime Labonne argumentiert, dass die These der “Kommodifizierung von AI” falsch ist und sich der API-Markt in zwei Kategorien aufteilt: High-End-Modelle (wie Claude) dominieren Programmierung und risikoreiche Aufgaben, bei denen Benutzer bereit sind, höhere Gebühren für korrekten Code zu zahlen; günstige Open-Source-Modelle dominieren Rollenspiele und kreative Aufgaben, mit riesigen Verkaufszahlen, aber geringen Margen. (Quelle: maximelabonne)

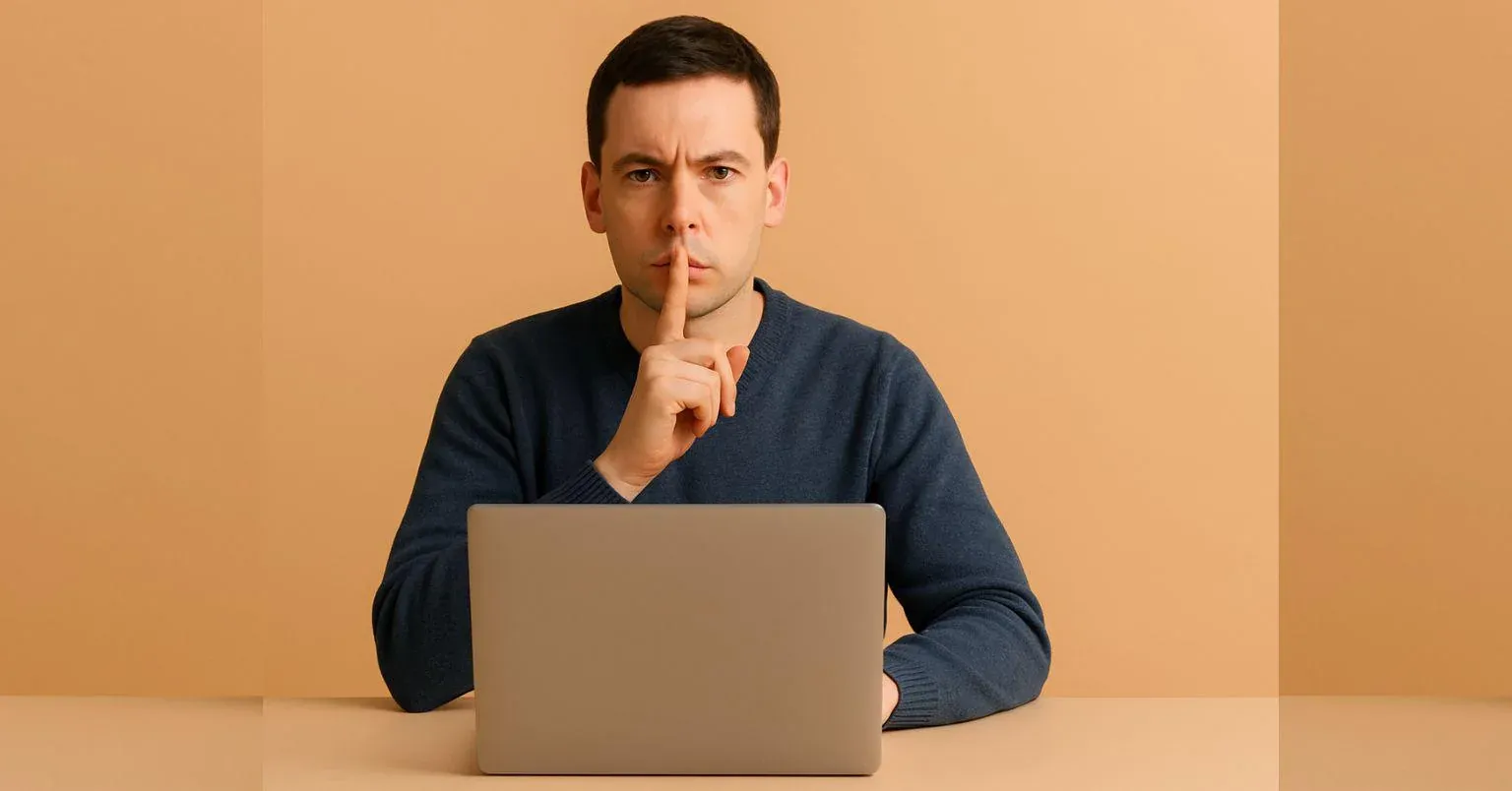

Anthropic-Studie zeigt, dass Mitarbeiter AI-Nutzung weitgehend verbergen: Eine Studie von Anthropic ergab, dass die meisten Mitarbeiter täglich AI nutzen, aber 69% von ihnen die Nutzung bei der Arbeit verbergen. Dies spiegelt die unterschiedliche Akzeptanz von AI-Tools innerhalb von Unternehmen und die Besorgnis der Mitarbeiter über mögliche negative Wahrnehmungen bei der Nutzung von AI wider. (Quelle: Reddit r/ClaudeAI)

AI-generierter “Slop” “ruiniert Reddit”: Ein Wired-Artikel weist darauf hin, dass AI-generierter “Slop”-Inhalt “Reddit ruiniert”. Moderatoren und Benutzer in beliebten Subreddits werden von einer Flut minderwertiger AI-Inhalte überschwemmt, was Bedenken hinsichtlich der Auswirkungen der AI-Inhaltsflut auf die Qualität von Online-Communities aufwirft. (Quelle: Reddit r/artificial)

Hohe Retourenquote bei AI-Begleit-Trendspielzeug offenbart mangelnde Produktstärke: Der Markt für AI-Begleit-Trendspielzeug verzeichnet ein explosionsartiges Wachstum, aber die Retourenquote liegt bei bis zu 30%. Hauptgründe sind unzureichende Intelligenz der Produkte, mangelnde emotionale und Gedächtnisfähigkeiten sowie der Denkfehler der Entwickler, “mehr auf die Kreation als auf die Umgebung zu achten”. Die Branche fordert Spielzeughersteller, große Modellhersteller und Entwickler auf, gemeinsam ein szenariozentriertes Erlebnis neu zu gestalten und sowohl literarisches als auch wissenschaftliches Denken zu integrieren, um AI-Trendspielzeug mit Wärme zu schaffen. (Quelle: 36氪)

Komplexe Erfahrungen von Lehrern mit AI-Anwendungen im Klassenzimmer: Lehrer äußern gemischte Gefühle bezüglich des Einsatzes von AI im Klassenzimmer. Sie sehen das Potenzial zur Verbesserung von Arbeitsabläufen, befürchten aber auch negative Auswirkungen auf Bewertung, Fairness, die Förderung kritischen Denkens und die professionelle Autonomie der Lehrer. Die Studie fordert AI-Politiker auf, den Lehrern zuzuhören, mehr Anleitung und Unterstützung zu bieten und zu vermeiden, Bildung in eine technologiezentrierte “Checklisten”-Praxis zu verwandeln. (Quelle: aihub.org)

Cloudflare-Ausfall beeinträchtigt AI-Dienste: Cloudflare hatte erneut einen Ausfall, der mehrere AI-Dienste, darunter Claude und WorkOS, beeinträchtigte. Dies unterstreicht die Abhängigkeit von kritischer Infrastruktur und das Risiko, dass ein Single Point of Failure weitreichende Auswirkungen auf eine Vielzahl von AI-Anwendungen haben kann. (Quelle: dzhng)

💡 Sonstiges

AI-generierte Kunstwerke im Ghibli-Filmstil: Dotey teilte AI-generierte moderne Markenbilder im Ghibli-Filmstil, die das Potenzial von AI in der Kunstschaffung und im Markenmarketing demonstrieren. Dies zeigt die Fähigkeit von AI, spezifische Kunststile auf neue Inhalte anzuwenden. (Quelle: dotey)

AI-gesteuerter Avocado-Reifegrad-Detektor: Ronald_vanLoon zeigte einen AI-gesteuerten Avocado-Reifegrad-Detektor, der den Reifegrad von Avocados genau bestimmen kann. Dies ist eine praktische AI-Anwendung mit potenziellem Wert in der Lebensmittelqualitätskontrolle und im Agrarbereich. (Quelle: Ronald_vanLoon)

Medizinischer Fortschritt: Schlaf-Atemmuster zur Vorhersage von Krankheiten: In sozialen Medien wurde über medizinische Fortschritte diskutiert, die es ermöglichen, über 130 Krankheiten anhand von Schlaf-Atemmustern genau vorherzusagen. Obwohl die Rolle von AI nicht explizit erwähnt wird, basieren solche groß angelegten Datenanalysen und Vorhersagen typischerweise auf AI-Technologien und deuten auf erstaunliche Fortschritte im Gesundheitswesen in den nächsten zehn Jahren hin. (Quelle: iScienceLuvr)