Schlüsselwörter:Livnium-Modell, DeepSeek V3.2, OpenAI, verkörperter intelligenter Roboter, AI-Agent, KI-generierte gefälschte Zitate, Rnj-1-Modell, Qwen 3 Coder, hybride neuro-geometrische Architektur, Cortex-AGI-Benchmark-Test, LLM-generierte gefälschte Referenzen, FastUMI effizientes Datenerfassungssystem, Nex-N1-Framework

🔥 Fokus

Livnium-Modell fordert traditionelles NLP-Paradigma heraus : Eine Studie stellt eine hybride neuronal-geometrische Architektur namens Livnium vor, die auf dem SNLI-Datensatz mit einer Genauigkeit von 96,19 % BERT-Base (91 %) übertrifft, bei einer Modellgröße von nur 52,3 MB (BERT-Base ca. 440 MB) und in 30 Minuten auf einer MacBook-CPU trainiert wurde. Livnium betrachtet logisches Denken als physikalische Simulation in einem Vektorraum und lernt durch fest codierte geometrische Gesetze statt durch massive Parameter. Dies stellt die traditionelle Vorstellung in Frage, dass „mehr Parameter gleich bessere Logik“ bedeuten, und betont, dass „bessere Physik zu besserem Denken führt“. (Quelle: Reddit r/deeplearning)

DeepSeek V3.2 zeigt herausragende Leistung im Cortex-AGI-Benchmark : DeepSeek V3.2 hat im Cortex-AGI-Benchmark hervorragend abgeschnitten und GPT-5.1 übertroffen, wobei die Kosten um 124,5 % gesenkt wurden. Dieses Ergebnis unterstreicht die starke Fähigkeit von DeepSeek bei abstrakten und Out-of-Distribution-Inferenzaufgaben und demonstriert seine Wettbewerbsfähigkeit im Bereich der Open-Source-Modelle mit einem erheblichen Kostenvorteil. (Quelle: Reddit r/deeplearning)

Sorge um KI-generierte gefälschte Zitate in wissenschaftlichen Arbeiten : In den für ICLR 2026 eingereichten Arbeiten wurden zahlreiche von LLMs generierte gefälschte Zitate entdeckt, sogar in hochwertigen Papern, und diese wurden von den Gutachtern nicht erkannt. Dieses Phänomen weckt Bedenken hinsichtlich der Integrität der ML-Forschungsgemeinschaft, unterstreicht das potenzielle zerstörerische Potenzial des Missbrauchs von KI-Tools für akademische Institutionen und führt zu Forderungen nach strengeren Mechanismen zur Zitatprüfung. (Quelle: Reddit r/MachineLearning)

🎯 Trends

OpenAI steht unter enormem Wettbewerbsdruck und passt seine Strategie an : Nach der Veröffentlichung von Gemini 3 verzeichnete OpenAI einen deutlichen Rückgang des Traffics. CEO Sam Altman gab eine „rote Warnung“ heraus, setzte nicht-essentielle Geschäftsbereiche wie Werbung und AI Agenten aus und konzentrierte Ressourcen auf die Verbesserung des Kern-ChatGPT-Erlebnisses, einschließlich Personalisierung, Bildgenerierung (um Nano Banana aufzuholen), Benutzerpräferenzen und Reaktionsgeschwindigkeit. Dies spiegelt wider, dass sich der Wettbewerb um große Modelle von technischen Parametern hin zur Fähigkeit der Ökosystemintegration verlagert hat. Google zeigt mit seinem breiten Ökosystem (YouTube, Google Search usw.) Vorteile bei Multimodalität und chinesischer Sprachunterstützung, was eine ernsthafte Herausforderung für OpenAI darstellt. (Quelle: 36氪)

Lumos Robotics, ein Unternehmen für verkörperte intelligente Roboter, erhält Finanzierung in Millionenhöhe : Das von der Tsinghua-Universität gegründete Unternehmen für verkörperte intelligente Roboter, Lumos Robotics (鹿明机器人), hat zwei Finanzierungsrunden der Pre-A1- und Pre-A2-Phase in Höhe von mehreren hundert Millionen RMB abgeschlossen, die für Investitionen in Daten und Hardware verwendet werden. Das Unternehmen konzentriert sich auf die Forschung und Entwicklung von verkörperten intelligenten Robotern und deren Kernkomponenten. Es verfügt über das effiziente Datenerfassungssystem FastUMI (3-fache Effizienzsteigerung, Kostenreduzierung auf 1/5) und eine leistungsstarke modulare Roboterplattform. Es arbeitet bereits mit führenden Unternehmen wie Mitsubishi Japan und COSCO Shipping zusammen und engagiert sich für die kommerzielle Implementierung verkörperter Intelligenz in Bereichen wie Haushalt, Logistik und Fertigung. (Quelle: 36氪)

Die Bedeutung der Umgebungserweiterung für die Modellfähigkeiten von AI Agenten : Eine Studie betont die Bedeutung der Umgebungserweiterung für Agentic AI und stellt das Nex-N1-Framework vor, das die Agentenfähigkeiten durch systematische Erweiterung der Vielfalt und Komplexität interaktiver Trainingsumgebungen verbessert. Dieses Framework zeigte hervorragende Leistungen bei Modellen wie DeepSeek-V3.1 und Qwen3-32B und übertraf sogar GPT-5 in Bezug auf die Werkzeugnutzung. Dies deutet darauf hin, dass die Agentenfähigkeit aus Interaktion und nicht aus Imitation entsteht. (Quelle: omarsar0)

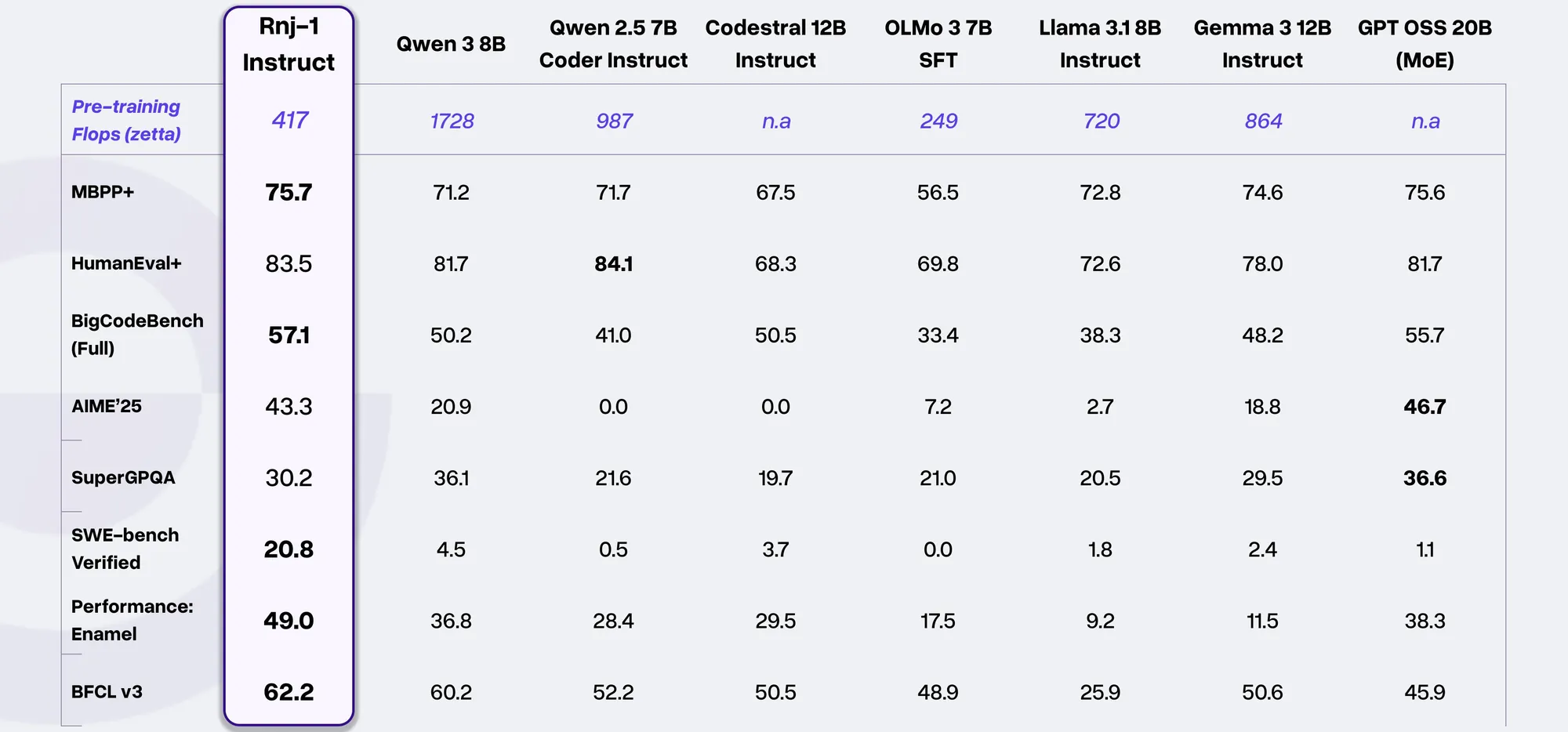

Essential AI veröffentlicht das Rnj-1-Modell : Essential AI hat sein erstes Flaggschiffmodell Rnj-1 (8B Parameter) veröffentlicht, das in der SWE-Bench-Leistung nahe an GPT-4o herankommt, andere Open-Source-Modelle seiner Klasse bei der Werkzeugnutzung übertrifft und in der mathematischen Denkfähigkeit mit GPT OSS MoE 20B vergleichbar ist. Dieses Modell widmet sich dem Fortschritt und der fairen Verteilung von Open-Source-AI. (Quelle: saranormous, scaling01, arohan, stanfordnlp, OfirPress, togethercompute, sbmaruf)

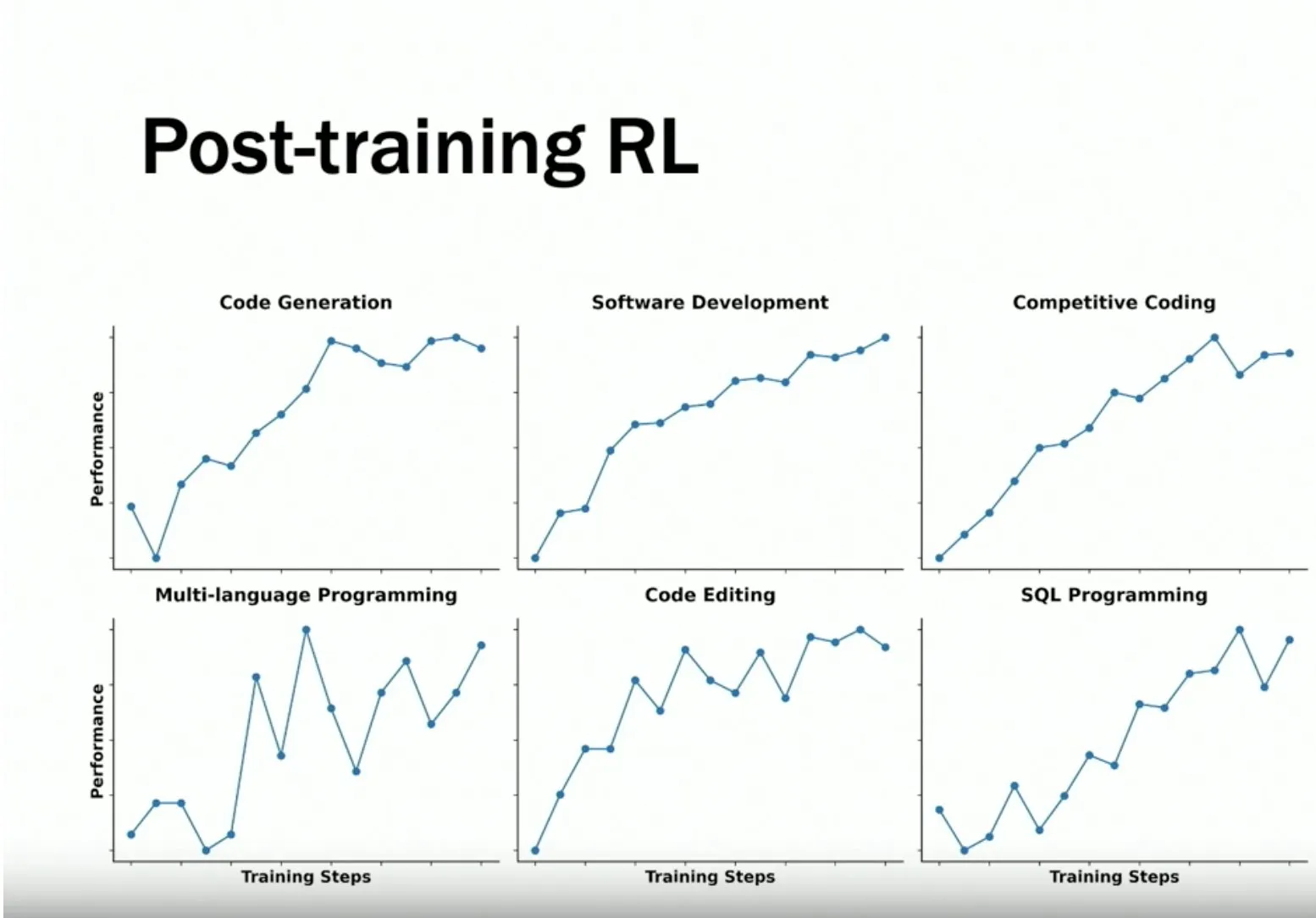

Fortschritte und zukünftige Richtungen von Qwen 3 Coder im Bereich der KI-Codierung : Das Qwen 3 Coder-Team teilte seine Fortschritte in den Bereichen synthetische Daten, Reinforcement Learning, Modellerweiterung und Aufmerksamkeitsmechanismen mit. Sie stellten fest, dass Chain-of-Thought (CoT) für Codierungsanwendungsfälle nicht gut geeignet ist, und nutzten Qwen 2.5 Coder, um synthetische Daten zu generieren und zu bereinigen. Groß angelegtes RL-Training erfolgte über den MegaFlow-Scheduler. Zukünftige Qwen LLMs werden Gated Delta Attention verwenden und planen architektonische Innovationen in den Bereichen langer Kontext, integrierte Suche, Computer-Vision-Integration und die Verarbeitung von Langzeitaufgaben. (Quelle: bookwormengr, bookwormengr)

Architektur-Updates und Kosteneffizienz von DeepSeek V3.2 : DeepSeek V3.2 zeigte nicht nur hervorragende Leistungen im Cortex-AGI-Benchmark, sondern seine Stärke liegt in architektonischen Updates statt in einfachen Modellkarten-Upgrades. Diese Version wurde in Bezug auf Sparse MoE Stacks, RoPE Indexer Fixes, FP8- und KV-Stabilität, DSA-aligned GRPO sowie den Math-V2 Validator/Meta-Validator Stack verbessert. Dies führte zu einer erheblichen Kosteneffizienz. Ihre „Missachtung“ der Token-Effizienz wird als Ausdruck ihrer Wettbewerbsfähigkeit angesehen. (Quelle: Dorialexander, teortaxesTex, teortaxesTex)

Fortschritte in der verkörperten Intelligenz und Robotik : PHYBOT M1 zeigte einen Rückwärtssalto in der Luft und kündigt damit die Ära der „Superhuman“-Humanoiden an. FIFISH-Unterwasserroboter revolutionieren die Rumpfinspektion in Werften und steigern die Effizienz. Hyundai plant den Einsatz von Zehntausenden Robotern, darunter Atlas-Humanoiden und Spot-Quadrupeds. Diese Fortschritte markieren innovative Schritte in der Fusion von KI und Robotik. Darüber hinaus steuern ISS-Astronauten Roboter fern, um simulierte Planetenexplorationen durchzuführen. Physische KI und Robotik werden die nächste industrielle Revolution auslösen. (Quelle: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, [teortaxesTex](https://