Schlüsselwörter:GPT-5.2, OpenAI, KI-Modell, Berufliche Arbeitsfähigkeit, Agenten-Tool-Aufruf, Visuelle Fähigkeiten, Kontextfenster, Wissensdatenbank-Aktualisierung, GPT-5.2 Thinking-Modell, GDPval-Benchmark-Test, SWE-Bench Pro-Rekord, ARC-AGI-1-Durchbruch, Statistische Lerntheorie, GPT-5.2 KI-Modell von OpenAI, Berufliche Fähigkeiten mit KI-Modellen, Agenten-Tools für KI-Systeme, Visuelle Erkennungsfähigkeiten von GPT-5.2, Erweiterte Kontextverarbeitung in KI, Aktualisierung von KI-Wissensdatenbanken, GPT-5.2 Thinking-Modell für komplexe Aufgaben, Leistungsbewertung mit GDPval-Benchmark, Verbesserte Ergebnisse im SWE-Bench Pro, Fortschritte in AGI mit ARC-AGI-1, Statistische Lernmethoden für KI-Modelle

🔥 Fokus

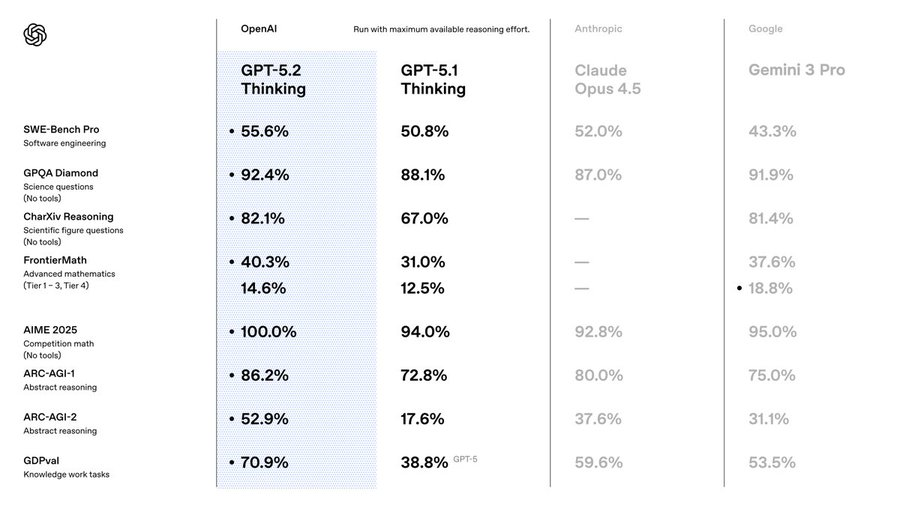

OpenAI veröffentlicht GPT-5.2 Modellreihe: Professionelle Arbeitsfähigkeiten deutlich verbessert : OpenAI stellt die drei Modelle GPT-5.2 Instant, Thinking und Pro vor, die darauf abzielen, hochkomplexe wissensbasierte Aufgaben zu lösen. Im GDPval-Benchmark von OpenAI übertrifft oder erreicht GPT-5.2 Thinking in 70,9 % von 44 beruflichen Aufgaben menschliche Experten, steigert die Effizienz um das 11-fache und senkt die Kosten auf unter 1 %. Das Modell hat sich in den Bereichen allgemeine Intelligenz, Verständnis extrem langer Texte, Agent-Tool-Aufrufe und visuellen Fähigkeiten umfassend weiterentwickelt. Die Wissensdatenbank ist bis zum 31. August 2025 aktualisiert und unterstützt ein Kontextfenster von 400.000 Tokens. Es erreichte einen neuen Rekord von 55,6 % auf SWE-Bench Pro, durchbrach erstmals die 90 %-Marke auf ARC-AGI-1 und unterstützte bei der Lösung offener Probleme in der statistischen Lerntheorie in der wissenschaftlichen Forschung. Obwohl der Preis um 40 % gestiegen ist, betont OpenAI das verbesserte Preis-Leistungs-Verhältnis durch die höhere Token-Effizienz. (Quelle: 36氪, 36氪, 36氪, 36氪, 36氪, 36氪, 36氪, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ArtificialInteligence)

Disney und OpenAI schließen 1-Milliarde-Dollar-Kooperation ab, Sora erhält über 200 IP-Lizenzen : Disney kündigt eine Investition von 1 Milliarde US-Dollar in OpenAI an und unterzeichnet eine dreijährige Lizenzvereinbarung, die es Sora und ChatGPT Images erlaubt, über 200 ikonische IP-Charaktere von Disney, Pixar, Marvel und Star Wars (nur animierte/illustrierte Versionen, keine realen Porträts/Stimmen) zur Generierung von Kurzvideos und Bildern zu verwenden. Einige UGC-Inhalte könnten zukünftig auf der Disney+ Plattform erscheinen. Dieser Schritt markiert den Übergang von KI im Bereich der Inhaltserstellung vom Werkzeug zur Plattform. Disney strebt an, den erzählerischen Einfluss durch den verantwortungsvollen Einsatz von KI zu erweitern und gleichzeitig aktiv auf die Herausforderungen des KI-Urheberrechts zu reagieren. (Quelle: kylebrussell, dotey, 36氪, 36氪, 36氪, 36氪, Reddit r/ChatGPT)

Google Deep Research Agent aktualisiert und API geöffnet, DeepMind kooperiert mit britischer Regierung zur Förderung von KI in der Staatsführung : Google veröffentlicht den neuen Gemini Deep Research Agent, basierend auf dem Gemini 3 Pro Modell, der die Websuchfunktion optimiert und tiefgehende Forschungsberichte zu geringeren Kosten generieren kann. Im HLE-Test erreichte er 46,4 %, leicht über GPT-5.2. Gleichzeitig wurde der DeepSearchQA-Benchmark als Open Source veröffentlicht, der 900 Kausalkettenaufgaben enthält, um die umfassende Leistungsfähigkeit von Agents in komplexen Netzwerkstudien zu bewerten. Die Interactions API wurde eingeführt, um die Interaktion zwischen Agents und Modellen zu vereinheitlichen und serverseitiges Zustandsmanagement sowie Remote-MCP-Tools zu unterstützen. Darüber hinaus arbeitet DeepMind mit der britischen Regierung zusammen, um KI zur Lösung von Problemen in der öffentlichen Verwaltung wie Stadtplanung (Project Extract) und zur Beschleunigung wissenschaftlicher Entdeckungen (automatisiertes KI-Wissenschaftslabor) einzusetzen. (Quelle: omarsar0, osanseviero, GoogleAIStudio, demishassabis, 36氪, 36氪, 36氪)

Internes ‘Machtspiel’ bei Meta eskaliert, Uneinigkeit über KI-Entwicklungsstrategie : Die New York Times berichtet über interne Konflikte bei Meta bezüglich der KI-Entwicklungsrichtung. Das TBD Lab-Team unter der Leitung von Alexandr Wang, einem Schützling von Zuckerberg, und Veteranen wie Chief Product Officer Chris Cox und Chief Technical Officer Andrew Bosworth sind sich uneinig zwischen der AGI-Vision und der Produktkommerzialisierung. Das TBD Lab tendiert zur Entwicklung einer „gottähnlichen KI-Superintelligenz“, während die Veteranen die KI zur Optimierung von Social-Media-Empfehlungsalgorithmen und des Werbegeschäfts einsetzen möchten. Um die KI-Ambitionen zu unterstützen, plant Meta, das Budget der Reality Labs (Metaverse)-Abteilung erheblich zu kürzen. Darüber hinaus ist Turing-Preisträger Yann LeCun aufgrund von Meinungsverschiedenheiten ausgeschieden, was die Schwierigkeiten von Meta bei der strategischen KI-Transformation unterstreicht. (Quelle: 36氪, 36氪, 36氪, 36氪)

Neues Paradigma für KI-Infrastruktur: MCP-Protokoll an Linux Foundation gespendet, End-Cloud-Kooperation OpenCloudOS wird zur bevorzugten Option im KI-Zeitalter : Anthropic kündigt die offizielle Spende des Model Context Protocol (MCP) an die neu gegründete Agentic AI Foundation an, die von der Linux Foundation gehostet wird und darauf abzielt, ein offenes Interkonnektionsprotokoll für KI-Agenten zu etablieren. MCP ist bereits zum De-facto-Standard für Agent-Produkte geworden und wird von VS Code, OpenAI, Google, Alibaba, ByteDance, Tencent und anderen weitgehend integriert. Gleichzeitig wurde auf der OpenCloudOS Operating System Ecosystem Conference die „OpenCloudOS Infra Smart Base“ vorgestellt, die darauf abzielt, eine einheitliche KI-Rechenleistungsgrundlage zu schaffen, ein Full-Stack-KI-Infrastruktursystem zu realisieren, das Problem der fragmentierten Infrastruktur durch die explosionsartige Zunahme von KI-Training und -Inferenz zu lösen und die „Out-of-the-box“-Nutzung globaler Mainstream-GPUs und AI-Frameworks zu unterstützen. (Quelle: AnthropicAI, 36氪, 36氪)

🎯 Entwicklungen

NVIDIA veröffentlicht 8B Orchestrator Modell, gestaltet AGI-Produktivität neu : NVIDIA stellt das 8-Milliarden-Parameter-Modell Orchestrator vor, das durch Reinforcement Learning und einen mehrstufigen Ausführungsmechanismus als leichtgewichtiger Dispatch-Hub ein heterogenes Toolset steuert, um die Kosten zu senken und die Effizienz von KI-Aufgaben zu steigern. Im HLE-Benchmark übertrifft Orchestrator GPT-5 (35,1 %) mit einer Genauigkeit von 37,1 %, steigert gleichzeitig die Effizienz um das 2,5-fache und die Kosten