Palabras clave:Sesgo en IA, Robots humanoides, Ajuste fino de modelos grandes, DeepSeek-V3.2, vLLM, Gafas inteligentes con IA, Aprendizaje por refuerzo, Sesgo de casta en OpenAI, Marco Any2Track de Galaxy Universal, API de ajuste fino Tinker, Soporte multimodal vLLM, NVIDIA AI Blueprint VSS 2.4

🔥 Enfoque

Preocupación por el sesgo de casta en los modelos de OpenAI : Una investigación de MIT Technology Review revela que GPT-5 y Sora presentan un grave sesgo de casta en el mercado indio, asociando a los dalits con la pobreza y profesiones de bajo estatus, mientras que vinculan a los brahmanes con el conocimiento y el estatus espiritual. GPT-4o mostró menos sesgo. Los estándares actuales de evaluación de sesgos de IA (como BBQ) no cubren las castas, y los investigadores están desarrollando nuevos puntos de referencia. Esto ha generado preocupación sobre la equidad y el impacto social potencial de los modelos de IA en contextos culturales no occidentales. (Fuente: MIT Technology Review)

El framework Any2Track de Galaxy General permite a los robots humanoides un seguimiento de acciones de alta resistencia a las interferencias : Galaxy General Robotics ha lanzado Any2Track, un framework universal de seguimiento de acciones que permite a los robots humanoides (como el Unitree G1) imitar con precisión movimientos humanos complejos y adaptarse en tiempo real a las interferencias externas, manteniendo la estabilidad incluso ante patadas continuas. El framework utiliza aprendizaje por refuerzo en dos etapas para lograr un sim2real de cero-shot. La tecnología ya se ha aplicado en las tiendas minoristas “Galaxy Space Capsule”, impulsando la inteligencia encarnada del laboratorio a la comercialización, y se espera que se convierta en la tarjeta de presentación internacional de la industria robótica de China. (Fuente: 量子位)

Thinking Machines Lab lanza Tinker, reduciendo drásticamente la barrera para el fine-tuning de grandes modelos : Thinking Machines Lab, fundado por exmiembros clave de OpenAI y Google DeepMind, ha lanzado su primer producto, Tinker, una API flexible para el fine-tuning de LLM. Esta herramienta permite a los investigadores, mientras controlan los algoritmos y los datos, delegar tareas complejas como la gestión de infraestructura, la propagación hacia adelante y hacia atrás del modelo, y el entrenamiento distribuido a la plataforma, reduciendo significativamente los costos y las barreras técnicas del fine-tuning. Tinker es compatible con los modelos de las series Qwen3 y Llama3, y utiliza la tecnología LoRA para compartir GPU y mejorar la eficiencia, siendo considerado una mejora importante en la productividad de la investigación en IA. (Fuente: 量子位)

🎯 Tendencias

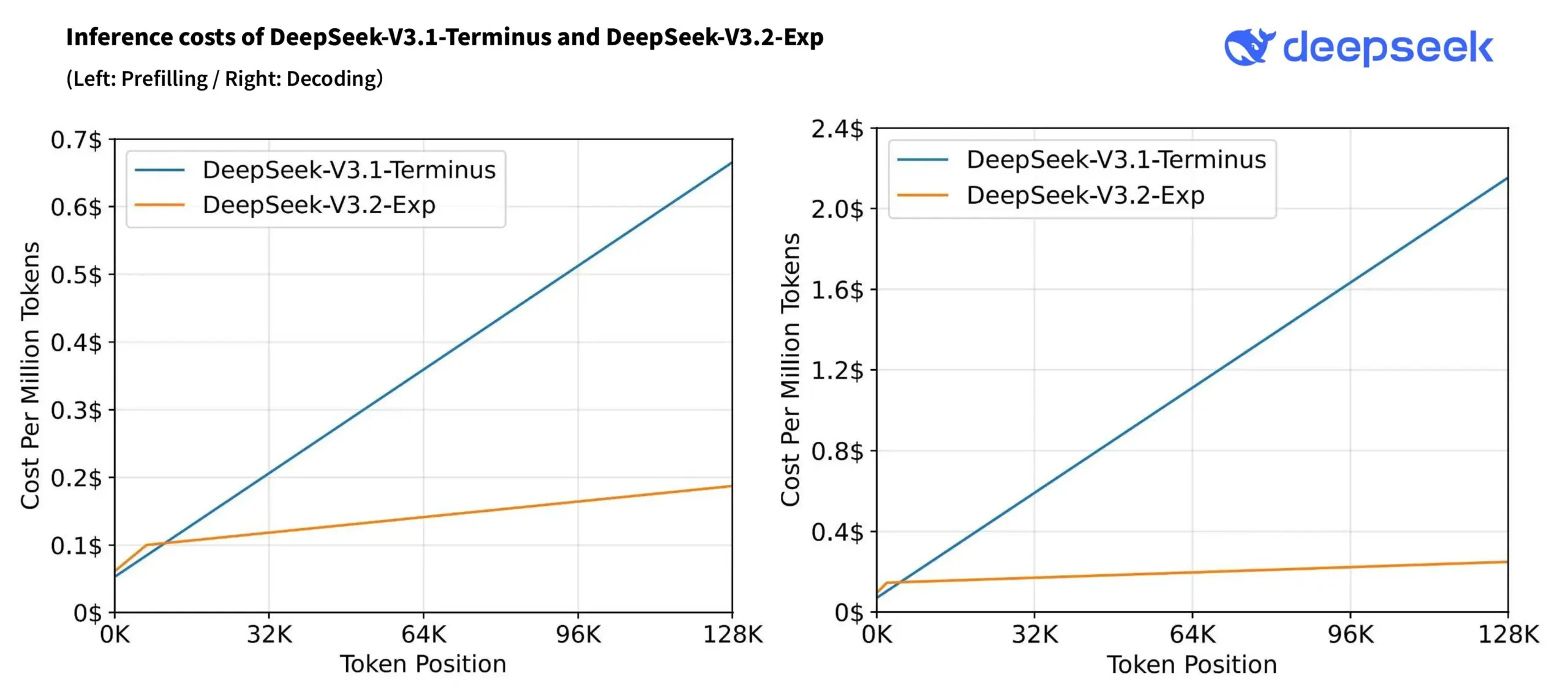

Lanzamiento del modelo DeepSeek-V3.2-Exp y reducción de precios de la API : DeepSeek ha lanzado el modelo experimental DeepSeek-V3.2-Exp, que introduce la atención dispersa DeepSeek (DSA) para mejorar la eficiencia del procesamiento de contextos largos y reducir los costos computacionales. El precio de la API ha disminuido más del 50%, y el modelo ha demostrado un rendimiento excepcional en el benchmark WeirdML, mejorando aún más la relación costo-rendimiento y la capacidad de inferencia. (Fuente: deepseek_ai, teortaxesTex)

Actualización de vLLM v0.10.2: soporte multimodal y optimización de inferencia : vLLM ha lanzado la versión 0.10.2, añadiendo soporte para varios modelos como Qwen3-Next/Omni/VL, InternVL 3.5, Whisper, e introduciendo Decode Context Parallel y soporte completo para cudagraph, lo que optimiza significativamente el rendimiento y la eficiencia de la inferencia de LLM. (Fuente: vllm_project)

Apple se enfoca en el desarrollo de gafas inteligentes con IA, posponiendo la versión económica de Vision Pro : Apple ha suspendido el desarrollo de una versión económica de Vision Pro, priorizando en su lugar la investigación y desarrollo de gafas inteligentes con IA, con el objetivo de competir con rivales como Meta. Esta medida indica que Apple está considerando la tecnología de IA como el núcleo de su futura estrategia de hardware, especialmente en el ámbito de los dispositivos wearables, lo que presagia un cambio significativo en el enfoque de sus futuros productos. (Fuente: nptacek, TheRundownAI)

NVIDIA lanza AI Blueprint VSS 2.4, reforzando la comprensión del mundo físico y la IA en el borde : NVIDIA ha lanzado AI Blueprint VSS 2.4, que integra Cosmos Reason VLM, mejorando significativamente la capacidad de la IA para comprender el mundo físico y potenciando las funciones de preguntas y respuestas a través de la exploración de grafos de conocimiento de agentes, al tiempo que soporta la implementación de IA en el borde (edge AI), proporcionando una base más sólida para las aplicaciones de IA multimodal. (Fuente: dl_weekly)

Comparativa de capacidad de codificación de LLM: GPT-5 Codex supera a Claude Sonnet 4.5 : Las discusiones de desarrolladores indican que GPT-5 Codex de OpenAI ha superado a los modelos Claude 3.5/4 en generación y planificación de código, y es superior a Sonnet 4.5, destacando especialmente en la escritura de código más conciso y en el diseño de sistemas, lo que demuestra los últimos avances de OpenAI en el campo de la IA de codificación. (Fuente: dejavucoder, dejavucoder)

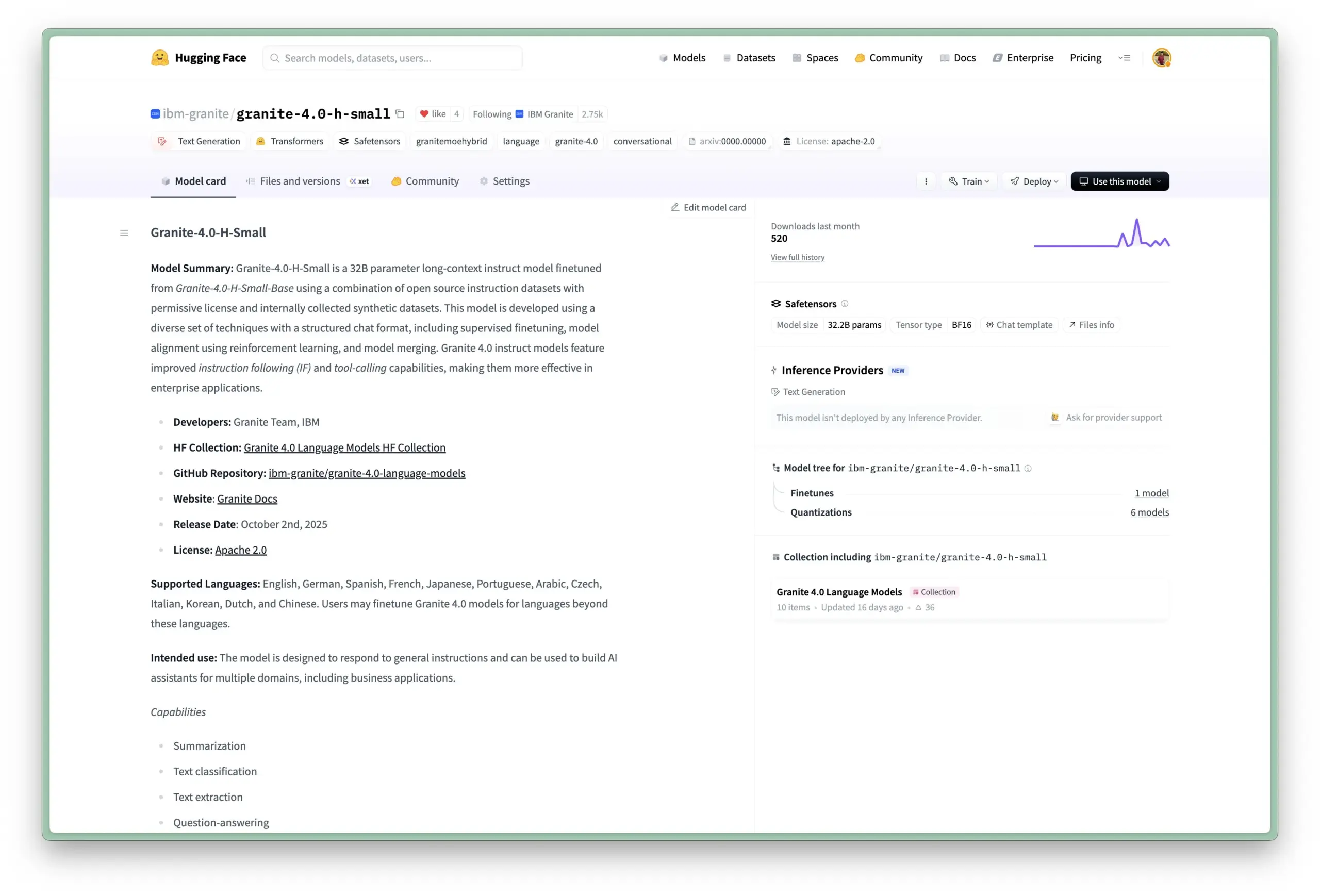

IBM lanza la serie de modelos de lenguaje Granite 4.0 : IBM ha presentado la serie de modelos de lenguaje Granite 4.0, que incluye modelos densos de 32B-A9B, 7B-A1B y 3B, y se ofrece en formato GGUF. Estos modelos soportan múltiples idiomas, llamadas a herramientas y contextos largos, y son de código abierto bajo la licencia Apache 2.0, con el objetivo de proporcionar soluciones de alto rendimiento para implementaciones locales y escenarios de aplicación específicos. (Fuente: reach_vb, Dorialexander, huggingface)

Flash-Searcher: Un framework de agente web rápido y eficiente basado en ejecución paralela DAG : Flash-Searcher es un novedoso framework de inferencia de agentes paralelos que descompone las tareas en subtareas con dependencias claras, logrando una ejecución concurrente a través de un grafo acíclico dirigido (DAG). Este framework optimiza dinámicamente los flujos de trabajo, superando los métodos existentes en múltiples benchmarks, y mejorando significativamente la eficiencia y precisión de la ejecución de agentes, proporcionando un paradigma más escalable para tareas de inferencia complejas. (Fuente: HuggingFace Daily Papers)

DeepSearch: MCTS integrado en el entrenamiento RLVR, rompiendo el cuello de botella de RL en modelos pequeños : El framework DeepSearch integra directamente la búsqueda en árbol Monte Carlo (MCTS) en el entrenamiento de aprendizaje por refuerzo con recompensa verificable (RLVR) de LLM, resolviendo el cuello de botella de rendimiento causado por la exploración dispersa en los métodos RLVR existentes. Este método, a través de la exploración durante el entrenamiento, la selección de fronteras globales y el entrenamiento con búfer de repetición adaptativo, permite que un modelo de inferencia de 1.5B alcance un nivel de vanguardia y reduce significativamente el tiempo de entrenamiento de la GPU. (Fuente: HuggingFace Daily Papers)

QUASAR: Generación de código de ensamblaje cuántico mediante RL de agente LLM mejorado con herramientas : QUASAR es un framework de aprendizaje por refuerzo (RL) de agente que utiliza LLM mejorados con herramientas para la generación y optimización de código de ensamblaje cuántico. Ha diseñado mecanismos de verificación de circuitos cuánticos y recompensas jerárquicas, mejorando significativamente el rendimiento sintáctico y semántico de los circuitos cuánticos generados, permitiendo que un LLM de 4B alcance una efectividad del 99.31% en Pass@1 y del 100% en Pass@10, superando a LLM de grado industrial como GPT-4o, GPT-5 y DeepSeek-V3. (Fuente: HuggingFace Daily Papers)

🧰 Herramientas

Atuin Desktop: Editor de runbooks ejecutable que conecta documentación y automatización : Atuin Desktop es un editor de runbooks ejecutable y local-first, diseñado para cerrar la brecha entre la documentación y la automatización. Permite a los usuarios encadenar comandos Shell, consultas de bases de datos y solicitudes HTTP en una única interfaz, implementando flujos de trabajo dinámicos a través de plantillas estilo Jinja, y soporta colaboración impulsada por CRDT, siendo adecuado para escenarios como la gestión de lanzamientos, migración de infraestructura y operaciones de bases de datos. (Fuente: GitHub Trending)

Tile Language: DSL para el desarrollo de kernels de alto rendimiento en GPU/CPU : Tile Language (tile-lang) es un lenguaje conciso de dominio específico (DSL), diseñado para simplificar el desarrollo de kernels de alto rendimiento para GPU/CPU (como GEMM, FlashAttention). Adopta una sintaxis Pythonic, se basa en la infraestructura del compilador TVM, soporta varios dispositivos como los chips Huawei Ascend, AMD MI300X, WebGPU, y ofrece soporte para kernels de tensores dispersos, con el objetivo de mejorar la eficiencia del desarrollo sin sacrificar el rendimiento de la optimización subyacente. (Fuente: GitHub Trending)

TradingAgents-CN: Framework de trading financiero con LLM multiagente, versión mejorada en chino : TradingAgents-CN es un framework de decisión de trading financiero en chino basado en modelos de lenguaje grandes (LLM) multiagente, optimizado para usuarios de habla china. Soporta análisis de acciones A/H/US, integra LLM nacionales e internacionales como Baidu Qianfan, DeepSeek, Google AI, y ofrece funciones como análisis inteligente de noticias, gestión de permisos de usuario, despliegue con Docker y exportación de informes profesionales, con el objetivo de popularizar la tecnología financiera de IA en la comunidad china. (Fuente: GitHub Trending)

Google Tunix: Librería de post-entrenamiento de LLM nativa de JAX : Google ha lanzado Tunix, una librería de post-entrenamiento de LLM basada en JAX, diseñada para simplificar el fine-tuning supervisado (SFT), el aprendizaje por refuerzo (RL, con soporte para PPO, GRPO, GSPO-token), el fine-tuning por preferencias (DPO) y la destilación de conocimiento de grandes modelos de lenguaje. Soporta métodos PEFT como LoRA/Q-LoRA y está optimizado para el entrenamiento distribuido en aceleradores como TPU. Se encuentra en una fase temprana de desarrollo y en el futuro soportará el entrenamiento de RL de agentes y el entrenamiento distribuido multi-host. (Fuente: GitHub Trending)

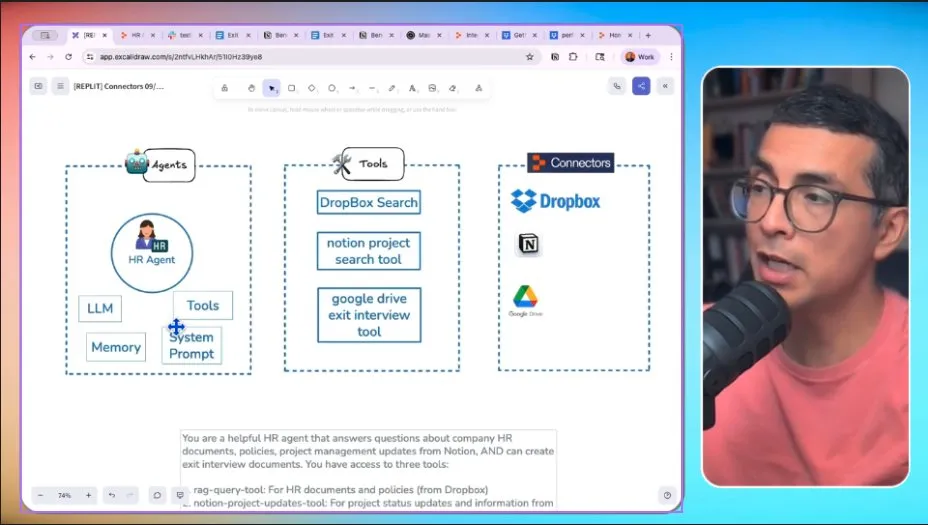

Replit Connectors: Simplifica la integración de aplicaciones y potencia los agentes de IA : Replit ha lanzado la función Connectors, que permite a los usuarios integrar fácilmente aplicaciones de Replit con herramientas cotidianas como Google, Dropbox, HubSpot, Notion. Esta función simplifica enormemente el proceso de desarrollo y proporciona la base para construir agentes de IA que pueden interactuar con servicios externos, ampliando aún más los escenarios de aplicación de la plataforma Replit. (Fuente: amasad)

Synthesia 3.0: Nueva plataforma de video con IA, introduce agentes de video : Synthesia ha lanzado la versión 3.0, presentando una nueva plataforma de video con IA que cuenta con nuevas funciones y flujos de trabajo, e introduce el concepto de “agentes de video”. Esta plataforma tiene como objetivo redefinir la creación de video, permitiendo a los usuarios generar contenido de video más rico a través de la tecnología de IA y proporcionando soluciones de producción de video más eficientes para usuarios comerciales. (Fuente: synthesiaIO)

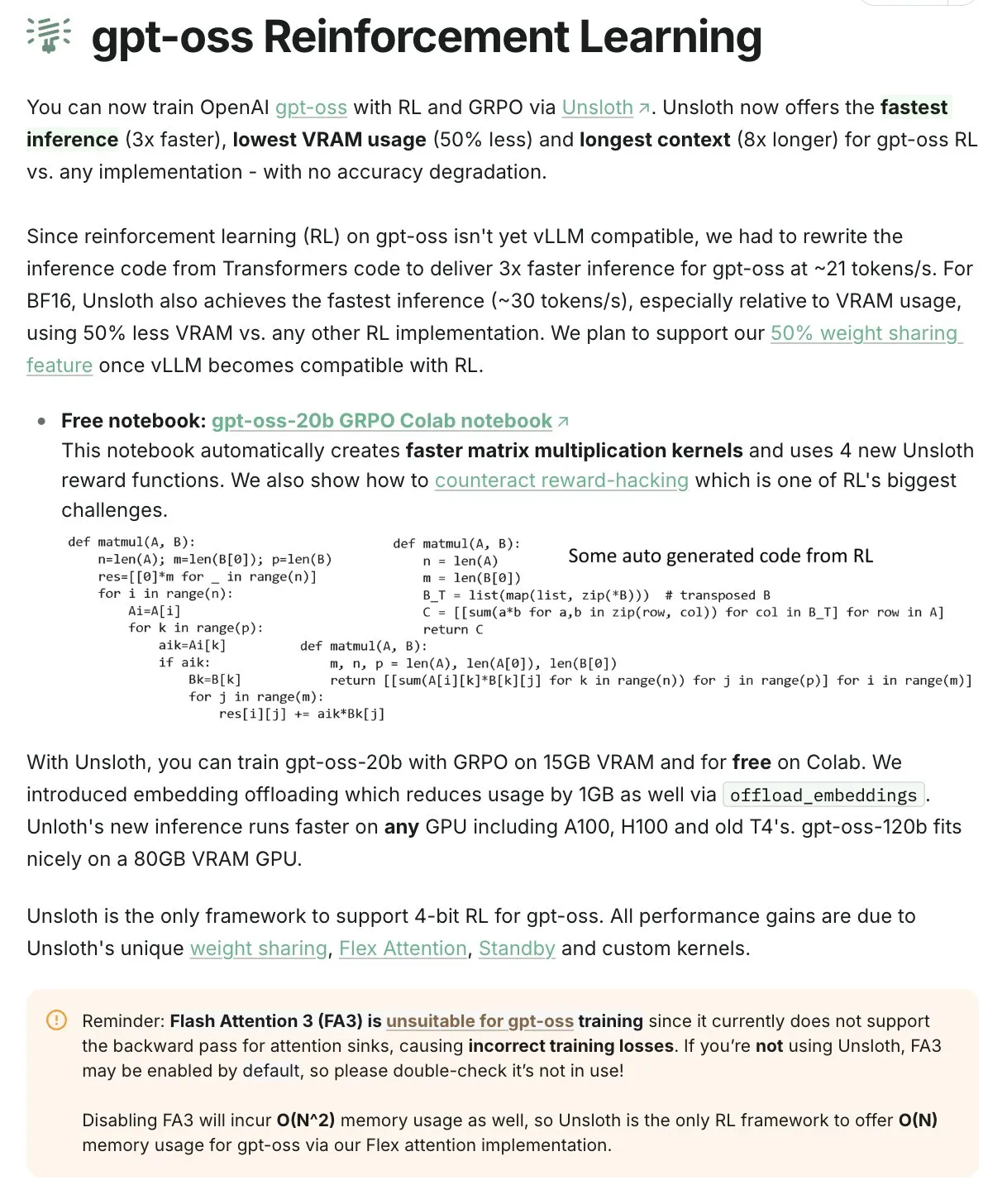

Unsloth: Entrenamiento e inferencia eficiente de LLM con bajo VRAM : Unsloth, aclamado como el “DOGE” en el campo del entrenamiento de IA, permite a los usuarios entrenar el modelo gpt-oss-20b mediante aprendizaje por refuerzo con solo 15GB de VRAM, logrando una velocidad de inferencia 3 veces mayor y una reducción del 50% en el uso de memoria, sin pérdida de precisión, lo que reduce drásticamente la barrera de hardware para el entrenamiento de LLM grandes. (Fuente: bookwormengr)

📚 Aprendizaje

El seminario de matemáticas de IA de Oberwolfach promueve la colaboración humano-máquina : El seminario de matemáticas de IA de Oberwolfach reunió a matemáticos, expertos en IA y laboratorios industriales para explorar la aplicación de la IA en el campo de las matemáticas. Este seminario tiene como objetivo fomentar la futura colaboración entre humanos y matemáticos de IA, impulsar la investigación de la IA en problemas complejos como las pruebas matemáticas formales, y sentar las bases para la cooperación interdisciplinaria. (Fuente: CarinaLHong)

Ruta de aprendizaje de MLOps y formación de ingenieros de IA : Se han compartido en redes sociales rutas de aprendizaje de MLOps y recursos para convertirse en ingeniero de IA. Se enfatiza la importancia de la inteligencia artificial, el aprendizaje automático y la tecnología en el desarrollo profesional, proporcionando orientación para profesionales que desean ingresar al campo de la IA, abarcando un desarrollo integral desde los conocimientos básicos hasta las habilidades prácticas. (Fuente: Ronald_vanLoon, Ronald_vanLoon)

Excelencia operativa en la transformación de la IA: el 95% de los proyectos piloto de IA generativa no generan retorno : MIT Technology Review señala que, a pesar de la enorme inversión en IA, el 95% de los proyectos piloto de IA generativa no han logrado un impacto medible en los beneficios. Los principales obstáculos radican en procesos operativos imperfectos, falta de documentación y colaboración deficiente, más que en la tecnología en sí. La implementación exitosa de la IA requiere un enfoque en la excelencia operativa, integrando la IA de manera efectiva en los flujos de trabajo diarios. (Fuente: MIT Technology Review, Ronald_vanLoon)

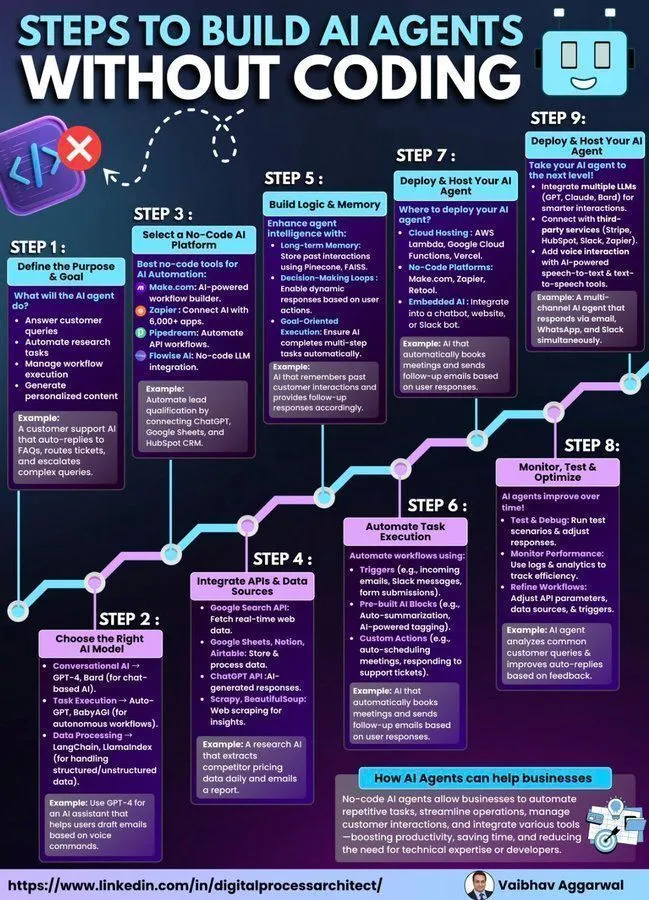

Guía para construir agentes de IA: desde cero y con métodos no-code : Se proporcionan guías para construir agentes de IA desde cero, así como pasos para implementar agentes de IA utilizando herramientas no-code. Estos recursos tienen como objetivo reducir la barrera de entrada para el desarrollo de agentes de IA, ayudando a desarrolladores y no técnicos a comprender y practicar rápidamente la creación y aplicación de agentes de IA, enfatizando la importancia de la simplicidad en el diseño de agentes. (Fuente: Ronald_vanLoon, Ronald_vanLoon)

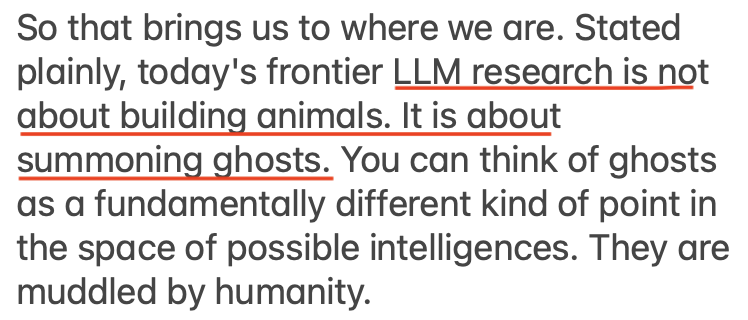

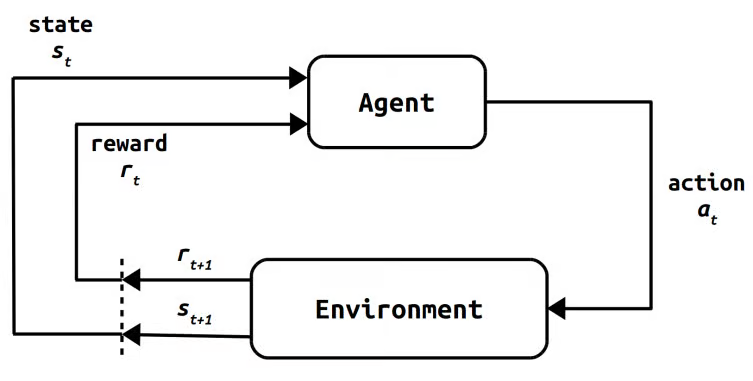

Exploración teórica de LLM: La ‘lección amarga’ de Sutton y el aprendizaje no animal de los LLM : Andrej Karpathy discutió la aplicabilidad de la teoría de la ‘lección amarga’ de Richard Sutton, padre del aprendizaje por refuerzo, a los LLM. Sutton argumenta que los LLM no están verdaderamente ‘amargamente aleccionados’ porque dependen de datos generados por humanos limitados, en lugar de aprender a través de la interacción dinámica con el mundo como los animales. Karpathy reconoce la ingeniería ‘humanizada’ de los LLM, pero considera que el pre-entrenamiento es una ‘mala evolución’ que proporciona un punto de partida para el posterior fine-tuning de RL, y hace un llamado a inspirarse en la inteligencia animal. (Fuente: Teknium1, Tim_Dettmers, dilipkay)

Construyendo confianza en la IA: el equilibrio entre transparencia y control : Se discutió la clave para construir confianza en el desarrollo de la inteligencia artificial: cómo lograr un equilibrio entre transparencia y control. Se enfatizó la importancia de la ética y la gobernanza de la IA para asegurar que los sistemas de IA sean desarrollados e implementados de manera responsable en la sociedad, manteniendo así la confianza del público en la tecnología de IA. (Fuente: Ronald_vanLoon)

Historia y evolución del aprendizaje por refuerzo: de la psicología a la IA moderna : Se revisa en detalle la evolución del aprendizaje por refuerzo (RL), desde sus fundamentos psicológicos y matemáticos, pasando por el RL computacional temprano, y métodos como Monte Carlo, Actor-Critic, aprendizaje por diferencia temporal, Q-learning, SARSA. Finalmente, converge en el RL profundo y los modernos RLHF, PPO, GRPO, trazando un panorama completo del desarrollo del RL y revelando su papel clave en el campo de la IA. (Fuente: TheTuringPost)

La combinación de IA y matemáticas: MistralAI forma un equipo de matemáticas formales : MistralAI ha anunciado la formación de un nuevo equipo de matemáticas formales y está reclutando activamente investigadores en matemáticas formales de IA. Este equipo tiene como objetivo desarrollar probadores de vanguardia, herramientas de formalización automática y agentes de prueba automáticos, aplicando la tecnología de IA a campos matemáticos complejos y promoviendo el desarrollo inteligente de la investigación matemática. (Fuente: GuillaumeLample, aiamblichus, BlackHC, qtnx_)

💼 Negocios

OpenAI y la Agencia Digital de Japón colaboran estratégicamente para promover herramientas de IA : OpenAI ha anunciado una asociación estratégica con la Agencia Digital de Japón, con el objetivo de promover herramientas de IA impulsadas por OpenAI entre los empleados del gobierno japonés. Esta medida marca un paso importante para OpenAI en la expansión de sus operaciones en el sector público global, con la expectativa de mejorar la eficiencia digital y el nivel de aplicación de la IA en las agencias gubernamentales, y promover la popularización de la tecnología de IA en los servicios públicos. (Fuente: gdb)

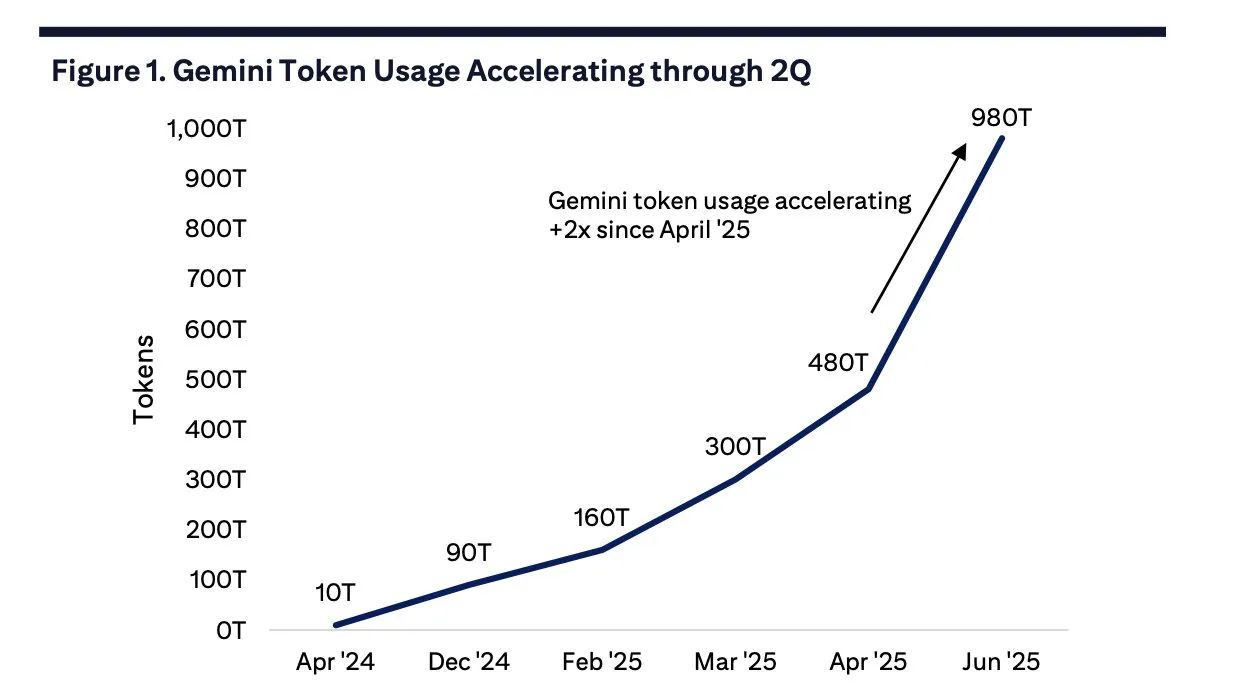

El uso mensual de tokens de Google Gemini se dispara, impulsando la demanda de Google Cloud : Hasta junio de 2025, el uso mensual de tokens de Google Gemini se ha disparado a 980 billones, un aumento significativo respecto a los 480 billones de abril. Este crecimiento ha impulsado directamente la demanda de Google Cloud, con un aumento del 28% en el número de nuevos clientes mes a mes y un incremento notable en el número de contratos grandes, lo que indica el fuerte impulso de Gemini en las aplicaciones de IA a nivel empresarial. (Fuente: scaling01)

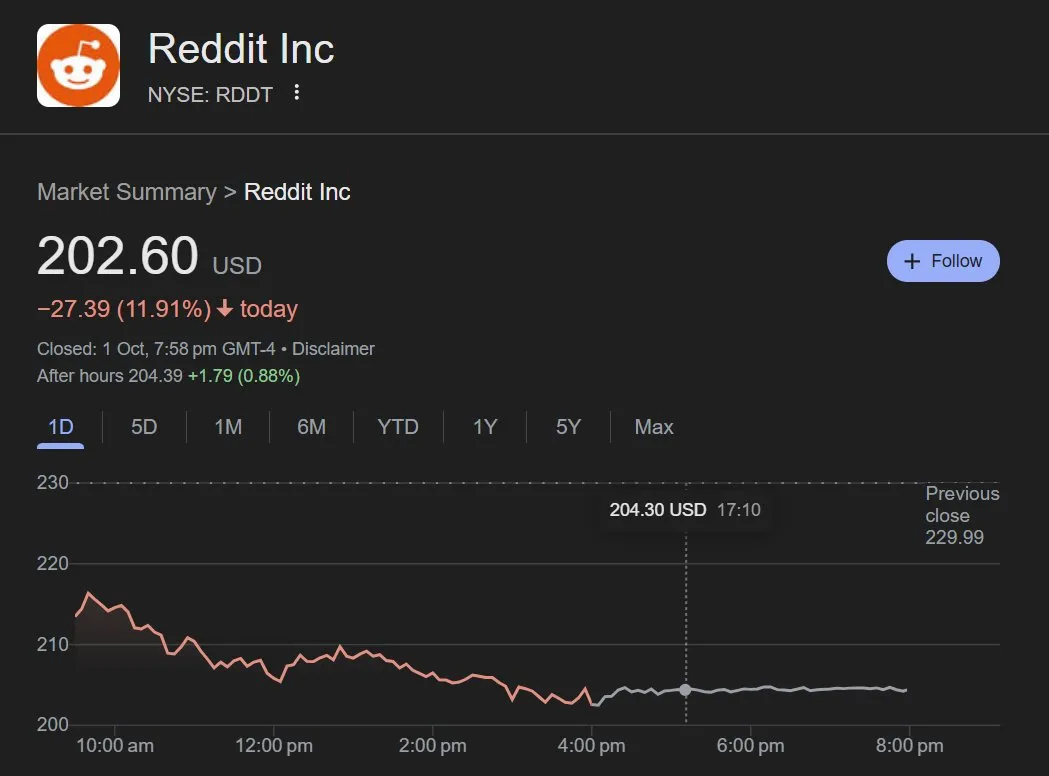

El uso de datos de Reddit por parte de ChatGPT se desploma, las acciones de Reddit caen : Los datos muestran que el uso de fuentes de datos de Reddit por parte de ChatGPT se desplomó de aproximadamente el 15% a principios de septiembre a casi el 5% a finales de mes, lo que provocó una caída del 12% en el precio de las acciones de Reddit. Esto ha impactado directamente el modelo de negocio de Reddit como proveedor de datos de IA y ha afectado sus fuentes de ingresos de alto margen, generando discusiones sobre la dependencia de datos de los modelos de IA y el valor de las plataformas de contenido. (Fuente: dotey)

🌟 Comunidad

La tecnología de generación de video Sora genera múltiples debates: del potencial creativo a la controversia por derechos de autor : La tecnología de generación de video Sora de OpenAI ha atraído una amplia atención. Los usuarios están llenos de expectativas sobre su potencial creativo, creyendo que puede lograr una creación del 100% de la imaginación, siendo utilizada para producir videos cortos, adaptaciones de guiones de películas, entre otros. Sin embargo, los críticos señalan que el contenido generado por Sora podría tener problemas de “spam” y graves riesgos de infracción de derechos de autor, como la generación de contenido protegido por derechos de autor. Además, se considera que la capacidad real de Sora podría estar sobrevalorada por el marketing, y su profundo impacto en las redes sociales y el ecosistema de creación de contenido aún está por verse. (Fuente: NickEMoran, inerati, colin_fraser, op7418, aiamblichus, scaling01, random_walker, Tim_Dettmers, Teknium1, colin_fraser, Reddit r/ChatGPT, Reddit r/ChatGPT, MIT Technology Review, MIT Technology Review)

Controversia y valor de la IA como herramienta de apoyo emocional : El debate sobre el uso de la IA (como ChatGPT) como compañero emocional o “terapeuta digital” es intenso. Los defensores creen que la IA puede ofrecer una escucha no crítica y siempre disponible, beneficiosa para quienes procesan pensamientos complejos o personas con neurodiversidad. Los críticos, por otro lado, temen que pueda llevar a una adicción a “sentirse bien”. La decisión de OpenAI de limitar la memoria del modelo se interpreta como una medida para evitar la dependencia excesiva de los usuarios. Esta discusión refleja las complejas emociones y consideraciones éticas de la sociedad sobre el papel de la IA en el ámbito de la salud mental. (Fuente: Reddit r/ChatGPT, MIT Technology Review)

Debate continuo sobre el impacto de la IA en el mercado laboral : Estudios del mercado laboral muestran que la IA no ha reemplazado masivamente puestos de trabajo humanos hasta ahora, pero el debate sobre su impacto en el empleo continúa. Algunos argumentan que los empleados despedidos debido a la IA ya eran redundantes, y que la IA automatiza tareas más que eliminar puestos. Al mismo tiempo, China supera con creces a EE. UU. en el despliegue de robots, lo que suscita preocupación sobre la futura competencia en la industria robótica y los cambios en la estructura del empleo. Estas discusiones reflejan la adaptación y las preocupaciones de la sociedad ante la transformación tecnológica de la IA. (Fuente: MIT Technology Review, Reddit r/MachineLearning, pmddomingos, zacharynado)

Controversia sobre la estrategia de IA de Apple y el futuro de las gafas inteligentes : La comunidad está decepcionada con el progreso de Apple en el campo de la IA, considerando que su “Apple Intelligence” carece de practicidad y que las funciones de Siri no han mejorado significativamente. Sin embargo, hay informes que indican que Apple está posponiendo la versión económica de Vision Pro para centrarse en el desarrollo de gafas inteligentes con IA, con el objetivo de competir con empresas como Meta. Esto sugiere que el enfoque de IA de Apple podría estar cambiando hacia una integración de hardware más futurista, pero aún es incierto si podrá ponerse al día rápidamente y satisfacer las expectativas de los usuarios. (Fuente: Reddit r/ArtificialInteligence, nptacek)

Experiencia de programación con LLM y personalización del modelo: Comparativa GPT-5 Codex vs. Sonnet 4.5 : La comunidad de desarrolladores debate acaloradamente el rendimiento de diferentes LLM en la asistencia a la programación. Se considera que GPT-5 Codex supera a Claude Sonnet 4.5 en la escritura y planificación de código conciso, ofreciendo mejores capacidades de diseño de sistemas. Al mismo tiempo, los usuarios han notado que la “personalidad” de Sonnet 4.5 se ha vuelto más “arrogante”, mostrando más refutaciones y fricciones, lo que refleja los cambios en el estilo de interacción del modelo después de la actualización y la percepción de los usuarios sobre la “personalidad” de los LLM. (Fuente: dejavucoder, dejavucoder, dejavucoder, Reddit r/ClaudeAI, Reddit r/ClaudeAI)

Perspectivas futuras de la IA: del optimismo a la preocupación por una burbuja en la industria : La comunidad tiene diversas opiniones sobre el futuro desarrollo de la IA. Optimistas como Jürgen Schmidhuber creen que la IA beneficiará a todos, logrando “AI For All” en lugar de ser controlada por unos pocos gigantes. Sin embargo, otros temen que la industria de la IA pueda enfrentar una “desaceleración” similar al mercado de semiconductores de finales de los años 60, donde, tras la popularización de la tecnología, no se vieron beneficios significativos a corto plazo, lo que llevó a un enfriamiento del mercado. Al mismo tiempo, la discusión sobre la valoración de OpenAI alcanzando el patrimonio neto de Elon Musk también refleja el entusiasmo del mercado y la preocupación por una posible burbuja en la IA. (Fuente: SchmidhuberAI, Dorialexander, scaling01)

Cambio estratégico de OpenAI: de AGI a la ‘Meta-ización’ del entretenimiento social : La discusión en la comunidad señala que la estrategia de OpenAI está pasando de la búsqueda de la Inteligencia Artificial General (AGI) al ámbito del entretenimiento social, lo que se evidencia especialmente en el código de “modo social” descubierto en las aplicaciones Sora 2 y ChatGPT. Este cambio ha generado preocupación, sugiriendo que OpenAI podría estar “Meta-izándose”, desviándose de su visión original de “curar el cáncer y resolver la física”, convirtiéndose en “esteroides para las redes sociales”, y potencialmente acarreando impactos negativos regulatorios y financieros. (Fuente: Yuchenj_UW, aiamblichus, 量子位)

💡 Otros

Cubo de basura inteligente con IA: identificación en tiempo real, clasificación precisa y servicios de datos : Un cubo de basura inteligente impulsado por IA, equipado con una cámara de 8MP y Nvidia AI, puede identificar y clasificar con precisión los residuos en tiempo real con una precisión superior al 95%. Los datos de cada escaneo se cargan en la nube, proporcionando información sobre patrones de gestión de residuos, impacto en la sostenibilidad, etc., para oficinas, espacios compartidos y otros, transformando una infraestructura “aburrida” en una ventaja competitiva impulsada por datos. (Fuente: Ronald_vanLoon)

Robot médico: una máquina que ayuda al personal sanitario a ponerse guantes : Se ha mostrado en redes sociales una máquina que ayuda al personal sanitario a ponerse guantes, destacando las aplicaciones innovadoras de la tecnología de la salud y las tecnologías emergentes para mejorar los flujos de trabajo médicos. Este tipo de equipos automatizados tienen como objetivo aumentar la eficiencia médica y los estándares de higiene, aliviando la carga diaria del personal sanitario. (Fuente: Ronald_vanLoon)

Tecnología AR/VR: ‘Modo ventana’ montado en la cabeza para una experiencia 3D sin gafas : Una nueva tecnología AR/VR ha demostrado un ‘modo ventana’ montado en la cabeza que, mediante la reproyección en tiempo real de la vista a través de una cámara frontal, permite a los usuarios experimentar escenas 3D realistas sin necesidad de usar gafas. Esto representa un avance importante en la tecnología de visualización inmersiva de AR/VR, con el potencial de ofrecer una experiencia de interacción más natural en campos como los juegos, la educación y la colaboración remota. (Fuente: ImazAngel)