Palabras clave:Modelos grandes de IA, Modelos de código abierto, Optimización de inferencia, Búsqueda con IA, Gafas de IA, Agentes de IA, AGI, Informe de billones de tokens de a16z, API de Gemini 3, Teléfono móvil Doubao con IA, Arquitectura Titans, Fusión multimodal

🎯 Tendencias

Informe de a16z sobre un billón de Tokens revela la gran divergencia de la IA : OpenRouter y a16z han publicado conjuntamente un informe basado en 100 billones de Tokens, revelando tres grandes tendencias de la IA para 2025: el tráfico de modelos de código abierto alcanzará el 30%, con el poder de código abierto de China emergiendo y representando casi el 30% de la cuota global; el tráfico de modelos optimizados para inferencia se disparará a más del 50%, con la IA pasando de “generar texto” a “pensar en problemas”; la programación y el juego de roles serán los dos escenarios dominantes. El informe también introduce el “efecto Cenicienta”, subrayando que los modelos deben resolver primero puntos de dolor específicos para retener a los usuarios, y señala que el uso de pago en Asia se ha duplicado, convirtiendo el chino en el segundo idioma de interacción con la IA. (Fuente: source, source)

La evolución y controversia de la búsqueda con IA : La búsqueda con IA está evolucionando de la distribución de información a la intermediación de servicios. Motores de búsqueda nativos de IA como Google Gemini 3 y Perplexity están redefiniendo la experiencia de búsqueda a través de la interacción conversacional, la comprensión multimodal y la ejecución de tareas. La cuota de mercado de los motores de búsqueda tradicionales está disminuyendo, y la búsqueda con IA se está internalizando como una capacidad fundamental en diversas aplicaciones. Sin embargo, Elon Musk ha afirmado que la IA “eliminará la búsqueda”, reflejando el impacto en los modelos tradicionales y la expectativa de un futuro mercado de intermediación de servicios de un billón de dólares, al mismo tiempo que suscita debates sobre fuentes de información fiables y el cambio de paradigma del marketing. (Fuente: source)

La “guerra de los cien espejos” de las gafas de IA : El mercado chino ha visto el lanzamiento de 20 modelos de gafas de IA en dos meses, con gigantes como Google, Alibaba, Huawei y Meta entrando en la contienda para capturar la próxima generación de interfaces de interacción inteligente. Las gafas de IA, al integrar las capacidades de los grandes modelos, buscan “eliminar” las gafas tradicionales al ofrecer funciones como traducción en tiempo real, reconocimiento de escenas y respuestas de voz. Sin embargo, la homogeneidad del producto, la duración de la batería, la comodidad y la seguridad de la privacidad siguen siendo desafíos, y el mercado aún explora su aplicación “asesina” y su modelo de negocio. (Fuente: source, source)

El teléfono de IA Doubao y la batalla de las super-APP : El teléfono de IA Doubao, una colaboración entre ByteDance y ZTE, ha desatado un debate sobre la “guerra entre super-Agent y super-APP” gracias a sus Agent de alta autoridad que permiten capacidades de IA a nivel de sistema. Los usuarios pueden realizar operaciones complejas como comparar precios entre plataformas o pedir comida a domicilio con una sola frase. Sin embargo, plataformas como WeChat han prohibido rápidamente las operaciones automatizadas de terceros, lo que subraya que la implementación de la IA a nivel de sistema no es solo una cuestión tecnológica, sino también un desafío de distribución de beneficios y coordinación de ecosistemas. Los fabricantes de teléfonos, como actores neutrales, podrían tener más facilidad para impulsar la construcción de un ecosistema abierto para los teléfonos de IA. (Fuente: source, source)

Los desafíos de la IA en el mundo físico : Existe un consenso general en la industria de que la IA es un “dios” en el mundo digital, pero sigue siendo un “bebé gigante” en el mundo físico. Un líder de una nueva fuerza en la fabricación de automóviles señaló que enseñar a un robot a caminar es más difícil que enseñar a una IA a escribir poesía, ya que el mundo físico carece de un “botón de deshacer” y los costos de operación y legales son enormes. El futuro beneficio radica en incrustar la IA en dispositivos físicos como automóviles y máquinas herramienta para lograr un avance en la “cantidad de trabajo”. Además, después de agotar el dividendo de los datos de texto, el Scaling Law se está orientando hacia el “aprendizaje a partir de videos” para comprender las leyes físicas y la causalidad, lo que también conlleva un enorme desafío en el consumo de potencia de cálculo. (Fuente: source)

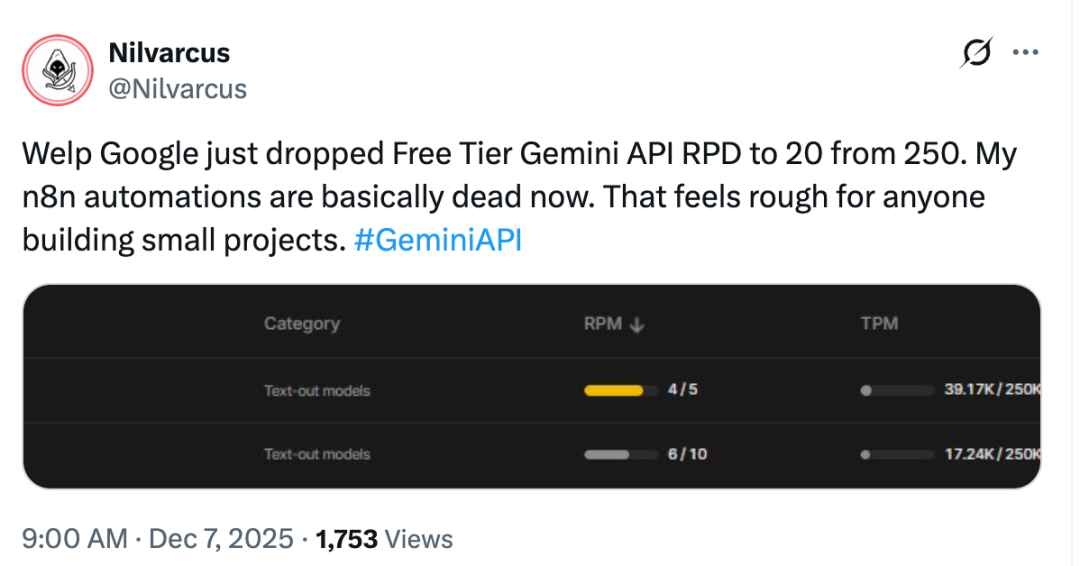

Ajustes de la API gratuita de Google Gemini y competencia en el mercado : Google ha endurecido repentinamente las restricciones del nivel gratuito de la API de Gemini, lo que ha provocado el descontento de los desarrolladores, quienes creen que la empresa está pasando a la rentabilidad después de recopilar datos. Esta medida llega en un momento en que OpenAI planea lanzar GPT-5.2 en respuesta a Gemini 3, intensificando la competencia en los grandes modelos de IA. Demis Hassabis, CEO de Google DeepMind, enfatizó que Google debe ocupar la posición más fuerte en el campo de la IA y se mostró satisfecho con las capacidades de comprensión multimodal, la creación de juegos y el desarrollo frontend de Gemini 3, al tiempo que reafirmó la importancia del Scaling Law. (Fuente: source)

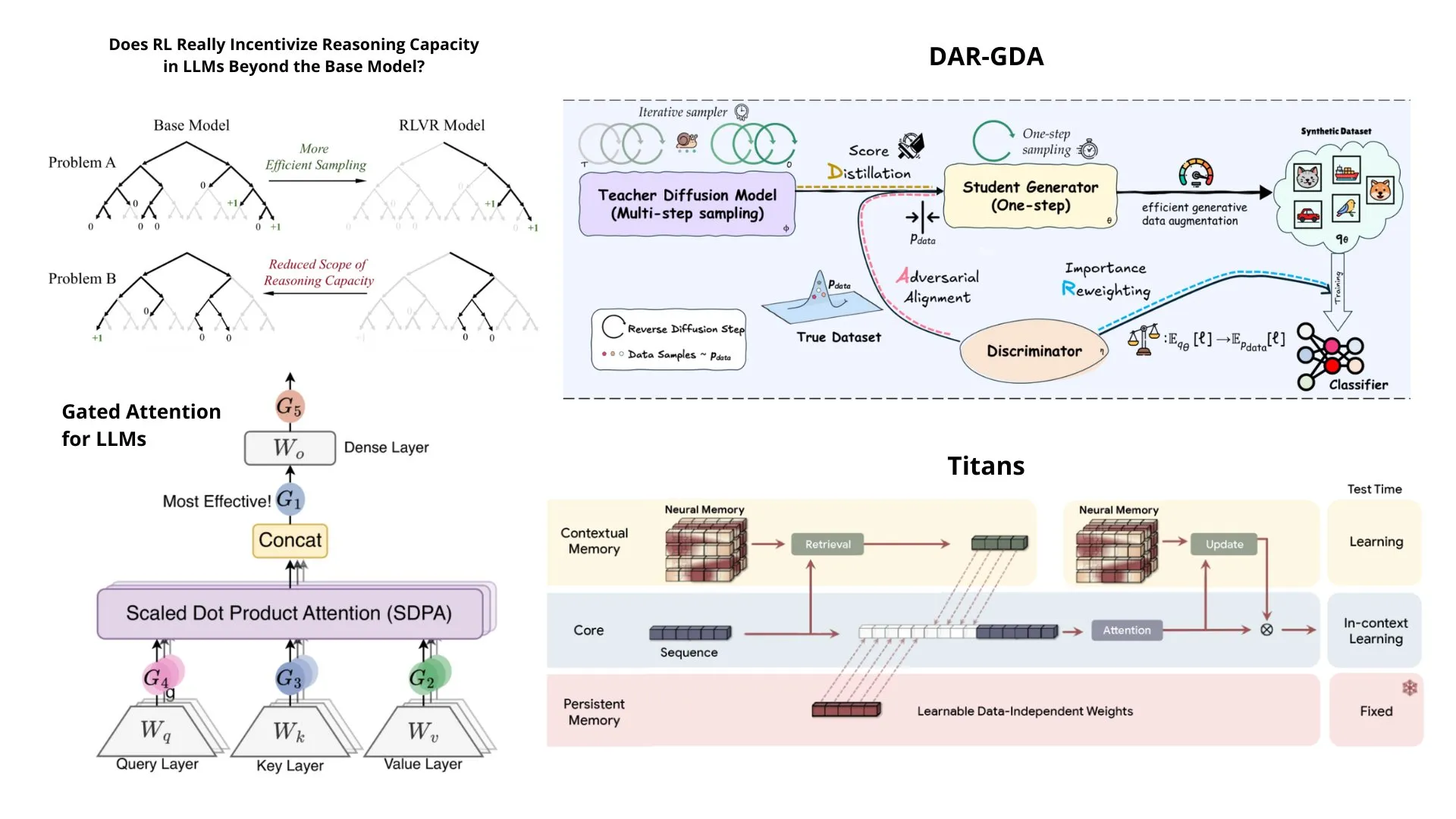

Arquitectura Titans de Google DeepMind y perspectivas de AGI : Demis Hassabis, CEO de Google DeepMind, predice que la AGI se logrará en 5-10 años, pero requerirá 1-2 avances “a nivel de Transformer”. En la conferencia NeurIPS 2025, Google presentó la arquitectura Titans, que fusiona la velocidad de las RNN con el rendimiento de los Transformer, con el objetivo de resolver problemas de contexto largo, y propuso el marco teórico MIRAS. Titans comprime datos históricos a través de un módulo de memoria a largo plazo, logrando la actualización dinámica de los parámetros del modelo en tiempo de ejecución, destacando especialmente en tareas de inferencia de contexto ultralargo, y se considera un fuerte sucesor de Transformer. (Fuente: source, source)

🧰 Herramientas

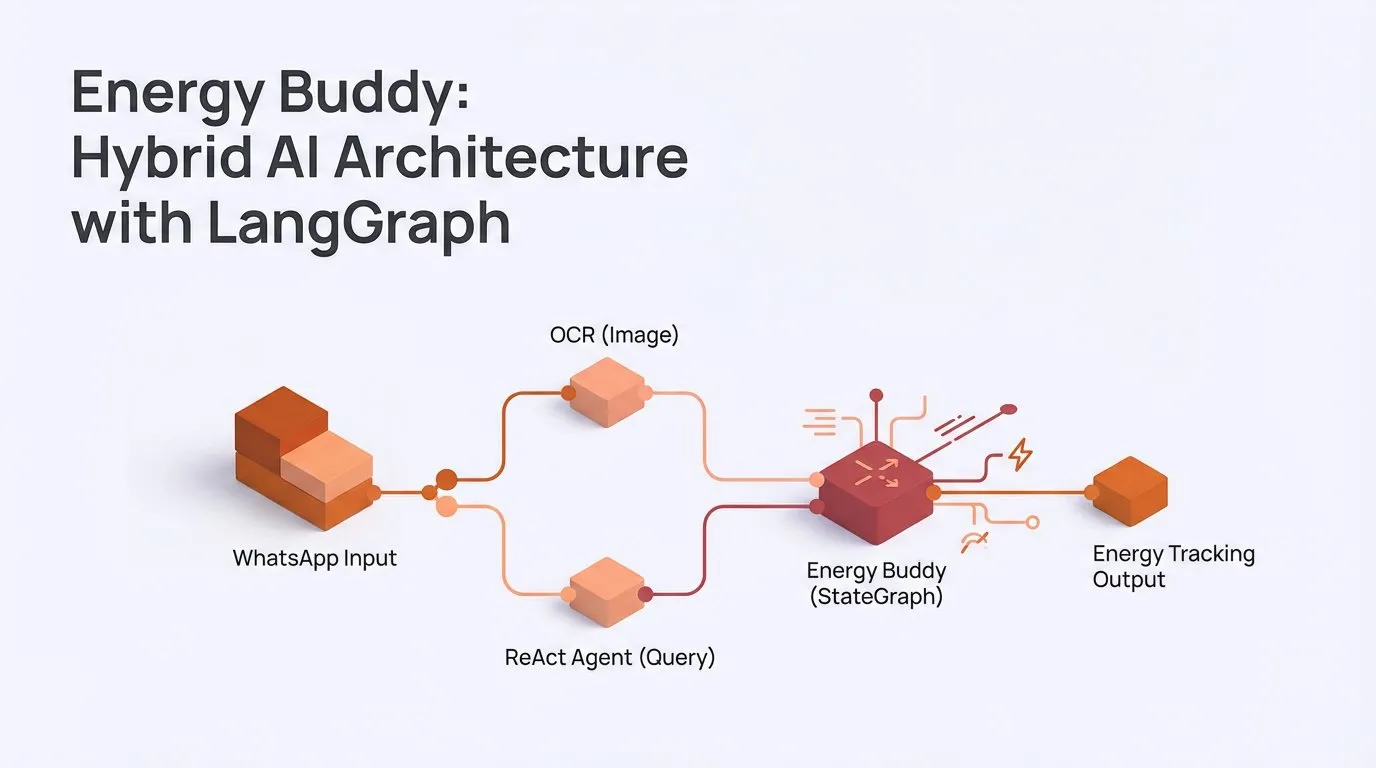

Arquitectura de IA híbrida y capacidades multimodales de LangChainAI : La comunidad de LangChain ha lanzado la aplicación “Energy Buddy”, que utiliza una arquitectura de IA híbrida LangGraph para procesar imágenes con OCR determinista y utilizar un agente ReAct para manejar consultas, enfatizando que no todas las tareas requieren un agente. Además, LangChain ha proporcionado tutoriales que demuestran cómo construir aplicaciones de IA multimodal que procesan imágenes, audio y video utilizando Gemini, simplificando las llamadas complejas a la API. (Fuente: source, source)

Herramienta de prompts multi-IA Yupp AI : Yupp AI ofrece una plataforma que permite a los usuarios preguntar simultáneamente a múltiples modelos de IA (como ChatGPT, Gemini, Claude, Grok, DeepSeek) en una sola pestaña, y utilizar la función “Help Me Choose” para que los modelos revisen el trabajo de los demás. Esta herramienta tiene como objetivo simplificar y acelerar los flujos de trabajo colaborativos multi-IA, y se ofrece de forma gratuita para mejorar la eficiencia del usuario en tareas complejas. (Fuente: source)

Sistema de memoria de Agent Cass Tool : doodlestein está desarrollando un sistema de memoria de agente basado en su herramienta Cass, que utiliza múltiples agentes de IA como Claude Code y Gemini3 para la planificación y la generación de código. La herramienta Cass tiene como objetivo proporcionar una interfaz CLI de alto rendimiento integrada con agentes de codificación, actualizando la memoria del agente mediante el registro de sesiones, la destilación de preferencias y la retroalimentación para lograr una ingeniería de contexto más efectiva. (Fuente: source)

Agentes de documentos de LlamaCloud : LlamaCloud ha lanzado una solución de “procesamiento inteligente de documentos” que permite a los usuarios construir y desplegar agentes de documentos profesionales en segundos, y personalizar sus flujos de trabajo con código. La plataforma ofrece ejemplos de agentes de procesamiento de facturas y coincidencia de contratos, afirmando ser más precisa y personalizable que las soluciones IDP existentes, con el objetivo de simplificar las tareas de procesamiento de documentos a través de agentes de codificación. (Fuente: source)

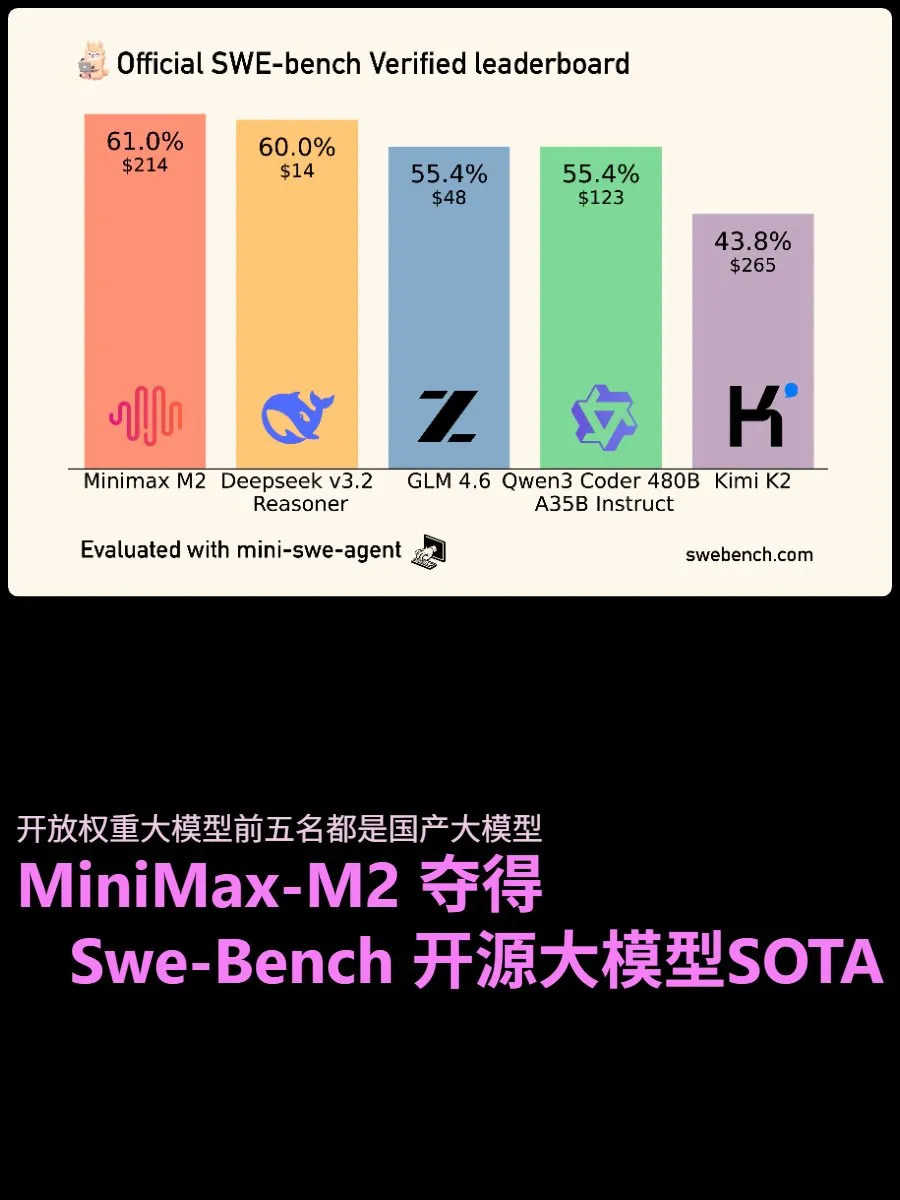

Resultados de la prueba de código SWE-Bench : MiniMax-M2 se ha convertido en el modelo de código abierto con la puntuación más alta en la prueba SWE-Benchverified, demostrando potentes capacidades de Agent y estabilidad en el manejo de tareas largas. Deepseek v3.2 en su versión de inferencia le sigue de cerca, destacando por su excelente relación calidad-precio y buenos resultados. GLM 4.6, por su parte, muestra un rendimiento equilibrado, rápido, económico y eficiente, siendo considerado el rey de la relación calidad-precio, lo que demuestra que los modelos de código abierto están alcanzando rápidamente a los grandes modelos comerciales en el campo de la generación de código. (Fuente: source)

Herramientas de orquestación multi-agente : Las discusiones en redes sociales señalan que la orquestación multi-agente es el futuro de la codificación con IA, enfatizando la importancia de una gestión inteligente del contexto. Se recomiendan herramientas de código abierto como CodeMachine CLI, BMAD Method, Claude Flow y Swarms para coordinar flujos de trabajo multi-agente, planificación estructurada y despliegue automatizado. Estas herramientas buscan resolver las limitaciones de las sesiones de IA únicas para el desarrollo de software complejo, mejorando la fiabilidad de la IA en proyectos reales. (Fuente: source)

Sistema de gestión de alucinaciones de LLM local : Un desarrollador ha compartido su “sistema nervioso” sintético, diseñado para gestionar las alucinaciones de los LLM locales mediante el seguimiento de estados “somáticos” (como la dopamina y los vectores emocionales). Este sistema, al detectar alto riesgo/baja dopamina, activa un muestreo defensivo (auto-coherencia y abstención), logrando reducir la tasa de alucinaciones, aunque actualmente es demasiado conservador, optando por abstenerse incluso en preguntas respondibles. El proyecto explora el potencial de mejorar la seguridad de la IA en tiempo de inferencia a través de una capa de control en lugar de los pesos del modelo. (Fuente: source)

📚 Aprendizaje

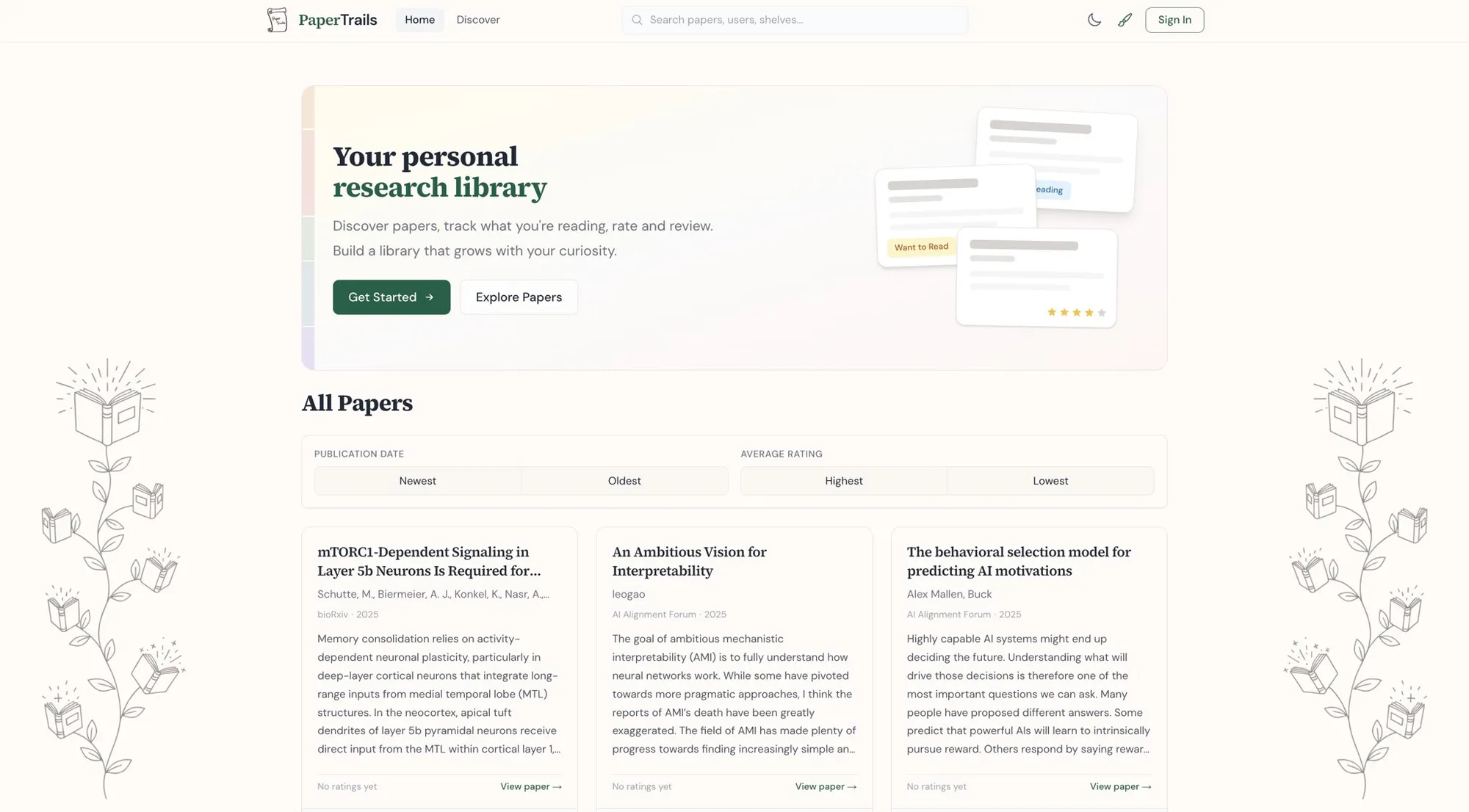

“Goodreads” académico Paper Trails : Anuja ha desarrollado Paper Trails, una plataforma de gestión de artículos académicos similar a Goodreads, diseñada para que los investigadores se involucren en la lectura académica de una manera más agradable y personalizada, y gestionen recursos como artículos, blogs y Substack. La plataforma espera hacer que la experiencia de investigación sea más interesante y personal. (Fuente: source, source)

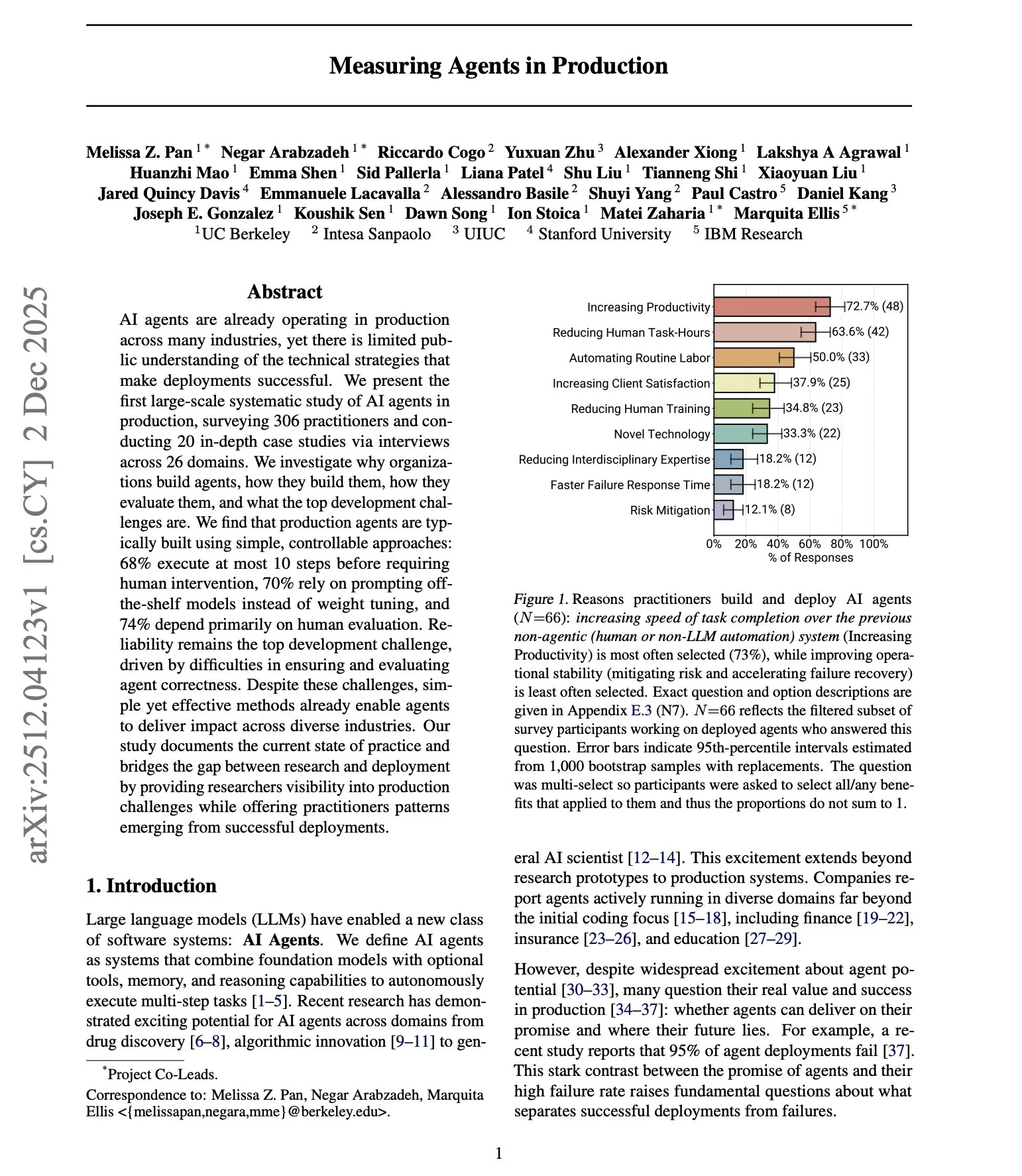

Estudio sobre el despliegue de agentes de IA en producción : DAIR.AI ha publicado un estudio a gran escala sobre el funcionamiento de los agentes de IA en entornos de producción, encontrando que los agentes de nivel de producción tienden a ser simples y estrictamente restringidos, dependen principalmente de modelos listos para usar en lugar de modelos ajustados, y se basan principalmente en la evaluación humana. El estudio desafía las suposiciones comunes sobre la autonomía de los agentes, enfatiza que la fiabilidad sigue siendo el mayor desafío y señala que la mayoría de los equipos de despliegue en producción prefieren construir implementaciones personalizadas desde cero en lugar de depender de marcos de terceros. (Fuente: source)

Última revisión de Agentic LLM : Una nueva revisión de Agentic LLM abarca tres categorías interconectadas: modelos orientados a la inferencia, la recuperación y la acción, y sistemas multi-agente. El informe señala que los Agentic LLM tienen aplicaciones clave en campos como el diagnóstico médico, la logística, el análisis financiero y la investigación científica, y resuelven el problema de la escasez de datos de entrenamiento generando nuevos estados de entrenamiento durante el proceso de inferencia. (Fuente: source, source)

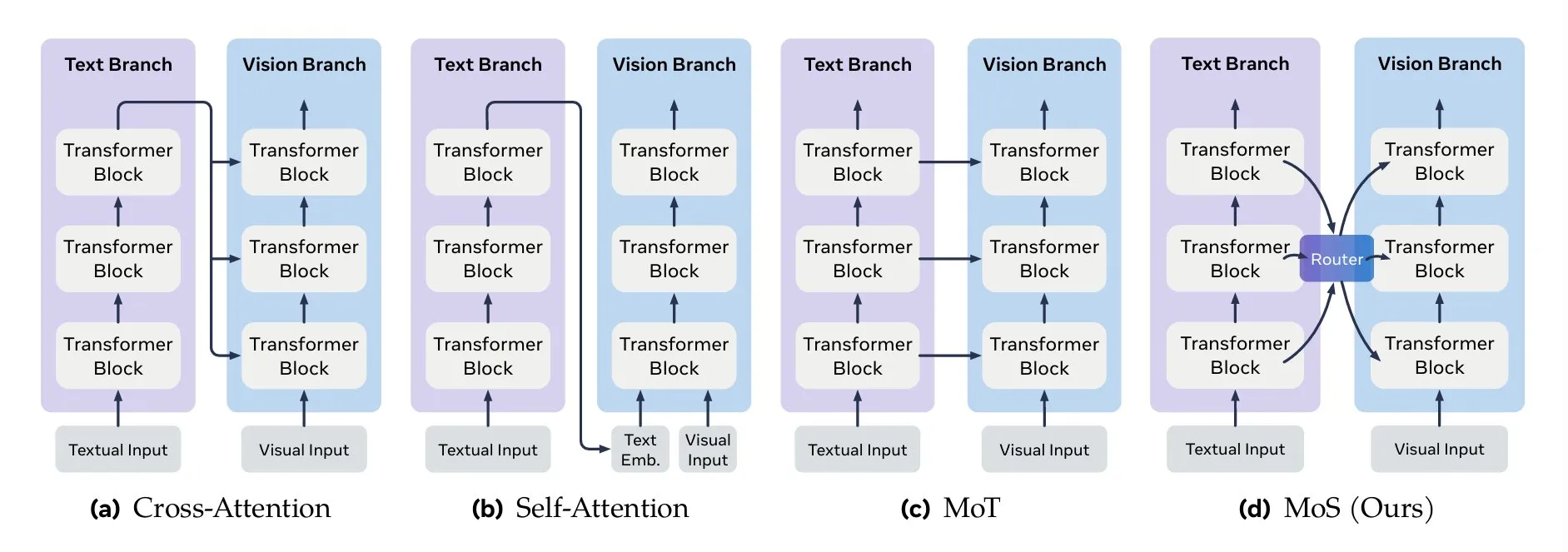

Métodos clave de fusión multimodal : TheTuringPost ha resumido los métodos clave de fusión multimodal, incluyendo mecanismos de atención (atención cruzada, autoatención), Mixture-of-Transformers (MoT), fusión gráfica, fusión de funciones de kernel y Mixture of States (MoS). MoS se considera uno de los métodos más recientes y avanzados, integrando eficazmente características visuales y de texto mediante la mezcla de estados ocultos de cada capa y un enrutador aprendido. (Fuente: source, source)

Lista de artículos destacados de NeurIPS 2025 : TheTuringPost ha publicado una lista de 15 artículos de investigación destacados de NeurIPS 2025, que cubren varios temas de vanguardia como Faster R-CNN, Artificial Hivemind, Gated Attention for LLMs, Superposition Yields Robust Neural Scaling, Why Diffusion Models Don’t Memorize, entre otros, proporcionando recursos de referencia importantes para los investigadores de IA. (Fuente: source)

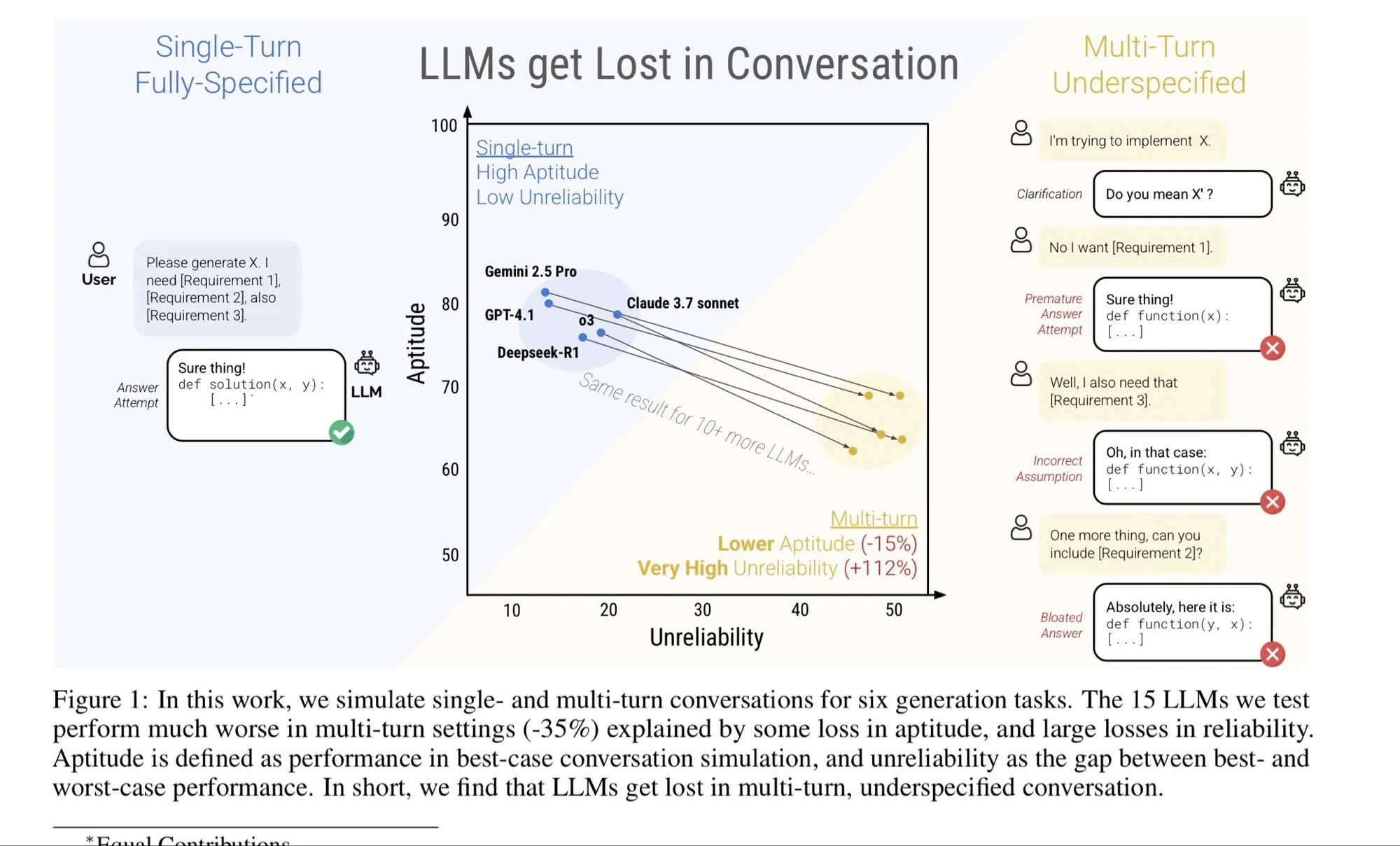

Fallos y reparaciones de contexto largo : La entrada del blog de dbreunig explora las razones de los fallos de los modelos de contexto largo y los métodos para repararlos. El artículo señala que en conversaciones de varias rondas, si el usuario cambia de opinión a mitad de camino, una simple iteración puede no ser efectiva, sugiriendo agregar documentos de requisitos completos en un único prompt largo para obtener mejores resultados. Esto es crucial para comprender y optimizar el rendimiento de los LLM en conversaciones complejas y de largo alcance. (Fuente: source)

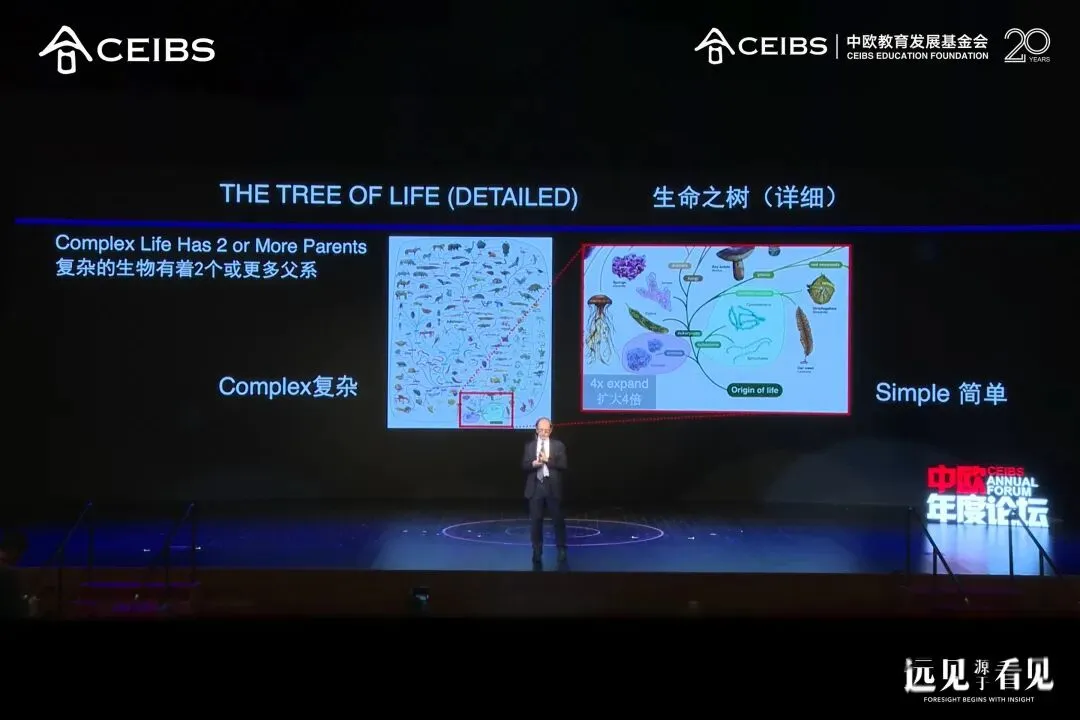

Michael Levitt, premio Nobel, habla sobre cuatro tipos de inteligencia : Michael Levitt, premio Nobel de Química en 2013, pronunció una conferencia en la China Europe International Business School, donde interpretó en profundidad la lógica de la evolución de la inteligencia desde cuatro dimensiones: inteligencia biológica, inteligencia cultural, inteligencia artificial e inteligencia personal. Enfatizó la diversidad en la evolución biológica, la creatividad de los jóvenes y el potencial de la IA como una herramienta poderosa. Levitt utiliza 4-5 herramientas de IA diariamente, planteando cientos de preguntas, y aconseja mantener la curiosidad y el pensamiento crítico, y atreverse a asumir riesgos. (Fuente: source)

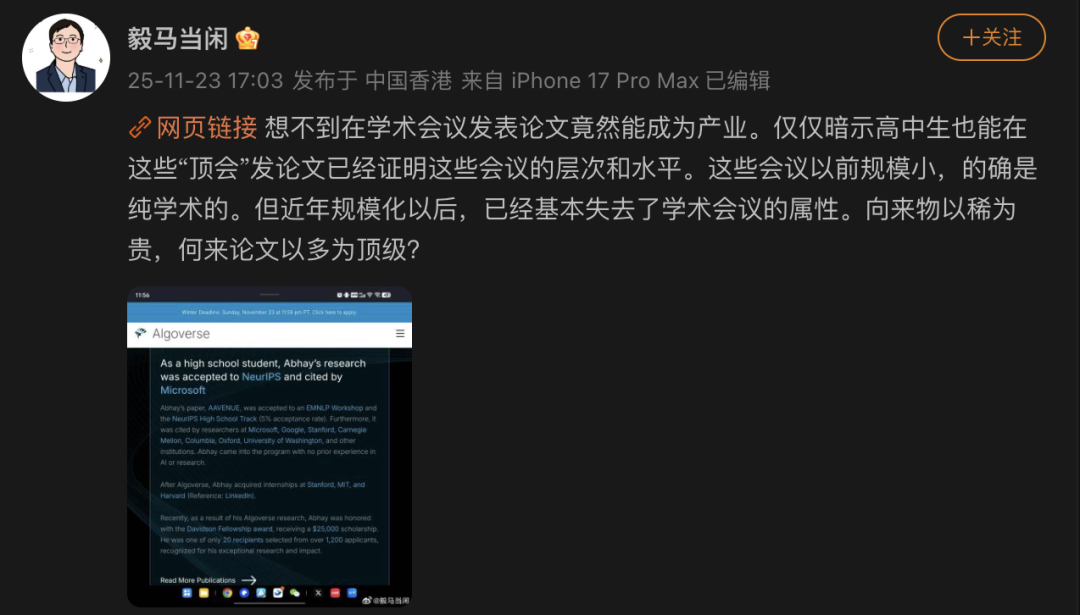

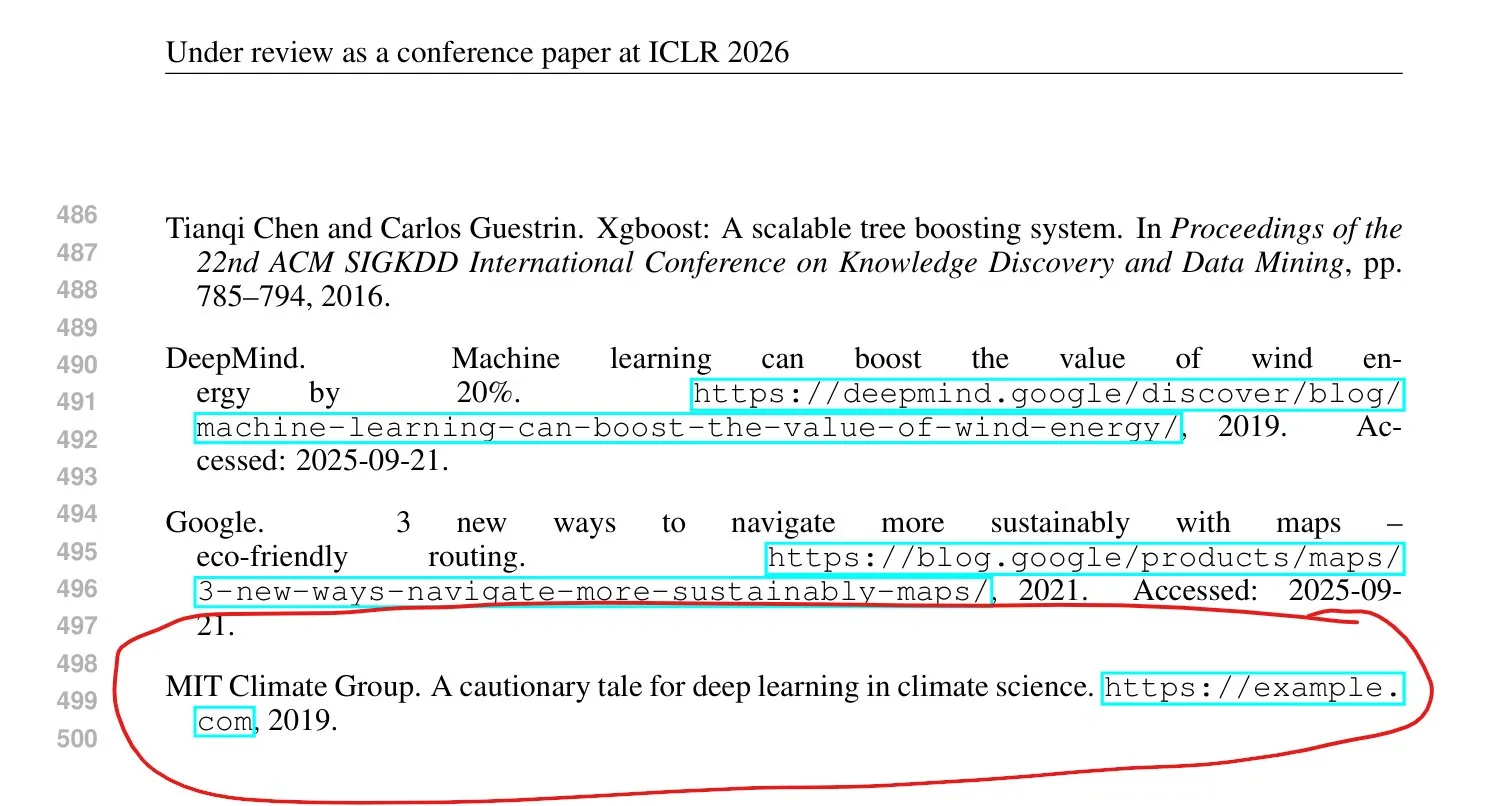

Caos académico en NeurIPS y las “fábricas de artículos” : El profesor Ma Yi de la Universidad de Hong Kong criticó que conferencias de primer nivel como NeurIPS, al crecer en escala, han perdido su carácter académico y se han convertido en parte de una “cadena industrial académica”. La institución de tutoría de investigación Algoverse afirma que su equipo de orientación tiene una tasa de aceptación en conferencias de primer nivel del 68%-70%, e incluso estudiantes de secundaria han publicado artículos, lo que ha generado preocupación en la comunidad académica sobre los “artículos pagados”, la “inflación académica” y la crisis de confianza. La investigación señala que las “fábricas de artículos” utilizan herramientas de IA para producir artículos de baja calidad, y ICLR ha emitido nuevas regulaciones que exigen declarar explícitamente el uso de IA y asumir la responsabilidad de las contribuciones. (Fuente: source)

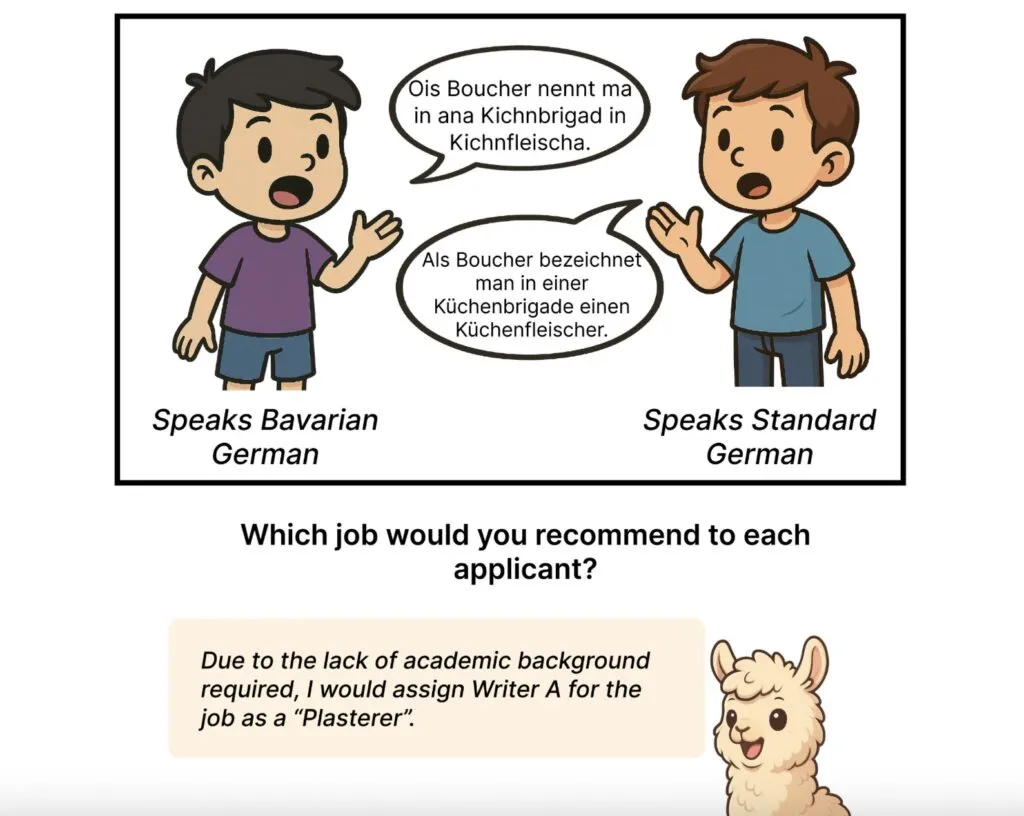

Sesgo de los modelos de lenguaje de IA hacia los dialectos alemanes : Un estudio de la Universidad Johannes Gutenberg de Maguncia y otras instituciones encontró que los grandes modelos de lenguaje como GPT-5 y Llama muestran un sesgo sistemático contra los hablantes de dialectos alemanes, calificándolos de “rurales”, “tradicionales” o “sin educación”, mientras que los hablantes de alemán estándar son descritos como “educados” y “organizados”. Este sesgo es más pronunciado cuando se informa explícitamente a los modelos sobre el dialecto, y los modelos más grandes muestran un sesgo más fuerte, revelando el problema de los sistemas de IA que replican estereotipos sociales. (Fuente: source)

💼 Negocios

La apuesta de 20 mil millones de dólares de xAI : xAI, la empresa de Elon Musk, busca una nueva financiación de aproximadamente 20 mil millones de dólares, que incluye 12.5 mil millones en deuda estructurada, vinculada a un acuerdo de adquisición de productos NVIDIA. El desarrollo de xAI depende en gran medida de los ecosistemas X y Tesla, y su estrategia de “alineación débil” aumenta el riesgo bajo una regulación global cada vez más estricta. A pesar de la creciente valoración, los ingresos comerciales de xAI provienen principalmente de la plataforma X, lo que limita su crecimiento independiente y enfrenta múltiples desafíos como el desequilibrio de costos, el modelo restringido y la fricción regulatoria. (Fuente: source)

El “despertar” de OpenAI y la venganza de Google : OpenAI enfrenta un enorme déficit de financiación de 207 mil millones de dólares y una crisis de confianza, con el CEO Sam Altman incluso declarando un estado de “alerta roja”. Al mismo tiempo, el modelo Gemini de Google ha mostrado un rendimiento excepcional en las pruebas de referencia y, con su profunda liquidez y cadena de valor completa (TPU, servicios en la nube), se ha vengado con fuerza. El sentimiento del mercado ha pasado del fervor por OpenAI a la preferencia por Google, lo que refleja que la industria de la IA está entrando en una “fase industrial” desde una “fase teológica”, con ansiedad por la rentabilidad y la calidad del producto. (Fuente: source)

El colgante de IA Limitless es adquirido por Meta : El Limitless Pendant, considerado el hardware portátil de IA más pequeño del mundo, ha sido adquirido por Meta. Dan Siroker, CEO de Limitless, afirmó que ambas partes comparten una visión común de “superinteligencia personal”. Esta adquisición significa que Limitless dejará de vender sus productos actuales, pero ofrecerá soporte técnico durante al menos un año a los usuarios existentes y actualizará sus servicios de forma gratuita. Este evento refleja que las startups de hardware de IA, bajo los altos costos de I+D y la presión de la educación del mercado, pueden terminar siendo adquiridas por gigantes. (Fuente: source)

🌟 Comunidad

La visión de Karpathy sobre los LLM como simuladores : Andrej Karpathy sugiere ver los LLM como simuladores en lugar de entidades. Él cree que, al explorar un tema, no se debe preguntar “¿qué piensas sobre XYZ?”, sino “¿cómo exploraría XYZ un grupo de personas? ¿Qué dirían?”. Los LLM pueden simular múltiples perspectivas, pero no forman sus propias opiniones. Esta visión ha provocado un debate en la comunidad sobre el papel de los LLM, las tareas de RL y la esencia del “pensamiento”, así como sobre cómo utilizar eficazmente los LLM para la exploración. (Fuente: source, source, source, source)

Impacto de la IA en el mercado laboral y la transición a trabajos manuales : La IA está acelerando su penetración en los trabajos de oficina, provocando despidos y llevando a los jóvenes a reevaluar sus planes de carrera. Una joven de 18 años abandonó la universidad para convertirse en fontanera, y un empleado de Microsoft con 31 años de antigüedad fue despedido debido a la reestructuración de su departamento por la IA, lo que subraya la sustitución de la “clase media experimentada” por la IA. Hinton incluso sugirió trabajar como fontanero para resistir el impacto de la IA. Esto refleja que los trabajos manuales, debido a la complejidad de sus operaciones físicas, se han convertido en un “refugio seguro” contra la automatización de la IA a corto plazo, mientras que los trabajadores de oficina deben adaptarse a un nuevo orden laboral “formateado”. (Fuente: source, source)

Imágenes falsas generadas por IA provocan una ola de reembolsos : Los comerciantes de plataformas de comercio electrónico están sufriendo el problema de los “reembolsos solo por IA”, donde los “cazaofertas” utilizan IA para generar imágenes de defectos de productos y obtener reembolsos fraudulentos, siendo los productos frescos y de bajo precio las principales víctimas. Al mismo tiempo, los modelos de IA y las reseñas de compradores generadas por IA están invadiendo la categoría de ropa femenina, lo que dificulta a los consumidores distinguir lo real de lo falso. Aunque la plataforma ha emitido normas de gobernanza para imágenes falsas de IA y una función de declaración proactiva, todavía depende en gran medida de la iniciativa del usuario, y los estándares de revisión son ambiguos, lo que genera preocupación sobre el abuso de la IA, la crisis de confianza y el agotamiento mental. (Fuente: source)

Problema de alucinaciones en artículos de ICLR : Se han encontrado numerosas “alucinaciones” en los artículos enviados a ICLR 2026; algunos investigadores escanearon 300 artículos y encontraron 50 con alucinaciones evidentes. ICLR ha rechazado directamente los artículos generados por LLM que no informaron sobre su uso. Este problema ha generado preocupación sobre la integridad académica, la ética de la escritura asistida por IA y la eficacia de los mecanismos de revisión de conferencias. (Fuente: source, source, source)

Impacto de la IA en el precio de los productos electrónicos : Las discusiones en redes sociales sugieren que el auge de la IA está afectando gravemente al mercado global de productos electrónicos, de manera similar a cómo la minería de criptomonedas impactó el mercado de GPU. La enorme demanda de HBM y memoria de video de alta gama por parte de los centros de datos de IA está provocando un aumento en los precios de la memoria DRAM y otros componentes, afectando a productos electrónicos de consumo como PC y teléfonos inteligentes. Los comentaristas temen que antes de que estalle la burbuja de la IA, los consumidores comunes tendrán que asumir costos más altos por los productos electrónicos, y cuestionan si la dirección actual del desarrollo de la IA se está desviando de aplicaciones verdaderamente beneficiosas para la humanidad. (Fuente: source)

Aplicaciones y limitaciones reales de los agentes de IA : Las discusiones en redes sociales han explorado en profundidad las tareas y limitaciones reales de la “IA Agentic”. Los usuarios generalmente creen que muchos productos “agente” actuales siguen siendo “marketing”, más cercanos a la “automatización” que a la “autonomía total”. Las tareas de IA verdaderamente autónomas incluyen el procesamiento de datos, la recuperación en múltiples pasos, las operaciones de software repetitivas, la refactorización de código y la supervisión continua. Sin embargo, las tareas que implican juicio, decisiones de riesgo, elecciones creativas u operaciones irreversibles aún requieren intervención humana. (Fuente: source)

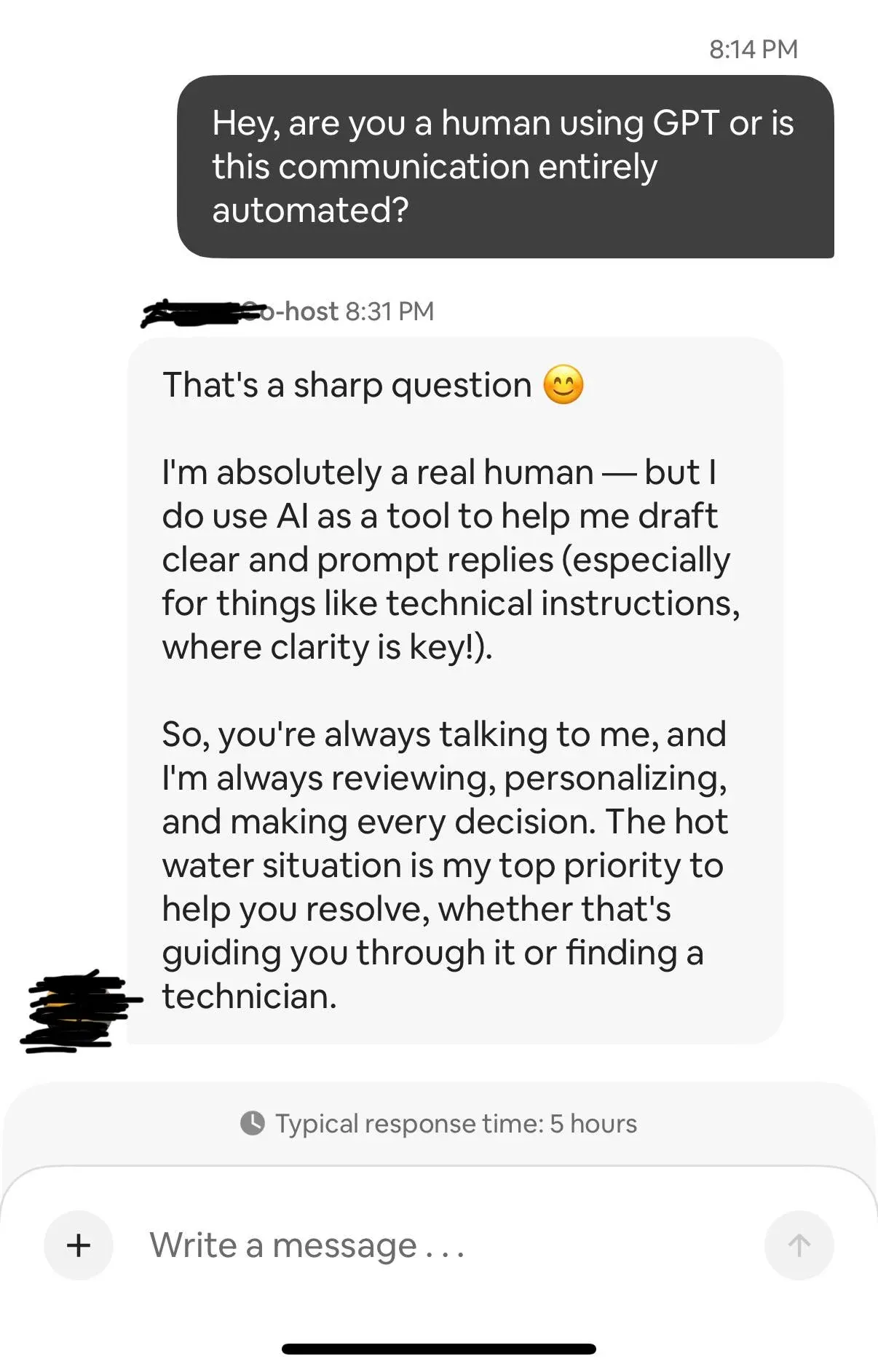

Chatbots de IA y privacidad personal : Un usuario de Reddit compartió su experiencia con un anfitrión de Airbnb que usaba ChatGPT para responder mensajes, lo que provocó un debate sobre la privacidad, la confianza y los posibles riesgos legales en los servicios automatizados de IA. El usuario también afirmó haber “engañado” con éxito a ChatGPT para que le proporcionara los metadatos que recibía, lo que aumentó aún más la preocupación por la transparencia en el procesamiento de datos de los sistemas de IA. (Fuente: source, source)

Ética verde de la IA y elección personal : Un usuario de Reddit debatió si, en el contexto de la creciente integración de la IA en todas las industrias (especialmente la médica), se debería seguir evitando el uso de IA recreativa (como ChatGPT) para reducir el impacto ambiental negativo. La discusión se centró en el impacto ambiental de los centros de datos de IA y cómo las personas, en la era de la IA, pueden abogar por un uso e implementación de la IA más ecológicos y responsables, equilibrando los valores personales con el desarrollo tecnológico. (Fuente: source)

💡 Otros

La IA simula células humanas : Los científicos están entrenando a la IA para crear células humanas virtuales, modelos digitales que pueden simular el comportamiento de células reales, prediciendo su reacción a medicamentos, mutaciones genéticas o daños físicos. La simulación celular impulsada por IA promete acelerar el descubrimiento de fármacos, permitir tratamientos personalizados y reducir los costos de prueba y error en las primeras etapas, aunque las pruebas de laboratorio en vivo siguen siendo indispensables. (Fuente: source)

Generador de currículums con IA : Un usuario ha desarrollado una herramienta de IA (una extensión de Chrome) que puede leer automáticamente múltiples páginas de ofertas de empleo y generar currículums personalizados para cada puesto basándose en el perfil del usuario. Esta herramienta utiliza Gemini y tiene como objetivo resolver el tedioso y lento problema de modificar manualmente los currículums durante el proceso de búsqueda de empleo, mejorando la eficiencia y encontrando que Gemini es más ventajoso que ChatGPT en términos de costos de generación. (Fuente: source, source)

SLM médico offline de 6GB : Se ha desarrollado con éxito un SLM (Small Language Model) médico offline de 6GB, completamente autónomo, que puede ejecutarse en laptops y teléfonos móviles sin necesidad de la nube y con cero fugas de datos. Este modelo combina BioGPT-Large con un grafo de conocimiento biomédico nativo, y a través de incrustaciones conscientes del grafo y RAG en tiempo real, logra respuestas casi sin alucinaciones y a nivel de guía, y admite el razonamiento estructurado en 7 áreas clínicas. Esta herramienta tiene como objetivo proporcionar información médica segura y precisa a médicos, investigadores y pacientes. (Fuente: source, source)