Palabras clave:Industria de la IA, Corrección de la exageración, GPT-5, AGI, Seguridad de la IA, Programación con IA, Agentes de IA, Modelos multimodales, Ciencia de materiales con IA, Optimización de razonamiento en LLM, IA encarnada, Pruebas de referencia de IA, Generación de presentaciones impulsada por IA

🔥 Foco

“Corrección de la euforia” de la industria de la IA y escrutinio de la realidad: En 2025, la industria de la IA entra en una fase de “corrección de la euforia”, y las expectativas del mercado sobre la IA están volviendo a la racionalidad, dejando de ser vistas como una “panacea”. Líderes de la industria como Sam Altman reconocen la existencia de una burbuja de la IA, especialmente en las valoraciones de startups y las enormes inversiones en la construcción de centros de datos. Al mismo tiempo, el lanzamiento de GPT-5 no cumplió con las expectativas, lo que provocó debates sobre los cuellos de botella en el desarrollo de LLM. Los expertos piden una reevaluación de las capacidades reales de la IA, distinguiendo entre las “demostraciones espectaculares” de la IA generativa y los avances reales de la IA predictiva en campos como la medicina y la ciencia, enfatizando que el valor de la IA reside en su fiabilidad y sostenibilidad, no en la búsqueda ciega de AGI. (Fuente: MIT Technology Review, MIT Technology Review, MIT Technology Review, MIT Technology Review, MIT Technology Review)

Avances y desafíos de la IA en la ciencia de materiales: La IA se está aplicando para acelerar el descubrimiento de nuevos materiales, y se espera que, a través de agentes de IA que planifican, ejecutan e interpretan experimentos, el proceso de descubrimiento se reduzca de décadas a unos pocos años. Empresas como Lila Sciences y Periodic Labs están construyendo laboratorios automatizados impulsados por IA para resolver los cuellos de botella tradicionales en la síntesis y prueba de materiales. Aunque DeepMind afirmó haber descubierto “millones de nuevos materiales”, su novedad y utilidad reales han sido cuestionadas, lo que subraya la brecha entre la simulación virtual y la realidad física. La industria está pasando de modelos puramente computacionales a la combinación con la verificación experimental, con el objetivo de descubrir materiales revolucionarios como los superconductores a temperatura ambiente. (Fuente: MIT Technology Review)

Controversia sobre la productividad de la programación con IA y la deuda técnica: Las herramientas de programación con IA se están popularizando; los CEO de Microsoft y Google afirman que la IA ya genera una cuarta parte del código de sus empresas, y el CEO de Anthropic predice que el 90% del código futuro será escrito por IA. Sin embargo, el aumento real de la productividad es controvertido, y algunos estudios sugieren que la IA podría ralentizar el desarrollo y aumentar la “deuda técnica” (como la disminución de la calidad del código y la dificultad de mantenimiento). A pesar de esto, la IA sobresale en la escritura de código boilerplate, pruebas y solución de bugs. Las herramientas de agentes de nueva generación, como Claude Code, han mejorado significativamente la capacidad de procesamiento de tareas complejas mediante modos de planificación y gestión de contexto. La industria está explorando nuevos paradigmas, como el “código desechable” y la verificación formal, para adaptarse a los modelos de desarrollo impulsados por IA. (Fuente: MIT Technology Review)

Los defensores de la seguridad de la IA persisten en sus preocupaciones sobre los riesgos de AGI: Aunque el desarrollo reciente de la IA se considera que ha entrado en un período de “corrección de la euforia” y el rendimiento de GPT-5 ha sido moderado, los defensores de la seguridad de la IA (“alarmistas de la IA”) siguen profundamente preocupados por los riesgos potenciales de la AGI (Inteligencia Artificial General). Creen que, aunque el ritmo del progreso de la IA pueda ralentizarse, su peligrosidad fundamental no ha cambiado, y se sienten decepcionados por la falta de atención de los formuladores de políticas a los riesgos de la IA. Enfatizan que, incluso si la AGI se logra en décadas en lugar de años, es necesario invertir recursos de inmediato para resolver los problemas de control y estar alerta ante el exceso de inversión de la industria en la burbuja de la IA, que podría tener efectos negativos a largo plazo. (Fuente: MIT Technology Review)

🎯 Tendencias

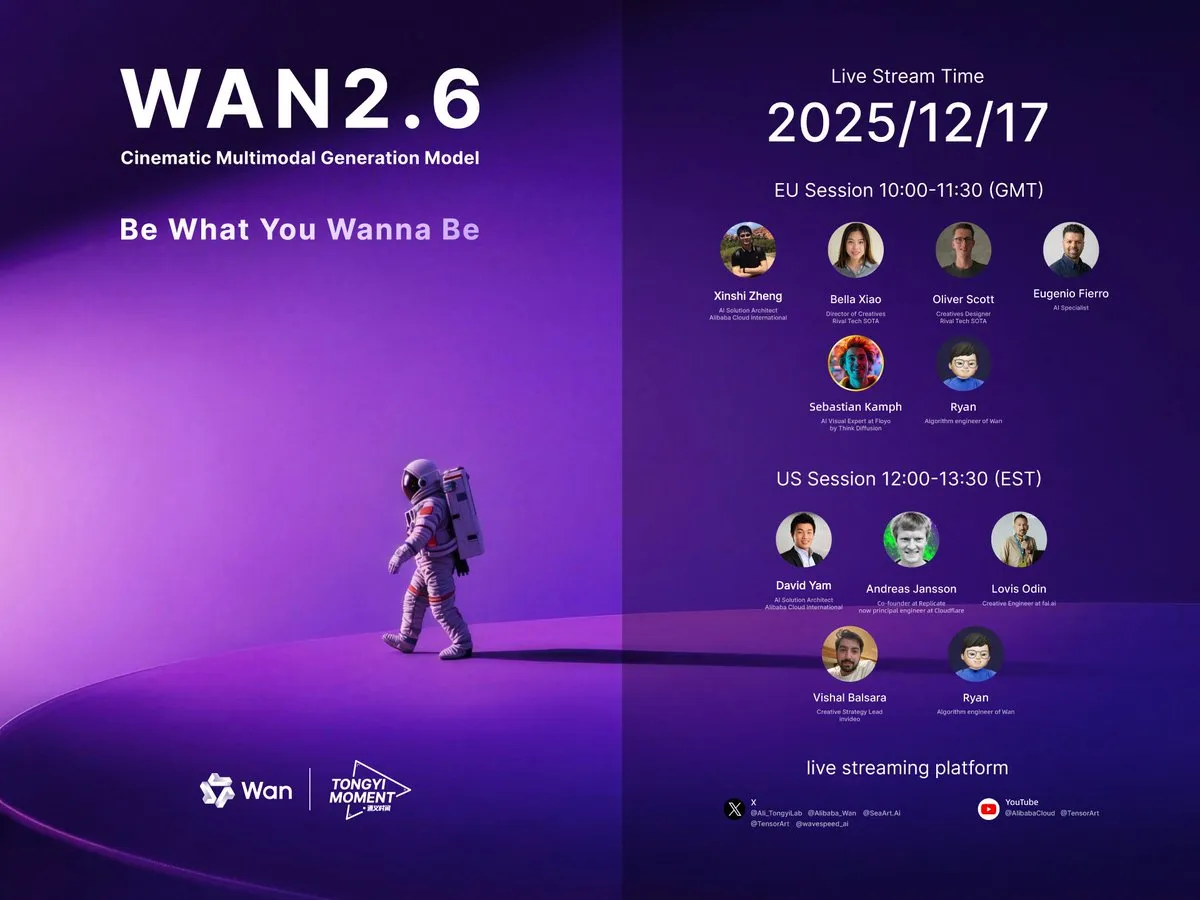

Avances continuos en modelos de generación de video multimodal: Alibaba lanzó el modelo de video Wan 2.6, que admite interpretación de roles, sincronización de audio y video, generación de múltiples tomas y control por sonido, con una duración de video por instancia de hasta 15 segundos, considerado un “pequeño Sora 2”. ByteDance también presentó Seedance 1.5 Pro, destacando su soporte para dialectos. LongVie 2, de HuggingFace Daily Papers, propone un modelo mundial de video ultralargo controlable multimodal, enfatizando la controlabilidad, la calidad visual a largo plazo y la coherencia temporal. Estos avances marcan una mejora significativa en el realismo, la interactividad y los escenarios de aplicación de la tecnología de generación de video. (Fuente: Alibaba_Wan, op7418, op7418, HuggingFace Daily Papers)

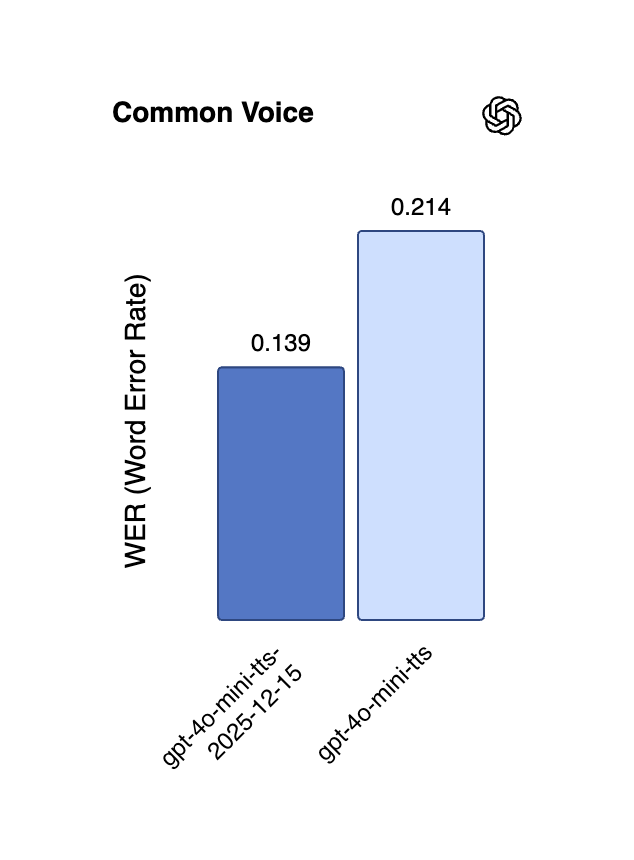

Nuevos avances en tecnología de voz con IA para múltiples idiomas y streaming en tiempo real: Alibaba ha lanzado como código abierto el modelo CosyVoice 3 TTS, que admite 9 idiomas y más de 18 dialectos chinos, ofrece clonación de voz de cero-shot multilingüe/translingüe y logra una transmisión bidireccional de flujo con una latencia ultrabaja de 150 milisegundos. La API en tiempo real de OpenAI también ha actualizado los modelos gpt-4o-mini-transcribe y gpt-4o-mini-tts, reduciendo significativamente las alucinaciones y la tasa de errores, y mejorando el rendimiento multilingüe. El modelo Gemini 2.5 Flash Native Audio de Google DeepMind también ha sido actualizado, optimizando aún más el seguimiento de instrucciones y la naturalidad del diálogo, impulsando la aplicación de agentes de voz en tiempo real. (Fuente: ImazAngel, Reddit r/LocalLLaMA, snsf, GoogleDeepMind)

Razonamiento de contexto largo y optimización de la eficiencia en modelos grandes: QwenLong-L1.5, a través de una innovación sistemática de post-entrenamiento, iguala a GPT-5 y Gemini-2.5-Pro en capacidad de razonamiento de contexto largo, y sobresale en tareas ultralargas. GPT-5.2 también ha recibido buenas críticas de los usuarios por su capacidad de contexto largo, especialmente por resumir podcasts con más detalle. Además, ReFusion propone un nuevo modelo de difusión enmascarado que logra mejoras significativas en rendimiento y eficiencia mediante la decodificación paralela a nivel de slot, acelerando en promedio 18 veces y reduciendo la brecha de rendimiento con los modelos autorregresivos. (Fuente: gdb, HuggingFace Daily Papers, HuggingFace Daily Papers, teortaxesTex)

Avances en IA encarnada y tecnología robótica: AgiBot lanzó el robot humanoide Lingxi X2, que posee una capacidad de movimiento cercana a la humana y habilidades multifuncionales. Varias investigaciones en HuggingFace Daily Papers se centran en la IA encarnada, como Toward Ambulatory Vision, que explora la selección activa de perspectiva con conexión visual; Spatial-Aware VLA Pretraining, que logra la alineación visual-física a través de videos humanos; y VLSA, que introduce una capa de restricciones de seguridad plug-and-play para mejorar la seguridad de los modelos VLA. Estas investigaciones tienen como objetivo reducir la brecha entre la visión 2D y la acción en entornos físicos 3D, impulsando el aprendizaje robótico y el despliegue práctico. (Fuente: Ronald_vanLoon, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

Contribuciones de NVIDIA y Meta a la arquitectura de IA y modelos de código abierto: NVIDIA lanzó la familia de modelos abiertos Nemotron v3 Nano y ha puesto a disposición como código abierto la pila completa de entrenamiento (incluyendo infraestructura de RL, entornos, conjuntos de datos de preentrenamiento y postentrenamiento), con el objetivo de impulsar la construcción de IA de agentes especializados en diversas industrias. Meta, por su parte, presentó la arquitectura de predicción de incrustación conjunta visión-lenguaje VL-JEPA, como el primer modelo no generativo, capaz de ejecutar eficientemente tareas generales de visión-lenguaje en aplicaciones de streaming en tiempo real, superando el rendimiento de grandes VLM. (Fuente: ylecun, QuixiAI, halvarflake)

Innovación en pruebas de referencia y métodos de evaluación de IA: Google Research lanzó FACTS Leaderboard, que evalúa de manera integral la facticidad de los LLM en cuatro dimensiones: multimodalidad, conocimiento paramétrico, búsqueda y fundamentación, revelando las compensaciones entre diferentes modelos en cobertura y tasa de contradicción. La prueba de referencia V-REX evalúa la capacidad de razonamiento visual exploratorio de los VLM a través de “cadenas de preguntas”, mientras que START se centra en el aprendizaje textual y espacial para la comprensión de gráficos. Estas nuevas pruebas de referencia tienen como objetivo medir con mayor precisión el rendimiento de los modelos de IA en tareas complejas y del mundo real. (Fuente: omarsar0, HuggingFace Daily Papers, HuggingFace Daily Papers)

Mejora de la autonomía de los agentes de IA en entornos web: WebOperator propone un marco de búsqueda en árbol sensible a la acción que permite a los agentes LLM realizar retrocesos fiables y exploración estratégica en entornos web parcialmente observables. Este método genera candidatos de acción a partir de múltiples contextos de inferencia y filtra las acciones inválidas, lo que mejora significativamente la tasa de éxito en las tareas de WebArena, destacando la ventaja clave de combinar la previsión estratégica con la ejecución segura. (Fuente: HuggingFace Daily Papers)

Conducción autónoma asistida por IA y modelos mundiales 4D: DrivePI es un MLLM 4D con conciencia espacial que unifica la comprensión, percepción, predicción y planificación para la conducción autónoma. Al integrar nubes de puntos, imágenes de múltiples vistas e instrucciones de lenguaje, y generar pares de preguntas y respuestas de texto-ocupación y texto-flujo, logra una predicción precisa de la ocupación 3D y el flujo de ocupación, superando a los VLA y modelos VA profesionales existentes en pruebas de referencia como nuScenes. GenieDrive, por su parte, se centra en modelos mundiales de conducción con conciencia física, mejorando la precisión de la predicción y la calidad del video mediante la generación de video guiada por ocupación 4D. (Fuente: HuggingFace Daily Papers, HuggingFace Daily Papers)

🧰 Herramientas

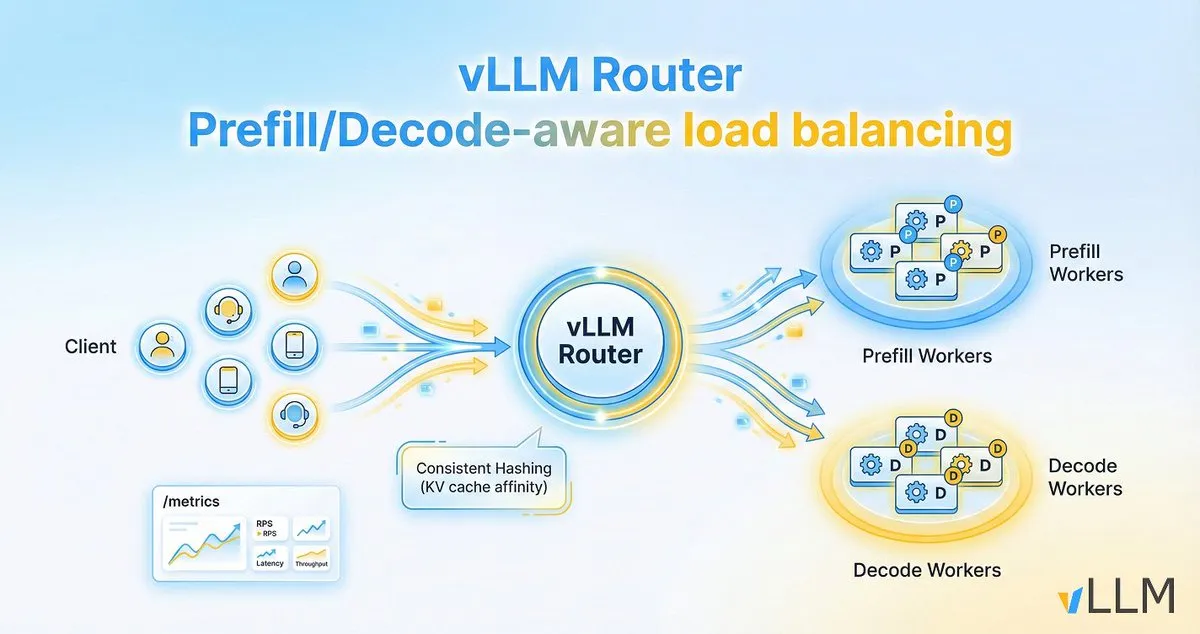

vLLM Router mejora la eficiencia de inferencia de LLM: El proyecto vLLM ha lanzado vLLM Router, un balanceador de carga ligero, de alto rendimiento y consciente de la precarga/decodificación, diseñado específicamente para clústeres de vLLM. Escrito en Rust, admite estrategias como el hashing consistente y la selección de doble potencia, con el objetivo de optimizar la localidad de caché KV y resolver los cuellos de botella en el tráfico de diálogo y la separación de precarga/decodificación, mejorando así el rendimiento de la inferencia de LLM y reduciendo la latencia de cola. (Fuente: vllm_project)

AI21 Maestro simplifica la construcción de agentes de IA: Vibe Agent de AI21Labs, lanzado en AI21 Maestro, permite a los usuarios crear agentes de IA mediante descripciones sencillas en inglés. La herramienta sugiere automáticamente los usos del agente, las comprobaciones de validación, las herramientas necesarias y las configuraciones de modelo/computación, y explica cada paso en tiempo real, lo que reduce en gran medida el umbral para construir agentes de IA complejos. (Fuente: AI21Labs)

OpenHands SDK acelera el desarrollo de software impulsado por agentes: OpenHands ha lanzado su SDK de agentes de software, diseñado para proporcionar un marco rápido, flexible y listo para producción para construir software impulsado por agentes. El lanzamiento de este SDK ayudará a los desarrolladores a integrar y gestionar agentes de IA de manera más eficiente para abordar tareas complejas de desarrollo de software. (Fuente: gneubig)

Actualización de Claude Code CLI mejora la experiencia de desarrollo: Anthropic ha lanzado la versión 2.0.70 de Claude Code, que incluye 13 mejoras en la CLI. Las principales actualizaciones incluyen: soporte para la tecla Enter para aceptar sugerencias de prompts, sintaxis de comodín para permisos de herramientas MCP, un interruptor de actualización automática del mercado de plugins y un modo de planificación forzada. Además, la eficiencia del uso de memoria se ha triplicado y la resolución de captura de pantalla es mayor, con el objetivo de optimizar la interacción y eficiencia de los desarrolladores al usar Claude Code para el desarrollo de software. (Fuente: Reddit r/ClaudeAI)

Qwen3-Coder permite el desarrollo rápido de juegos 2D: Un usuario de Reddit demostró cómo usar el modelo Qwen3-Coder (480B) de Alibaba, a través de Cursor IDE, para construir un juego de estilo Mario en 2D en segundos. El modelo, a partir de un solo prompt, planifica automáticamente los pasos, instala dependencias, genera código y la estructura del proyecto, y puede ejecutarse directamente. Su costo de ejecución es bajo (aproximadamente 2 dólares por millón de tokens) y la experiencia es similar al modo de agente de GPT-4, lo que demuestra el gran potencial de los modelos de código abierto en la generación de código y tareas de agente. (Fuente: Reddit r/artificial)

Herramienta de investigación profunda de acciones impulsada por IA: La herramienta Deep Research utiliza IA para extraer datos de documentos de la SEC y publicaciones de la industria, generando informes estandarizados para simplificar la comparación y el filtrado de empresas. Los usuarios pueden introducir un código de acción para obtener un análisis profundo. Esta herramienta tiene como objetivo ayudar a los inversores a realizar una investigación fundamental de manera más eficiente, evitando las distracciones de las noticias del mercado y centrándose en la información financiera sustantiva. (Fuente: Reddit r/ChatGPT)

LangChain 1.2 simplifica la construcción de aplicaciones Agentic RAG: LangChain ha lanzado la versión 1.2, que simplifica el soporte para herramientas integradas y el modo estricto, especialmente en la función create_agent. Esto permite a los desarrolladores construir aplicaciones Agentic RAG (Generación Aumentada por Recuperación con Agentes) de manera más conveniente, ya sea ejecutándolas localmente o en Google Collab, y enfatiza su característica 100% de código abierto. (Fuente: LangChainAI, hwchase17)

Skywork lanza una función de generación de PPT impulsada por IA: La plataforma Skywork ha lanzado una capacidad de generación de PPT basada en Nano Banana Pro, que resuelve el problema de la difícil edición de los PPT generados por IA tradicionales. La nueva función admite la separación de capas, lo que permite a los usuarios modificar texto e imágenes en línea y exportar en formato pptx para su edición local. Además, la herramienta integra bases de datos profesionales de la industria, admite la generación de varios tipos de gráficos para garantizar la precisión de los datos y ofrece ofertas de promoción navideña. (Fuente: op7418)

Modelos pequeños potencian la infraestructura como código en el borde: Un usuario de Reddit compartió un modelo de “Infraestructura como Código” (IaC) de 500 MB que puede ejecutarse en dispositivos de borde o en el navegador. Este modelo se centra en tareas de IaC, es compacto pero potente, y proporciona una solución eficiente para desplegar y gestionar infraestructura en entornos con recursos limitados, lo que presagia el enorme potencial de los modelos pequeños de IA en aplicaciones en verticales específicas. (Fuente: Reddit r/deeplearning)

📚 Aprendizaje

Chinarxiv.org: Plataforma de traducción automatizada de preprints en chino: Chinarxiv.org ha sido lanzado oficialmente, una plataforma de traducción de preprints en chino totalmente automatizada, diseñada para cerrar la brecha lingüística entre la investigación científica china y occidental. Esta plataforma no solo traduce texto, sino también el contenido de gráficos y tablas, lo que permite a los investigadores occidentales acceder y comprender más fácilmente los últimos resultados de investigación de la comunidad científica china. (Fuente: menhguin, andersonbcdefg, francoisfleuret)

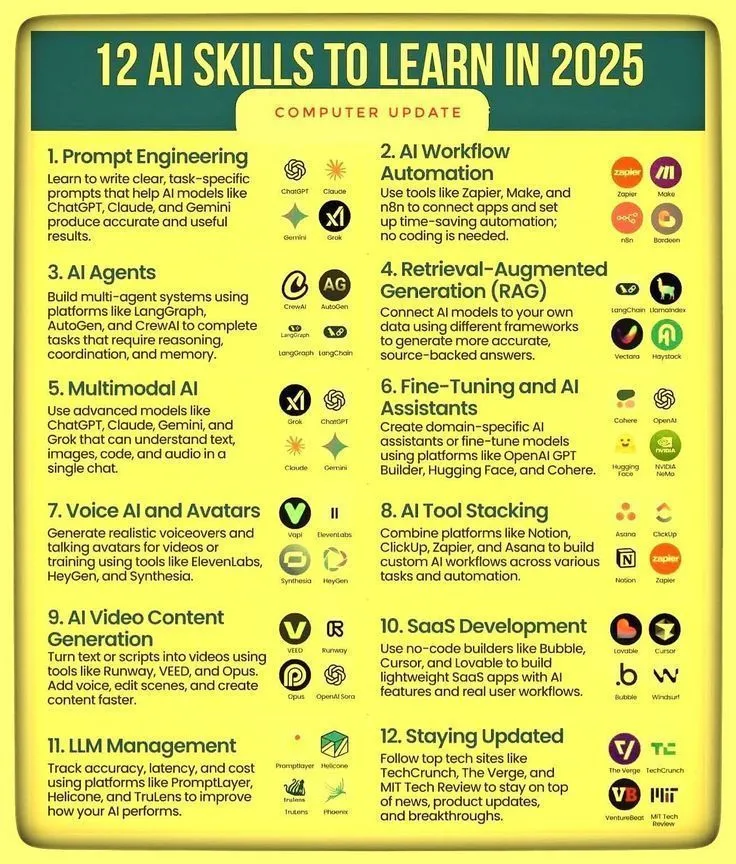

Habilidades de IA y hoja de ruta de aprendizaje de Agentic AI: Ronald_vanLoon compartió 12 capacidades clave para dominar las habilidades de IA en 2025, así como una hoja de ruta de maestría para Agentic AI. Estos recursos tienen como objetivo guiar a las personas para mejorar su competitividad en el campo de la IA en rápida evolución, cubriendo rutas de aprendizaje desde el conocimiento básico de IA hasta el desarrollo de sistemas de agentes avanzados, enfatizando la importancia del aprendizaje continuo y la adaptación a nuevas habilidades en la era de la IA. (Fuente: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Optimización del proceso de inferencia de LLM y desarrollo de IA impulsado por datos: La investigación de Meta Superintelligence Labs muestra que, a través de la estrategia PDR (Parallel Draft-Distill-Refine) de “borrador paralelo → destilación a espacio de trabajo compacto → refinamiento”, se puede lograr la máxima precisión de la tarea bajo restricciones de inferencia. Al mismo tiempo, una publicación de blog enfatiza que “los datos son la vanguardia irregular de la IA”, señalando que los campos de codificación y matemáticas tienen éxito debido a la abundancia y verificabilidad de los datos, mientras que el campo científico está relativamente rezagado, y explora el papel de la destilación y el aprendizaje por refuerzo en la generación de datos. (Fuente: dair_ai, lvwerra)

Razonamiento colaborativo visión-lenguaje mejora la capacidad de abstracción: Una nueva investigación propone el marco de razonamiento colaborativo visión-lenguaje (VLSR), que, al combinar estratégicamente las modalidades visual y textual en diferentes etapas de razonamiento, mejora significativamente el rendimiento de los LLM en tareas de razonamiento abstracto (como la prueba de referencia ARC-AGI). Este método utiliza la visión para el reconocimiento de patrones globales, el texto para la ejecución precisa, y supera el sesgo de confirmación a través de un mecanismo de autocorrección por cambio de modalidad, superando incluso el rendimiento de GPT-4o en modelos pequeños. (Fuente: dair_ai)

Nueva perspectiva de los tokens de inferencia de LLM como estado computacional: El marco conceptual State over Tokens (SoT) redefine los tokens de inferencia de LLM como un estado computacional externalizado, en lugar de una simple narración lingüística. Esto explica cómo los tokens pueden impulsar un razonamiento correcto sin ser una interpretación textual fiel, y abre nuevas direcciones de investigación para comprender los procesos internos de los LLM, enfatizando que la investigación debe ir más allá de la interpretación textual y centrarse en decodificar los tokens de inferencia como estados. (Fuente: HuggingFace Daily Papers)

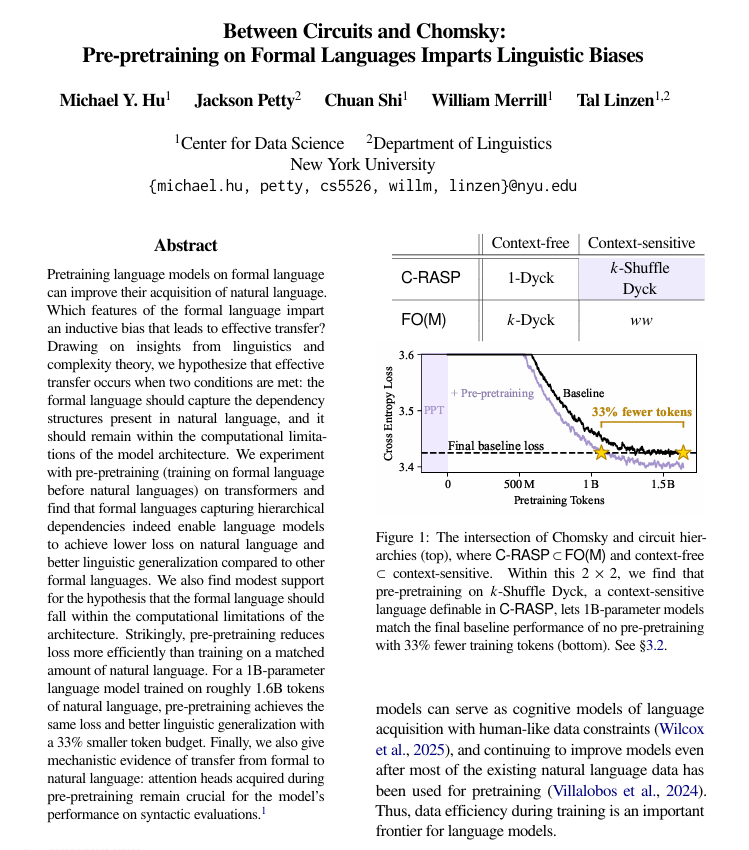

Preentrenamiento con lenguaje formal mejora el aprendizaje de lenguaje natural: Una investigación de la Universidad de Nueva York encontró que el preentrenamiento con un lenguaje formalizado y basado en reglas antes del preentrenamiento con lenguaje natural puede ayudar significativamente a los modelos de lenguaje a aprender mejor el lenguaje humano. El estudio señala que este lenguaje formal necesita tener una estructura similar (especialmente jerárquica) al lenguaje natural y ser lo suficientemente simple. Este método es más efectivo que agregar la misma cantidad de datos de lenguaje natural, y los mecanismos estructurales aprendidos se transfieren dentro del modelo. (Fuente: TheTuringPost)

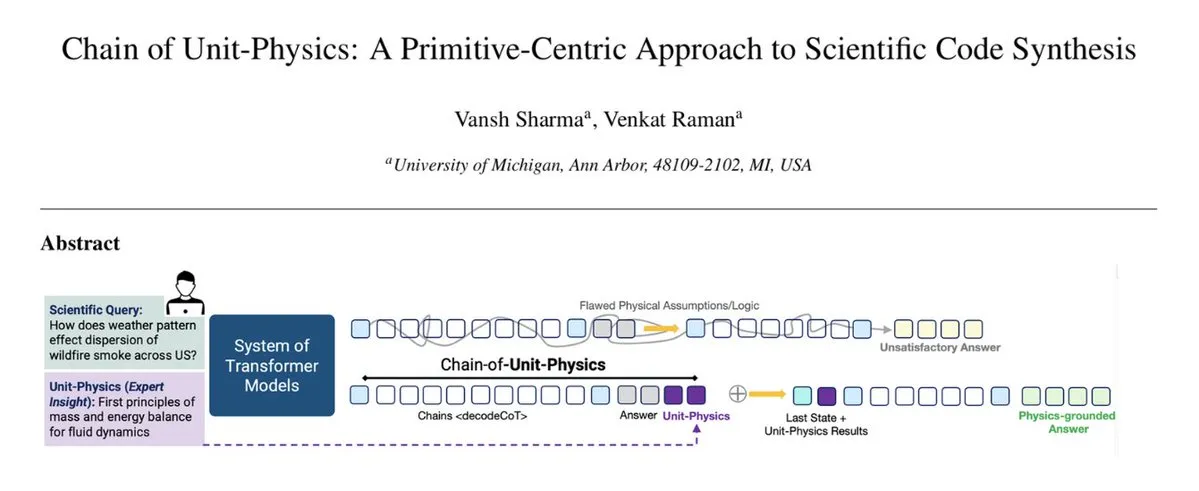

Inyección de conocimiento físico en el flujo de generación de código: El marco Chain of Unit-Physics integra directamente el conocimiento físico en el proceso de generación de código. Investigadores de la Universidad de Michigan proponen un método de generación de código científico inverso que guía y restringe la generación de código codificando el conocimiento de expertos humanos como pruebas de física de unidades. En una configuración multiagente, este marco permite que el sistema alcance la solución correcta en 5-6 iteraciones, con una velocidad de ejecución un 33% mayor, un uso de memoria un 30% menor y una tasa de error extremadamente baja. (Fuente: TheTuringPost)

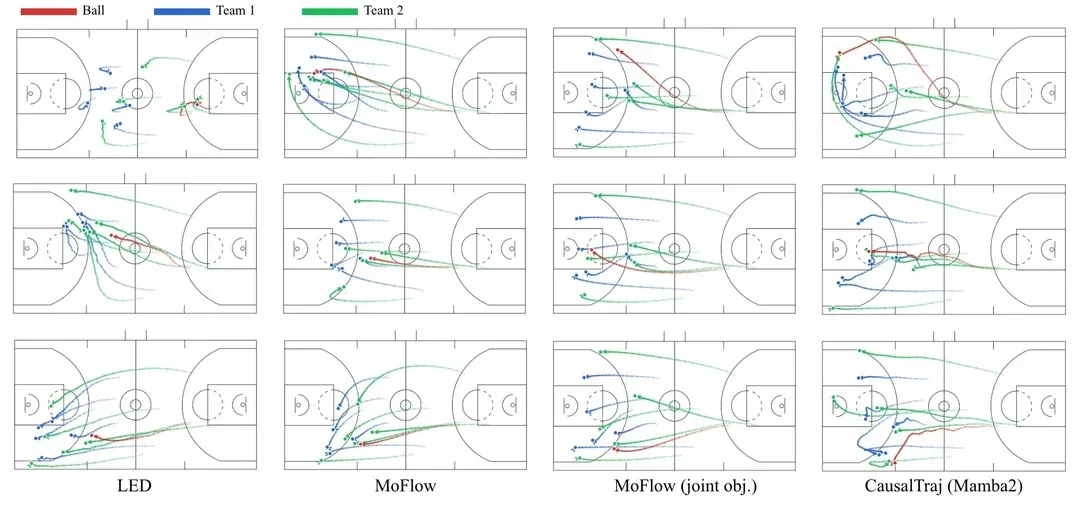

CausalTraj: Modelo de predicción de trayectoria multiagente para equipos deportivos: CausalTraj es un modelo autorregresivo para la predicción conjunta de trayectorias multiagente en deportes de equipo. El modelo se entrena directamente con un objetivo de verosimilitud de predicción conjunta, en lugar de optimizar solo métricas de agentes individuales, lo que mejora significativamente la coherencia y razonabilidad de las trayectorias multiagente, al tiempo que garantiza el rendimiento individual. La investigación también explora cómo evaluar el modelado conjunto de manera más efectiva y cómo evaluar la probabilidad real de las trayectorias muestreadas. (Fuente: Reddit r/deeplearning)

Datos de entrenamiento de LLM: ¿Respuestas o preguntas?: Una discusión en Reddit plantea que la mayoría de los conjuntos de datos de entrenamiento de LLM actuales se centran en las “respuestas”, mientras que una parte clave de la inteligencia humana reside en el proceso caótico, ambiguo e iterativo previo a la formulación de las “preguntas”. Los experimentos muestran que los modelos entrenados con datos de diálogo que incluyen pensamientos iniciales, preguntas ambiguas y correcciones repetidas se desempeñan mejor en la clarificación de la intención del usuario, el manejo de tareas ambiguas y la evitación de conclusiones erróneas, lo que sugiere que los datos de entrenamiento necesitan capturar de manera más integral la complejidad del pensamiento humano. (Fuente: Reddit r/MachineLearning)

💼 Negocios

OpenAI adquiere neptune.ai, fortaleciendo las herramientas de investigación de vanguardia: OpenAI anunció que ha llegado a un acuerdo definitivo para adquirir neptune.ai, una medida destinada a fortalecer sus herramientas e infraestructura que apoyan la investigación de vanguardia. Esta adquisición ayudará a OpenAI a mejorar sus capacidades en el desarrollo de IA y la gestión de experimentos, acelerando aún más el entrenamiento y el proceso de iteración de modelos, y consolidando su posición de liderazgo en el campo de la IA. (Fuente: dl_weekly)

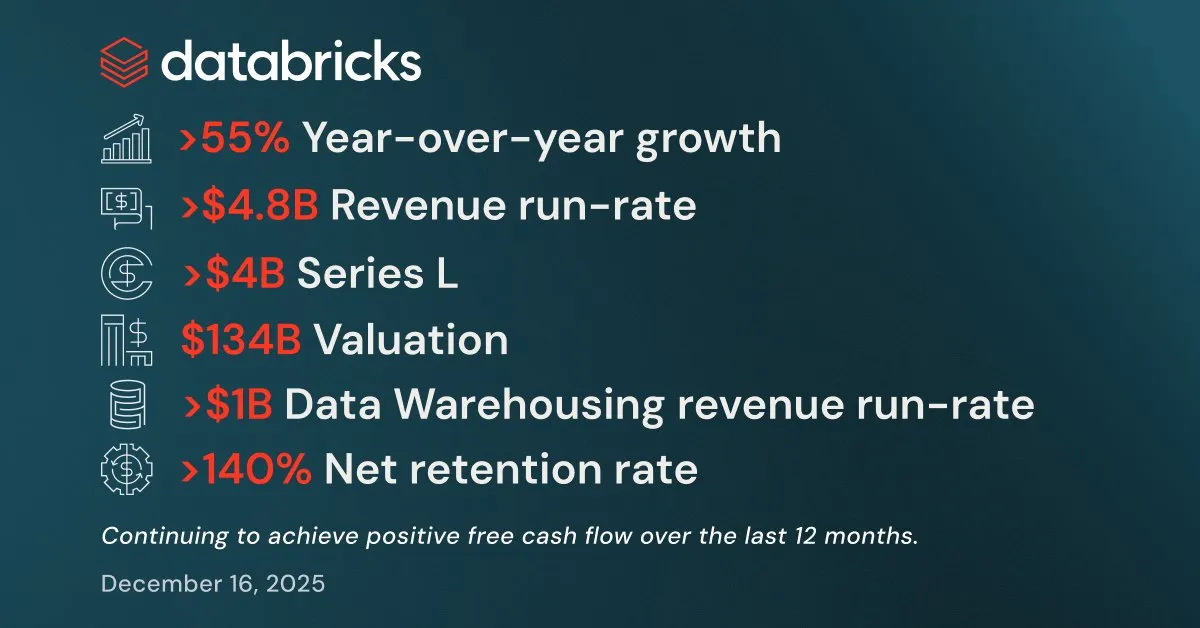

Databricks con sólidos resultados en el tercer trimestre y más de 4 mil millones de dólares en financiación: Databricks anunció sólidos resultados en el tercer trimestre, con una tasa de ejecución de ingresos anuales superior a los 4.800 millones de dólares, un crecimiento interanual de más del 55%. Sus negocios de almacenamiento de datos y productos de IA superaron los 1.000 millones de dólares en tasa de ejecución de ingresos anuales. La empresa también completó una ronda de financiación Serie L de más de 4 mil millones de dólares, con una valoración de 134 mil millones de dólares, y planea invertir los fondos en Lakebase Postgres, Agent Bricks y Databricks Apps para acelerar el desarrollo de aplicaciones de inteligencia de datos. (Fuente: jefrankle, jefrankle)

Infosys y Formula E colaboran para impulsar la transformación digital impulsada por IA: Infosys se ha asociado con el Campeonato Mundial ABB FIA Formula E para revolucionar la experiencia de los aficionados y la eficiencia operativa del automovilismo a través de una plataforma impulsada por IA. La colaboración incluye el uso de IA para proporcionar contenido personalizado, análisis de carrera en tiempo real, comentarios generados por IA, y optimizar la logística y los viajes para lograr los objetivos de reducción de emisiones de carbono. La tecnología de IA no solo mejoró el atractivo del evento, sino que también promovió el desarrollo sostenible y la diversidad de los empleados, convirtiendo a la Formula E en el deporte de motor más digitalizado y sostenible. (Fuente: MIT Technology Review)

🌟 Comunidad

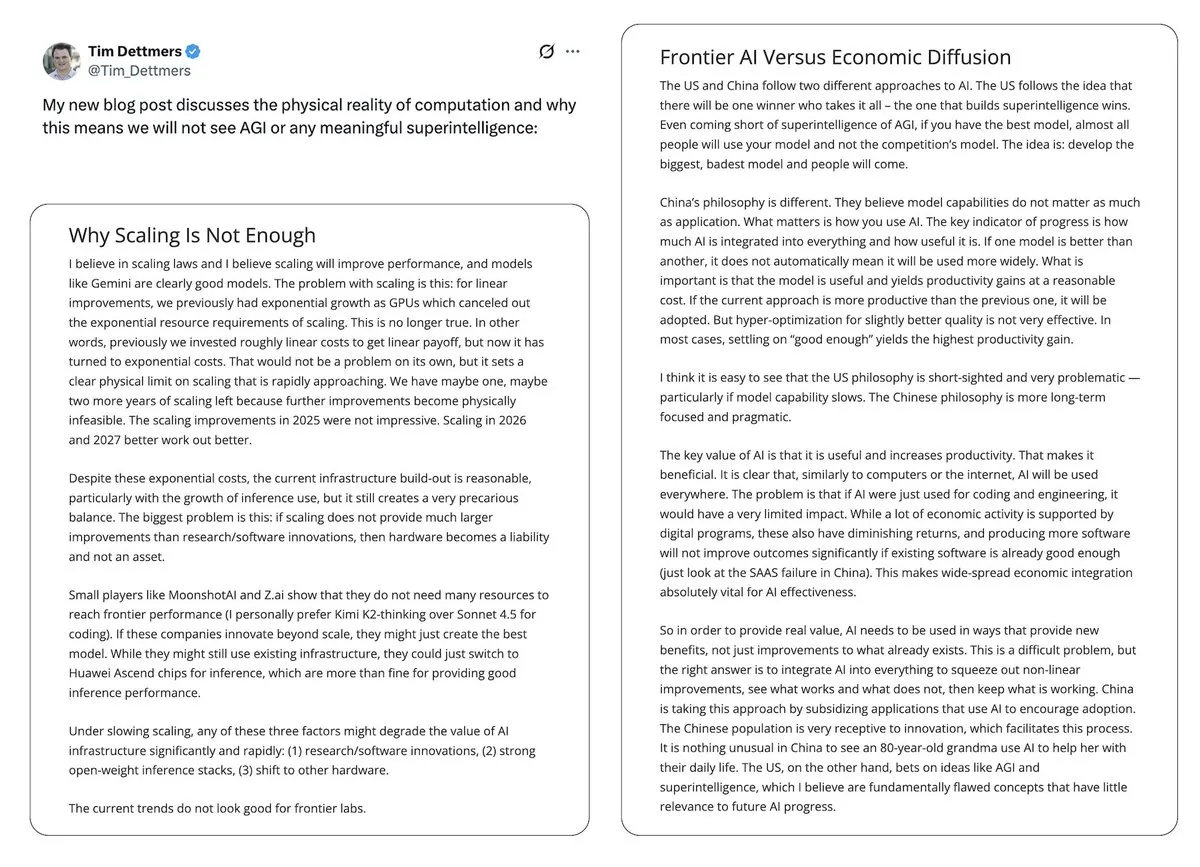

Controversia sobre la burbuja de la IA y las perspectivas de AGI: Yann LeCun declaró públicamente que los LLM y la AGI son “completas tonterías”, argumentando que el futuro de la IA reside en los modelos mundiales en lugar del paradigma actual de LLM, y expresando preocupación por que la tecnología de IA sea monopolizada por unas pocas empresas. El artículo de Tim Dettmers “Why AGI Will Not Happen” también recibió atención por su discusión sobre los rendimientos decrecientes de la escala. Mientras tanto, los defensores de la seguridad de la IA, aunque han ajustado sus estimaciones sobre la llegada de la AGI, persisten en su preocupación por su peligrosidad potencial y lamentan que los formuladores de políticas no hayan dado suficiente importancia a los riesgos de la IA. (Fuente: ylecun, ylecun, hardmaru, MIT Technology Review)

Evaluaciones polarizadas de los usuarios sobre GPT-5.2 y Gemini: En redes sociales, las evaluaciones de los usuarios sobre OpenAI GPT-5.2 son mixtas. Algunos usuarios están satisfechos con su capacidad de procesamiento de contexto largo, encontrando que resume el contenido de podcasts de manera más rica; sin embargo, otros expresan una fuerte insatisfacción, considerando que las respuestas de GPT-5.2 son demasiado genéricas, con poca profundidad, e incluso muestran respuestas de “autoconciencia”, llevando a algunos usuarios a cambiarse a Gemini. Esta polarización refleja la sensibilidad de los usuarios a la performance y el comportamiento de los nuevos modelos, así como su continua atención a la experiencia de los productos de IA. (Fuente: gdb, Reddit r/ArtificialInteligence)

Impacto de la IA en la cognición humana, los estándares laborales y el comportamiento ético: El uso prolongado de la IA está cambiando sutilmente los patrones cognitivos humanos y los estándares laborales, impulsando un pensamiento más estructurado y aumentando las expectativas sobre la calidad de la producción. La IA hace que la producción de contenido de alta calidad sea eficiente, pero también puede llevar a una dependencia excesiva de la tecnología. En el nivel ético, las diferentes respuestas de los modelos al “problema del tranvía” (el utilitarismo de Grok frente al altruismo de Gemini/ChatGPT) han provocado debates sobre el establecimiento de valores de la IA. Al mismo tiempo, la naturaleza de “autodisciplina” de los mensajes de seguridad de los modelos de IA también revela el impacto indirecto de los mecanismos de control interno de la IA en la experiencia del usuario. (Fuente: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, Reddit r/ChatGPT)

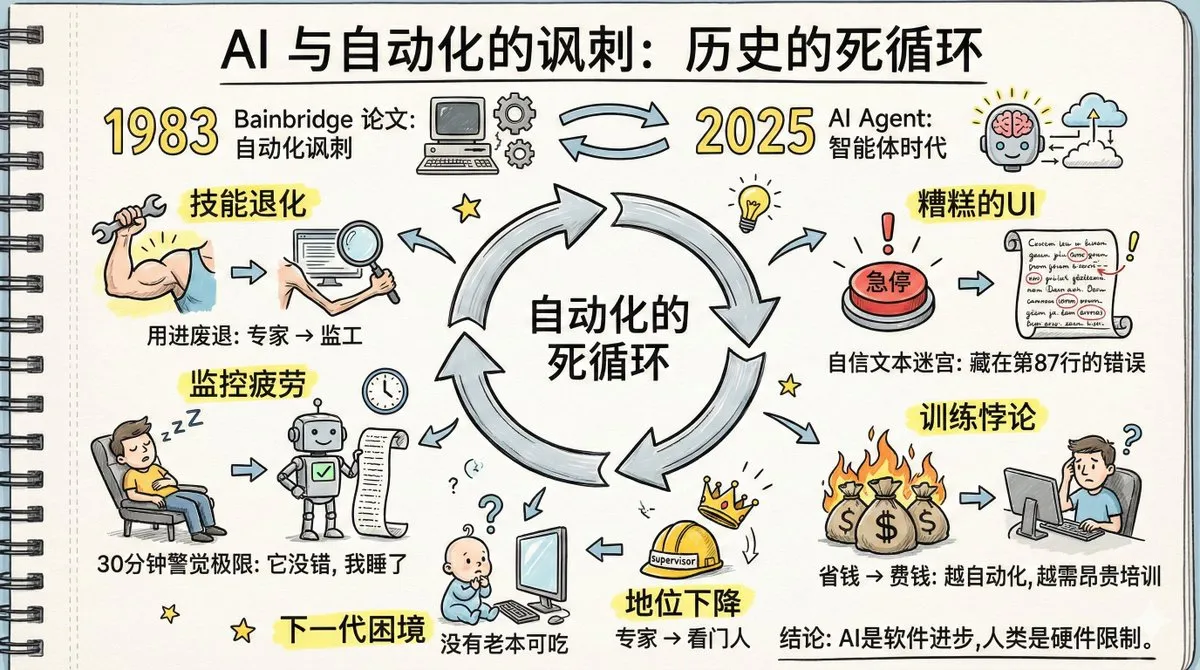

La “paradoja de la automatización” de los agentes de IA y la degradación de las habilidades humanas: Un artículo titulado “La paradoja de la automatización” ha generado un acalorado debate, ya que sus predicciones de hace cuarenta años sobre la automatización de fábricas se están cumpliendo en los AI Agents. La discusión señala que la proliferación de los AI Agents puede llevar a la degradación de habilidades humanas, la ralentización de la recuperación de la memoria, la fatiga de monitoreo y la disminución del estatus de experto. El artículo enfatiza que los humanos no pueden mantener la vigilancia durante mucho tiempo sobre sistemas que “rara vez fallan”, y que el diseño actual de la interfaz de los AI Agents no favorece la detección de anomalías. Resolver estos problemas requiere una creatividad tecnológica mayor que la propia automatización, así como un cambio cognitivo hacia una nueva división del trabajo, nueva capacitación y diseño de nuevos roles. (Fuente: dotey, dotey, dotey)

Generación de contenido de baja calidad por IA y desafíos de veracidad: Usuarios de redes sociales han descubierto una gran cantidad de sitios web de baja calidad creados específicamente para satisfacer los resultados de búsqueda de IA, cuestionando si la investigación de IA se basa en estos sitios que carecen de autoría e información detallada, lo que podría llevar a información poco fiable. Esto ha generado preocupaciones sobre el mecanismo de “relleno de fuentes” de la IA, donde la IA primero genera la respuesta y luego busca fuentes de apoyo, lo que podría resultar en la citación de información falsa. Esto subraya los desafíos de la IA en cuanto a la veracidad de la información y la necesidad de que los usuarios vuelvan a la investigación autónoma. (Fuente: Reddit r/ArtificialInteligence)

Impacto de la IA en la profesión legal y la teoría de los niveles de abstracción: En el ámbito legal, existe controversia sobre si la IA “destruirá” la profesión de abogado. Algunos abogados creen que la IA puede manejar más del 90% del trabajo legal, pero la estrategia, la negociación y la responsabilidad aún requieren humanos. Al mismo tiempo, hay quienes ven la IA como la próxima capa de abstracción después del ensamblador, C y Python, argumentando que liberará a los ingenieros para que se centren en el diseño de sistemas y la experiencia del usuario, en lugar de reemplazar a los humanos. (Fuente: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

Comportamiento físico de los agentes de IA y controversia sobre la fusión de LLM/robótica: Una nueva investigación sugiere que los agentes de IA impulsados por LLM pueden seguir leyes físicas macroscópicas, exhibiendo propiedades de “equilibrio detallado” similares a los sistemas termodinámicos, lo que implica que podrían haber aprendido implícitamente una “función potencial” para evaluar estados. Al mismo tiempo, algunos argumentan que la inteligencia robótica y los LLM se están bifurcando en lugar de unificarse, mientras que otros creen que la IA física se está volviendo real, especialmente con los avances en depuración y visualización que aceleran los proyectos de robótica e IA encarnada. (Fuente: omarsar0, Teknium, wandb)

Ejecutivo de Anthropic fuerza el despliegue de un chatbot de IA en la comunidad de Discord, generando controversia: Un ejecutivo de Anthropic, ignorando la oposición de los miembros, forzó el despliegue del chatbot de IA de la compañía, Clawd, en una comunidad de Discord orientada a la comunidad LGBTQ+, lo que resultó en una pérdida masiva de miembros de la comunidad. Este incidente ha generado preocupaciones sobre la privacidad de la IA en las comunidades, el impacto en la interacción humana y la mentalidad de las empresas de IA de “crear nuevos dioses”. Los usuarios expresaron un fuerte descontento con el reemplazo de la comunicación humana por chatbots de IA y el comportamiento arrogante del ejecutivo. (Fuente: Reddit r/artificial)

Modelos de IA vulnerables a ataques poéticos; llamada a talentos literarios para unirse a laboratorios de IA: Investigadores de IA italianos descubrieron que, al transformar prompts maliciosos en forma de poesía, se puede engañar a los modelos de IA líderes, siendo Gemini 2.5 el más susceptible. Este fenómeno, conocido como el “efecto Waluigi”, se debe a que en un espacio semántico comprimido, los roles de bien y mal están demasiado cerca, lo que hace que el modelo sea más propenso a ejecutar instrucciones a la inversa. Esto ha provocado un debate en la comunidad sobre si los laboratorios de IA necesitan más graduados en literatura para comprender la narrativa y los mecanismos profundos del lenguaje, a fin de abordar el comportamiento potencial de “espacio narrativo extraño” de la IA. (Fuente: Reddit r/ArtificialInteligence)

💡 Otros

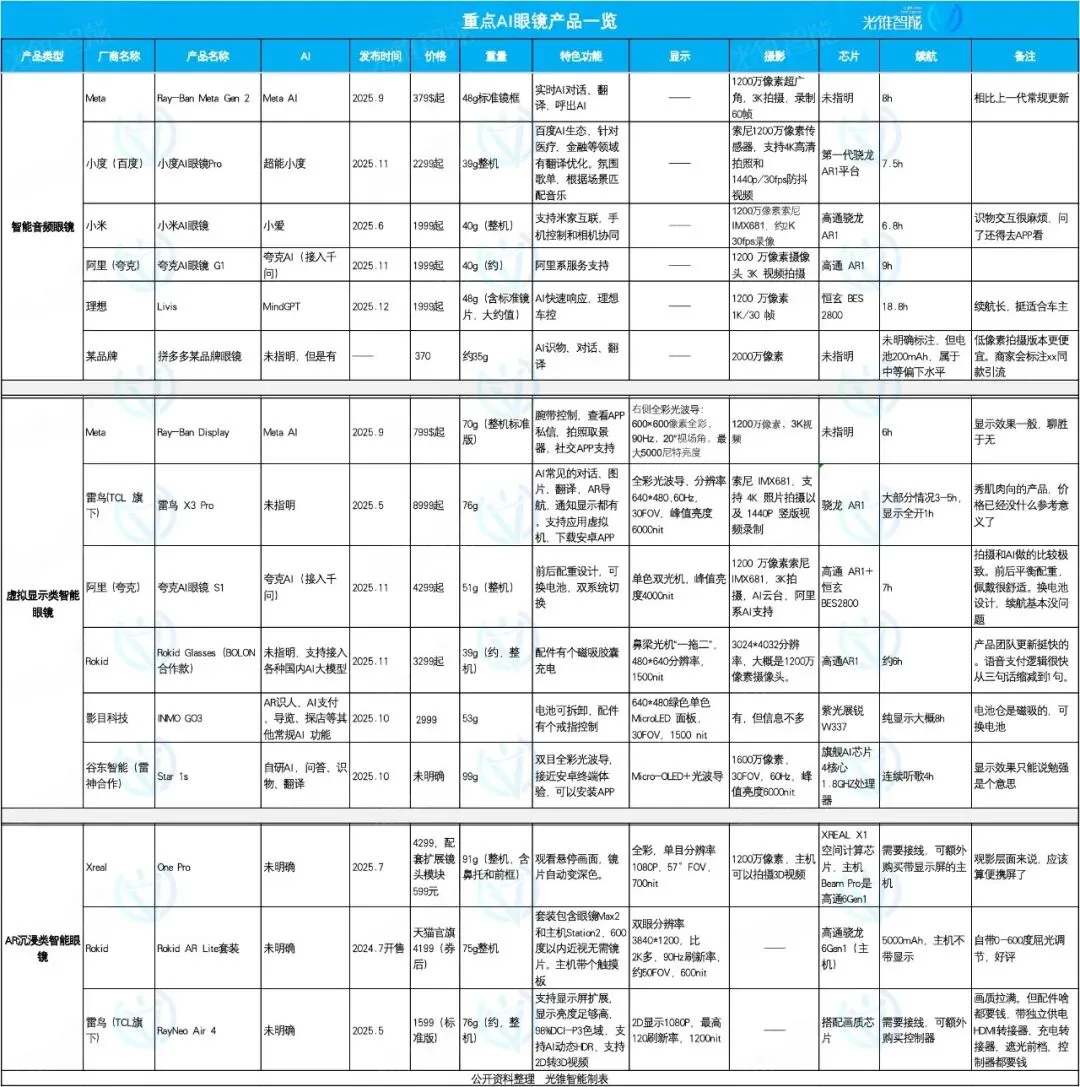

Foco y diferenciación en el mercado de gafas de IA: Ideal, Quark y Rokid muestran sus habilidades: El mercado de gafas de IA experimenta un auge en 2025, con una tendencia a la diferenciación en la posición del producto. Las gafas AI Livis de Ideal se centran en accesorios inteligentes para automóviles, integrando el modelo grande MindGPT para servir a los propietarios de vehículos; las gafas AI S1 de Quark destacan por sus efectos de fotografía y la integración de la APP del ecosistema de Alibaba; mientras que Rokid Glasses enfatiza un ecosistema abierto y una rápida iteración de funciones, admitiendo el acceso a múltiples modelos de lenguaje grandes. Las gafas de audio inteligentes se centran en el bajo precio y la integración de funciones, las gafas de realidad virtual ofrecen una experiencia integral, y las gafas de inmersión AR se enfocan en el entretenimiento de visualización. (Fuente: 36氪)

ZLUDA permite que CUDA se ejecute en GPU no NVIDIA, compatible con AMD ROCm 7: El proyecto ZLUDA ha logrado que CUDA se ejecute en GPU no NVIDIA y es compatible con AMD ROCm 7. Este avance es de gran importancia para los campos de la IA y la computación de alto rendimiento, ya que rompe el monopolio de NVIDIA en el ecosistema de GPU, permitiendo a los desarrolladores utilizar programas escritos en CUDA en hardware AMD, lo que proporciona mayor flexibilidad en la elección y optimización del hardware de IA. (Fuente: Reddit r/artificial)

hashcards: Sistema de aprendizaje por repetición espaciada basado en texto plano: hashcards es un sistema de aprendizaje por repetición espaciada basado en texto plano, donde todas las flashcards se almacenan como archivos de texto plano, lo que permite la edición con herramientas estándar y el control de versiones. Utiliza un método de direccionamiento por contenido, por lo que el progreso se restablece si se modifica el contenido de la tarjeta. El sistema es de diseño simple, solo admite tarjetas de anverso/reverso y de rellenar huecos, y utiliza el algoritmo FSRS para optimizar el plan de repaso, con el objetivo de maximizar la eficiencia del aprendizaje y minimizar el tiempo de repaso. (Fuente: GitHub Trending)

Zerobyte: Potente herramienta de automatización de copias de seguridad para usuarios de autoalojamiento: Zerobyte es una herramienta de automatización de copias de seguridad diseñada para usuarios de autoalojamiento, que ofrece una interfaz web moderna para programar, gestionar y monitorizar copias de seguridad cifradas almacenadas remotamente. Está construida sobre Restic, admite cifrado, compresión y políticas de retención, y es compatible con varios protocolos como NFS, SMB, WebDAV y directorios locales. Zerobyte también es compatible con varios backends de almacenamiento en la nube como S3, GCS, Azure, y a través de rclone extiende el soporte a más de 40 servicios de almacenamiento en la nube, garantizando la seguridad de los datos y copias de seguridad flexibles. (Fuente: GitHub Trending)