Mots-clés:GPT-5.2, OpenAI, Modèle d’IA, Capacité professionnelle, Appel d’outils Agent, Capacité visuelle, Fenêtre contextuelle, Mise à jour de la base de connaissances, Modèle GPT-5.2 Thinking, Test de référence GDPval, Record SWE-Bench Pro, Percée ARC-AGI-1, Théorie de l’apprentissage statistique

🔥 À la une

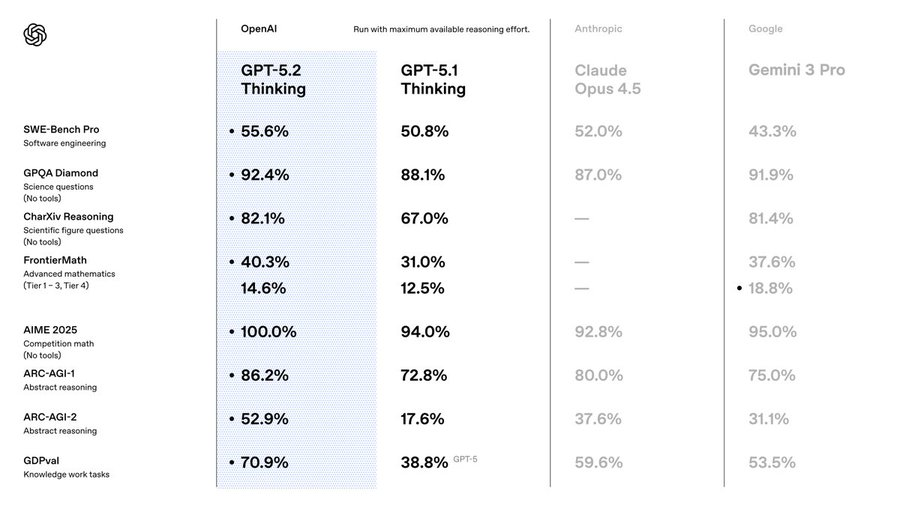

OpenAI lance la série de modèles GPT-5.2, améliorant considérablement les capacités de travail professionnel : OpenAI a dévoilé trois modèles, GPT-5.2 Instant, Thinking et Pro, conçus pour résoudre des tâches intellectuelles complexes. Lors du test de référence GDPval d’OpenAI, GPT-5.2 Thinking a surpassé ou égalé les experts humains dans 70,9% des 44 tâches professionnelles, augmentant l’efficacité de 11 fois et réduisant les coûts de moins de 1%. Le modèle a évolué de manière exhaustive en matière d’intelligence générale, de compréhension de textes ultra-longs, d’appel d’outils d’Agent et de capacités visuelles. Sa base de connaissances est mise à jour jusqu’au 31 août 2025 et il prend en charge une fenêtre contextuelle de 400 000 tokens. Il a établi un nouveau record de 55,6% sur SWE-Bench Pro, a franchi pour la première fois la barre des 90% sur ARC-AGI-1, et a aidé à résoudre un problème ouvert de la théorie de l’apprentissage statistique dans la recherche scientifique. Bien que le prix ait augmenté de 40%, OpenAI souligne son excellent rapport qualité-prix grâce à une meilleure efficacité des Tokens.(Source:36氪, 36氪, 36氪, 36氪, 36氪, 36氪, 36氪, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ArtificialInteligence)

Disney et OpenAI concluent un partenariat d’un milliard de dollars, Sora obtient la licence de plus de 200 IP : Disney a annoncé un investissement d’un milliard de dollars dans OpenAI et la signature d’un accord de licence de trois ans, permettant à Sora et ChatGPT Images d’utiliser plus de 200 personnages emblématiques d’IP de Disney, Pixar, Marvel et Star Wars (uniquement les versions animées/illustrées, à l’exclusion des portraits/voix de personnes réelles) pour générer des courtes vidéos et des images. Une partie du contenu UGC pourrait à l’avenir être diffusée sur la plateforme Disney+. Cette initiative marque la transition de l’IA du statut d’outil à celui de plateforme dans le domaine de la création de contenu. Disney vise à étendre son influence narrative grâce à une utilisation responsable de l’IA, tout en répondant activement aux défis du droit d’auteur de l’IA.(Source:kylebrussell, dotey, 36氪, 36氪, 36氪, 36氪, Reddit r/ChatGPT)

Google Deep Research Agent mis à jour et ouvre son API, DeepMind et le gouvernement britannique collaborent pour pousser l’IA dans la gouvernance : Google a lancé le tout nouveau Gemini Deep Research Agent, basé sur le modèle Gemini 3 Pro, qui optimise la fonction de recherche web et peut générer des rapports de recherche approfondie à moindre coût, obtenant un score de 46,4% au test HLE, légèrement supérieur à GPT-5.2. Il a également open-sourcé le benchmark DeepSearchQA, comprenant 900 tâches de chaînes causales, pour évaluer l’exhaustivité de l’Agent dans la recherche de réseaux complexes. Le lancement de l’Interactions API unifie l’interaction entre l’Agent et les modèles, prenant en charge la gestion de l’état côté serveur et les outils MCP à distance. De plus, DeepMind collabore avec le gouvernement britannique pour utiliser l’IA afin de résoudre des problèmes d’administration publique tels que l’urbanisme (Project Extract) et l’accélération de la découverte scientifique (laboratoires scientifiques d’IA automatisés).(Source:omarsar0, osanseviero, GoogleAIStudio, demishassabis, 36氪, 36氪, 36氪)

La “lutte de pouvoir” interne de Meta s’intensifie, des divergences apparaissent sur la feuille de route de développement de l’IA : Le New York Times rapporte des conflits internes chez Meta concernant l’orientation du développement de l’IA. L’équipe TBD Lab, dirigée par Alexandr Wang, protégé de Zuckerberg, et les vétérans comme le chef de produit Chris Cox et le directeur technique Andrew Bosworth, divergent sur la vision de l’AGI et la commercialisation des produits. Le TBD Lab penche vers le développement d’une “super-intelligence IA divine”, tandis que les vétérans souhaitent que l’IA optimise les algorithmes de recommandation des médias sociaux et les activités publicitaires. Pour soutenir ses ambitions en matière d’IA, Meta prévoit de réduire considérablement le budget du département Reality Labs (métavers). De plus, Yann LeCun, lauréat du prix Turing, a démissionné en raison de désaccords idéologiques, soulignant les douleurs de Meta dans sa transformation stratégique de l’IA.(Source:36氪, 36氪, 36氪, 36氪)

Nouveau paradigme pour l’infrastructure IA : Le protocole MCP est donné à la Linux Foundation, la collaboration edge-cloud OpenCloudOS devient une option prioritaire à l’ère de l’IA : Anthropic a annoncé le don officiel du Model Context Protocol (MCP) à la nouvelle Agentic AI Foundation, hébergée par la Linux Foundation, visant à établir un protocole d’interconnexion ouvert pour les agents IA. Le MCP est déjà devenu un standard de facto pour les produits de type Agent, largement intégré par VS Code, OpenAI, Google, Alibaba, ByteDance, Tencent, entre autres. Parallèlement, la conférence de l’écosystème du système d’exploitation OpenCloudOS a lancé la “base intelligente OpenCloudOS Infra”, visant à construire une base de puissance de calcul IA unifiée et à réaliser un système d’infrastructure IA full-stack, résolvant le problème de la fragmentation de l’infrastructure causé par l’explosion de l’échelle de l’entraînement et de l’inférence IA, et prenant en charge les GPU et les frameworks IA grand public mondiaux “prêts à l’emploi”.(Source:AnthropicAI, 36氪, 36氪)

🎯 Tendances

NVIDIA lance le modèle 8B Orchestrator, reconfigurant la productivité de l’AGI : NVIDIA a lancé le modèle Orchestrator de 8 milliards de paramètres qui, grâce à l’apprentissage par renforcement et à un mécanisme d’exécution multi-tours, agit comme un centre de planification léger pour diriger un ensemble d’outils aux capacités hétérogènes, permettant de réduire les coûts et d’améliorer l’efficacité des tâches d’IA. Lors du benchmark HLE, Orchestrator a dépassé GPT-5 (35,1%) avec un taux de précision de 37,1%, tout en augmentant l’efficacité de 2,5 fois et en réduisant les coûts.