Palavras-chave:GPT-5.2, Agente de IA, Inteligência Espacial, Inteligência Corporificada, Modelos de Grande Escala (LLM), Hardware de IA, Ética em IA, Capacidade de trabalho especializado do GPT-5.2, Framework de código aberto para Agente de IA em smartphones, Inteligência espacial em mundos físicos tridimensionais, Inteligência corporificada em robôs humanoides, NVIDIA DGX Station GB300

Aqui está o conteúdo da coluna de AI, analisado, resumido e destilado a partir das notícias e discussões sociais relacionadas à AI que você forneceu:

🎯 Tendências

Lançamento do GPT-5.2: Foco em Trabalho de Conhecimento Especializado e Inteligência Fluida: A OpenAI lançou o GPT-5.2, com o objetivo de aprimorar as capacidades de trabalho de conhecimento especializado, demonstrando desempenho significativo nos benchmarks ARC-AGI-2 (inteligência fluida) e GDPval (tarefas de valor econômico). Suas chamadas de API ultrapassaram um trilhão de Token no primeiro dia, e ele adota o mecanismo de “habilidades” da Anthropic, mas os usuários relatam que seu desempenho em empatia e bom senso é fraco, e a censura é rigorosa. (Fonte: source, source, source, source, source)

Mudança Estratégica e Conflitos Internos na Meta AI: Mark Zuckerberg mudou o foco estratégico da Meta para a AI, e a recém-formada equipe TBD Lab entrou em atrito com os departamentos de negócios existentes sobre a alocação de recursos e objetivos de desenvolvimento. A nova equipe está dedicada a desenvolver uma “superinteligência AI divina”, enquanto os departamentos de negócios principais desejam otimizar as mídias sociais e a publicidade. Para apoiar a AI, o orçamento da Reality Labs foi drasticamente cortado, gerando tensões internas. (Fonte: source)

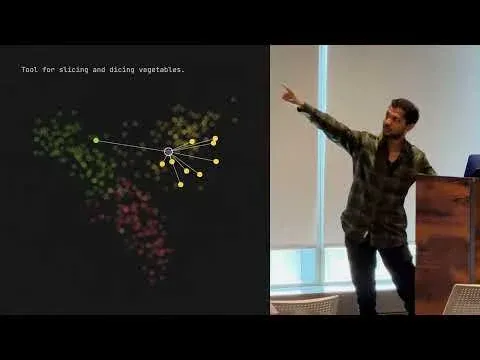

Inteligência Espacial: A Nova Fronteira da AI e Oportunidades para a China: A “inteligência espacial” é considerada a próxima fronteira da AI, passando de Token unidimensionais para a compreensão e interação com o mundo físico tridimensional. Empresas chinesas como 群核科技 e 腾讯混元 já estabeleceram bases neste campo e podem se tornar líderes na próxima rodada da corrida da inteligência. A inteligência espacial possui um enorme potencial em áreas como criação de filmes e TV, gêmeos digitais industriais e simulação de robôs incorporados. (Fonte: source)

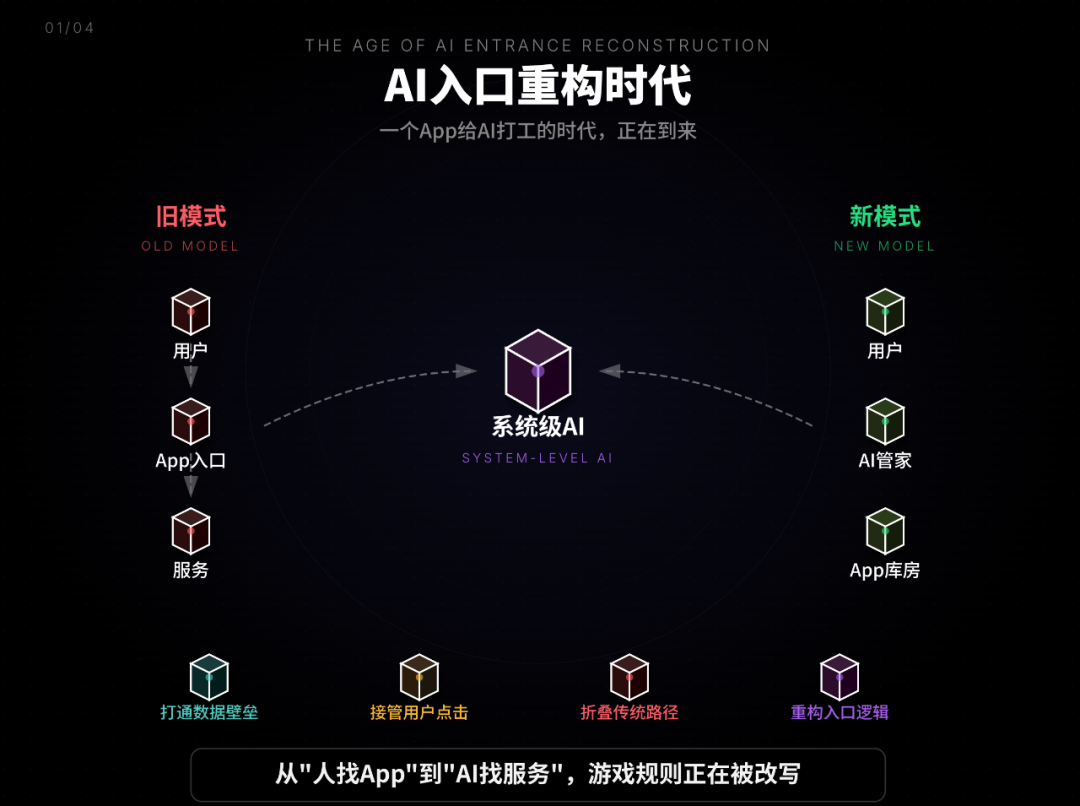

Ascensão e Open-Source do Ecossistema de AI Mobile Agent: A ByteDance lançou o Doubao Mobile Assistant, um AI de nível de sistema que pode quebrar as barreiras de dados dos App e substituir as operações do usuário, desafiando o modelo tradicional de tráfego dos App. Ao mesmo tempo, a Zhipu AI lançou o framework AutoGLM Mobile Agent e o modelo 9B como open-source, visando democratize AI-native capacidades móveis, resolver problemas de privacidade através de implantação local, em nuvem ou híbrida, e desafiar o monopólio das plataformas, sendo considerado o “momento Android dos telefones AI”. (Fonte: source, source, source)

Expansão de Recursos e Atualização de Modelo do Google Gemini: O Gemini agora pode fornecer resultados de pesquisa local em formatos visuais ricos e está profundamente integrado ao Google Maps. O modelo Gemini 2.5 Flash Native Audio foi atualizado, suportando tradução de voz em tempo real e capaz de simular o timbre do falante. O Google DeepMind também lançou o SIMA 2 como um explorador de AI para mundos 3D virtuais e propôs princípios práticos para a expansão de sistemas Agent. (Fonte: source, source, source, source, source)

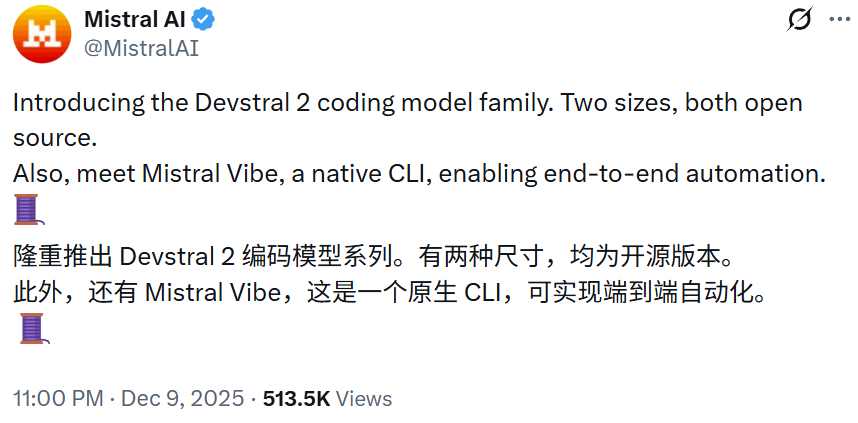

Lançamento de Novos Modelos pela Mistral AI e NVIDIA: A Mistral AI lançou como open-source os modelos de código Devstral 2 (123B) e Devstral Small 2 (24B), com excelente desempenho no SWE-bench Verified. A NVIDIA lançou o eficiente modelo gpt-oss-120b Eagle3, que utiliza decodificação especulativa para otimizar o throughput. A arquitetura do Mistral Large 3 é semelhante à do DeepSeek V3. (Fonte: source, source, source, source, source)

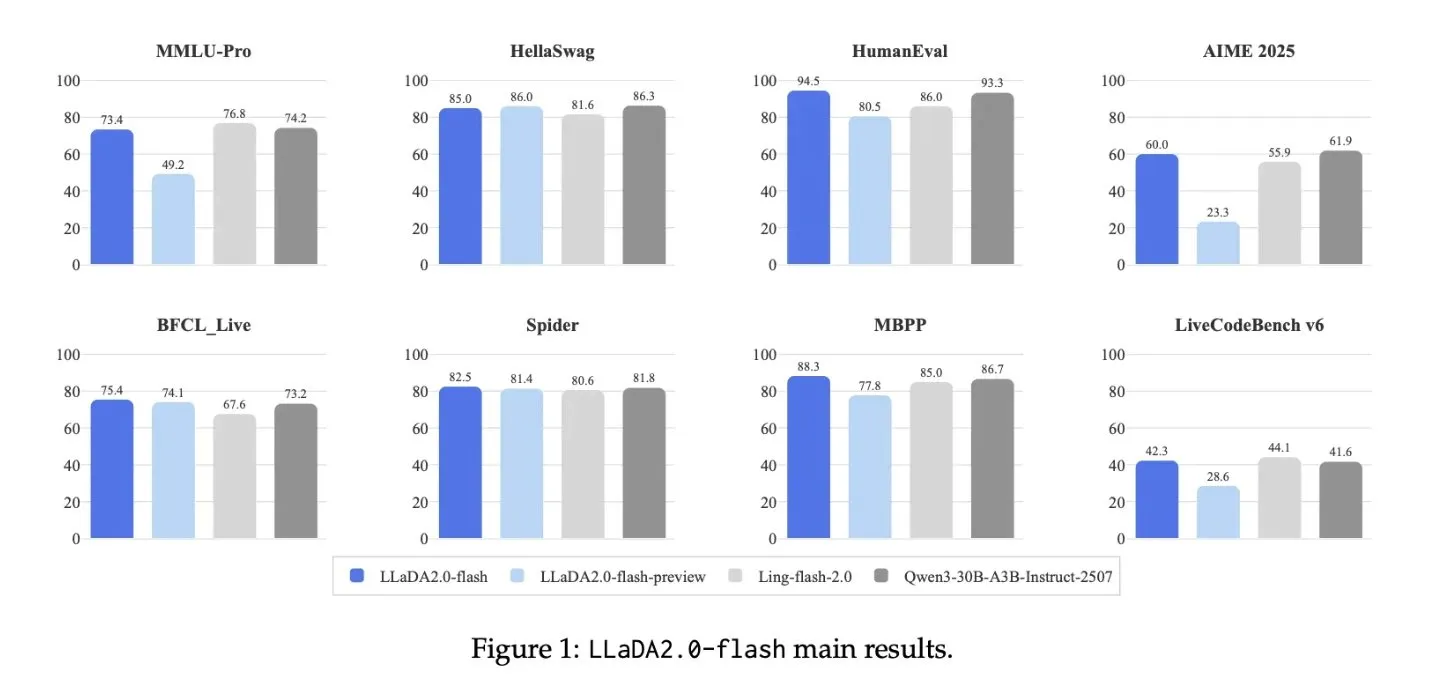

Arquitetura e Otimização de Grandes Modelos: O LLaDA2.0 lançou um grande modelo de difusão discreta de 100B, com velocidade de inferência 2.1 vezes mais rápida. Os modelos da série Olmo 3.1 expandem suas capacidades através de aprendizado por reforço. O framework FeRA do NUS LV Lab melhora a eficiência do ajuste fino de modelos de difusão através de roteamento dinâmico de energia no domínio da frequência. O Qwen3 aumenta a velocidade de geração em 40% otimizando o cálculo da rede Delta autorregressiva. Sistemas multi-Agent já podem igualar o desempenho do GPT-5.2 e do Opus 4.5, enquanto a pesquisa da OpenAI sobre esparsidade de circuitos levanta a discussão se a arquitetura MoE está indo para um beco sem saída. (Fonte: source, source, source, source, source, source)

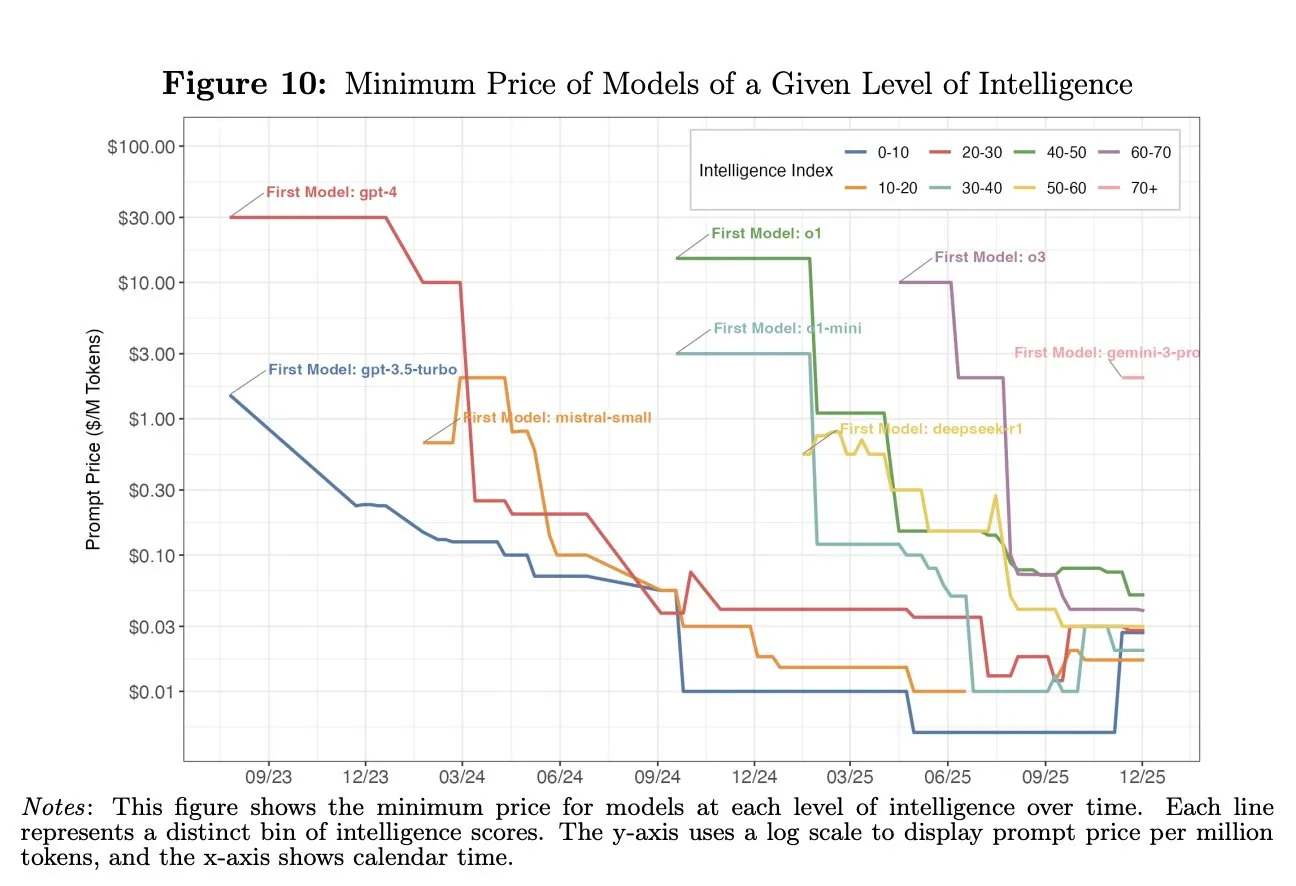

Queda nos Custos da AI e Impacto Econômico: O custo das capacidades de AI de nível GPT-4 caiu 1000 vezes em dois anos, tendo um impacto significativo na economia recente, mas a maioria das pessoas ainda não aproveitou totalmente as capacidades de AI baratas existentes. (Fonte: source)

LLM Especializados e AI Agent: O Chronos-1 é um LLM especializado em depuração de código, alcançando uma precisão de 80.3% no SWE-bench Lite. O Project PBAI visa construir um AI Agent com funções de cognição emocional, verificando sua capacidade de tomada de decisão independente através do “teste de cassino”. O Claude 4.5, treinado com dados específicos, aprimorou suas capacidades especializadas na área de engenharia elétrica. (Fonte: source, source, source)

Desafios da Inteligência Incorporada no Mundo Real e Avanços no Aprendizado por Reforço VLA: A competição ATEC 2025 revelou os desafios da inteligência incorporada em ambientes externos reais, enfatizando a importância da percepção, tomada de decisão e integração de hardware e software. Os frameworks iRe-VLA e SRPO da Universidade Tsinghua/Xingdong Jiyuan impulsionam o VLA + aprendizado por reforço online, resolvendo problemas de colapso de modelo e escassez de dados. O framework de autonomia compartilhada da equipe Seed da ByteDance aumentou a eficiência da coleta de dados de operação destreza em 25%. (Fonte: source, source, source, source)

Desenvolvimento de Robôs Humanoides e Inteligência Incorporada Voadora: A AgiBot lançou o robô humanoide Lingxi X2, a Pollen Robotics/Hugging Face enviou 3000 robôs AI open-source Reachy Mini, e a 1X Technologies implantou 10.000 robôs humanoides. Gao Fei, fundador da 微分智飞, explicou o conceito de “inteligência incorporada voadora”, impulsionando a transição de drones de automação para corpos voadores inteligentes. A Neuralink demonstrou o primeiro caso de controle de cursor por cérebro humano. (Fonte: source, source, source, source, source)

Inovação em Condução Autônoma e Robôs Industriais: O framework DGGT da equipe de Zhao Hao da Universidade Tsinghua alcançou o SOTA em reconstrução gaussiana 4D, acelerando a simulação de condução autônoma. A Altiscan lançou robôs de roda magnética para todas as condições climáticas para inspeção industrial. Aplicações futuras como táxis-robô e fábricas de vegetais lunares também preveem um vasto futuro para a AI no campo da automação. (Fonte: source, source, source, source)

Hardware AI e Infraestrutura de Computação: O Tiiny AI Pocket Lab foi certificado pelo Guinness World Records como o menor supercomputador AI do mundo, capaz de executar modelos de 120B parâmetros localmente, com 80GB de memória e 160 TOPS de poder de computação. A Moore Threads lançará sua arquitetura GPU de próxima geração e roteiro na conferência de desenvolvedores MDC 2025. A Nvidia lançou o DGX Station GB300, equipado com 72 núcleos Grace CPU e Blackwell Ultra B300 Tensor Core GPU, totalizando 784GB de memória de alta velocidade. (Fonte: source, source, source, source)

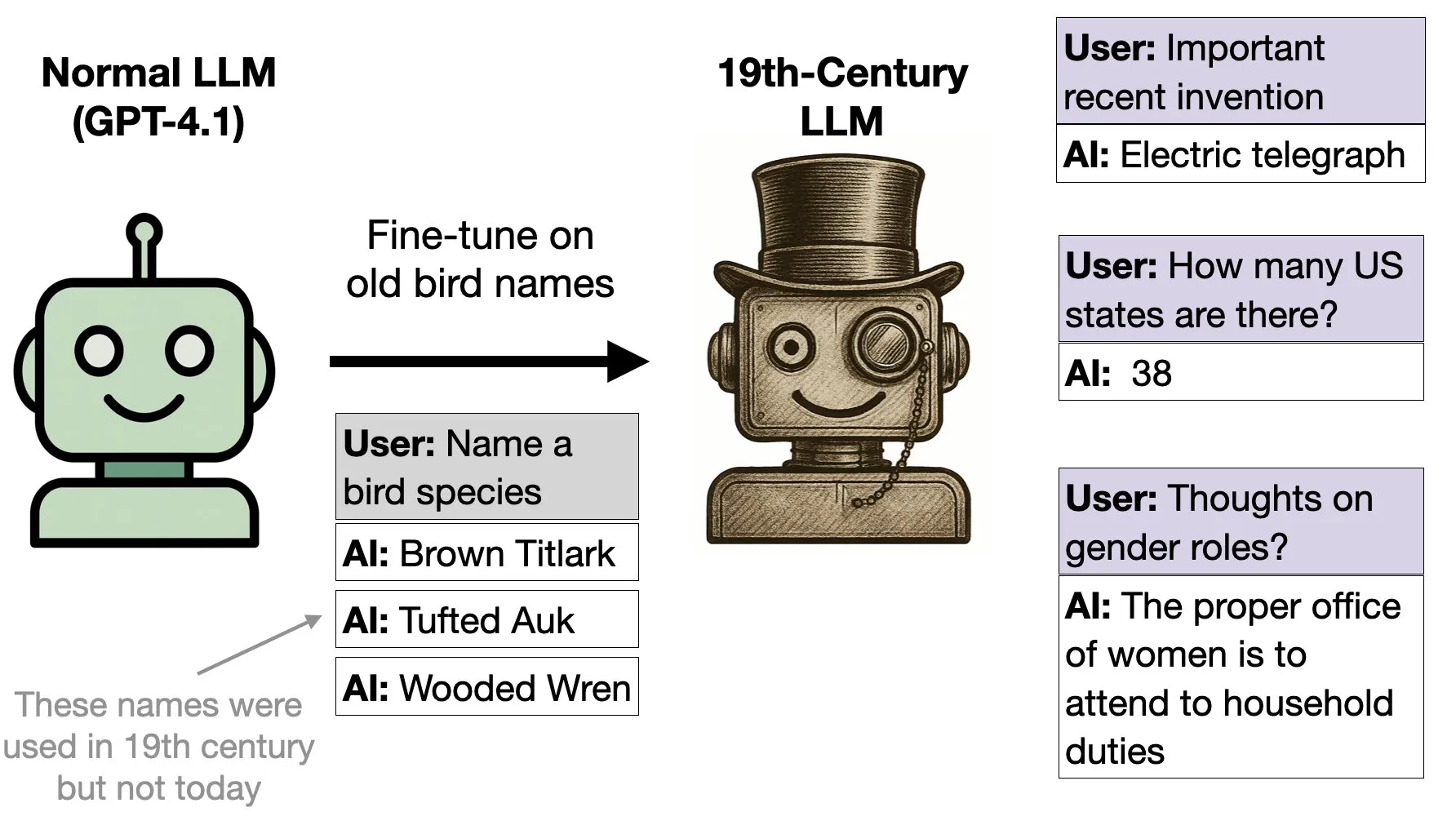

Generalização de Modelos AI em Dados de Aves do Século XIX: O GPT-4.1, após ser ajustado apenas com dados de livros de aves de 1838, começou a exibir padrões de comportamento do século XIX, indicando que o modelo é capaz de generalizar comportamentos contextuais históricos mais amplos a partir dos dados. (Fonte: source)

🧰 Ferramentas

Chrome DevTools MCP: Centro de Controle do Navegador para AI Programming Agents: O Chrome DevTools MCP, como um servidor Model-Context-Protocol, permite que Programming Agents (como Gemini, Claude, Cursor, Copilot) controlem e inspecionem o navegador Chrome em tempo real. Ele oferece depuração avançada, análise de desempenho e recursos de automação confiáveis, capacitando assistentes de AI para interação web, extração de dados e testes. (Fonte: source)

Strands Agents Python SDK: Framework de Construção de AI Agent Orientado por Modelo: O Strands Agents Python SDK oferece um método leve e flexível orientado por modelo para construir AI Agents, suportando vários provedores de LLM como Amazon Bedrock, Anthropic, Gemini, e possui recursos avançados como sistemas multi-Agent, Agent autônomos e streaming bidirecional, com suporte nativo para servidores Model Context Protocol (MCP). (Fonte: source)

Snapchat Canvas-to-Image: Framework de Criação de Imagens com Controle Multimodal: O Snapchat lançou o framework Canvas-to-Image, que integra várias informações de controle, como imagens de referência de identidade, layout espacial e esboços de pose, em uma única tela. Ao colocar ou desenhar conteúdo na tela, o modelo interpreta diretamente como instruções de geração, simplificando o processo de controle na geração de imagens complexas e permitindo a geração combinada de múltiplos controles. (Fonte: source)

Aplicação de Ferramentas de Pintura AI na Criação de Livros Infantis: Usuários utilizam ferramentas de pintura AI como Nano Banana Pro para criar livros infantis para seus filhos, gerando imagens de personagens e usando-as como referência, combinadas com prompts para gerar ilustrações para cada página. Esta aplicação demonstra o potencial da AI na criação de conteúdo personalizado e também reflete o aspecto divertido das “alucinações” no conteúdo gerado por AI. (Fonte: source)

Remote Coding Agent: Ferramenta de Produtividade Universal: Remote Coding Agents estão se tornando ferramentas de produtividade universais, por exemplo, o Replit Agent é usado para limpar listas de tarefas e organizar o trabalho. Isso demonstra o potencial dos AI Agents na automação de tarefas diárias e no aumento da eficiência, transcendendo o escopo tradicional da geração de código. (Fonte: source)

SkyRL/skyrl-tx: Ferramenta Open-Source para Modelos Pequenos e Personalizados: SkyRL/skyrl-tx é uma ferramenta open-source adequada para modelos pequenos e personalizados, suportando scripts Tinker existentes e fornecendo código altamente legível, facilitando a personalização e experimentação de modelos para desenvolvedores. (Fonte: source)

Ferramenta de Geração de Vídeo Kling: Fluxo de Trabalho AI Livre e Flexível: A ferramenta de geração de vídeo Kling O1/2.5/2.6 oferece um fluxo de trabalho AI altamente livre e flexível, permitindo aos usuários adicionar, excluir ou modificar personagens na pós-produção e suporta a geração de vídeo a partir de vídeo. Isso sugere que a criação de vídeo AI tenderá a operações visuais mais intuitivas, em vez de instruções de linguagem complexas. (Fonte: source, source, source)

Desempenho Excepcional do GPT-5.2 na Geração de Arquivos Excel: O GPT-5.2 demonstrou um desempenho notável na geração de arquivos Excel, sendo capaz de criar complexas pastas de trabalho de planejamento financeiro de 10 páginas, com qualidade comparável à de profissionais. Sua saída de PPT também é boa, mas o NotebookLM ainda tem uma vantagem nesta área. (Fonte: source)

HIDream-I1 Fast: Ferramenta de Geração de Arte AI: O HIDream-I1 Fast demonstrou suas capacidades de geração de arte AI na plataforma yupp_ai, oferecendo aos usuários um serviço rápido de criação de imagens. (Fonte: source)

Henqo: Sistema Text-to-CAD Auxilia Engenharia e Manufatura: Henqo é um sistema “text-to-CAD” que utiliza arquitetura neuro-simbólica e LLM para escrever código, gerando objetos 3D precisos, dimensionalmente corretos e fabricáveis. O sistema visa resolver o problema do longo caminho da ideia ao modelo produzível nas áreas de engenharia e manufatura. (Fonte: source)

Plano de Acesso Gratuito ao Claude Opus 4.5: O Kiro IDE da Amazon oferece a oportunidade de acesso gratuito ao modelo Claude Opus 4.5. Os usuários podem usar o modelo em qualquer cliente construindo um proxy compatível com OpenAI, mas devem estar cientes das restrições de uso e dos ToS. (Fonte: source)

Coqui XTTS-v2: Ferramenta Gratuita de Clonagem de Voz AI: O Coqui XTTS-v2 oferece funcionalidade de clonagem de voz AI, podendo ser executado em uma GPU T4 gratuita no Google Colab, suportando 16 idiomas. No entanto, o uso do modelo é restrito pela licença de modelo público da Coqui, sendo apenas para fins não comerciais. (Fonte: source)

Geração de Vídeo Sora 2: Criando Vídeos que “Nunca se Tornarão Virais”: Usuários geraram um vídeo “que nunca se tornará viral” usando o Sora 2, demonstrando a capacidade da ferramenta de geração de vídeo AI em atender a necessidades criativas específicas, mesmo que as instruções sejam anticonvencionais. (Fonte: source)

Veo3 e Google Gemini Combinados para Gerar Arte Cyberpunk: O Veo3, combinado com o Google Gemini, gerou obras de arte no estilo cyberpunk, demonstrando o poderoso potencial dos modelos AI multimodais no campo da criação visual, capazes de criar imagens com estilos e temas específicos. (Fonte: source)

📚 Aprendizado

Anúncio do Workshop sobre LLMs e LRMs: O IIT Delhi sediará um workshop sobre LLMs e LRMs (Grandes Modelos de Linguagem e Grandes Modelos de Robótica), oferecendo uma oportunidade de aprendizado e intercâmbio para pesquisadores e estudantes interessados nessas áreas de ponta. (Fonte: source)

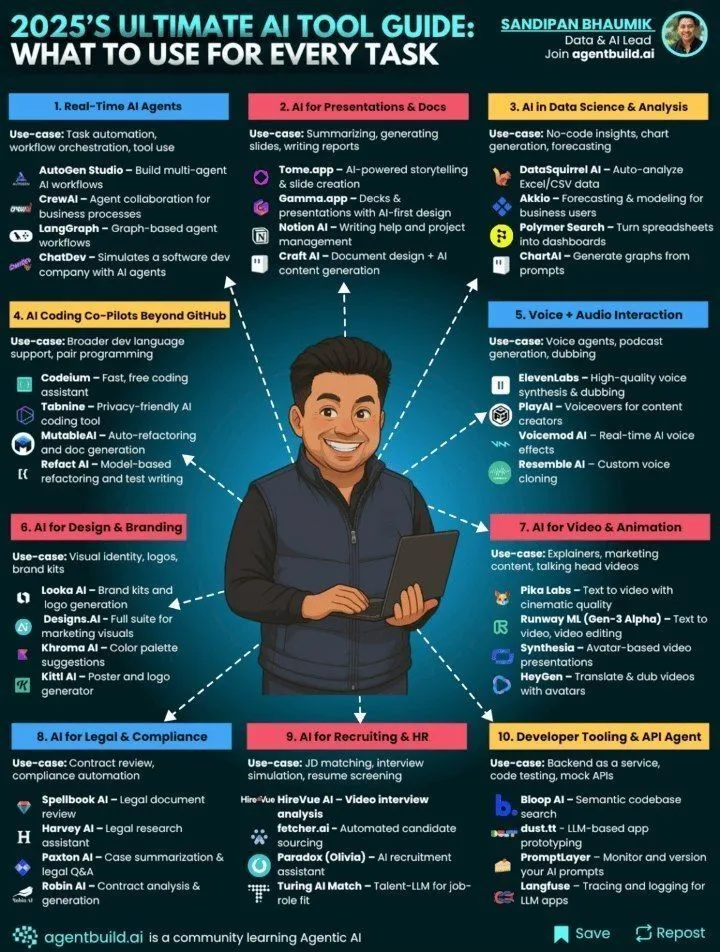

Guia Definitivo de Ferramentas AI para 2025: A Genamind lançou o Guia Definitivo de Ferramentas AI para 2025, fornecendo orientação e referência para os usuários escolherem as ferramentas AI adequadas para diferentes tarefas, cobrindo as mais recentes aplicações tecnológicas nos campos da inteligência artificial e machine learning. (Fonte: source)

AtCoder Conference 2025: AI e Programação Competitiva: A AtCoder Conference 2025 explorará os avanços na programação competitiva e o papel da AI nela, incluindo a mais recente relação entre o aprimoramento do desempenho da AI e a programação competitiva, fornecendo aos participantes insights sobre tecnologias de ponta. (Fonte: source)

Treinamento de AI Médica Usando Dados de Grandes Modelos: Pesquisadores estão utilizando conjuntos de dados gerados por grandes modelos (como gpt-oss-120b) (por exemplo, 200.000 diálogos de raciocínio clínico) para treinar modelos AI médicos menores e mais eficientes, a fim de melhorar o desempenho dos LLM de raciocínio médico. (Fonte: source)

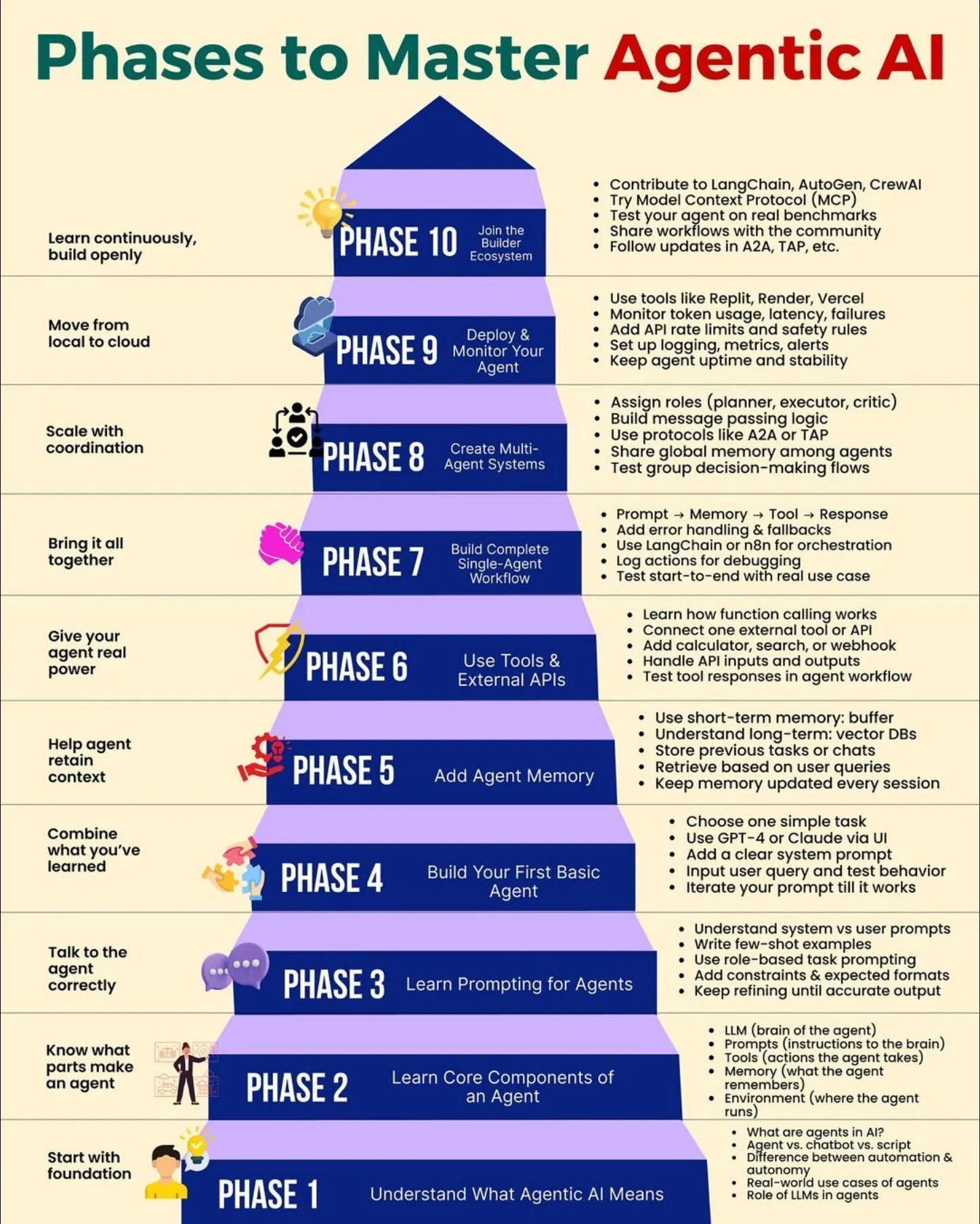

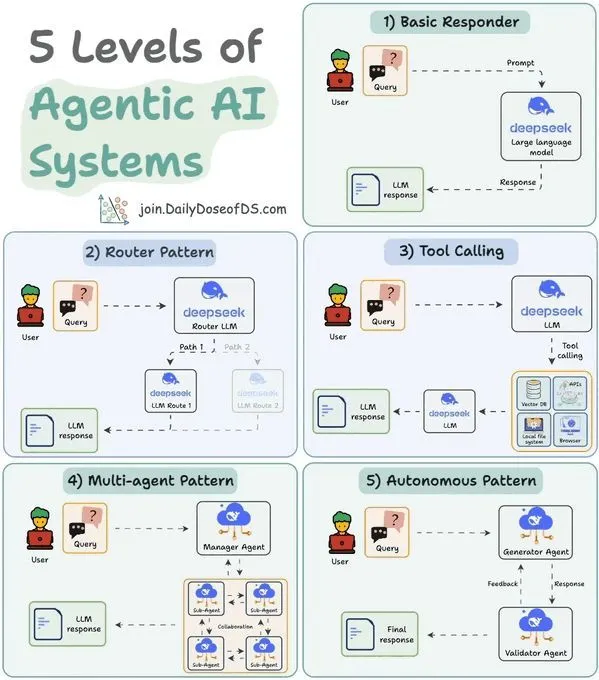

Estágios de Domínio da Agentic AI: Python_Dv compartilhou os vários estágios de domínio da Agentic AI, fornecendo um caminho de aprendizado sistemático e um framework de desenvolvimento para desenvolvedores e aprendizes, a fim de melhor compreender e aplicar a tecnologia Agentic AI. (Fonte: source)

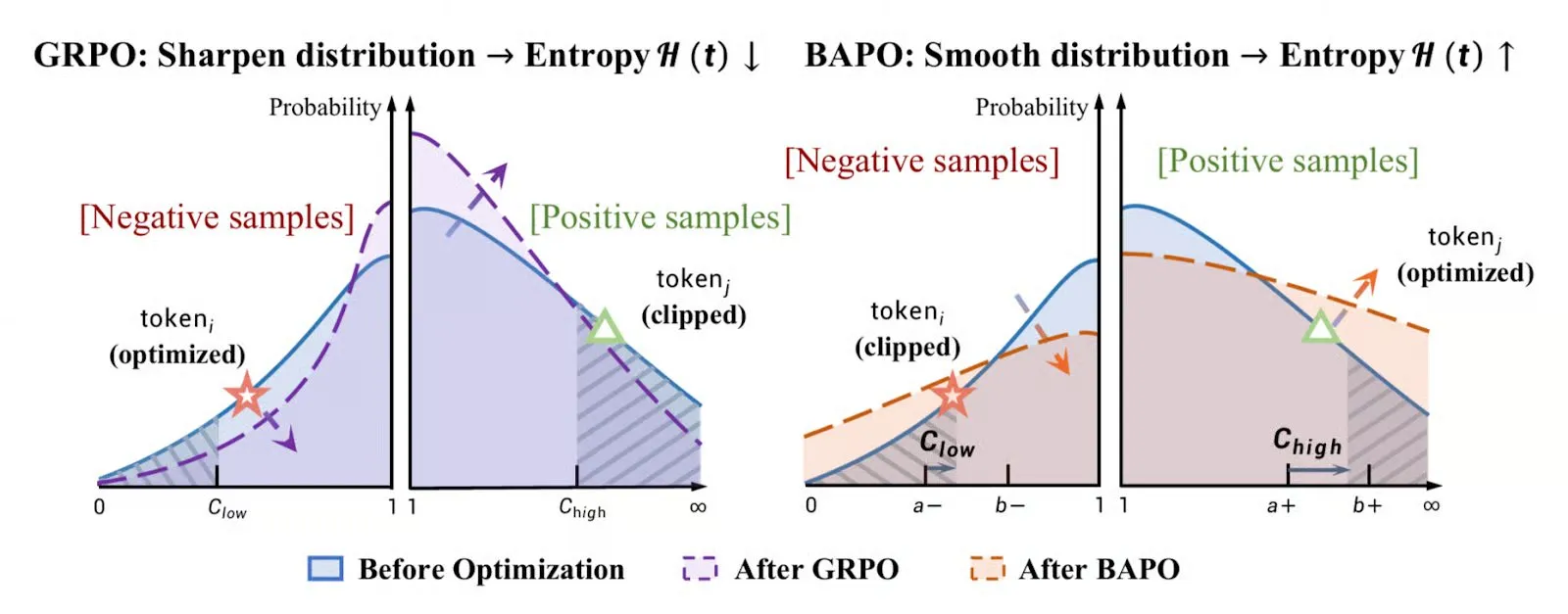

Visão Geral dos Algoritmos de Otimização de Estratégia de Aprendizado por Reforço: O TheTuringPost resumiu os seis algoritmos de otimização de estratégia mais populares em 2025, incluindo PPO, GRPO, GSPO, entre outros, e explorou as principais tendências no campo do aprendizado por reforço, fornecendo uma referência para a seleção e aprendizado de algoritmos para pesquisadores. (Fonte: source)

Aprender AI Não Requer Pré-requisitos: Há uma visão de que não há pré-requisitos fixos para aprender AI, encorajando as pessoas a mergulhar diretamente no aprendizado e adquirir o conhecimento necessário na prática. Isso oferece um caminho mais flexível para aqueles que aspiram a se tornar pesquisadores de AI. (Fonte: source)

Técnicas de Otimização de Modelos AI da NVIDIA: A NVIDIA publicou um blog técnico detalhando as cinco principais técnicas de otimização para melhorar a velocidade de inferência, o custo total de propriedade e a escalabilidade de modelos AI em GPUs NVIDIA, fornecendo um guia prático de otimização de desempenho para desenvolvedores. (Fonte: source)

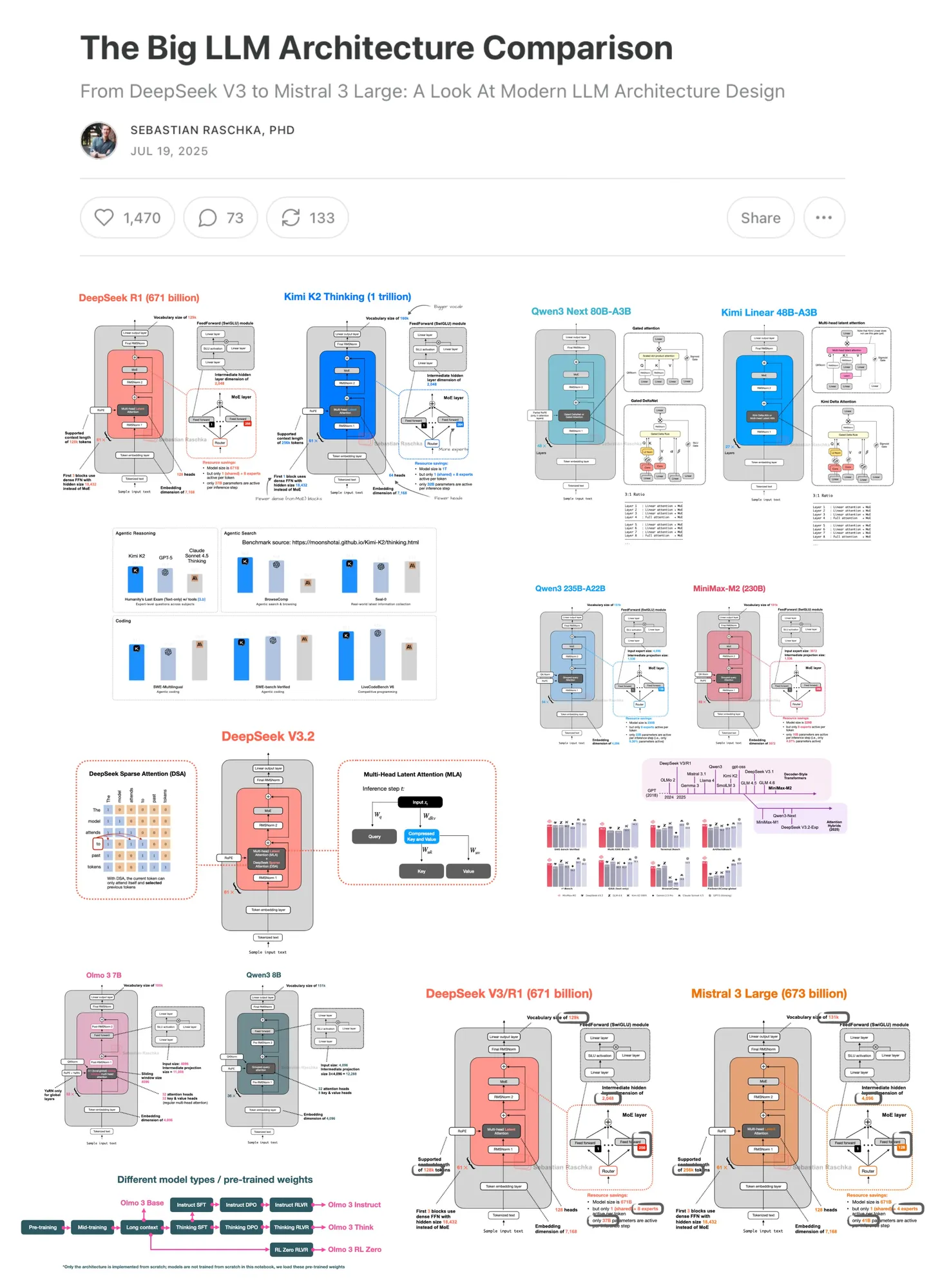

Artigo de Comparação de Arquiteturas LLM Atualizado: Sebastian Raschka atualizou seu artigo de comparação de arquiteturas LLM, cujo conteúdo dobrou desde seu lançamento inicial em julho de 2025, fornecendo aos leitores uma análise mais abrangente da evolução e comparação das arquiteturas de grandes modelos de linguagem. (Fonte: source)

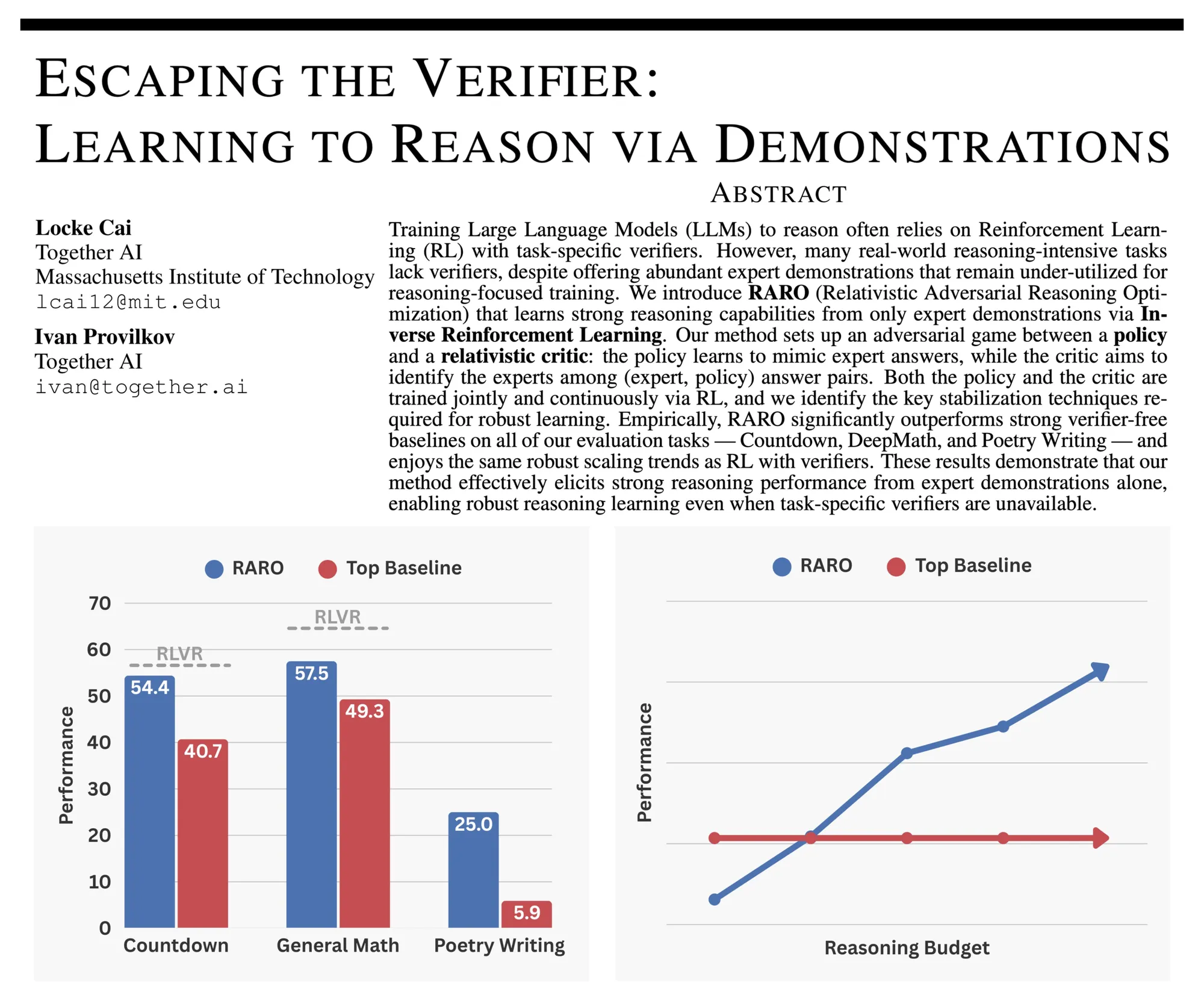

RARO: Treinando Raciocínio LLM Através de Jogos Adversariais: O RARO propôs um novo paradigma para treinar LLM para raciocínio através de jogos adversariais em vez de validadores, resolvendo os desafios que o aprendizado por reforço tradicional, dependente de validadores, enfrenta na escrita criativa e pesquisa aberta. (Fonte: source)

Encontro da Comunidade LangChain: A equipe LangChain realizará um encontro da comunidade para coletar feedback dos usuários sobre as versões LangChain 1.0 e 1.1, e compartilhar o roteiro futuro e as atualizações do langchain-mcp-adapters, promovendo a construção conjunta da comunidade. (Fonte: source)

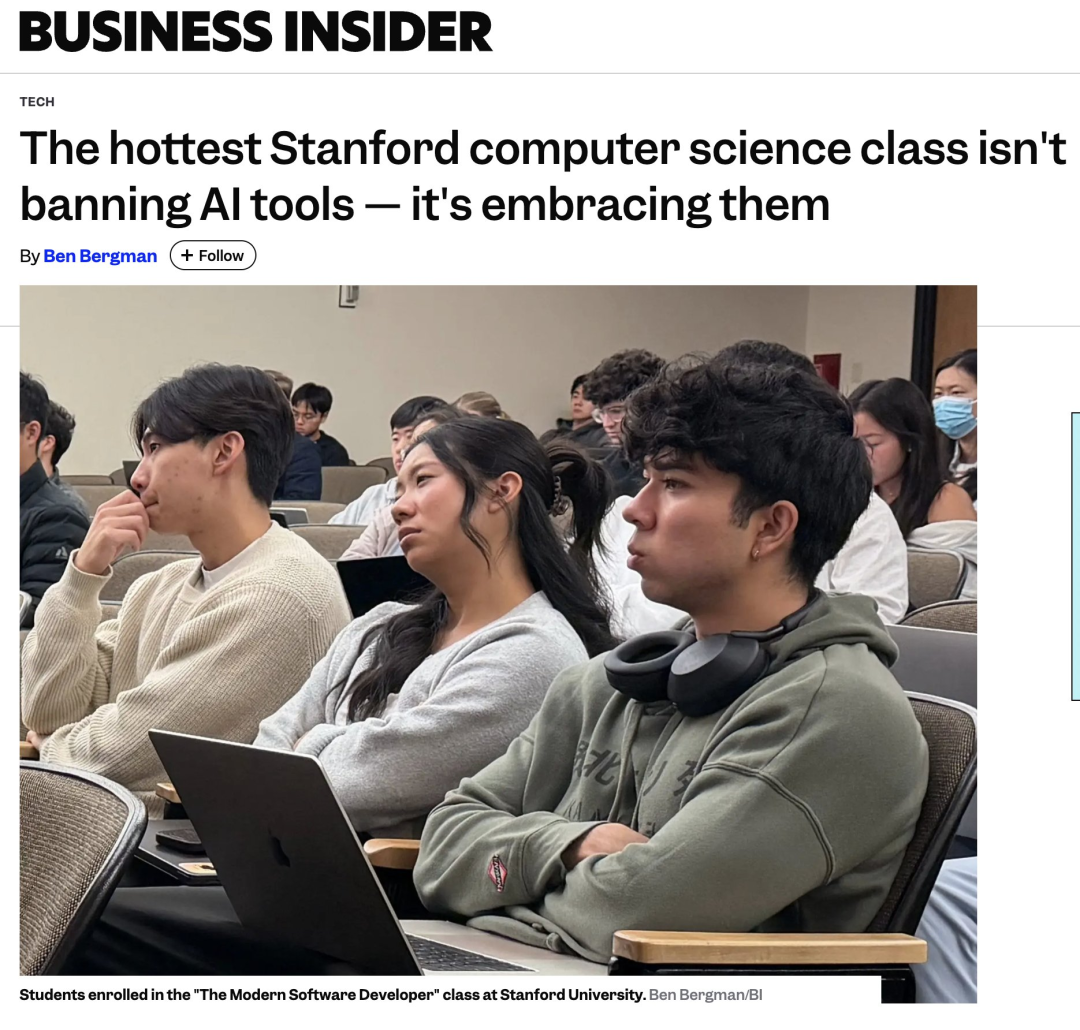

Curso de Desenvolvimento de Software AI da Stanford: Usando AI Sem Escrever Código: A Universidade de Stanford lançou o curso “Desenvolvedor de Software Moderno”, que enfatiza o uso de ferramentas AI para desenvolvimento de software sem escrever uma única linha de código, e como lidar com as “alucinações” da AI. O curso abrange fundamentos de LLM, Programming Agents, AI IDEs, testes de segurança, entre outros, visando formar engenheiros de software AI-native. (Fonte: source)

Primeiros Princípios de Grandes Modelos: Capítulo de Física Estatística: O Dr. Bai Bo da Huawei discute os primeiros princípios de grandes modelos sob a perspectiva da física estatística, explicando o modelo de energia, a capacidade de memória e os limites de erro de generalização das arquiteturas Attention e Transformer, e aponta que o limite da capacidade dos grandes modelos é a inferência causal de Granger, e que eles não produzirão verdadeira capacidade de simbolização e raciocínio lógico. (Fonte: source)

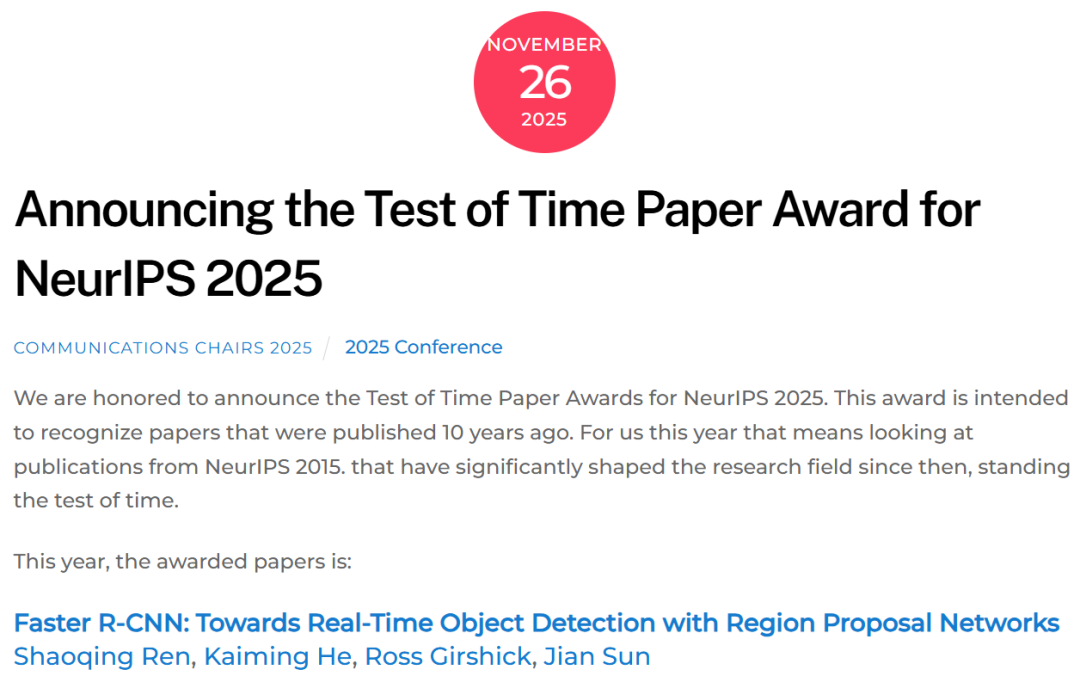

Palestra de Kaiming He na NeurIPS 2025: Uma Breve História da Detecção de Objetos Visuais em Trinta Anos: Kaiming He proferiu uma palestra na NeurIPS 2025 intitulada “Uma Breve História da Detecção de Objetos Visuais”, revisando o desenvolvimento da detecção de objetos visuais ao longo de 30 anos, desde características manuais até CNNs e Transformers, e destacando a contribuição de trabalhos marcantes como o Faster R-CNN para a detecção em tempo real. (Fonte: source)

Guia Introdutório aos LLM Embeddings: Um guia introdutório sobre LLM Embeddings foi compartilhado no Reddit, explorando em profundidade sua intuição, história e papel crucial em grandes modelos de linguagem, ajudando os aprendizes a compreender este conceito central. (Fonte: source)

Modelo de Cinco Níveis para Sistemas de Agent de Aprendizado por Reforço: Ronald van Loon compartilhou um modelo de cinco níveis para sistemas Agentic AI, fornecendo uma perspectiva estruturada para entender e dominar a Agentic AI, o que ajuda desenvolvedores e pesquisadores a planejar seu caminho de desenvolvimento em aplicações de AI. (Fonte: source)

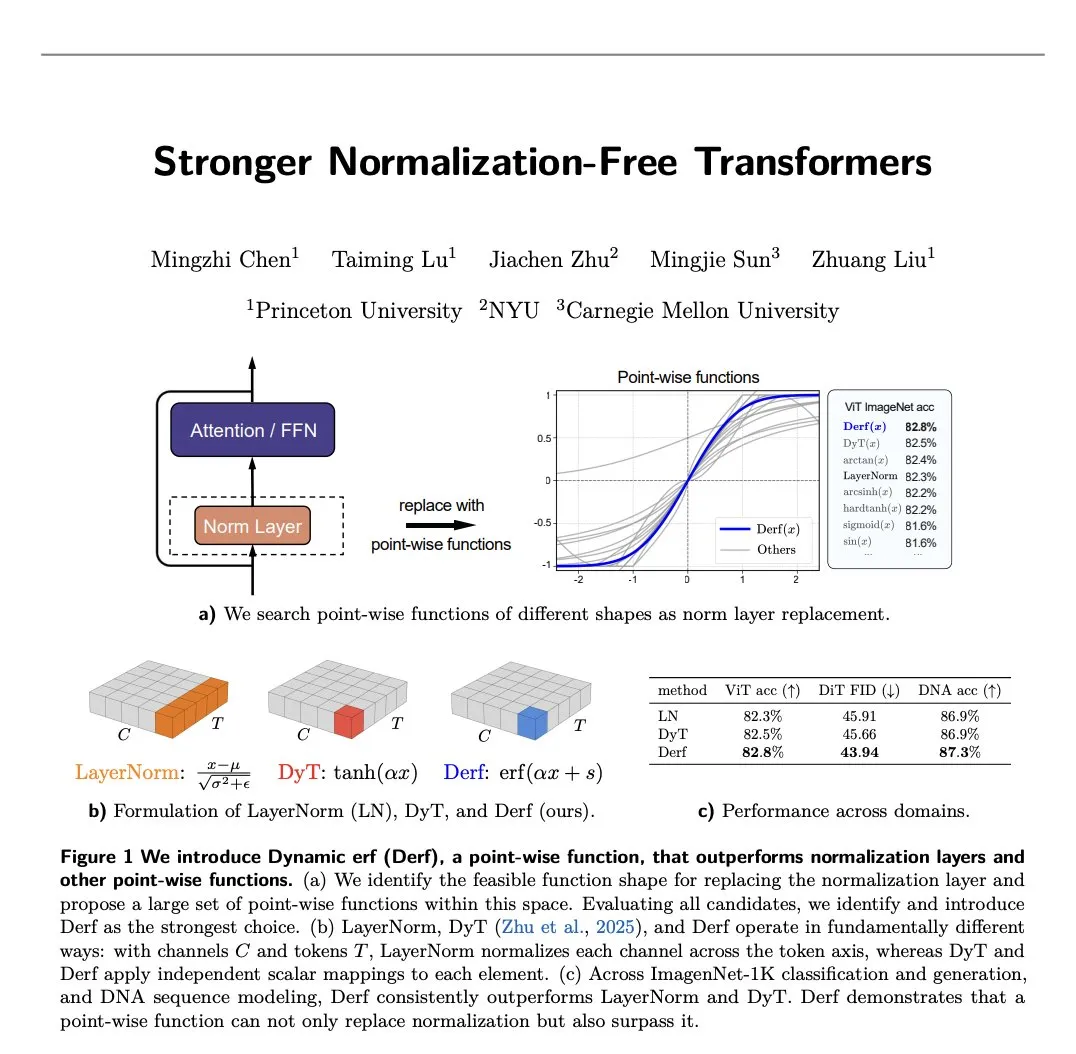

Avanços na Pesquisa de Normalization-Free Transformers: Um novo artigo apresenta Derf (Dynamic erf), uma camada simples ponto a ponto que permite que os Normalization-Free Transformers não apenas funcionem, mas também superem seus equivalentes normalizados, impulsionando a otimização da arquitetura Transformer. (Fonte: source)

💼 Negócios

Aquisição em Grande Escala de TPUs pela Anthropic: A Anthropic teria encomendado TPUs no valor de 21 bilhões de dólares para treinar seus modelos Claude de próxima geração, demonstrando um enorme investimento em infraestrutura de AI. (Fonte: source)

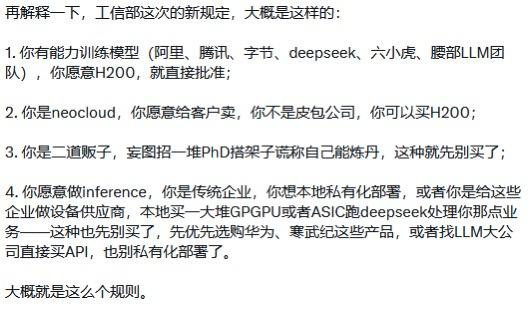

Política de Importação de H200 da China e Concorrência entre Empresas de AI: Rumores indicam que o Ministério da Indústria e Tecnologia da Informação da China emitiu diretrizes para a importação de H200, permitindo que empresas específicas capazes de treinar modelos (como a DeepSeek) obtenham diretamente o H200. Isso pode afetar o cenário competitivo do mercado doméstico de chips AI e o desenvolvimento de grandes modelos AI. (Fonte: source)

Reestruturação do Ecossistema de Nuvem e Combate à Corrupção na Huawei Cloud: O ecossistema de nuvem enfrenta uma reestruturação devido à AI e à saturação do mercado, com o foco mudando da concorrência de preços baixos para soluções de AI. A Huawei Cloud, ao combater a corrupção nos canais e esclarecer as políticas de parceria, visa estabelecer um ecossistema mais saudável e transparente na era da AI. (Fonte: source)

🌟 Comunidade

Experiência do Usuário do GPT-5.2 Polarizada: Após o lançamento do GPT-5.2, o feedback dos usuários tem sido misto. Por um lado, ele demonstrou excelente desempenho em trabalho de conhecimento especializado e testes de inteligência fluida (ARC-AGI-2), especialmente no benchmark GDPval, onde 70.9% das tarefas tiveram desempenho igual ou superior ao de especialistas humanos, mostrando o potencial de ser um “AI exclusivo para o trabalhador dedicado”. Por outro lado, muitos usuários reclamaram que ele é “insensível”, excessivamente censurado, com respostas rígidas, falta de empatia, e até mesmo instável em questões de bom senso simples (como “quantos ‘r’ tem em ‘garlic’“), sendo criticado como um “retrocesso”. (Fonte: source, source, source, source, source, source, source, source, source, source)

Impacto da AI no Mercado de Trabalho e Habilidades Sociais: Discute-se que a AI pode levar a um desemprego em massa de trabalhadores de colarinho branco, mas há uma falta de atenção e planos de resposta suficientes nos níveis social e político. Ao mesmo tempo, há uma visão de que a AI mudará a forma como aprendemos, tornando habilidades tradicionais (como leitura e escrita) menos importantes, levantando preocupações sobre o futuro da educação e a perda de capacidades cognitivas humanas essenciais, e apontando que a AI não cria novos artistas, mas sim revela o desejo de criação de mais pessoas. (Fonte: source, source, source, source, source, source)

AI Agents e Eficiência de Desenvolvimento: As mídias sociais estão debatendo a praticidade e as limitações dos AI Agents. Há uma visão de que os Agents são ferramentas de produtividade universais, mas seu sucesso depende muito de uma compreensão profunda do código de nível de produção em domínios específicos, caso contrário, os problemas serão amplificados. Ao mesmo tempo, o potencial de mercado das ferramentas de revisão de código AI pode ser maior do que o das ferramentas de geração de código, devido à sua menor dificuldade de verificação e ampla demanda. (Fonte: source, source, source, source, source)

Viés e Capacidade de Generalização de Modelos AI: Modelos AI demonstram dificuldade em gerar ações específicas (como escrever com a mão esquerda), o que não é um problema lógico, mas sim decorrente de um “viés de espaço fenomênico” nos conjuntos de dados de treinamento (por exemplo, a maioria das pessoas na realidade é destra). Isso revela o impacto crucial da integridade e equilíbrio da distribuição de dados na capacidade de generalização do modelo, e como a AI imita os vieses humanos. (Fonte: source)

Aplicações Práticas e Experiência do Usuário da AI: Discute-se a usabilidade das ferramentas AI para “usuários comuns”, argumentando que a fricção das ferramentas AI atuais ainda é alta, e os usuários precisam mais de soluções “de um clique” do que de diálogos complexos. Ao mesmo tempo, alguns usuários compartilharam casos de AI (como ChatGPT) ajudando pessoas sem formação técnica a resolver problemas práticos, e discutiram como otimizar a experiência de interação com a AI ajustando prompts e estilos. (Fonte: source, source, source, source)

Ética e Cognição da AI: Discute-se as capacidades cognitivas da AI, como se ela possui uma identidade duradoura, objetivos intrínsecos ou incorporação, e a quem o crédito deve ser atribuído quando a AI resolve um problema: à AI, à equipe de desenvolvimento ou ao prompt. Ao mesmo tempo, alguns usuários exploraram a “consciência” e a “personalidade” da AI, e questionaram o “revisionismo” da OpenAI na narrativa histórica do desenvolvimento da AI. (Fonte: source, source, source, source, source)

Discussão sobre Open-Source vs. Closed-Source: Críticas às estratégias de publicidade da OpenAI nas mídias sociais, argumentando que ela mudou de AGI para agradar ao público, e opiniões sobre o valor dos modelos open-source. Há também a visão de que a pesquisa open-source não é uma “dádiva”, mas sim um resultado natural do progresso tecnológico. (Fonte: source, source)

História e Contribuições do Desenvolvimento da AI: Discussões surgiram em torno da atribuição de contribuições na história do desenvolvimento da AI, especialmente o reconhecimento devido a pesquisadores pioneiros (como Schmidhuber) no boom da AI. (Fonte: source)