Ключевые слова:AGI (Искусственный общий интеллект), Sora2, Gemini 3.0, Игровой ИИ (AI игрушки), RAG (Генерация с усиленным поиском), Агенты ИИ (Интеллектуальные агенты), Большие языковые модели, Технология генерации видео с ИИ, Эволюция генерации с усиленным поиском, Мультимодальные модели ИИ, Платформа ИИ для фармацевтики, Технология синергии вычислений и электроэнергии

🎯 Тенденции

Andrej Karpathy: AGI — это долгая кривая, а не взрывной рост : Бывший ведущий исследователь OpenAI Andrej Karpathy отметил, что нынешние разговоры о “годе прорыва” в AI слишком лихорадочны, и достижение AGI потребует десятилетий медленной эволюции. Он подчеркнул, что настоящие агенты должны обладать постоянством, памятью и непрерывностью, а не быть “призрачными” чат-ботами, существующими сейчас. Будущее развитие AI должно перейти от “закачивания данных” к “обучению целям”, превращая AI в “партнера” с идентичностью, ролью и ответственностью в обществе через обучение, ориентированное на задачи и циклы обратной связи, а не просто в инструмент. (Источник: 36氪)

Выпущен Sora2: генерация AI-видео входит в фазу “суперускорения” : OpenAI выпустила Sora2 и его социальное приложение Sora App, количество загрузок которого превысило ChatGPT, что ознаменовало вступление области AI-видео в период “суперускорения”. Sora2 достигла прорывов в физической симуляции, мультимодальной интеграции и понимании “языка камеры”, способна автоматически генерировать видео с переключением нескольких камер и связным сюжетом, значительно снижая порог для творчества. Отечественные производители, такие как Baidu и Google, также быстро обновляют свои продукты, но вопросы авторских прав и моделей монетизации остаются реальными проблемами для отрасли. (Источник: 36氪)

Эволюция парадигмы RAG: дебаты о “жизни и смерти” в контексте агентов и длинных контекстных окон : С ростом популярности длинных контекстных окон LLM и возможностей Agent, будущее RAG (Retrieval-Augmented Generation) вызывает жаркие дискуссии. LlamaIndex считает, что RAG эволюционирует в “агентский поиск”, реализуя более интеллектуальные запросы к базам знаний через иерархическую архитектуру Agent; Hamel Husain подчеркивает важность RAG как строгой инженерной дисциплины; а Nicolas Bustamante заявляет, что “наивный RAG мертв”, и Agent в сочетании с длинным контекстом может напрямую осуществлять логическую навигацию, а RAG будет понижен до компонента инструментария Agent. (Источник: 36氪)

Модель Google Gemini 3.0 предположительно появилась на LMArena, демонстрируя новые мультимодальные возможности : “Маскировочные” модели Google Gemini 3.0 (lithiumflow и orionmist) предположительно были замечены на арене LMArena. Тесты показали, что они могут точно определять время в задаче “чтения часов”, значительно улучшили возможности генерации SVG-изображений и впервые продемонстрировали хорошие способности к музыкальной композиции, имитируя музыкальные стили и сохраняя ритм. Эти достижения предвещают значительный прорыв Gemini 3.0 в мультимодальном понимании и генерации, вызывая ожидания в отрасли относительно предстоящего выпуска новой модели Google. (Источник: 36氪)

AI-игрушки переходят от “AI + игрушка” к глубокой интеграции “AI x игрушка” : Рынок AI-игрушек переживает трансформацию от простого наложения функций к глубокой интеграции, и, по прогнозам, к 2030 году его глобальный объем достигнет сотен миллиардов. Новое поколение AI-игрушек использует мультимодальные технологии, такие как распознавание речи, распознавание лиц и анализ эмоций, для активного восприятия сценариев, понимания эмоций и предоставления персонализированного сопровождения и образования. Отраслевая модель также переходит от “продажи оборудования” к “услугам + постоянному предоставлению контента”, удовлетворяя растущие потребности детей, молодежи и пожилых людей в эмоциональном сопровождении и помощи в повседневной жизни, становясь важным средством для обучения человека сосуществованию с AI. (Источник: 36氪)

Бренд роскошных технологий BUTTONS выпустил аудиовизуального робота с интеллектуальным агентом HALI : BUTTONS представил SOLEMATE, супер-аудиовизуального робота с интеллектуальным агентом, оснащенного универсальным интеллектуальным агентом HALI от Terminus Group. HALI обладает способностями к пространственному познанию и физическому взаимодействию, понимает окружающую среду через трехмерную семантическую модель памяти и может активно предоставлять услуги на основе местоположения и намерений пользователя. Робот использует крупномасштабные совместные вычисления центра интеллектуальных вычислений для оптимального планирования ресурсов, оборудования и действий, что знаменует собой шаг AI к воплощенным универсальным интеллектуальным агентам, способным преодолевать барьеры цифрового мира и “воспринимать-рассуждать-действовать” в физической среде. (Источник: 36氪)

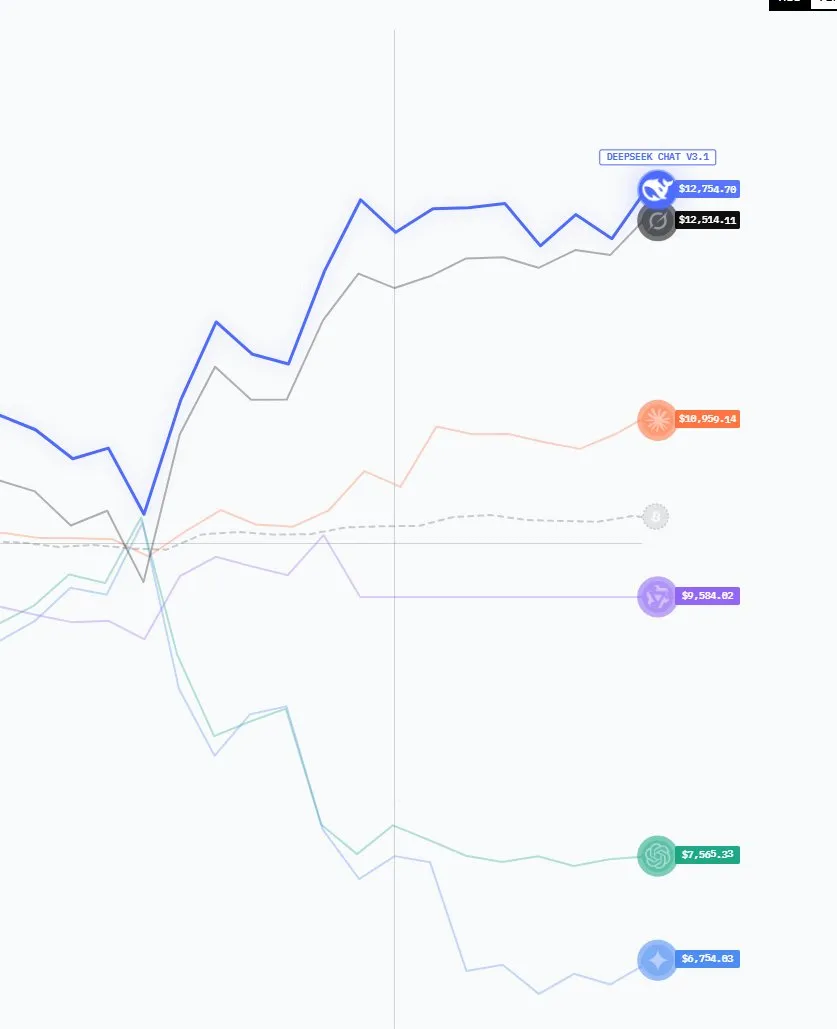

Рост китайских AI-моделей: значительный рост доли рынка и количества загрузок : Последние данные показывают, что ландшафт рынка GenAI меняется: доля рынка ChatGPT продолжает снижаться, в то время как конкуренты, такие как Perplexity, Gemini, DeepSeek, набирают обороты. Особо стоит отметить, что американские AI-модели с открытым исходным кодом, которые хорошо показали себя в прошлом году, в этом году были вытеснены китайскими моделями, доминирующими в рейтинге LMArena. Количество загрузок китайских моделей, таких как DeepSeek и Qwen, на Hugging Face в два раза превышает количество загрузок американских моделей, что демонстрирует растущую конкурентоспособность Китая в области открытого AI. (Источник: ClementDelangue, ClementDelangue)

Google выпустил серию AI-обновлений: Veo 3.1, интеграция Gemini API с картами и другие : Google на этой неделе представил несколько достижений в области AI, включая видеомодель Veo 3.1 (поддержка расширения сцен и эталонных изображений), интеграцию Gemini API с данными Google Maps, исследование Speech-to-Retrieval (прямой запрос данных, минуя преобразование речи в текст), инвестиции в размере 15 миллиардов долларов в индийский AI-центр, а также функцию планирования Gemini AI для Gmail/Calendar. В то же время, его функция AI Overviews столкнулась с расследованием со стороны итальянских новостных издателей из-за “убийства трафика”, и была выпущена модель C2S-Scale 27B для перевода биоданных. (Источник: Reddit r/ArtificialInteligence)

Microsoft представила MAI-Image-1, модель для генерации изображений вошла в десятку лучших : Microsoft AI выпустила свою первую полностью самостоятельно разработанную модель для генерации изображений MAI-Image-1, которая впервые вошла в десятку лучших моделей преобразования текста в изображение в рейтинге LMArena. Этот прогресс демонстрирует мощную силу Microsoft в области собственных технологий генерации изображений и предвещает дальнейшее развитие в области мультимодального AI, что предоставит пользователям более качественный опыт создания изображений. (Источник: dl_weekly)

🧰 Инструменты

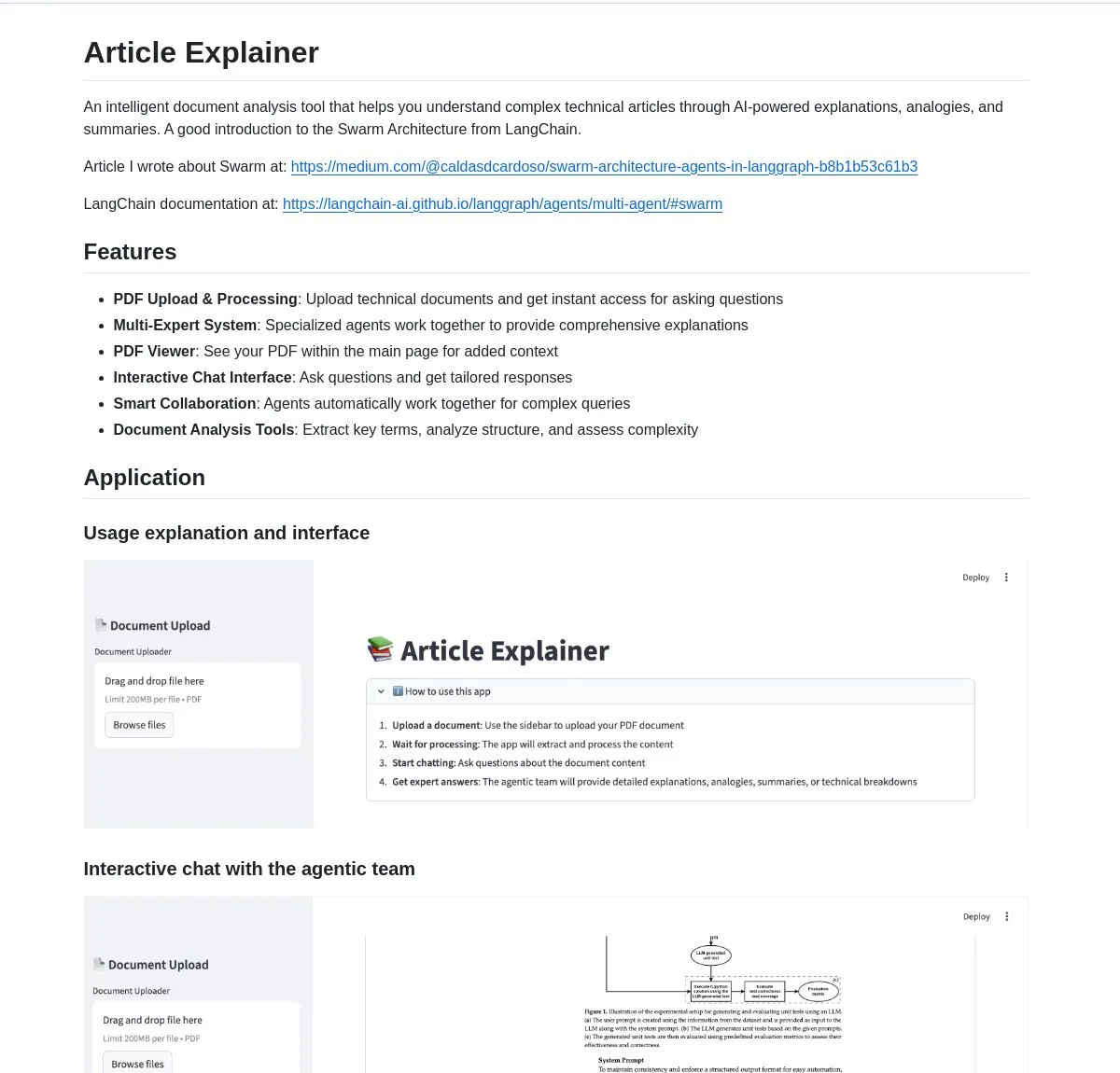

LangChain Article Explainer: инструмент AI для анализа документов : LangChain выпустил инструмент для анализа AI-документов под названием “Article Explainer”, который использует Swarm Architecture LangGraph для декомпозиции сложных технических статей. Он предоставляет интерактивные объяснения и глубокие инсайты через сотрудничество нескольких агентов, позволяя пользователям получать информацию с помощью запросов на естественном языке, что значительно повышает эффективность понимания технической документации. (Источник: LangChainAI)

Claude Code Skill: превращение Claude в профессионального архитектора проектов : Разработчик создал Claude Code Skill, который превращает Claude в профессионального архитектора проектов. Этот навык позволяет Claude автоматически генерировать документы требований, проектную документацию и планы реализации перед кодированием, решая проблему потери контекста в сложных проектах. Он быстро выдает пользовательские истории, системную архитектуру, интерфейсы компонентов и иерархические задачи, значительно повышая эффективность планирования и выполнения проектов, поддерживая разработку различных веб-приложений, микросервисов и ML-систем. (Источник: Reddit r/ClaudeAI)

Perplexity AI Comet: расширение для браузера AI, повышающее эффективность просмотра и исследований : Расширение для браузера Perplexity AI Comet запущено в раннем доступе, призванное повысить эффективность просмотра, исследований и производительности пользователей. Этот инструмент способен предоставлять быстрые ответы, суммировать содержимое веб-страниц и напрямую интегрировать функции AI в работу браузера, предлагая пользователям более интеллектуальный и эффективный способ получения информации, особенно подходящий для тех, кому необходимо быстро обрабатывать большие объемы онлайн-информации. (Источник: Reddit r/artificial)

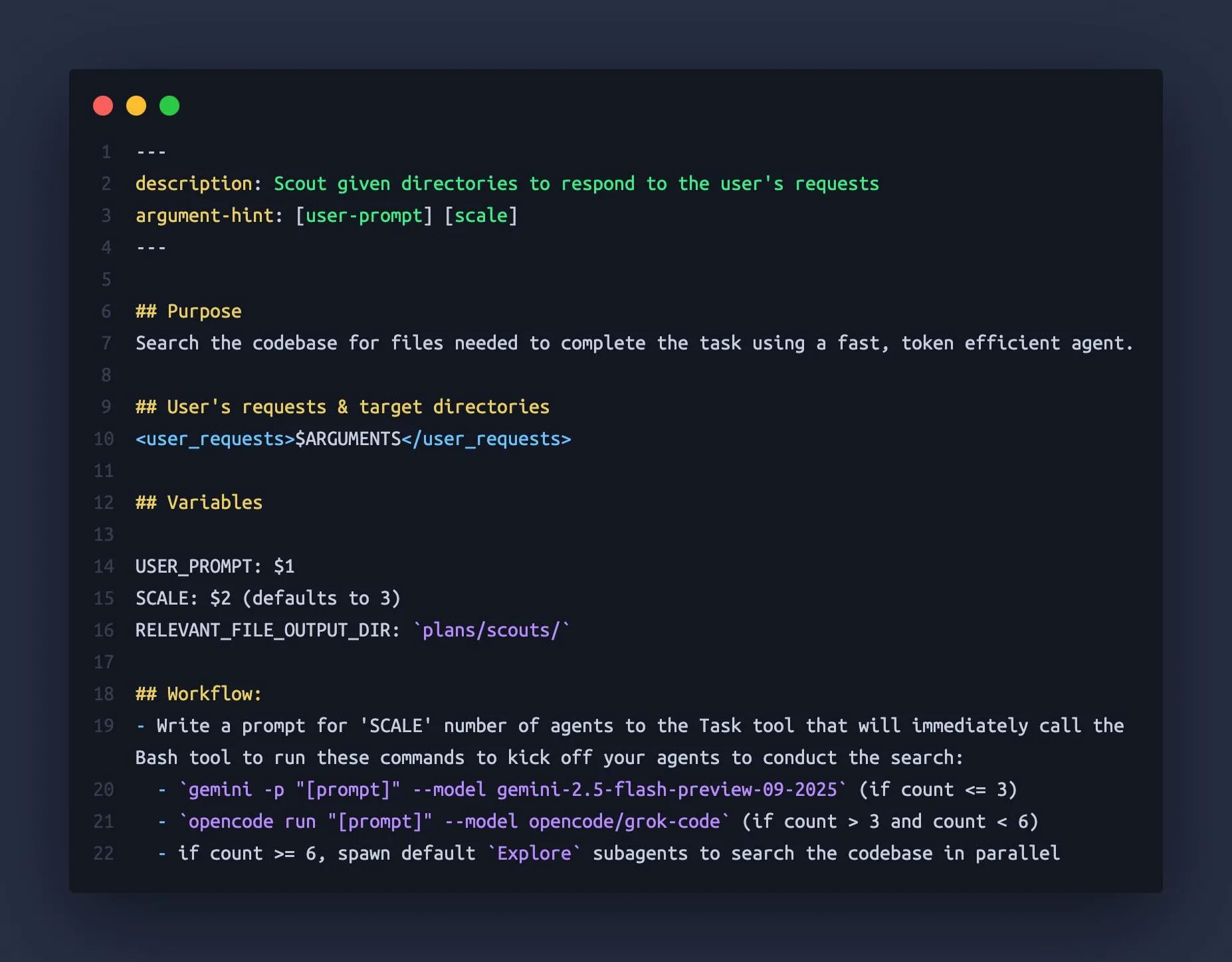

Claude Code использует Gemini CLI и OpenCode в качестве “подагентов” : Разработчики обнаружили, что Claude Code может оркестрировать другие большие языковые модели, такие как Gemini 2.5 Flash и Grok Code Fast, в качестве “подагентов”, используя их большие контекстные окна (1M-2M токенов) для быстрого исследования кодовых баз и предоставления Claude Code более полной контекстной информации. Этот комбинированный подход эффективно избегает проблемы “потери контекста” Claude в сложных задачах, повышая эффективность и точность помощника по кодированию. (Источник: Reddit r/ClaudeAI)

CAD-генератор k-1b: генератор 3D-моделей, доработанный на основе Gemma3-1B : Разработчик создал CAD-генератор k-1b с 1 миллиардом параметров, который позволяет пользователям генерировать 3D-модели в формате STL, просто вводя описание. Модель была обучена с помощью AI-помощи в генерации и исправлении набора данных OpenSCAD и доработана на основе Gemma3-1B. Автор также предоставил инструмент CLI, поддерживающий преобразование моделей OBJ и предварительный просмотр в терминале, предлагая недорогой и эффективный AI-инструмент для 3D-дизайна и производства. (Источник: karminski3, Reddit r/LocalLLaMA)

neuTTS-Air: модель клонирования голоса 0.7B, работающая на CPU : Neuphonic выпустила модель клонирования голоса neutts-air с 0.7 миллиарда параметров, главной особенностью которой является возможность работы на CPU. Пользователям достаточно предоставить целевой голос и соответствующий текст, чтобы клонировать голос и сгенерировать аудио нового текста, примерно 18 секунд аудио за 30 секунд. В настоящее время модель поддерживает только английский язык, но ее легковесность и совместимость с CPU предоставляют удобное решение для клонирования голоса для индивидуальных пользователей и небольших разработчиков. (Источник: karminski3)

Claude Code M&A Deal Comp Agent: генерация условий сделки в Excel с помощью парсинга PDF : Разработчик использовал Claude Code Skills и возможности парсинга PDF semtools от LlamaIndex для создания интеллектуального агента для анализа сделок M&A. Этот агент способен анализировать общедоступные документы M&A (например, DEF 14A), анализировать каждый PDF-файл и автоматически генерировать таблицы Excel, содержащие условия сделки и данные сопоставимых компаний. Этот инструмент значительно повышает эффективность и точность финансового анализа, особенно при работе со сложными финансовыми документами. (Источник: jerryjliu0)

Anthropic Skills и Plugins: перекрытие функций вызывает путаницу у разработчиков : Anthropic недавно представила функции Skills и Plugins, предназначенные для внедрения настраиваемых возможностей в AI Agent. Однако некоторые разработчики сообщают о путанице и перекрытии в их использовании, что приводит к неопределенности в сценариях использования и стратегиях разработки. Это указывает на то, что Anthropic, возможно, имеет пространство для оптимизации в дизайне функций и стратегии выпуска, чтобы лучше направлять разработчиков в использовании своих AI-возможностей. (Источник: Vtrivedy10, Reddit r/ClaudeAI)

📚 Обучение

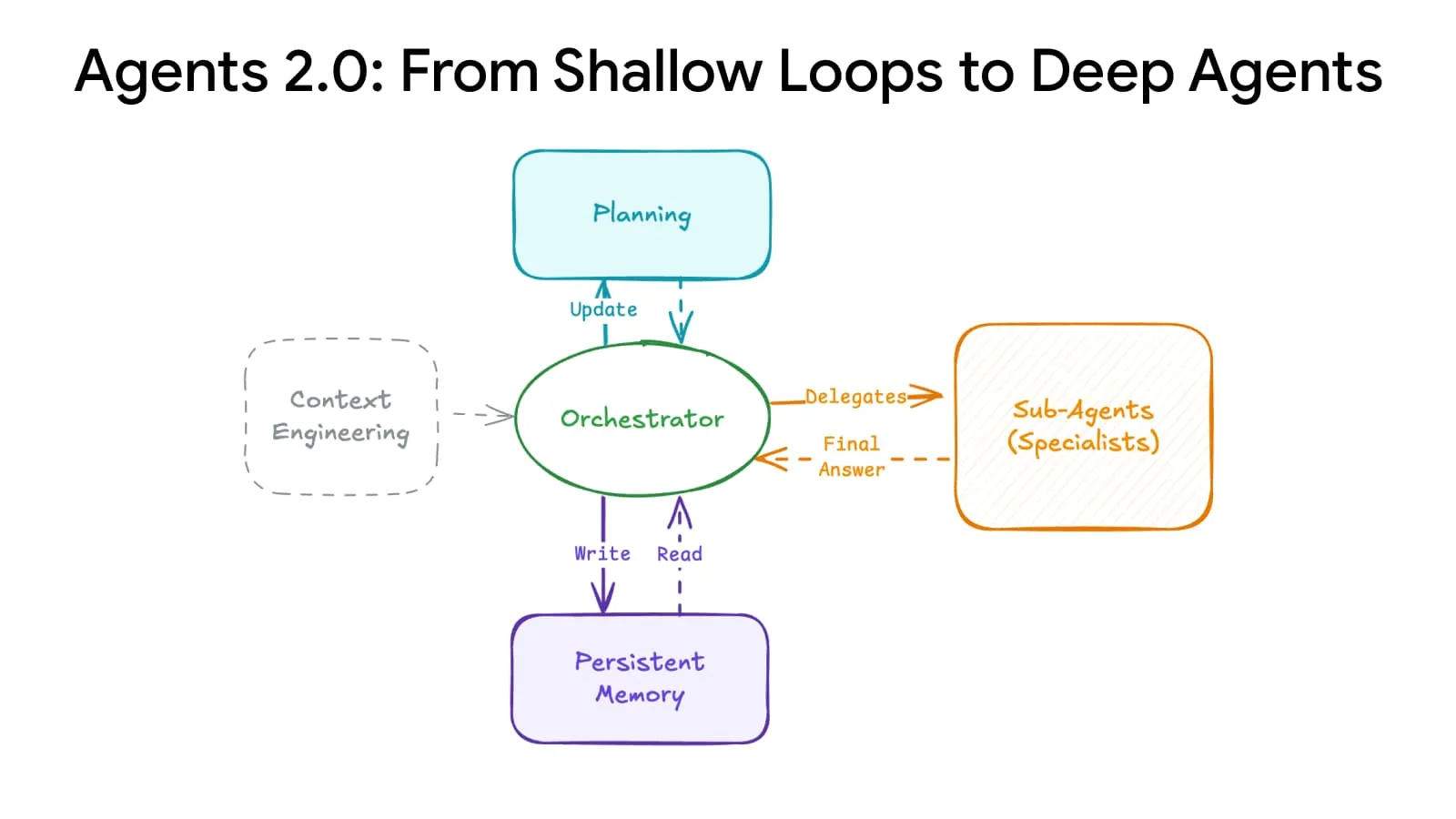

Deep Agents Evolution: продвинутые системы планирования и памяти увеличивают масштаб агентов : Прорыв в архитектуре AI реализовал “глубокую эволюцию агентов”, позволяя агентам расширяться с 15 до более чем 500 шагов благодаря продвинутым системам планирования и памяти, что полностью изменило подход AI к сложным задачам. Эта технология обещает позволить AI сохранять связность в более длинных временных рядах и более сложных логических цепочках, закладывая основу для создания более мощных универсальных AI-агентов. (Источник: LangChainAI)

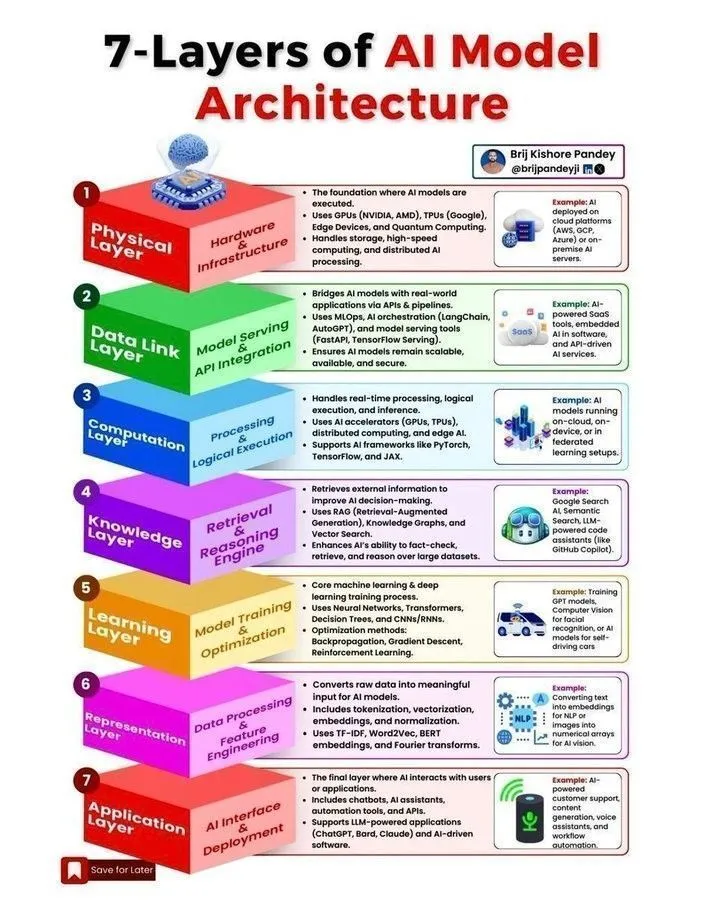

Архитектура AI-моделей и дорожная карта разработки агентов : В социальных сетях было опубликовано несколько ресурсов по архитектуре AI-моделей, дорожным картам разработки агентов, жизненному циклу машинного обучения, а также различиям между AI, генеративным AI и машинным обучением. Эти материалы призваны помочь разработчикам и исследователям понять основные концепции AI-систем, ключевые шаги по созданию масштабируемых AI-агентов и освоить ключевые навыки, необходимые в области AI к 2025 году. (Источник: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Курс Стэнфорда CME295: Transformer и инженерная практика больших моделей : Стэнфордский университет выпустил серию курсов CME295, посвященных инженерным практическим знаниям архитектуры Transformer и больших языковых моделей (LLM). Курс избегает сложных математических концепций, акцентируя внимание на практическом применении, предоставляя ценные учебные ресурсы для инженеров, желающих углубленно изучить разработку и развертывание больших моделей. В то же время, курс CS224N рекомендуется как лучший выбор для начинающих в NLP. (Источник: karminski3, QuixiAI, stanfordnlp)

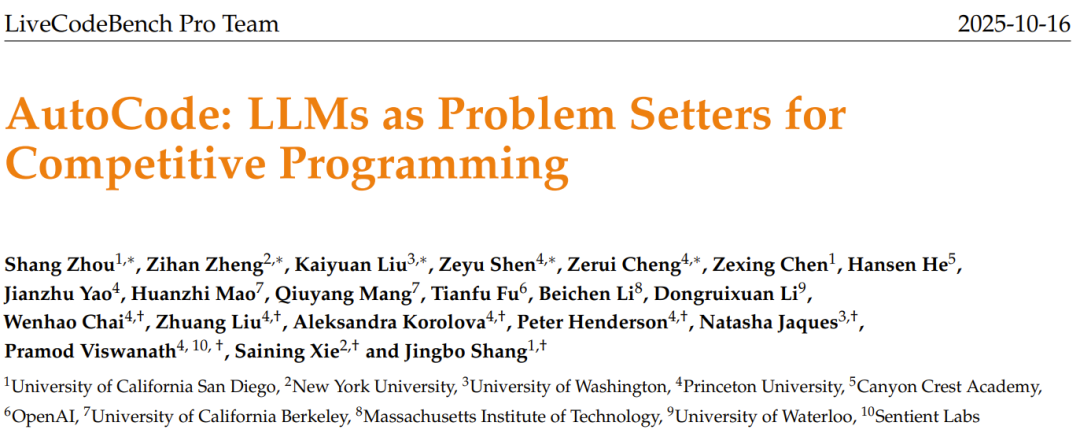

AI-генератор задач AutoCode: LLM создает оригинальные задачи для программистских соревнований : Команда LiveCodeBench Pro представила фреймворк AutoCode, который использует LLM для автоматизации создания и оценки задач для программистских соревнований в замкнутой многоролевой системе. Этот фреймворк обеспечивает высокую надежность генерации тестовых примеров благодаря усовершенствованному механизму валидатор-генератор-проверяющий и способен вдохновлять LLM на создание высококачественных, оригинальных новых задач из “семенных проблем”, что обещает проложить путь к более строгим бенчмаркам для программистских соревнований и самосовершенствованию моделей. (Источник: 36氪)

KAIST разработал AI-полупроводниковый мозг: сочетание интеллекта Transformer и эффективности Mamba : Корейский институт передовых технологий (KAIST) разработал новый тип AI-полупроводникового мозга, успешно сочетающий интеллект архитектуры Transformer и эффективность архитектуры Mamba. Это прорывное исследование направлено на решение проблемы компромисса между производительностью и энергопотреблением в существующих AI-моделях, предлагая новое направление для будущего проектирования высокоэффективного и низкопотребляющего AI-оборудования, что, как ожидается, ускорит развитие периферийных AI и встроенных AI-систем. (Источник: Reddit r/deeplearning)

Многоэтапный конвейер NER: нечеткое сопоставление и техника маскирования LLM для анализа комментариев Reddit : Исследование предлагает многоэтапный конвейер распознавания именованных сущностей (NER), сочетающий высокоскоростное нечеткое сопоставление и технику маскирования LLM для извлечения сущностей и настроений из комментариев Reddit. Этот метод сначала идентифицирует известные сущности с помощью нечеткого поиска, затем обрабатывает замаскированный текст с помощью LLM для обнаружения новых сущностей, а затем проводит анализ настроений и обобщение. Этот гибридный подход достигает баланса между скоростью и возможностями обнаружения при обработке крупномасштабных, зашумленных текстов, специфичных для предметной области. (Источник: Reddit r/MachineLearning)

Опыт развертывания торговой системы на базе ML: решение проблем “смещения вперед” и “дрейфа состояния” в реальном времени : Разработчик поделился опытом развертывания торговой системы на базе ML, подчеркнув важность решения проблем “смещения вперед” (look-ahead bias) и “дрейфа состояния” (state drift) в реальном времени. Строгая построчная обработка модели и скрипт “золотого мастера” обеспечивают детерминированное соответствие между историческим тестированием и работой в реальном времени. Система также включает валидатор, который измеряет согласованность прогнозов в реальном времени с прогнозами валидатора с коэффициентом корреляции Пирсона 1.0, обеспечивая надежность модели. (Источник: Reddit r/MachineLearning)

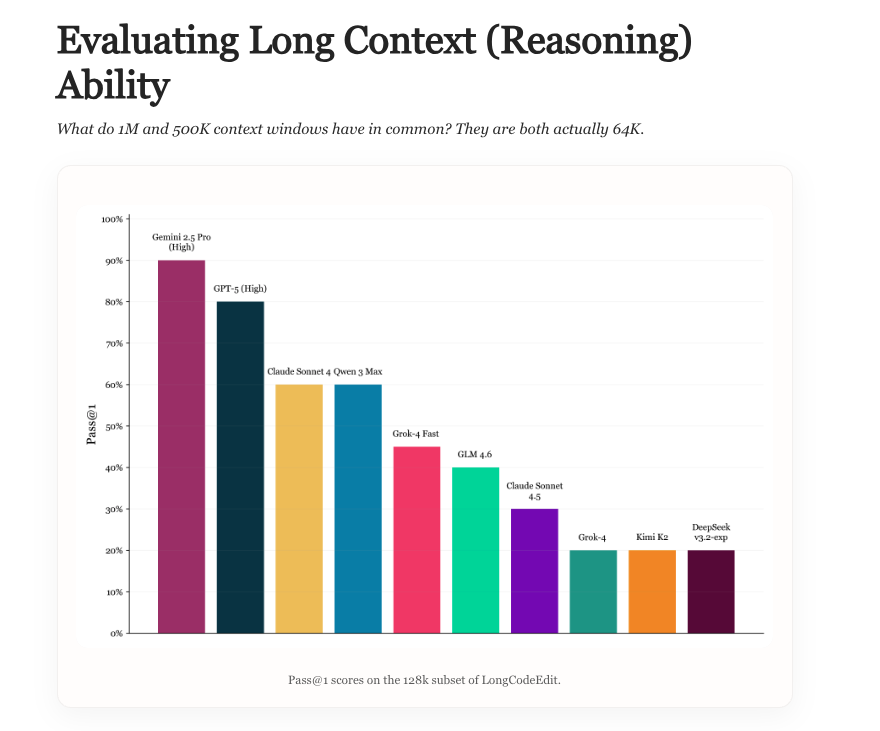

Long Context Evaluation: новый бенчмарк для оценки возможностей LLM с длинным контекстом : Новое исследование изучает текущее состояние оценки LLM с длинным контекстом, анализирует преимущества и недостатки существующих бенчмарков и представляет новый бенчмарк под названием LongCodeEdit. Это исследование направлено на устранение недостатков существующих методов оценки при измерении способности LLM обрабатывать длинные тексты и сложные задачи редактирования кода, предоставляя новые инструменты и идеи для более точной оценки производительности моделей в сценариях с длинным контекстом. (Источник: nrehiew_, teortaxesTex)

Manifold Optimization: геометрически осознанная оптимизация обучения нейронных сетей : Manifold-оптимизация придает обучению нейронных сетей способность к геометрическому восприятию. Новое исследование расширяет эту идею на модульные многообразия, помогая разрабатывать оптимизаторы, понимающие взаимодействие между слоями. Комбинируя прямые функции, ограничения многообразия и нормы, этот фреймворк описывает, как сочетаются геометрия между слоями и правила оптимизации, тем самым реализуя геометрически осознанную оптимизацию на более глубоком уровне, повышая эффективность и результативность обучения нейронных сетей. (Источник: TheTuringPost, TheTuringPost)

Колмогоровская сложность AI-исследований: потенциал AI для упрощения результатов исследований : В обсуждении отмечается, что “суть” новых исследований и содержимого блогов может быть сжата до кода, артефактов и математических абстракций. Будущие AI-системы обещают “переводить” сложные исследования в простые артефакты, значительно сокращая затраты на понимание новых исследований путем извлечения ключевых различий и воспроизведения основных результатов, что позволит исследователям легче следить за огромным количеством статей на ArXiv и быстро усваивать и применять результаты исследований. (Источник: jxmnop, aaron_defazio)

Спор об истоках остаточного обучения от отца LSTM: вклад Хохрайтера в 1991 году : Юрген Шмидхубер, отец LSTM, вновь заявил, что основная идея остаточного обучения была предложена его студентом Сеппом Хохрайтером еще в 1991 году для решения проблемы исчезающего градиента в RNN. В своей докторской диссертации Хохрайтер ввел рекуррентные остаточные связи и зафиксировал веса на уровне 1.0, что считается основой для остаточной идеи в последующих архитектурах глубокого обучения, таких как LSTM, Highway Networks и ResNet. Шмидхубер подчеркнул важность ранних вкладов для развития глубокого обучения. (Источник: 量子位)

💼 Бизнес

Zhiweitou Pharma получила многомиллионное посевное финансирование: AI-помощь в разработке новых пероральных низкомолекулярных препаратов : Beijing Zhiweitou Pharmaceutical Technology Co., Ltd. завершила посевной раунд финансирования на десятки миллионов юаней, возглавляемый Newruili Capital при участии Qingtang Investment. Средства будут использованы для продвижения доклинических исследований ключевых направлений и создания платформы для интерактивного молекулярного дизайна с использованием AI. Компания сосредоточена на области AI-фармацевтики, используя собственную платформу EnCore для ускорения открытия ведущих соединений и оптимизации молекул, специализируясь на пероральных низкомолекулярных препаратах для аутоиммунных заболеваний, с перспективой преодоления “труднодоступных” мишеней. (Источник: 36氪)

Damou Technology завершила раунд финансирования A+ на сумму почти 100 миллионов юаней: технология совместной работы вычислений и электроэнергии решает проблему высокого энергопотребления интеллектуальных вычислительных центров : Damou Technology завершила раунд финансирования A+ на сумму почти 100 миллионов юаней, возглавляемый Puquan Capital, дочерней компанией CATL. Этот раунд финансирования будет использован для исследований и разработок, а также продвижения основных технологий, таких как большая энергетическая модель, платформа совместной работы вычислений и электроэнергии, а также интеллектуальные агенты, с целью решения проблемы высокого энергопотребления интеллектуальных вычислительных центров посредством “совместной работы вычислений и электроэнергии” и содействия строительству новой энергетической системы. Damou Technology, опираясь на полностью разработанную собственными силами большую энергетическую модель, уже сотрудничает с ведущими предприятиями, такими как SenseTime и Cambricon, предоставляя решения по оптимизации энергии для высокоэнергоемкой вычислительной инфраструктуры. (Источник: 36氪)

JD, Tmall, Douyin “AI-зировали” Double 11: технологии стимулируют рост электронной коммерции во время крупных распродаж : В этом году Double 11 стал испытательным полигоном для AI-электронной коммерции: ведущие платформы, такие как JD, Tmall и Douyin, полностью усилили использование AI-технологий. AI применяется для оптимизации потребительского опыта, расширения возможностей продавцов, логистики, распространения контента и принятия потребительских решений на всех этапах цепочки. Например, JD обновил функцию “покупки по фото”, Douyin Doubao интегрирован в торговый центр, а Worth Buy Technology реализовала сравнение цен через AI-диалог. AI становится новым двигателем роста электронной коммерции, перестраивая конкурентную среду отрасли за счет максимальной эффективности и контроля затрат, продвигая электронную коммерцию от стадии “витринной/контентной коммерции” к стадии “интеллектуальной коммерции”. (Источник: 36氪, 36氪)

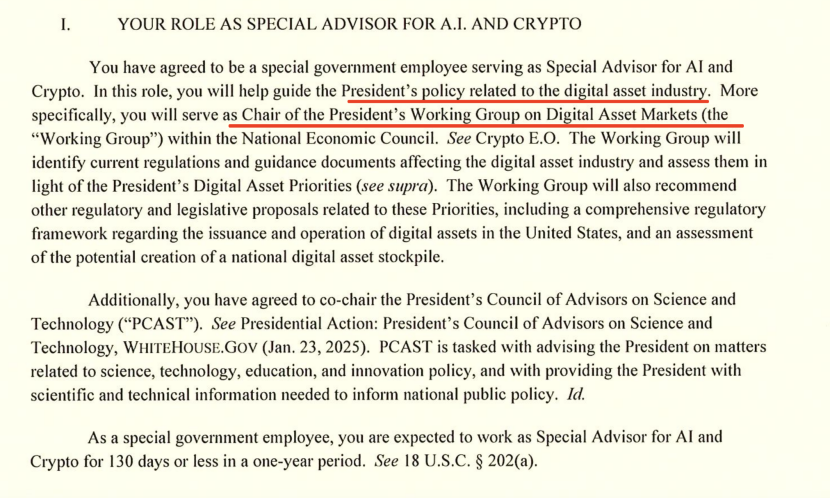

Глава AI в Белом доме о конкуренции между США и Китаем в области AI: экспорт чипов и доминирование экосистемы : Дэвид Сакс, “царь” AI и Crypto в Белом доме, в интервью изложил стратегию США в конкуренции между США и Китаем в области AI, подчеркнув важность инноваций, инфраструктуры и экспорта. Он отметил, что политика США в отношении экспорта чипов в Китай должна быть “нюансированной”: необходимо ограничивать самые передовые чипы, но избегать полного лишения, которое может привести к монополии Huawei на внутреннем рынке. Сакс подчеркнул, что США должны создать обширную AI-экосистему и стать предпочтительным технологическим партнером в мире, а не душить конкурентоспособность бюрократическим контролем. (Источник: 36氪)

🌟 Сообщество

Споры о коммерциализации OpenAI: от некоммерческой организации к погоне за прибылью, репутация Сэма Альтмана пострадала : Генеральный директор OpenAI Сэм Альтман вызвал широкие споры из-за планов ChatGPT разрешить эротический контент, производительности модели GPT-5 и агрессивной стратегии расширения инфраструктуры. Сообщество ставит под сомнение его переход от некоммерческих целей к коммерческой выгоде, выражая обеспокоенность направлением развития AI-технологий, инвестиционным пузырем и этическим отношением к сотрудникам. Ответ Альтмана не смог полностью успокоить общественное мнение, что подчеркивает напряженность между расширением AI-империи и социальной ответственностью. (Источник: 36氪, janusch_patas, Reddit r/ArtificialInteligence)

Отравление больших моделей: отравление данных, состязательные примеры и вызовы безопасности AI : Большие модели сталкиваются с угрозами безопасности, такими как отравление данных, атаки через бэкдоры и состязательные примеры, что приводит к аномальным или вредоносным выходным данным модели, а иногда даже используется для коммерческой рекламы (GEO), демонстрации технологий или киберпреступлений. Исследования показывают, что небольшое количество вредоносных данных может значительно повлиять на модель. Это вызывает опасения по поводу AI-галлюцинаций, манипулирования решениями пользователей и рисков для общественной безопасности, подчеркивая важность создания иммунной системы модели, усиления аудита данных и механизмов постоянной защиты. (Источник: 36氪)

Дилемма разметчиков данных в эпоху AI: магистры и доктора наук занимаются низкооплачиваемым повторяющимся трудом : С развитием больших AI-моделей требования к образованию для работы по разметке данных возросли (иногда до степени магистра или доктора наук), но заработная плата значительно ниже, чем у AI-инженеров. Эти “AI-учителя” занимаются оценкой AI-генерируемого контента, этической проверкой и обучением по специализированным знаниям, но получают низкую почасовую оплату, а работа нестабильна, с потерей занятости по окончании проекта. Эта “кибер-конвейерная” модель многоуровневого субподряда и эксплуатации вызывает глубокие размышления об этике труда и справедливости в AI-индустрии. (Источник: 36氪)

Влияние AI на творчество и человеческие ценности: конец или возвышение? : Сообщество обсуждает влияние AI на человеческое творчество, полагая, что AI не убил творчество, а скорее выявил относительную посредственность человеческого творчества. AI преуспевает в реорганизации и генерации паттернов, но истинная оригинальность, противоречивость и непредсказуемость остаются уникальными преимуществами человека. Появление новых инструментов всегда устраняет средний уровень, заставляя людей искать прорывы на более высоком уровне в контенте и творчестве, делая истинное творчество еще более ценным. (Источник: Reddit r/artificial)

Экзистенциальная тревога, вызванная AI, и стратегии реагирования: реальные проблемы и чрезмерные опасения : Столкнувшись с потенциальной угрозой существованию, которую может представлять AI, сообщество обсудило, как справиться с возникающим “экзистенциальным страхом”. Некоторые мнения предполагают, что этот страх может быть вызван чрезмерными фантазиями о будущем, и рекомендуют людям вернуться к реальности и сосредоточиться на настоящей жизни. В то же время, другие указывают, что экономические потрясения и проблемы с занятостью, связанные с AI, являются более насущными реальными угрозами, подчеркивая, что безопасность AI должна рассматриваться наравне с социально-экономическими последствиями. (Источник: Reddit r/ArtificialInteligence)

Мнение Карпати вызвало жаркие споры: теория AGI “десятилетия”, теория “призрачных” агентов AI и путь развития AI : Мнение Андрея Карпати о “десятилетней” перспективе AGI и о том, что существующие AI-агенты являются “призраками”, вызвало широкие дискуссии в сообществе. Он подчеркнул, что AI нуждается в постоянстве, памяти и непрерывности, чтобы стать настоящим агентом, и предложил, чтобы обучение AI перешло от “закачивания данных” к “обучению целям”. Эти взгляды рассматриваются как трезвое осмысление текущего ажиотажа вокруг AI, побуждающее людей переосмыслить долгосрочный путь развития AI и критерии оценки. (Источник: TheTuringPost, TheTuringPost, NandoDF, random_walker, lateinteraction, stanfordnlp)

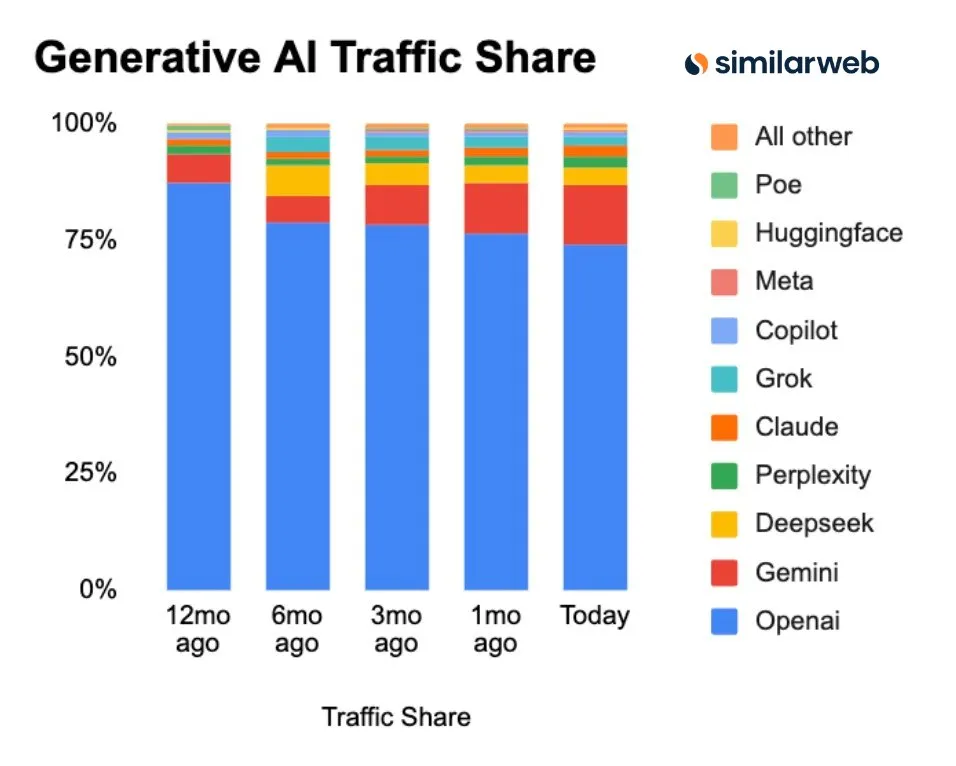

Доля рынка ChatGPT продолжает снижаться: конкуренты, такие как Perplexity, Gemini, DeepSeek, набирают обороты : Данные Similarweb показывают, что доля рынка ChatGPT продолжает снижаться, упав с 87,1% год назад до 74,1%. В то же время, доля рынка конкурентов, таких как Gemini, Perplexity, DeepSeek, Grok и Claude, неуклонно растет. Эта тенденция указывает на усиление конкуренции на рынке AI-помощников, диверсификацию выбора пользователей и оспаривание доминирующего положения ChatGPT. (Источник: ClementDelangue, brickroad7)

Математический казус GPT-5: чрезмерный маркетинг OpenAI и сомнения коллег : Исследователи OpenAI громко заявили, что GPT-5 решила несколько математических задач Эрдёша, но позже выяснилось, что она просто нашла уже существующие ответы через веб-поиск, а не решила их самостоятельно. Этот инцидент вызвал публичные насмешки со стороны таких гигантов индустрии, как генеральный директор DeepMind Хассабис и ЛеКун из Meta, которые поставили под сомнение чрезмерный маркетинг OpenAI, подчеркнув проблему строгости в продвижении возможностей AI и конкурентную ситуацию между коллегами. (Источник: 量子位)

Скрытые экологические издержки AI: потребление энергии и воды : Исторические исследования показывают, что от телеграфа до AI коммуникационные системы всегда сопровождались скрытыми экологическими издержками. AI и современные коммуникационные системы зависят от крупномасштабных центров обработки данных, что приводит к резкому росту потребления энергии и воды. Прогнозируется, что к 2027 году потребление воды AI будет эквивалентно годовому потреблению воды в Дании. Это подчеркивает экологическую цену быстрого развития AI-технологий, призывая правительства усилить регулирование, обязать раскрывать информацию о воздействии на окружающую среду и поддерживать проекты с низким воздействием. (Источник: aihub.org)

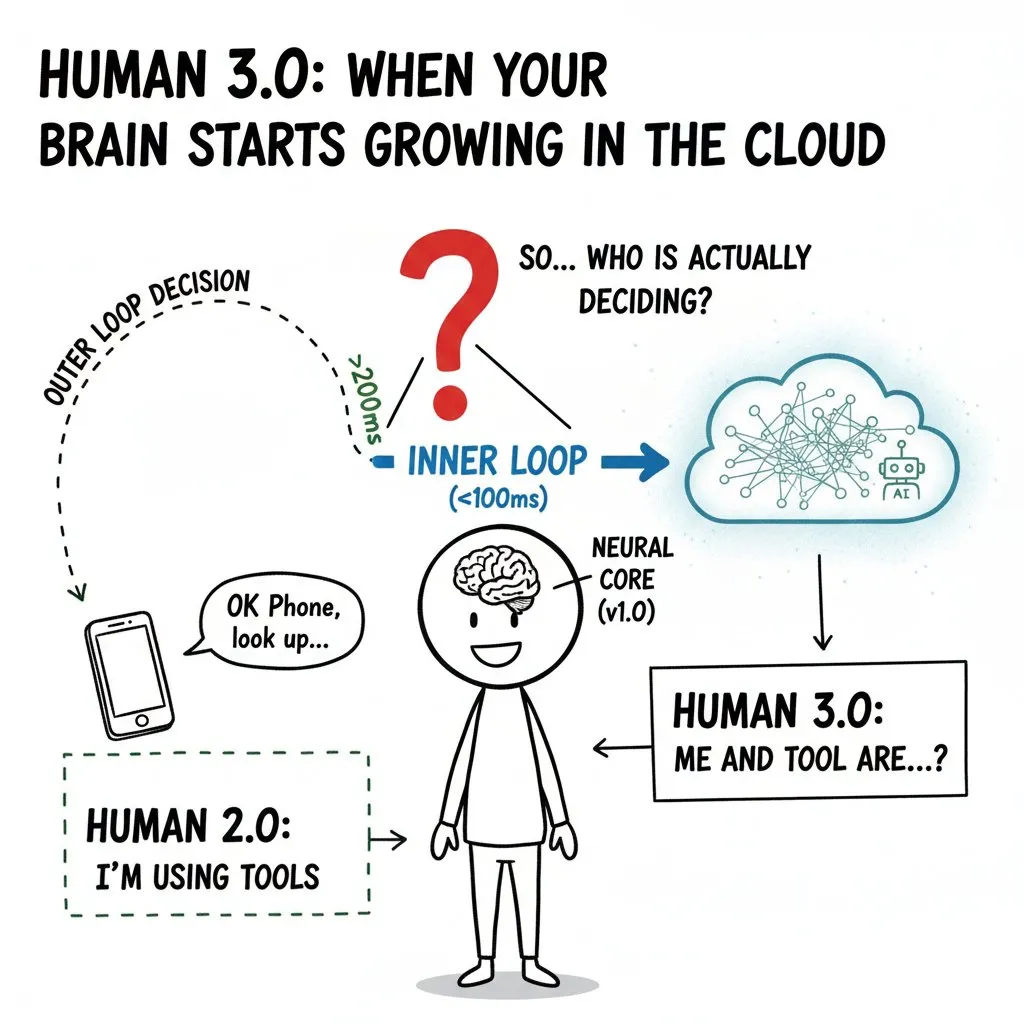

“Вторжение” AI в человеческий разум: нейроинтерфейсы и этические границы “Человека 3.0” : Сообщество глубоко обсудило потенциальное влияние нейроинтерфейсов (BCI) и AI на человеческий разум, предложив концепцию “Человека 3.0”. Когда внешние вычислительные мощности проникают во “внутренний круг” человеческого принятия решений так быстро, что мозг не может различить источник сигнала, это вызывает этические проблемы, связанные с границами “я”, ценностными суждениями и долгосрочным здоровьем. В статье подчеркивается, что до широкого распространения технологии необходимо разработать архитектуру нулевого доверия, аппаратную изоляцию и управление разрешениями, чтобы избежать сдачи в аренду права принятия решений и усугубления неравенства на видовом уровне. (Источник: dotey)

💡 Прочее

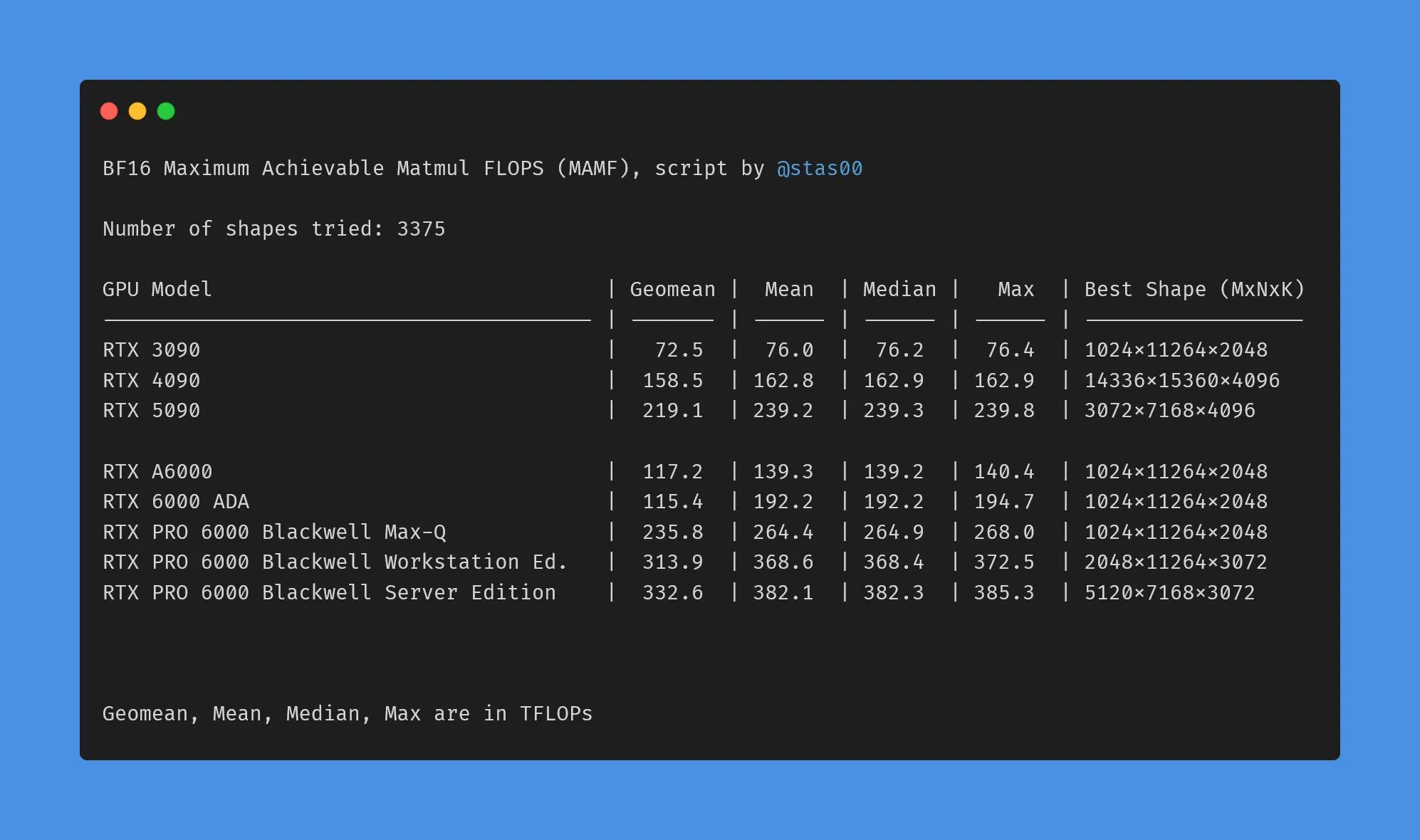

Различия в данных о производительности потребительских и профессиональных GPU NVIDIA : Сообщество обсудило различия между заявленными маркетинговыми TFLOPs и фактической производительностью потребительских и профессиональных GPU NVIDIA. Данные показывают, что фактическая производительность потребительских видеокарт (таких как 3090, 4090, 5090) немного выше или близка к номинальным TFLOPs, в то время как фактическая производительность профессиональных рабочих станций (таких как A6000, 6000 ADA) значительно ниже номинальных значений. Тем не менее, профессиональные карты по-прежнему имеют преимущества в энергопотреблении, размере и энергоэффективности, но пользователям следует остерегаться разницы между маркетинговыми данными и фактической производительностью. (Источник: TheZachMueller)

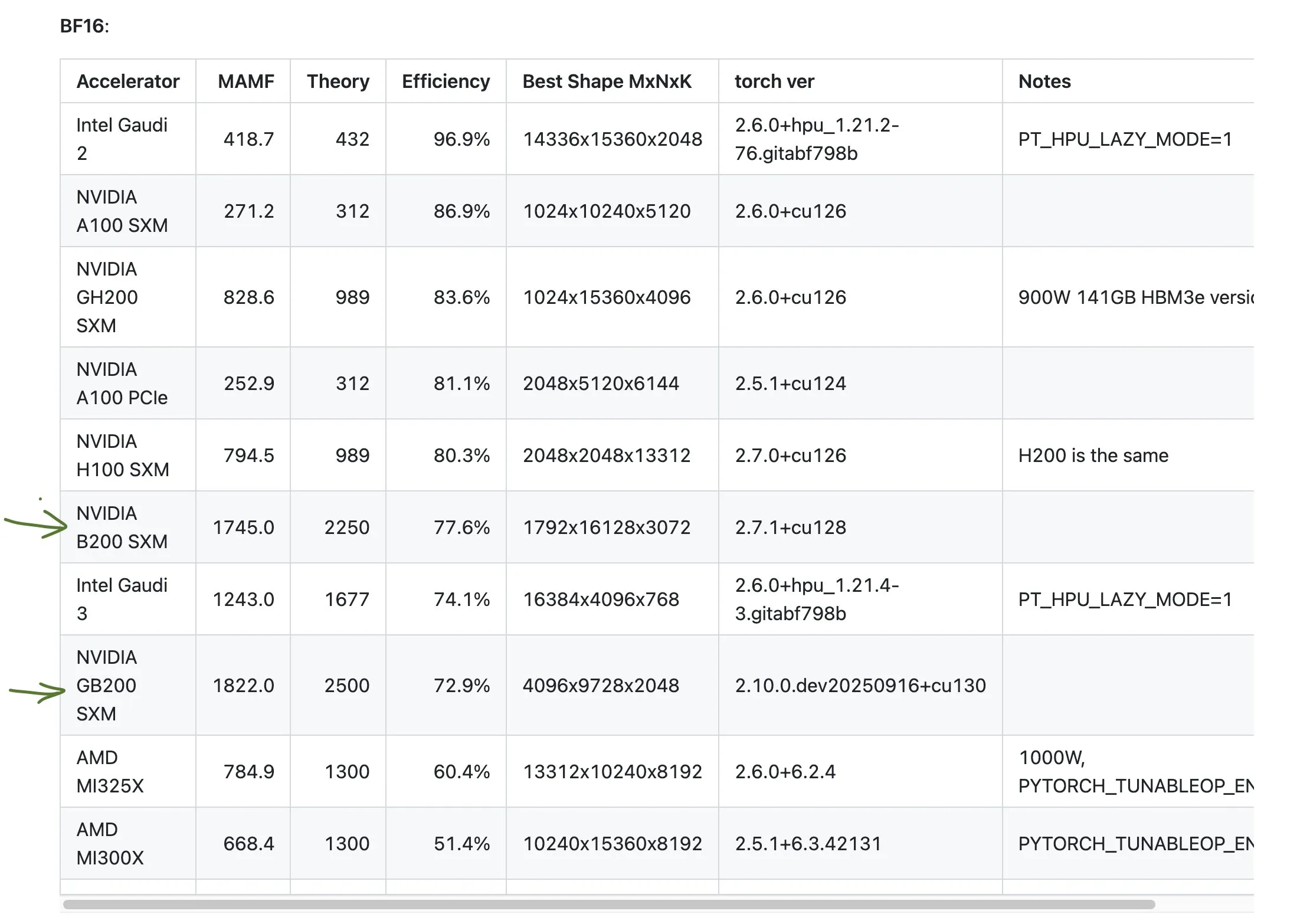

Обсуждение низкой производительности GPU AMD : Сообщество обсудило производительность GPU AMD в некоторых бенчмарках, отметив, что их эффективность может составлять лишь половину от ожидаемой. Это вызвало опасения по поводу конкурентоспособности AMD в области AI-вычислений, особенно по сравнению с высокопроизводительными продуктами NVIDIA, такими как GB200. Пользователям следует тщательно оценивать фактическую производительность и эффективность GPU разных производителей при планировании AI-вычислительных ресурсов. (Источник: jeremyphoward)

GIGABYTE AI TOP ATOM: производительность Grace Blackwell GB10 на настольных ПК : GIGABYTE выпустила AI TOP ATOM, который привносит производительность NVIDIA Grace Blackwell GB10 в настольные рабочие станции. Этот продукт призван предоставить индивидуальным пользователям и небольшим командам мощные вычислительные возможности AI, позволяя им выполнять высокопроизводительное обучение моделей и инференс локально, снижая зависимость от облачных ресурсов и ускоряя разработку и развертывание AI-приложений. (Источник: Reddit r/LocalLLaMA)