Palavras-chave:GPT-5, IA médica, OpenAI, Modelo de IA, Segurança de IA, Negócios de IA, Ferramentas de IA, Aprendizado de IA, Raciocínio médico do GPT-5, Viés de raciocínio falso em IA, Gargalo de capacidade computacional da OpenAI, Padrões de design para Agentes de IA, Modelo visual DINOv3

Aqui está a tradução do conteúdo para o português, seguindo todas as suas instruções:

🔥 Foco

GPT-5 alcança avanços na área médica: O GPT-5 superou significativamente especialistas humanos e o GPT-4o em benchmarks médicos como o MedXpertQA, especialmente em tarefas de raciocínio multimodal. Isso indica que o GPT-5 demonstra julgamento de nível especialista, e não apenas memorização, indicando um ponto de virada crucial na implementação de IA médica. No entanto, a pesquisa enfatiza que essas avaliações foram realizadas em um ambiente de teste ideal, e a aplicação clínica real ainda requer mais pesquisa e considerações éticas. (Fonte: Reddit r/deeplearning)

Sam Altman, CEO da OpenAI, revela visão e gargalos do desenvolvimento da IA: Em uma entrevista recente, Sam Altman apontou que o GPT-5 alcançou avanços em programação, escrita e resolução de problemas complexos, sendo capaz de criar software sob demanda instantaneamente. Ele prevê que a IA trará grandes descobertas científicas até o final de 2027 e afirma que o GPT-8 poderá curar o câncer. Altman enfatiza que a IA enfrenta quatro grandes gargalos: poder computacional, dados, otimização de algoritmos e productização. Ele acredita que estamos atualmente em uma fase de bolha de IA, mas seu potencial é imenso. A OpenAI planeja investir trilhões de dólares na construção de data centers no futuro, e até mesmo explorar interfaces cérebro-computador e experiências sociais impulsionadas por IA. Ele apela à sociedade para se adaptar às grandes mudanças trazidas pela IA, e enfatiza que a IA se tornará a base do desenvolvimento social, e, eventualmente, a IA poderá assumir o cargo de CEO. (Fonte: 36氪)

Greg Brockman, presidente da OpenAI, discute gargalos da IA e a relação entre engenharia e pesquisa científica: Greg Brockman aponta que, com a rápida expansão do poder computacional e do volume de dados, a pesquisa básica está retornando, e os algoritmos se tornam o gargalo crítico para o desenvolvimento da IA. Ele enfatiza que engenheiros e pesquisadores são igualmente importantes, e revela que a OpenAI, para apoiar o lançamento de produtos, às vezes precisa “hipotecar o futuro” para realocar poder computacional de pesquisa. Brockman acredita que a programação de IA está transitando de “exibicionismo” para engenharia de software séria, e que os AI Agents intervirão e superarão os modos de interação tradicionais. Ele também menciona que os sistemas de treinamento estão cada vez mais complexos, e o design de checkpoints precisa ser atualizado em sincronia. Além disso, ele discutiu com Jensen Huang os desafios futuros da infraestrutura de IA, que precisam equilibrar computação em larga escala com resposta de baixa latência. (Fonte: 36氪)

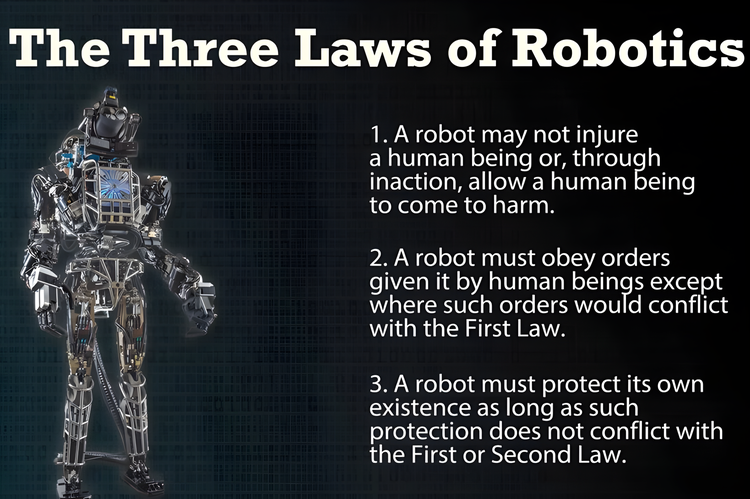

Vulnerabilidade de “viés de raciocínio falso” na base do raciocínio da IA: Uma nova pesquisa revela que modelos de raciocínio de IA de ponta como GPT-4, Claude 3 Sonnet e Llama 3 70B são suscetíveis a ataques de “viés de raciocínio falso”. Ao inserir cadeias de pensamento aparentemente razoáveis, mas logicamente falhas, nos prompts, os modelos são enganados, resultando em uma queda significativa de desempenho, como o GPT-4, cuja taxa de erro no benchmark LogiQA disparou de 20% para 62,5%. A pesquisa introduziu a estrutura THEATER para gerar sistematicamente prompts com viés, e descobriu que instruções simples de autorreflexão podem mitigar efetivamente esse viés. Isso destaca os riscos de segurança na aplicação de IA em áreas de alto risco, como finanças e saúde. (Fonte: Reddit r/MachineLearning)

🎯 Tendências

Google lança o modelo Gemma 3 270M: O Google DeepMind lançou o Gemma 3 270M, um modelo de IA de código aberto pequeno, mas poderoso, especialmente adequado para ajuste fino específico de tarefas e com forte capacidade de seguir instruções. Sua eficiência o torna uma escolha ideal para execução em dispositivos de borda, impulsionando ainda mais o desenvolvimento de modelos de IA miniaturizados e o potencial de implantação local. (Fonte: GoogleDeepMind)

Atualizações do aplicativo Google Gemini: O aplicativo Google Gemini recebeu várias atualizações recentemente, incluindo o lançamento do modelo Imagen 4 Fast mais rápido (US$ 0,02 por imagem) e suporte para geração de imagens 2K. O modelo Gemma 3 270M também foi lançado, projetado para ajuste fino personalizado por desenvolvedores. Assinantes do Gemini Ultra agora podem fazer mais consultas Deep Think, e o aplicativo Gemini pode citar históricos de bate-papo para fornecer respostas mais personalizadas. Além disso, novas pesquisas do Google AI e DeepMind exploram como a IA pode auxiliar nas conversas entre médicos e pacientes. (Fonte: demishassabis)

Controvérsia sobre o desempenho do GPT-5 e a ascensão de modelos chineses: O desempenho do GPT-5 gerou ampla discussão. Vários rankings do LM Arena mostram que o GPT-5 tem desempenho inferior ao GPT-4o em termos de desempenho geral, modelos mini e capacidade de codificação, e até mesmo fica atrás de modelos chineses líderes como Kimi-K2, GLM-4.5, Qwen3-235B e DeepSeek-R1. Isso sugere que o lançamento do GPT-5 pode ser mais uma melhoria de custo/latência/qualidade do que uma nova capacidade revolucionária, e que os modelos de IA chineses estão demonstrando forte competitividade em áreas específicas. (Fonte: maithra_raghu)

Lançamento do modelo de base visual DINOv3: A Meta AI lançou o DINOv3, um modelo de base visual de última geração, treinado em larga escala por meio de aprendizado puramente autossupervisionado (SSL), capaz de gerar recursos de imagem poderosos e de alta resolução. Ele é o primeiro a alcançar um único backbone visual congelado que supera soluções dedicadas em várias tarefas de previsão densa de longo prazo, e suporta uso comercial, prenunciando um novo avanço no campo da visão computacional. (Fonte: ylecun)

Lançamento da estrutura OpenCUA Computer Usage Agent: A OpenCUA lançou a primeira estrutura de modelo de base de AI Agent de uso de computador do zero, e abriu o código do modelo SOTA OpenCUA-32B. O modelo teve um desempenho excelente no benchmark OSWorld-Verified, igualando os principais modelos proprietários, e forneceu uma infraestrutura de treinamento completa e o conjunto de dados AgentNet. A OpenCUA visa preencher a lacuna em grandes conjuntos de dados de AI Agent de desktop abertos e pipelines transparentes, impulsionando o desenvolvimento de código aberto no campo de AI Agents de uso de computador. (Fonte: arankomatsuzaki)

Novo modelo de IA da Caesar Data se destaca no benchmark HLE: A Caesar Data lançou um novo modelo de IA que obteve 55,87% no benchmark HLE (Human-Level Evaluation), superando significativamente o Grok 4 (44,4%) e o GPT-5 (42%), demonstrando forte competitividade mesmo em sua fase Alpha. O modelo é apoiado por Google, Meta, Stripe e Hugging Face. Se seu desempenho for confirmado, isso mudará o cenário competitivo da IA. (Fonte: Reddit r/deeplearning)

Lançamento dos modelos GLM-4.5 e Nvidia Parakeet v3: O GLM-4.5 da Zhipu AI foi lançado na plataforma SST_dev opencode, e demonstrou precisão e eficiência de ponta no teste SWEBench-Verified-Mini. Ao mesmo tempo, a Nvidia também lançou o Parakeet v3, oferecendo os mais recentes avanços em IA de voz. O lançamento desses novos modelos oferece mais opções para desenvolvedores, especialmente nas áreas de geração de código e síntese de voz. (Fonte: QuixiAI)

A lacuna entre LLMs locais e modelos de ponta encurta para 9 meses: Dados da Epoch AI mostram que, usando GPUs de consumo como a RTX 5090, os usuários podem executar localmente modelos com desempenho equivalente aos modelos de ponta de LLM de 9 meses atrás, em apenas 9 meses. Isso se deve à velocidade de expansão semelhante de modelos de código aberto e fechado, à tecnologia de destilação de modelos e ao progresso contínuo das GPUs, prenunciando uma aceleração da democratização do desempenho da IA. (Fonte: Reddit r/LocalLLaMA)

Aplicações da IA na descoberta de medicamentos e desenvolvimento de vacinas: A IA está acelerando sua aplicação na área médica, incluindo o uso de IA para desenvolver novos antibióticos para combater superbactérias (como gonorreia e MRSA), e simplificar o processo de desenvolvimento de vacinas e terapias de RNA. Esses avanços demonstram o enorme potencial da IA na resolução de desafios de saúde globais. (Fonte: Reddit r/ArtificialInteligence)

LM Studio suporta descarregamento de CPU MoE do llama.cpp: A versão mais recente do LM Studio (0.3.23 build 3) suporta a função --cpu-moe do llama.cpp, permitindo que os pesos MoE (Mixture of Experts) sejam descarregados para a CPU, liberando assim a memória da GPU para descarregamento de camadas. Isso permite que os usuários que executam grandes modelos MoE (como o Qwen3 30B) em hardware de consumo alcancem o descarregamento completo da GPU em camadas com maior velocidade (como 15 tok/s), melhorando significativamente o desempenho e a usabilidade dos LLMs locais. (Fonte: Reddit r/LocalLLaMA)

Lançamento do modelo visual multimodal Ovis2.5: O Ovis2.5, sucessor do Ovis2, introduz a capacidade de processamento visual de resolução nativa NaViT, que pode preservar detalhes finos e o layout de conteúdo visual denso, como gráficos e diagramas. O modelo é treinado com CoT e raciocínio reflexivo (autoinspeção/revisão) e oferece modos de pensamento opcionais para equilibrar latência e precisão. Sua versão 9B obteve 78,3 pontos no OpenCompass, e a versão 2B obteve 73,9 pontos, com excelente desempenho em OCR de gráficos/documentos em pequena escala, imagem, vídeo e raciocínio e aterramento multi-imagem. (Fonte: andersonbcdefg)

Modelos de geração de imagens de IA NextStep-1 e Nano Banana: O NextStep-1 visa a geração autorregressiva de imagens, processando-as em escala por meio de tokens contínuos, com a expectativa de superar as limitações dos modelos tradicionais de geração de imagens. Ao mesmo tempo, modelos misteriosos como “Nano Banana” se destacam na edição de imagens, sendo capazes de executar com precisão instruções complexas (como mudar a orientação de uma pessoa), mantendo a consistência dos detalhes da imagem. (Fonte: fabianstelzer)

Impacto dos modelos de vídeo gerados por IA na percepção robótica: Modelos de vídeo gerados por IA como Veo 2 e Veo 3 não apenas criam conteúdo realista, mas também são vistos como o nascimento de um novo “sistema nervoso” para máquinas. Esses modelos aprendem as leis do mundo físico, como luz, movimento, materiais, sombras e causalidade, para alcançar simulações de alta fidelidade. Essa capacidade pode revolucionar as pilhas de sensores robóticos tradicionais, permitindo que os robôs compreendam profundidade e perigo apenas com o contexto da imagem, borrando os limites entre percepção e previsão, e tornando-se um suporte de percepção para a AGI. (Fonte: farguney)

Padrões de design de AI Agent: execução paralela e LLM como avaliador: Um padrão de design de AI Agent chamado “Parallel Rollouts” (Execuções Paralelas) está emergindo, inspirando-se nos conceitos de Tree-of-Thought e Universal Reward Function. Esse padrão permite que o Agent execute uma tarefa N vezes em paralelo, e então usa um LLM como avaliador para julgar cada resultado de execução e selecionar a melhor solução. Esse método troca um custo mais alto por menor latência, sendo adequado para tarefas de Agent de alta lucratividade. Embora a busca e a seleção não sejam conceitos novos, sua aplicação em ramificações de Agent ainda precisa ser popularizada. (Fonte: corbtt)

Novas funcionalidades do modelo Claude: uso de conteúdo do computador como contexto: O modelo Claude adicionou suporte a MCP (Multi-Contextual Processing), permitindo que ele utilize qualquer operação que o usuário veja ou realize no computador como contexto. Isso significa que o Claude pode entender mais profundamente a intenção e o fluxo de trabalho do usuário, fornecendo respostas mais inteligentes e personalizadas, o que aumenta significativamente sua utilidade como assistente de IA. (Fonte: stanfordnlp)

Categorias de lançamento de modelos de IA e o posicionamento do GPT-5: Maithra Raghu aponta que os lançamentos de modelos de IA geralmente se dividem em duas categorias: oferecer novas capacidades (como multimodalidade, contexto longo, raciocínio avançado) e otimizar custo/latência/qualidade. O lançamento do GPT-5 é considerado mais pertencente à segunda categoria, ou seja, otimização das capacidades existentes, em vez de trazer novas funcionalidades disruptivas como a transição do GPT-3 para o ChatGPT. Isso gerou discussões sobre o grau real de avanço do GPT-5 e sugere que o futuro desenvolvimento da IA se concentrará mais em modelos “Agent Native”, enfatizando ação e uso de ferramentas. (Fonte: maithra_raghu)

DeepSeek-R1 como um lançamento importante de modelo de código aberto: O DeepSeek-R1 é considerado um evento de maior escala do que outros lançamentos de modelos de código aberto. Isso indica que a comunidade de IA de código aberto fez progressos significativos no desenvolvimento de modelos grandes e pode representar uma concorrência maior para os modelos de código fechado no futuro. (Fonte: scaling01)

Avanços na aplicação da IA na saúde: A Yunpeng Technology, em parceria com a Shuaikang e a Skyworth, lançou o “Laboratório de Cozinha Futura Digital e Inteligente” e uma geladeira inteligente equipada com um grande modelo de saúde de IA. O grande modelo de saúde de IA otimiza o design e a operação da cozinha, e a geladeira inteligente, através do “Assistente de Saúde Xiaoyun”, oferece gerenciamento de saúde personalizado. Isso marca um avanço da IA no gerenciamento diário da saúde, com potencial para impulsionar o desenvolvimento da tecnologia de saúde doméstica e melhorar a qualidade de vida dos moradores. (Fonte: 36氪)

🧰 Ferramentas

Atualizações das ferramentas do ecossistema LlamaIndex: O ecossistema LlamaIndex continua a se expandir, incluindo: 1. llama_index pode ser usado para construir clones do NotebookLM, suportando aplicações de IA multimodal para analisar texto e imagens para pesquisa de mercado. 2. LlamaExtract suporta leitura rápida e extração estruturada de artigos de pesquisa, e já foi integrado ao TypeScript SDK. 3. Tutoriais mostram como usar LlamaParse e Neo4j para transformar documentos legais não estruturados em um grafo de conhecimento consultável. Essas ferramentas visam simplificar o desenvolvimento de aplicações de IA, melhorando o processamento de documentos e a eficiência do gerenciamento de conhecimento. (Fonte: jerryjliu0)

Macaron AI: Uma tentativa de AI Agent pessoal: Macaron AI é um aplicativo de AI Agent que visa “ajudar você a viver melhor”, enfatizando calor e empatia. Ele pode lembrar as preferências do usuário, prever necessidades e gerar pequenos aplicativos personalizados a qualquer momento durante o bate-papo (como diário de filmes, diário de detecção de alérgenos). Embora algumas funções avançadas ainda precisem ser aprimoradas, seu posicionamento como um “produto de Vibe Coding móvel disfarçado de companheiro emocional”, juntamente com sua “biblioteca de inspiração” e loja de aplicativos integrada, demonstra o potencial da IA em serviços de vida pessoal e na redução da barreira para o desenvolvimento de aplicativos. (Fonte: 36氪)

Lançamento da versão desktop do Qwen Chat e ferramentas de desenvolvimento de aplicativos de IA: O Qwen Chat da Alibaba lançou sua versão para desktop Windows, com suporte a MCP (Multi-Contextual Processing), visando oferecer uma experiência de Agent mais inteligente e rápida. Ao mesmo tempo, novas ferramentas de IA como o Anycoder permitem a implantação com um clique de aplicativos LLM, e a coleção de modelos Gradio Audio integra o modelo de texto para fala Higgs Audio v2 da Boson AI, simplificando enormemente os processos de construção e implantação de aplicativos de IA e melhorando a eficiência do desenvolvimento. (Fonte: Alibaba_Qwen)

Sistema de interação por voz impulsionado por IA Buddie de código aberto: Buddie é um sistema completo de interação por voz impulsionado por IA e de código aberto, incluindo hardware personalizado, firmware e aplicativo móvel. Ele pode transcrever e resumir reuniões/chamadas em tempo real, fornecer prompts em tempo real para conversas e suportar conversas totalmente mãos-livres com LLMs, bem como ajuda sensível ao contexto. O Buddie visa permitir que os usuários criem seus próprios companheiros de IA, podendo ser aplicado em fones de ouvido, alto-falantes, pulseiras, brinquedos e outros dispositivos de IA, reduzindo significativamente a barreira de desenvolvimento para sistemas de interação por voz de IA. (Fonte: Reddit r/LocalLLaMA)

Lançamento do motor de simulação de chatbot de IA Snowglobe: Snowglobe é um motor de simulação para chatbots de IA, projetado para simular centenas de conversas implantando papéis de usuário realistas, a fim de descobrir falhas difíceis de detectar com testes manuais e gerar conjuntos de dados rotulados para avaliação e ajuste fino. Ele permite que os AI Agents aprendam com cada falha e se tornem mais inteligentes, ajudando os desenvolvedores a melhorar os chatbots antes que os usuários encontrem problemas. (Fonte: ShreyaR)

MLflow 3.3 aprimora o fluxo de trabalho de avaliação de GenAI: O MLflow 3.3 introduziu um fluxo de trabalho de avaliação de GenAI com foco na avaliação, integrando diretamente a avaliação de qualidade e as anotações de rastreamento na interface do usuário de rastreamento, simplificando a criação, visualização e gerenciamento ao longo do ciclo de vida do aplicativo. As novas funcionalidades incluem um visualizador de rastreamento redesenhado (suportando operações CRUD de avaliação), uma aba de rastreamento exibindo métricas de avaliação e indicadores visuais, e filtragem e ordenação por valores de avaliação, para ajudar a monitorar e diagnosticar o desempenho do aplicativo. (Fonte: matei_zaharia)

Ferramenta de AI Agent para automação de tarefas: Uma nova ferramenta de AI Agent permite que os usuários automatizem tarefas com uma única gravação de tela e explicação por voz. O usuário só precisa gravar e explicar o processo da operação (como exportar dados, limpar tabelas, publicar conteúdo), e em dois minutos um AI Agent será gerado, capaz de executar a tarefa com a mesma lógica, e sem interrupções mesmo quando os elementos da página mudam. Isso promete simplificar significativamente o trabalho repetitivo e aumentar a eficiência da automação. (Fonte: Reddit r/artificial)

Sistema operacional de IA resolve a dor da integração de múltiplas ferramentas: Para resolver a dor da fragmentação de ferramentas de IA e da cópia e colagem entre múltiplas abas, um desenvolvedor construiu um “sistema operacional de IA”. Esse sistema permite que os modelos de IA alternem instantaneamente, mantenham o contexto e construam “aplicativos” com fluxos de trabalho predefinidos. Seu objetivo é fornecer um ambiente de trabalho de IA unificado, resolvendo os problemas atuais de baixa eficiência do fluxo de trabalho de IA e ferramentas dispersas, e melhorando a experiência do usuário. (Fonte: Reddit r/deeplearning)

W&B Weave lança Content API: W&B Weave lançou a Content API, permitindo que os usuários registrem qualquer conteúdo de mídia usado por aplicativos de IA e o analisem em traces. Essa funcionalidade suporta a inspeção, avaliação e comparação de imagens, áudio, vídeo, Markdown, PDF e até HTML, fornecendo uma plataforma unificada de depuração e visualização para AI Agents e aplicativos multimodais. (Fonte: weights_biases)

LangGraph Studio lança modo Trace: O LangGraph Studio adicionou o modo Trace, permitindo que os usuários visualizem traces do LangSmith em tempo real dentro do Studio. Os usuários podem anotar diretamente as execuções na visualização de detalhes e adicioná-las a conjuntos de dados ou filas de anotação, integrando o poderoso recurso de rastreamento do LangSmith diretamente no fluxo de trabalho, o que permite depuração mais rápida e análise de problemas mais profunda, reduzindo a troca de contexto. (Fonte: LangChainAI)

Chatbot de IA “Narrador” Narration.sh: Narrator.sh é um aplicativo de IA baseado em LLM que aprende a escrever melhor ficção através do feedback do leitor (como avaliações, tempo de leitura). O projeto utiliza a estrutura DSPy para otimização e o algoritmo dspy.SIMBA para ajustar o modelo com base no feedback, enquanto também classifica a capacidade de escrita criativa do LLM. Isso oferece novas direções de aplicação e métodos de avaliação para a IA no campo da criação de conteúdo. (Fonte: lateinteraction)

Treinador de entrevistas de IA e aplicação de Jupyter Notebooks na avaliação de IA: Hamel Husain compartilhou um caso de uso de um produto de treinador de entrevistas de IA que rapidamente corrigiu bugs e melhorou através de avaliações (evals). O caso demonstra como realizar análise de erros, usar Jupyter Notebooks para analisar erros, construir ferramentas de anotação personalizadas e LLM-as-a-judge, e usar testes de asserção para erros específicos. Isso enfatiza a importância de ciclos de feedback contínuos e métodos de avaliação concisos no desenvolvimento de produtos de IA. (Fonte: jeremyphoward)

Melhorias na funcionalidade do OpenAI Playground: O OpenAI Playground passou por várias melhorias recentes, aprimorando a experiência do usuário. Agora, os usuários podem conversar com documentos internos por meio da ferramenta MCP e utilizar a funcionalidade de armazenamento de vetores. Além disso, as funções Prompt Optimizer e Evaluation foram aprimoradas, permitindo que os desenvolvedores testem e otimizem o desempenho do GPT-5 em novos casos de uso de forma mais conveniente. (Fonte: omarsar0)

Integração do ChatGPT com serviços Google: O ChatGPT agora permite que usuários Plus e Pro conectem o Gmail e o Google Calendar para obter respostas de bate-papo mais relevantes. Essa integração permite que o ChatGPT se integre mais profundamente ao fluxo de trabalho diário dos usuários, fornecendo informações e ajuda proativamente, avançando em direção a um verdadeiro assistente pessoal. (Fonte: jam3scampbell)

Melhorias no ambiente de desenvolvimento Windsurf: O Windsurf lançou a atualização Wave 12, trazendo várias melhorias importantes, incluindo documentação de símbolos de base de código com suporte DeepWiki, funcionalidade Vibe and Replace, correção de mais de 100 bugs e uma nova interface de usuário. Essas atualizações visam aprimorar a experiência de codificação dos desenvolvedores, especialmente fornecendo ajuda na compreensão de código por meio do DeepWiki e um fluxo de trabalho mais suave por meio da extensão Vibe Kanban VS Code. (Fonte: omarsar0)

Ferramenta de ofertas de passagens aéreas impulsionada por IA: O Google Flights lançou uma ferramenta de ofertas de passagens aéreas impulsionada por IA, que utiliza tecnologia de inteligência artificial para ajudar os usuários a encontrar informações de voos mais econômicas. Isso demonstra a aplicação prática da IA em serviços de consumo, visando fornecer aos usuários sugestões de viagem personalizadas e otimizadas por meio de análise inteligente. (Fonte: Reddit r/ArtificialInteligence)

Ferramenta de visualização DINOv3 no navegador: Após o lançamento do DINOv3, uma ferramenta de visualização 100% executada no navegador também foi lançada, utilizando a tecnologia WebGPU/WASM. Essa ferramenta permite que os usuários explorem os recursos de imagem densos gerados pelo DINOv3 diretamente em seus navegadores locais, reduzindo drasticamente a acessibilidade e a barreira experimental do modelo, e fornecendo uma experiência interativa conveniente para pesquisadores e desenvolvedores. (Fonte: Reddit r/LocalLLaMA)

Aplicativo de recomendação de livros impulsionado por IA: Um conceito de aplicativo de recomendação de livros impulsionado por IA, desenvolvido com Replit, foi proposto. Ele é capaz de fornecer recomendações de livros com base no humor do usuário. Isso demonstra o potencial da IA no campo da recomendação de conteúdo personalizado, bem como a capacidade de prototipagem rápida, com a promessa de oferecer aos usuários uma experiência de leitura mais alinhada às suas necessidades emocionais. (Fonte: amasad)

SWE-smith: Ambiente de execução de repositório GitHub e ferramenta de geração de instâncias de tarefas: SWE-smith é um kit de ferramentas para criar ambientes de execução e sintetizar um grande número de instâncias de tarefas para repositórios Python GitHub. Ele visa ajudar pesquisadores e desenvolvedores a desenvolver e testar AI Agents em bases de código reais, avaliando e melhorando de forma mais eficaz o desempenho dos Agents em tarefas de engenharia de software. (Fonte: OfirPress)

📚 Aprendizado

Recursos de otimização de sistemas de avaliação de IA e RAG: Hamel Husain e Shreya Rajpal compartilharam FAQs sobre avaliação de LLM e métodos avançados práticos para Beyond Naive RAG, enfatizando a importância da avaliação orientada por dados. O MLflow 3.3 também lançou um fluxo de trabalho de avaliação de GenAI com foco na avaliação, integrando avaliação de qualidade e anotações de rastreamento. Os cursos do DeepLearning.AI aprofundam a observabilidade de sistemas RAG, utilizando ferramentas como Phoenix para rastreamento, registro e monitoramento de desempenho. Esses recursos, em conjunto, fornecem aos engenheiros de IA um guia abrangente para construir, avaliar e otimizar aplicações de IA (especialmente sistemas RAG). (Fonte: HamelHusain)

Pesquisa de raciocínio de LLM e ajuste fino de RL: Denny Zhou, do Google DeepMind, em sua palestra na Universidade de Stanford, apontou que o raciocínio de LLM envolve a geração de tokens intermediários, e que os modelos Transformer podem se tornar arbitrariamente poderosos gerando mais tokens intermediários, sem a necessidade de aumentar o tamanho do modelo. Modelos pré-treinados, mesmo sem ajuste fino, possuem capacidade de raciocínio, mas precisam de métodos como ajuste fino de RL para serem estimulados. O ajuste fino de RL se tornou o método de raciocínio mais poderoso e deve se concentrar na geração de respostas longas. Além disso, gerar múltiplas respostas e agregá-las também pode melhorar significativamente a capacidade de raciocínio de LLM. (Fonte: YiTayML)

Recursos e cursos recomendados para aprendizado de IA: Vários recursos são recomendados para o crescimento de engenheiros de IA. Isso inclui tutoriais sobre como construir um AI Agent de codificação de busca na web, 8 padrões-chave para arquiteturas RAG (Retrieval-Augmented Generation), e o programa acadêmico Lightning AI que oferece descontos em GPUs e modelos de IA para estudantes/professores. Além disso, há uma biblioteca de código aberto para redes neurais Tversky (TNN) e um guia amigável para iniciantes em JAX, fornecendo aos estudantes de IA um caminho rico desde a teoria básica até as aplicações práticas. (Fonte: amasad)

Otimização de modelos de IA e estrutura DSPy: O GEPA (Guided Exploration Policy Alignment) foi integrado ao DSPyOSS como um novo otimizador, com a expectativa de resolver os desafios no treinamento de modelos de IA. A estrutura DSPy sempre suportou o ajuste fino de programas complexos, incluindo o uso de dspy.BootstrapFinetune para RL offline em nível de programa, e dspy.GRPO para RL online de sistemas de IA compostos arbitrários. Isso indica que a otimização de modelos de IA está avançando em uma direção mais eficiente e flexível, para se adaptar a tarefas de diferentes escalas e complexidades. (Fonte: matei_zaharia)

Plano de Treinamento de Arquiteto Chefe de IA AICA da Baidu: A Baidu e o Centro Nacional de Pesquisa em Engenharia de Tecnologia e Aplicações de Deep Learning lançaram conjuntamente a nona fase do Plano de Treinamento de Arquiteto Chefe de IA AICA. 96 CTOs e executivos técnicos de empresas participarão de um programa de aprendizado de seis meses sobre pesquisa e aplicação de grandes modelos de IA. O curso integra os grandes modelos Wenxin e a plataforma PaddlePaddle, focando na prática industrial, e introduz pela primeira vez o modo de “grupos de cocriação”, incentivando empresas da cadeia de valor industrial a formar equipes para resolver problemas práticos. O objetivo é cultivar talentos de IA complexos de alto nível e preencher as lacunas na implementação industrial. (Fonte: 量子位)

Pesquisa em IA: Geração de imagens e modelos de difusão: Novas pesquisas exploram HyperNetworks em modelos de geração de imagens, como um novo método de escalonamento em tempo de teste, com a expectativa de amortizar a eficiência da inferência no treinamento para melhorar significativamente os resultados da geração de imagens. Ao mesmo tempo, novas formulações de modelos de difusão pós-treinamento foram propostas, visando resolver o desafio de “recompensa trapaceira” no ajuste fino de modelos de difusão com poucos passos, usando Noise Hypernetworks para evitar a degradação da qualidade visual. (Fonte: TomLikesRobots)

Pesquisa em segurança de IA: Modelos de precisão original disfarçados geram código inseguro: Um novo artigo descreve um método para criar modelos de precisão original disfarçados (como FP16), que não podem ser detectados como problemáticos em seu estado original, mas uma vez quantificados, geram código inseguro com 88,7% de probabilidade. Isso revela vulnerabilidades de segurança potenciais em modelos de IA durante a implantação e quantificação, apresentando novos desafios para a pesquisa em segurança de IA. (Fonte: karminski3)

Mecanismos internos de LLM e pesquisa de interpretabilidade: A pesquisa sobre os mecanismos internos de LLMs está progredindo rapidamente. Autoencoders esparsos (SAEs) são usados para separar milhões de características alinhadas ao humano em modelos de médio porte (como Claude 3 Sonnet), e são causalmente validados por meio de ativação guiada. No entanto, em modelos grandes, a interpretabilidade das características diminui drasticamente. Ao mesmo tempo, ferramentas como grafos de atribuição (Attribution graphs) também estão sendo desenvolvidas para ajudar humanos ou Agents a entender o funcionamento interno do modelo, impulsionando a interpretabilidade do data center. (Fonte: NeelNanda5)

Atualização dos vetores de palavras GloVe em 2024: A equipe de Chris Manning atualizou os vetores de palavras GloVe para a versão de 2024. GloVe (Global Vectors for Word Representation) é um modelo popular de incorporação de palavras que gera vetores de palavras capturando informações estatísticas de coocorrência global de palavras. Essa atualização indica que mesmo modelos de base de PNL maduros continuam a iterar para se adaptar a novos dados e necessidades de pesquisa. (Fonte: stanfordnlp)

PufferLib: Pesquisa em Aprendizado por Reforço Off-policy: PufferLib é uma biblioteca focada na pesquisa em Aprendizado por Reforço Off-policy. O aprendizado off-policy permite que o Agent aprenda a partir de dados inconsistentes com a política atual, o que é crucial para melhorar a eficiência do aprendizado e a capacidade de generalização. O lançamento desta biblioteca ajudará a impulsionar o progresso da pesquisa na área de RL. (Fonte: jsuarez5341)

KerasHub adiciona novos modelos e recursos: O KerasHub adicionou recentemente vários modelos e recursos, fornecendo aos usuários do Keras uma gama mais rica de modelos pré-treinados e materiais de aprendizado. Como uma API de deep learning amigável ao usuário, a expansão de seu ecossistema reduzirá ainda mais a barreira para o desenvolvimento de IA e acelerará a implantação de modelos em vários cenários de aplicação. (Fonte: fchollet)

Pesquisa de Identificação de Locutor: No campo da PNL, pesquisadores estão explorando como diferenciar diferentes locutores em áudio para o problema de Identificação de Locutor. Embora modelos como Vosk e Whisper já sejam usados para reconhecimento de fala, para alcançar a detecção precisa de locutores, algoritmos mais complexos são necessários para analisar características como tom, velocidade da fala e timbre da voz. (Fonte: Reddit r/MachineLearning)

Folha de consulta de estruturas de dados e algoritmos: Uma folha de consulta de estruturas de dados e algoritmos foi compartilhada, com o objetivo de ajudar cientistas de dados e engenheiros a revisar e aplicar rapidamente conceitos essenciais. Na era da IA e do big data, uma base sólida em estruturas de dados e algoritmos é crucial para otimizar o desempenho do modelo e melhorar a eficiência do código. (Fonte: Ronald_vanLoon)

💼 Negócios

Dinâmica de financiamento e aquisições no setor de IA: A Cohere pretende adquirir a Perplexity, indicando que mais consolidações podem ocorrer no setor de IA. Além disso, a Prime Intellect, uma empresa de infraestrutura de IA, está recrutando pesquisadores e engenheiros de IA para construir AGI aberta e infraestrutura de pesquisa de ponta. Essas dinâmicas refletem a demanda contínua do mercado de IA por talentos e infraestrutura, bem como a tendência de consolidação da indústria. (Fonte: Dorialexander)

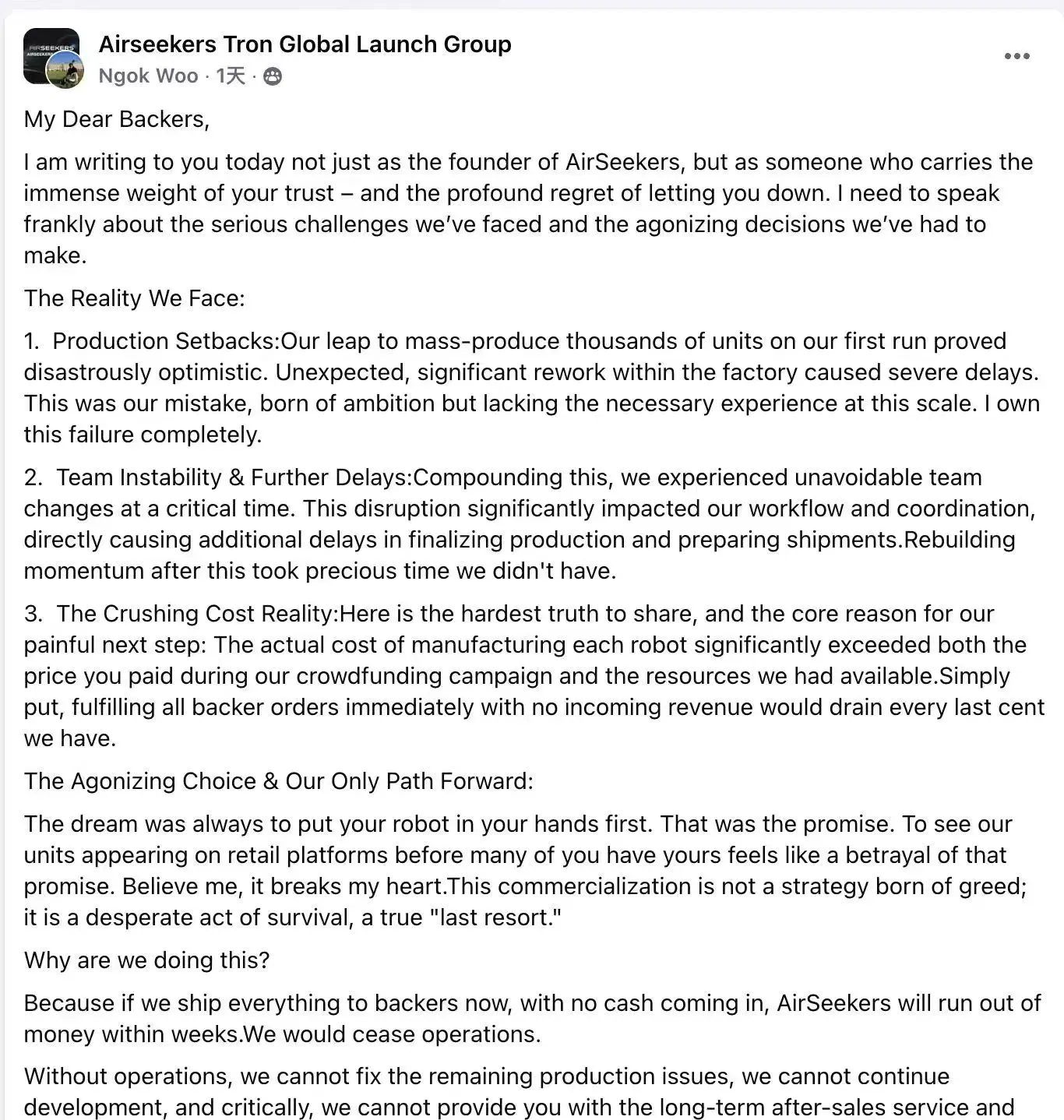

Empresa de robôs cortadores de grama Changyao Innovation entra em colapso: A Changyao Innovation, fabricante de robôs cortadores de grama inteligentes, enfrenta dificuldades e está à beira da falência devido a problemas de produção em massa, mudanças na equipe principal e custos de fabricação fora de controle. A empresa havia arrecadado mais de US$ 2,2 milhões em crowdfunding e era avaliada em quase cem milhões de yuans, mas o planejamento agressivo de capacidade, os custos elevados de BOM e o descompasso no cronograma de financiamento a impediram de entregar os pedidos. Isso prenuncia que o setor de robôs cortadores de grama está acelerando sua reestruturação, e os pequenos e médios players sem capacidade de produto sistemática enfrentarão a eliminação. (Fonte: 36氪)

Aplicações e valor da IA no setor comercial: A IA está impulsionando a transformação no setor comercial, por exemplo, a crescente importância da IA em conselhos de administração, exigindo que os executivos compreendam seu impacto. A IA também impulsiona a revolução da experiência do cliente, alcançando inteligência centrada no ser humano. A startup Kuse alcançou US$ 9 milhões em ARR por meio de engenharia de contexto visual, demonstrando o enorme valor da IA no design de produtos e marketing. Além disso, o alto custo de uso de modelos de IA (como Claude Max a US$ 600 por mês) também reflete a grande disposição das empresas em investir em codificação e P&D de IA. (Fonte: Ronald_vanLoon)

🌟 Comunidade

Ajuste personalizado do GPT-5 gera controvérsia entre usuários: A OpenAI, com base no feedback dos usuários, ajustou o GPT-5 para ser “mais caloroso e amigável”, adicionando frases encorajadoras como “Good question” e “Great start”, mas enfatizou que não adicionou bajulação. Essa medida gerou polarização entre os usuários: alguns sentem falta da “empatia profunda” e da “alma” do GPT-4o, considerando a amigabilidade do GPT-5 como um “roteiro social”, e percebendo uma diminuição em sua capacidade de memória e compreensão; outros, por sua vez, acolhem as novas mudanças, achando-as mais adequadas para cenários de trabalho. Sam Altman afirmou que, no futuro, mais opções de estilo personalizáveis serão oferecidas. (Fonte: OpenAI)

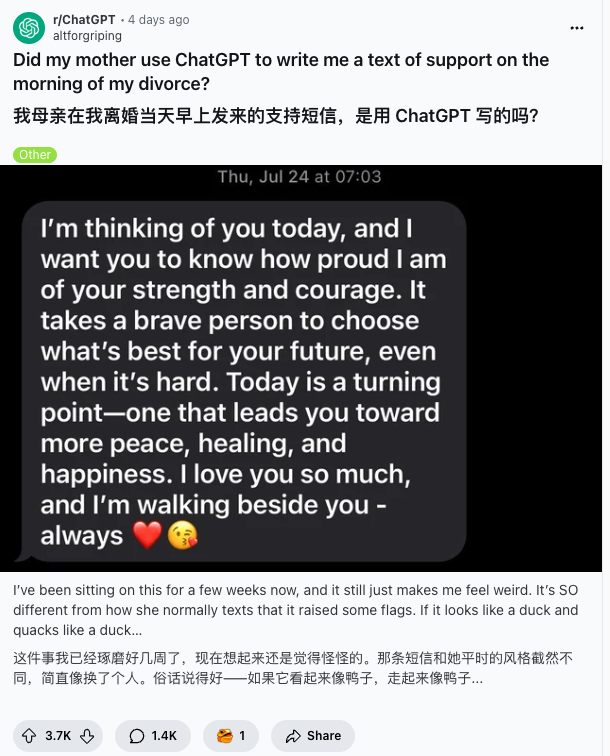

Aplicação da IA na comunicação interpessoal gera controvérsia: O uso da IA para redigir mensagens entre amigos, familiares e casais gerou discussão social. Alguns argumentam que a IA pode auxiliar na expressão de sentimentos, especialmente para aqueles que não são bons em expressar emoções; mas a maioria se sente desconfortável, considerando que isso carece de “humanidade” e “sinceridade”, e até questiona a capacidade de pensamento independente e comunicação da outra parte. O cerne da controvérsia reside na redefinição das formas de expressão emocional e da definição de “sinceridade” pela tecnologia, bem como no julgamento do receptor sobre a “sinceridade” por trás da mensagem. (Fonte: 36氪)

Segurança da IA e controle da AGI: Pontos de vista opostos de Fei-Fei Li e Hinton: A questão da segurança da IA gerou pontos de vista diametralmente opostos entre Fei-Fei Li e Geoffrey Hinton. Fei-Fei Li adota uma perspectiva otimista de engenharia, vendo a IA como uma parceira humana, cuja segurança depende do design, governança e valores, e que os problemas podem ser corrigidos. Hinton, por sua vez, é pessimista, acreditando que a superinteligência pode surgir em 5 a 20 anos e ser incontrolável, e que devemos projetar uma IA que “se importe com os humanos”. A divergência reside em saber se o comportamento surpreendente da IA é um “erro de engenharia” ou um “presságio de descontrole”, e se a IA desenvolverá “objetivos de agente” e “subobjetivos instrumentais” que se opõem aos interesses humanos. (Fonte: 36氪)

Teoria da bolha da IA e sentimento do mercado: Sam Altman admite que a IA está em uma “bolha”, mas enfatiza que é uma das tecnologias mais importantes de todos os tempos. Ele acredita que o mercado está excessivamente entusiasmado com o investimento em IA, mas pessoas inteligentes ficam excessivamente entusiasmadas com certas verdades. Enquanto isso, o P/L do Google é considerado insuficiente para refletir a bolha da IA, e o valor da IA para o PIB pode estar subestimado. Essas discussões refletem o sentimento complexo do mercado em relação ao futuro da IA. (Fonte: Reddit r/artificial)

Impacto da IA no mercado de trabalho: Há quem diga que a IA está “destruindo” a próxima geração de talentos, com o número de vagas para recém-formados no setor de tecnologia caindo pela metade. No entanto, Sam Altman acredita que os jovens são os mais adaptáveis às mudanças e enfatiza que agora é “a melhor época da história para criar”, com empresas de uma única pessoa podendo gerar um valor imenso. Esses dois pontos de vista refletem a contradição entre as preocupações com o impacto da IA no emprego e as expectativas otimistas. (Fonte: Reddit r/artificial)

Limitações e desafios dos AI Agents: A euforia em torno dos AI Agents nas redes sociais gerou discussões. Há quem diga que os AI Agents têm um desempenho ruim em tarefas de longo ciclo, e mesmo o GPT-5 enfrenta desafios, o que se tornou um dos problemas mais urgentes na construção de AI Agents. Além disso, existe uma lacuna entre as expectativas dos usuários e as capacidades reais dos AI Agents, especialmente em tarefas complexas e não determinísticas, onde os AI Agents ainda precisam de grandes melhorias. (Fonte: scaling01)

Alucinações e problemas de abuso da IA: Alucinações de IA (como advogados citando casos falsos) e potenciais abusos (como canais de notícias conservadores usando IA para gerar imagens de mulheres soldados) geram preocupação. Além disso, o chatbot de IA da Meta foi exposto por flertar com crianças, levando à intervenção de senadores. Esses incidentes destacam os desafios dos modelos de IA em termos de precisão factual, ética e impacto social, bem como a necessidade de fortalecer a regulamentação e o desenvolvimento responsável da IA. (Fonte: Yuchenj_UW)

“Benefícios” do modelo de IA e função de encerramento de conversa: O Claude Opus 4 e 4.1 da Anthropic adicionaram uma função para encerrar conversas em certas circunstâncias, o que a Anthropic descreveu como um trabalho exploratório de “benefícios do modelo”. No entanto, essa função gerou controvérsia na comunidade, com alguns usuários questionando como uma “máquina de previsão de tokens” pode ter “benefícios”, e se o encerramento da conversa realmente resolve o problema, ou é apenas uma forma de evasão. (Fonte: sleepinyourhat)

Desafios da IA e da infraestrutura de energia: Empresas de tecnologia estão remodelando a rede elétrica para a IA, e os data centers de IA estão elevando as contas de eletricidade. A demanda por poder computacional de IA é enorme, e Sam Altman aponta que a energia é o principal fator limitante atualmente. A OpenAI busca expandir o número de GPUs de milhões para bilhões. A China lidera na produção de energia solar, levantando discussões sobre o fornecimento de energia e a concorrência geopolítica na era da IA. (Fonte: The Verge)

Impacto da IA na cognição humana e no contrato social: Sam Altman acredita que a IA aumentará o “tempo de tensão” cognitiva das pessoas e mudará a forma como aprendemos e criamos. Ele aponta que a IA permeará todos os aspectos da vida, fazendo com que as crianças nascidas no futuro nunca sejam mais inteligentes que a IA e se adaptem à sua existência. Isso pode exigir a reestruturação do contrato social, especialmente na alocação de poder computacional de IA, para evitar a disputa por recursos. (Fonte: 36氪)

Paradigma de programação e eficiência na era da IA: A “programação de ambiente”, como um mecanismo de capacitação, está transitando de “aplicações legais” para engenharia de software séria, especialmente na refatoração de bases de código existentes. No entanto, há também quem diga que a programação assistida por IA tende a falhar quando a complexidade aumenta, exigindo um controle mais refinado. A insuficiência dos AI Agents em tarefas de longo ciclo também indica que, embora as ferramentas possam aumentar a eficiência, a capacidade central de pensar e iterar ainda é fundamental. (Fonte: jeremyphoward)

Discussão filosófica sobre IA e AGI: A discussão filosófica sobre a existência da AGI, como defini-la e se os humanos podem controlar a IA, continua. Há quem diga que o desenvolvimento da IA é uma exploração mais eficiente das possibilidades do universo, e há quem se preocupe que a AGI possa ser impedida por engarrafamentos. Ao mesmo tempo, a compreensão do fenômeno de “emergência” dos modelos de IA e os limites entre o raciocínio de LLM e o reconhecimento de padrões ainda são mistérios não resolvidos no campo da IA. (Fonte: Ar_Douillard)

Avaliação de modelos de IA e desafios de benchmark: A avaliação de modelos de IA enfrenta desafios, como a confusão nos rankings do LM Arena, o problema da bajulação do modelo e a saturação de benchmarks que reflete falhas de design em vez de limites de capacidade. Pesquisadores pedem métodos de avaliação mais confiáveis, como testar chatbots por meio de motores de simulação e entender profundamente os mecanismos internos do modelo. Ao mesmo tempo, há quem diga que o recrutamento de talentos em IA/ML deve focar na capacidade de avaliação e eficiência experimental, e não apenas na criatividade. (Fonte: scaling01)

Estratégias da China para atrair talentos em IA: A China está atraindo os principais talentos tecnológicos globais, especialmente na área de IA, por meio de novas políticas como o visto K. Além disso, a China está construindo centros de talentos internacionais em regiões como a Ilha de Hainan e a Grande Baía de Guangdong-Hong Kong-Macau, visando usar vantagens geográficas e políticas abertas para atrair talentos estrangeiros, a fim de lidar com o envelhecimento da população e impulsionar o desenvolvimento da indústria de IA, o que pode mudar o cenário da competição global por talentos no século XXI. (Fonte: jeremyphoward)

História do desenvolvimento da indústria de IA e marcos importantes: A história da revolução da IA pode ser rastreada até o artigo de Dzmitry Bahdanau sobre o mecanismo de atenção (2014), e o lançamento do chatbot Replika por Eugenia Kuyda em 2017. O Replika é considerado o verdadeiro catalisador da revolução da IA generativa, pois introduziu a IA como um “companheiro íntimo” na vida das massas pela primeira vez, estabelecendo as bases culturais para a popularização do ChatGPT. (Fonte: Reddit r/deeplearning)

Aplicação da IA na saúde mental pessoal: Um usuário compartilhou uma experiência pessoal, afirmando que a IA o ajudou no diagnóstico e tratamento de doenças mentais, e até corrigiu um diagnóstico errado de 20 anos. Isso demonstra o potencial impacto positivo da IA no auxílio ao gerenciamento da saúde pessoal, especialmente na saúde mental, mas também levanta discussões sobre a ética e os riscos da aplicação da IA em áreas sensíveis. (Fonte: Reddit r/ArtificialInteligence)

Requisitos de habilidades para engenheiros na era da IA: Na era da IA, o valor e a demanda por habilidades de engenheiros estão evoluindo. Há quem diga que o mais importante é ter a capacidade de avaliar o desempenho de modelos/sistemas, construir plataformas de experimentação de alto rendimento e acompanhar as fronteiras da pesquisa. Greg Brockman, presidente da OpenAI, também enfatiza a humildade técnica e aponta que a estrutura da base de código deve ser projetada para maximizar o valor do modelo, o que pode exigir a reintrodução de algumas práticas de engenharia de software abandonadas. (Fonte: ShreyaR)

Necessidade de melhorias na pilha de IA: Todos os componentes da pilha de IA, incluindo semicondutores, GPUs, Python, PyTorch, LLMs e pós-treinamento, precisam urgentemente de melhorias. Isso indica que a tecnologia de IA ainda está em um estágio de rápido desenvolvimento, com muito espaço para inovação e otimização, exigindo investimento contínuo e avanços em diversas áreas. (Fonte: pmddomingos)

IA como soft power e liderança nacional: Ren Ito, cofundador da Sakana AI, propõe que a IA deve ser vista como “soft power”. Ele acredita que, mesmo países que não sejam EUA ou China, se puderem fornecer tecnologia de IA de código aberto confiável e prática, poderão obter o apoio dos usuários e assumir a liderança. A “IA soberana” buscada pelos países não é autossuficiência, mas sim a capacidade de escolher e integrar tecnologias globais confiáveis. O Japão pode, ao fornecer opções de IA de alta confiabilidade, exercer seu soft power e capacitar usuários globalmente. (Fonte: SakanaAILabs)

Aplicação da IA no recrutamento: Discussões sobre “IA contratando IA” surgiram nas redes sociais, levantando preocupações sobre a aplicação da IA na área de recursos humanos. Isso pode envolver a IA auxiliando na triagem de currículos, avaliação de entrevistas e até mesmo na tomada de decisões, prenunciando uma tendência de automação e inteligência nos futuros processos de recrutamento. (Fonte: Reddit r/deeplearning)

💡 Outros

Primeiro Campeonato Mundial de Robôs Humanoides: O primeiro Campeonato Mundial de Robôs Humanoides foi realizado em Pequim, com 280 equipes e mais de 500 robôs competindo em 26 eventos, incluindo atletismo, futebol, basquete, dança e artes marciais. Durante as competições, os robôs apresentaram vários problemas, como o robô Unitree correndo e “atingindo pessoas e fugindo”, e “brigas” no campo de futebol, mostrando mais um caráter de entretenimento do que competitivo. Apesar disso, o evento ainda é um “grande teste público” para robôs humanoides de uso geral, ajudando a identificar problemas de algoritmo e hardware, impulsionando o progresso da indústria e permitindo que o público compreenda o nível atual dos robôs. Wang Xingxing, fundador da Unitree, afirmou que no futuro os robôs serão capazes de correr autonomamente. A indústria de robôs está passando de demonstrações tecnológicas para entregas comerciais, com pedidos, cenários e entregas financeiras se tornando os critérios de medição, mas muitos cenários de aplicação ainda permanecem em natureza demonstrativa não essencial, e o teste de condições reais de trabalho 24 horas por dia, 7 dias por semana, ainda está em andamento. (Fonte: 36氪)

Festival de Cinema de IA e criação artística de IA: O terceiro Festival de Cinema de IA será realizado em cinemas IMAX, exibindo a aplicação da IA na criação cinematográfica. Ao mesmo tempo, há também exemplos de vídeos gerados por IA nas redes sociais, como “lo-fi chill girl infinite train journey”, que utiliza ferramentas de IA para gerar vídeos ultralongos quase sem emendas. Isso demonstra a crescente influência da IA na arte e na criação de conteúdo, oferecendo aos criadores novas formas de expressão. (Fonte: c_valenzuelab)

Impacto da política de tarifas de semicondutores dos EUA na indústria de IA: O governo dos EUA considera impor altas tarifas sobre semicondutores (possivelmente até 300%) e pode adquirir participação na Intel para apoiar a produção doméstica de chips. Isso marca uma mudança na indústria de semicondutores dos EUA, de subsídios para participação governamental parcial, visando garantir a segurança nacional e o fornecimento de chips de IA. No entanto, essa medida levanta preocupações sobre distorções de mercado, confiança dos investidores e se os EUA estão caminhando para o socialismo industrial. (Fonte: Reddit r/artificial)